技术背景

在大多数情况下,我们都推荐用户在编译处理图像任务的模型时,将input_type_rt参数配置nv12,这是考虑到视频通路传来的数据通常都是nv12类型,这样配置可以最大化地节约耗时,提高全流程的处理效率。

但在前期的算法验证阶段,往往用户更希望模型能直接读取rgb/bgr数据,以更加直观地检查量化效果。在这种使用场景下,往往需要对图像数据做一些专门的处理,否则会产生错误的输出结果。本教程会详细介绍如何在input_type_rt配置rgb/bgr时,正确地处理输入数据。

工具链环境

模型说明

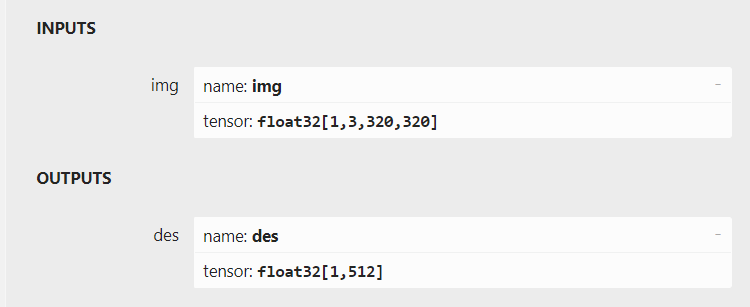

这次作为范例使用的模型是mixvpr,这是一个视觉场景识别算法,输入为1x3x320x320的图像,输出是1x512的全局描述子。onnx模型的输入输出的具体信息如下图所示:

yaml配置情况如下,浮点模型由rgb训练,且希望验证rgb输入的效果,因此input_type_rt和input_type_train都配置为rgb,同时input_layout_rt和input_layout_train都配置为NCHW,也配置了mean和scale参数。

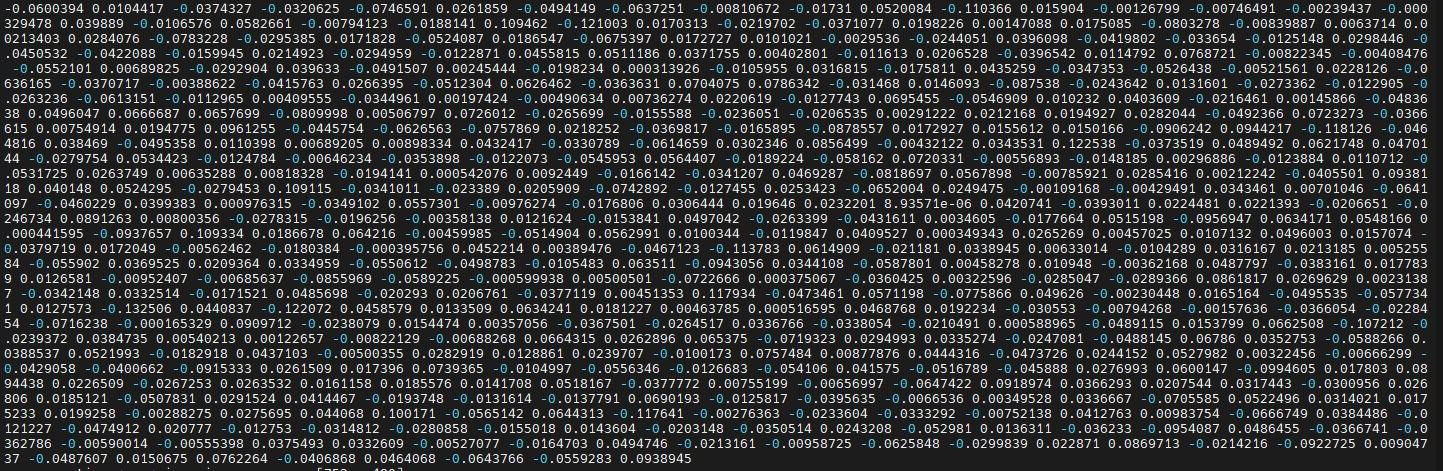

模型的原始输入为一张320x320的彩色png图像,pytorch浮点模型的推理结果如下,可作为量化效果的参考:

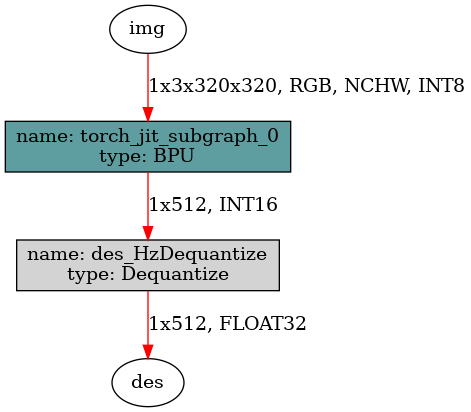

模型编译完成后,可以运行hb_perf mix.bin,查看生成的png图,了解bin模型的子图结构:

推理quantized.onnx

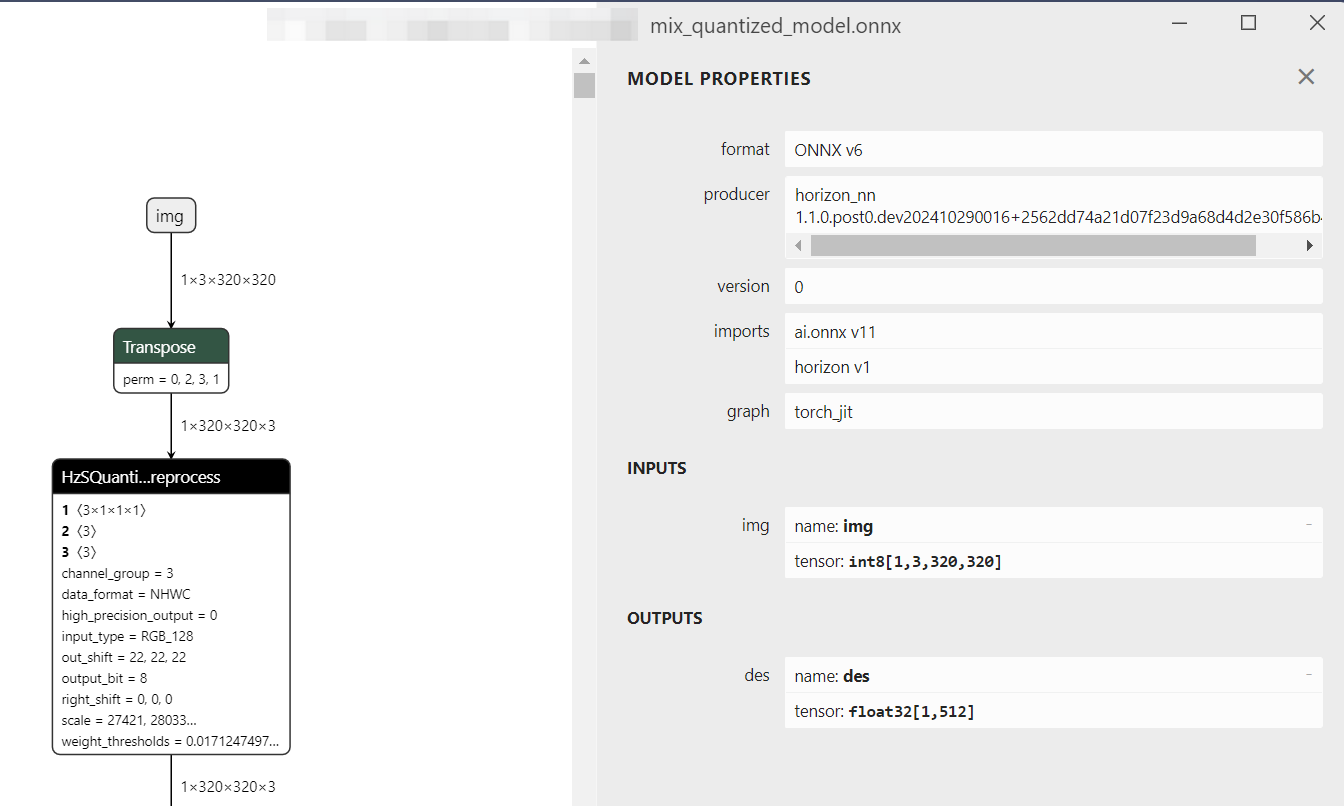

首先我们需要确认quantized.onnx的输入情况,该模型的输入shape为1x3x320x320,数据类型为int8,并且色彩空间应当是rgb类型(对应input_type_rt)

但我们知道,opencv读图后,得到的数据是bgr,hwc,uint8,且3维的,因此需要做一些预处理,才可以得到正确的输入数据。从读图到预处理到推理quantized.onnx的完整代码,及详细注释如下:

推理完成后查看输出结果,发现和浮点输出较为接近,说明该推理结果可靠

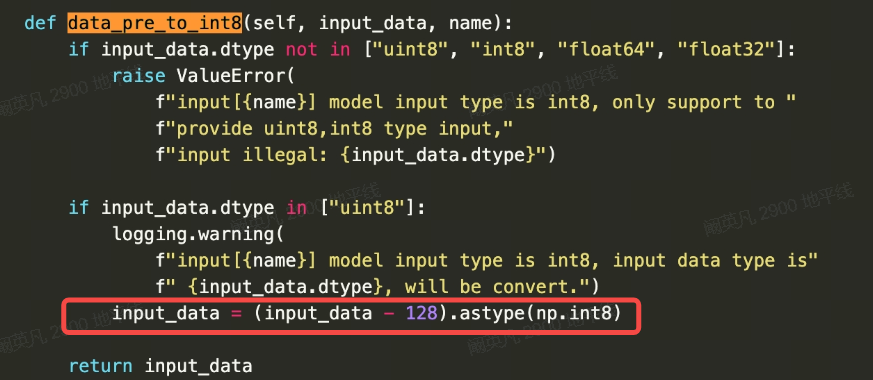

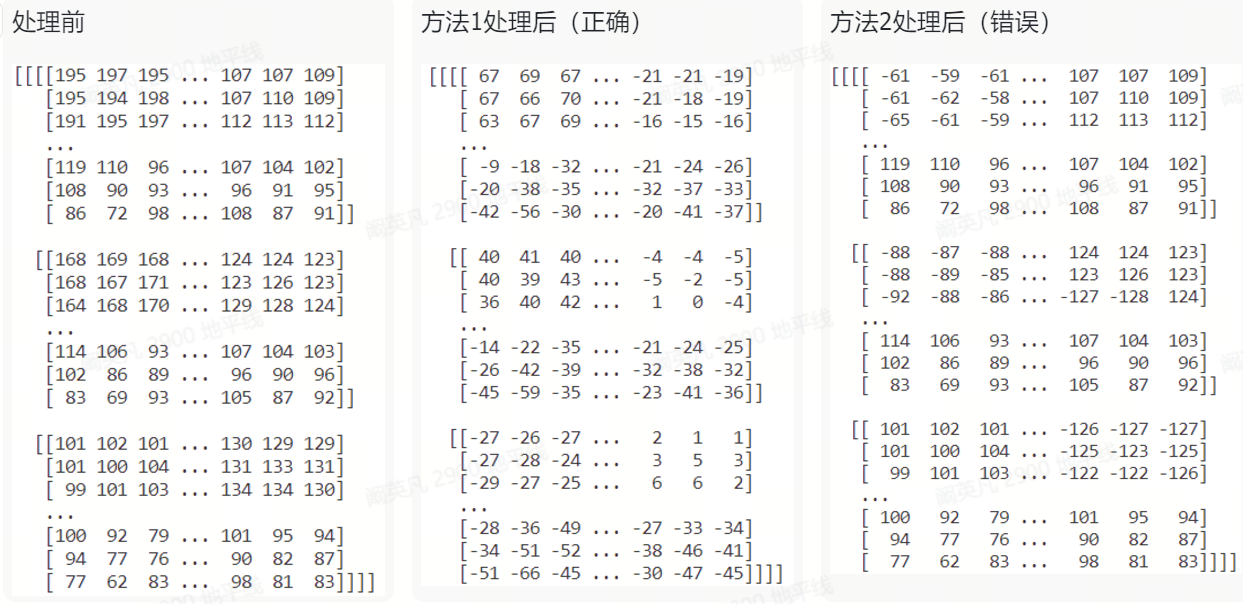

方法1(正确):在数值上,所有数据全部-128,对应上文代码中的data=(data-128).astype(np.int8)

方法2(错误):在数值上,0到127的值不变,128到255的值-256,对应data=data.astype(np.int8)

如果用户只写了data=data-128,那么此时的数据类型还是uint8,HB_ONNXRuntime会继续做data=(data-128).astype(np.int8)操作,这两个操作就等效成了data=data.astype(np.int8)

方法2处理后,得到的推理结果也是完全错误的,和浮点输出对不上

因此请务必确保,在uint8转int8这一步,使用data=(data-128).astype(np.int8),或者不转,让HB_ONNXRuntime自动执行这一操作。

推理bin

可以借助hrt_model_exec的infer功能推理模型,hrt_model_exec的源码已经开放,用户可以直接参考/package/board/hrt_tools/src/hrt_model_exec目录。

对于rgb_128_int8.bin输入,模型的推理结果如下,和quantized.onnx的输出结果完全一致。