自动泊车端到端算法ParkingE2E介绍

一、算法介绍:

输入:1. 去完畸变的RGB图 2. 目标停车位

输出:路径规划

论文精读博客参考链接:https://blog.csdn.net/qq_45933056/article/details/140968352

源代码:https://github.com/qintonguav/ParkingE2E

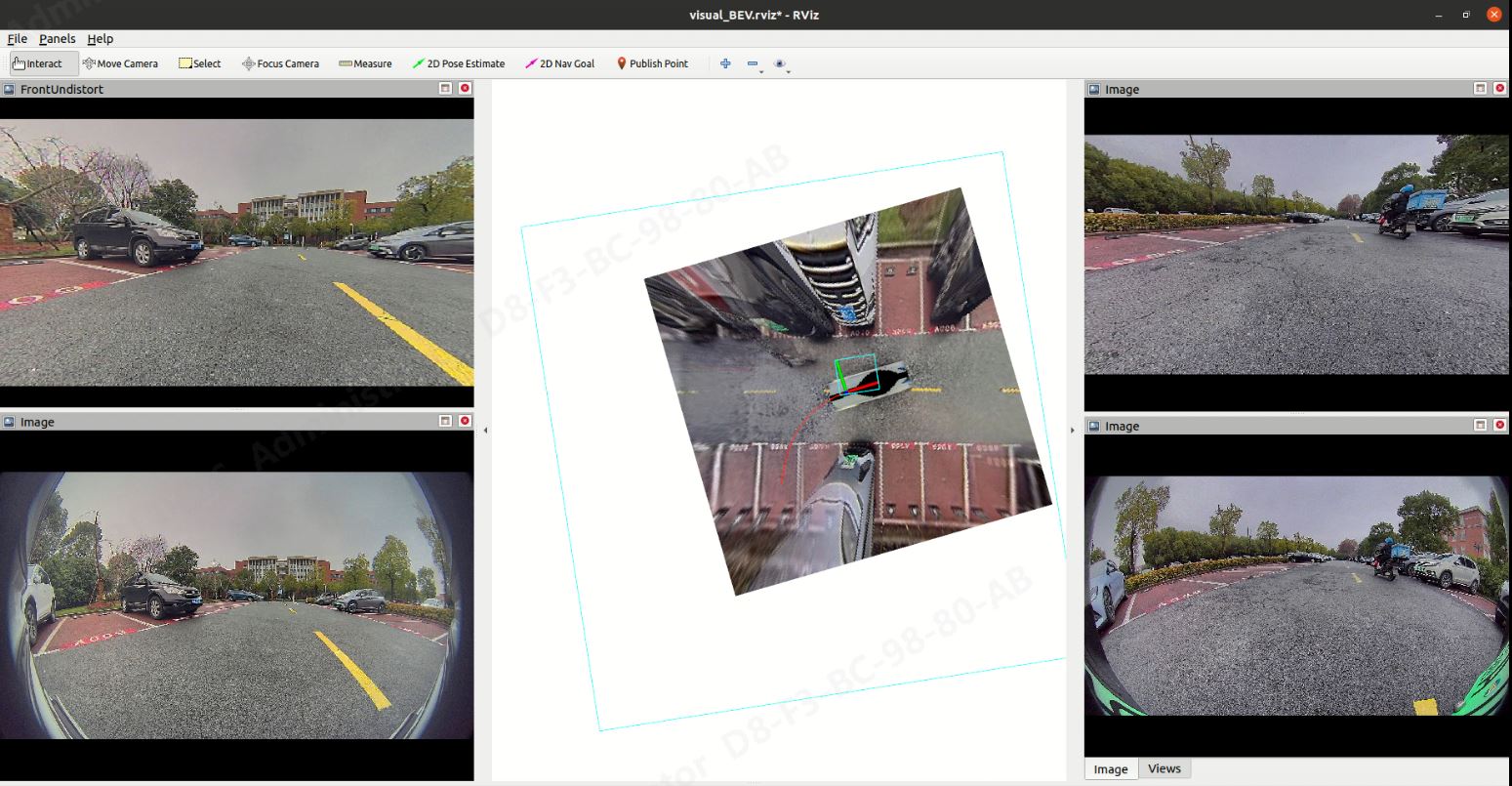

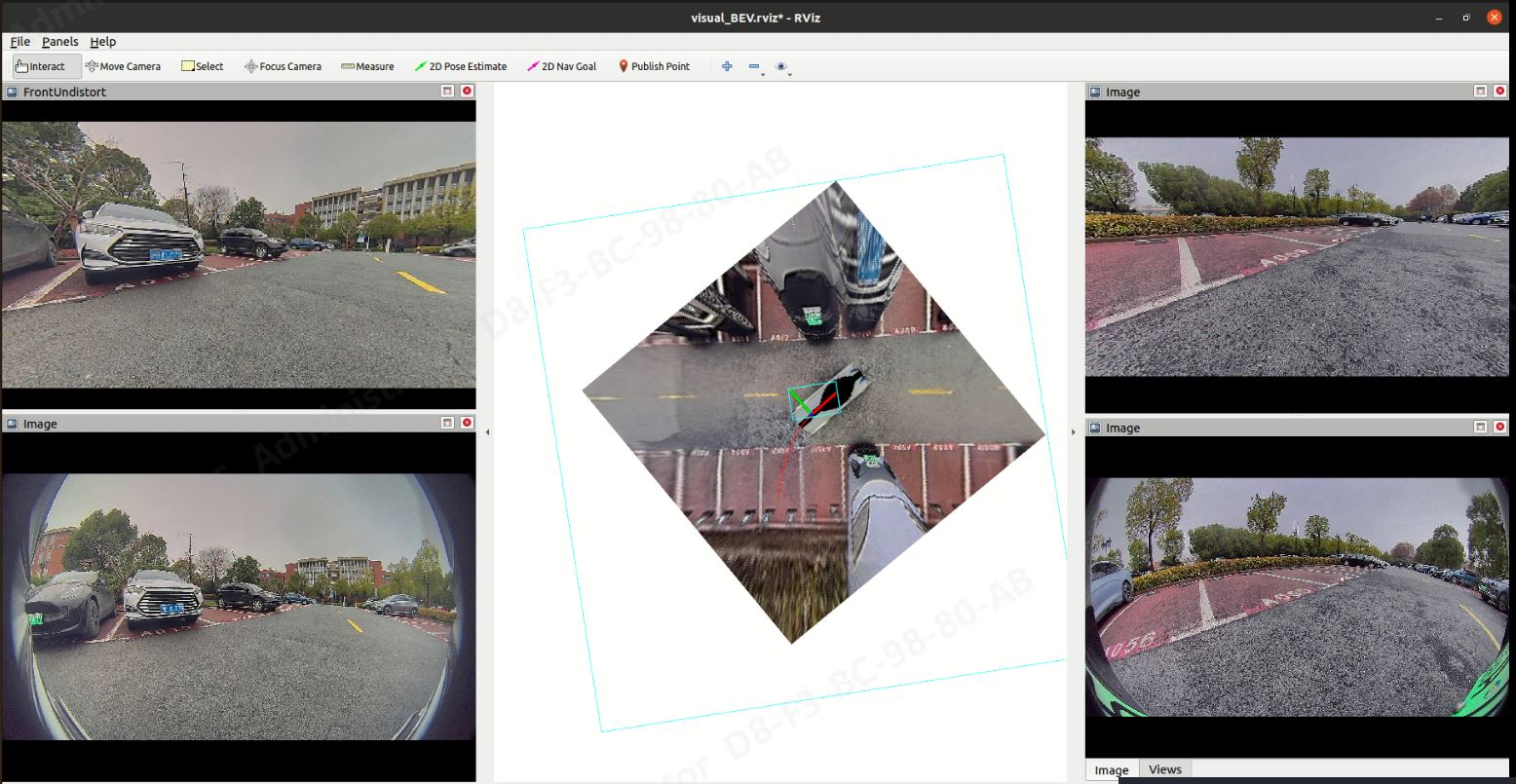

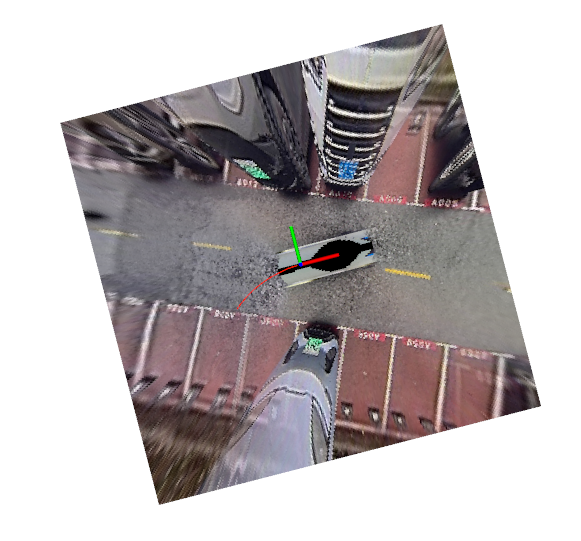

二、算法部署后的demo效果展示

三、实现过程

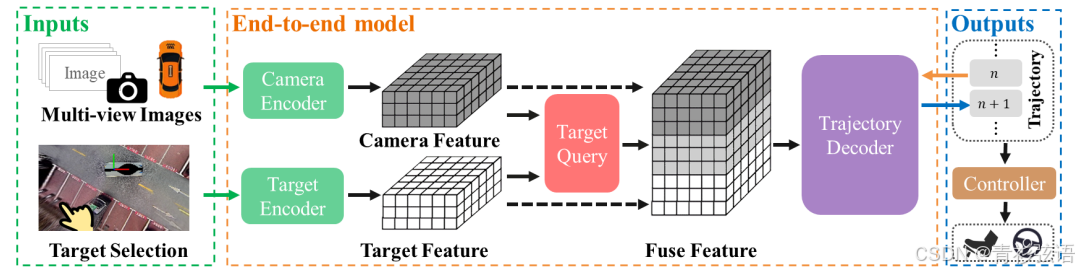

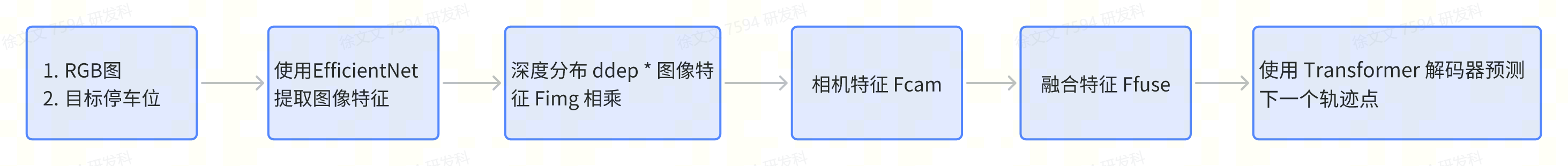

算法整体架构:

多视角 RGB 图像被处理,图像特征被转换为 BEV(鸟瞰图)表示形式。使用目标停车位生成 BEV 目标特征。我们通过目标查询将目标特征和图像 BEV 特征融合。然后我们使用自回归的 Transformer 解码器逐个获得预测的轨迹点。

训练过程:

注:训练数据集是去完畸变的图像,在数据处理时需要对4路鱼眼相机进行标定,获取相机内外参,对鱼眼图进行去畸变,去完畸变的图像会被制作成训练集

1.获取去完畸变的RGB图像和目标停车位做为输入

去完畸变的RGB图像示例:

目标停车位坐标示例:

使用EfficientNet从RGB图像中提取特征

将预测的深度分布 ddep 与图像特征 Fimg 相乘,以获得具有深度信息的图像特征

将图像特征投影到 BEV 体素网格(特征的大小为200×200,对应实际空间范围x∈[−10m, 10m], y∈[−10m, 10m],分辨率为0.1米)中,生成相机特征 Fcam

BEV视图示例:

使用深度 CNN 神经网络提取目标停车位特征 Ftarget

在BEV空间,将相机特征 Fcam和目标停车位特征 Ftarget 进行融合,获取融合特征 Ffuse

使用 Transformer 解码器以自回归方式预测轨迹点

实现过程图标表示:

推理过程:

1.在RViz界面软件中使用“2D-Nav-Goal”来选择目标停车位

2.获取起始位姿,将以起始点为原点的世界坐标转化为车辆坐标

3.组合数据输入到transformer进行推理,预测轨迹序列

4.将预测的轨迹序列发布到rviz进行可视化

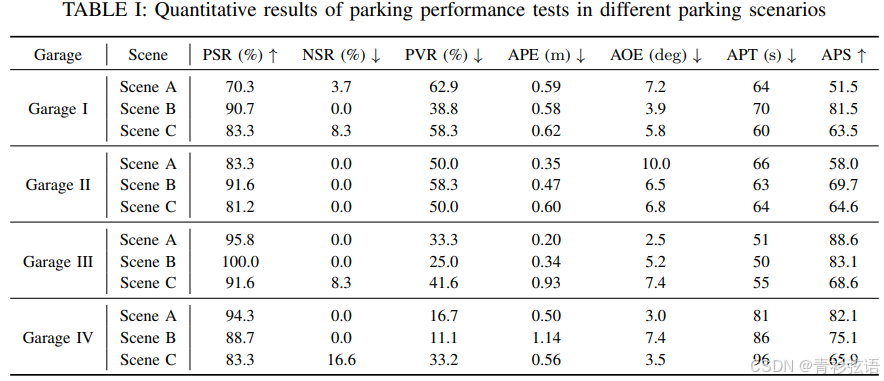

四、评估指标

端到端实车评估:在实车实验中,我们使用以下指标来评估端到端停车性能。

关键词解释:

PSR:停车成功率 NSR:无车位率 PVR: 停车违规率 APE:平均位置误差 AOE:平均方向误差

APS:平均停车得分 APT: 平均停车时间

五、局限性

由于数据规模和场景多样性的限制,我们的方法对移动目标的适应性较差

训练过程需要专家轨迹

与传统的基于规则的停车方法相比仍有差距