引言

J6参考算法中的tools/export_onnx.py默认导出的是qat.onnx,近期有不少用户错误地使用此qat.onnx进行推理和PTQ从而出现报错情况,本篇文章将以bevformer参考算法为例讲述如何导出原始浮点onnx。

权重下载

OE开发包下的samples/ai_toolchain/horizon_model_train_sample/scripts/configs/bev/README.md提供了权重下载链接。注意ckpt下载完成后配置一下config文件中的ckpt_dir 参数。

config文件修改

将config文件中onnx_cfg字段的stage配置为“float”;

将model_convert_pipeline配置为float_predictor["model_convert_pipeline"];

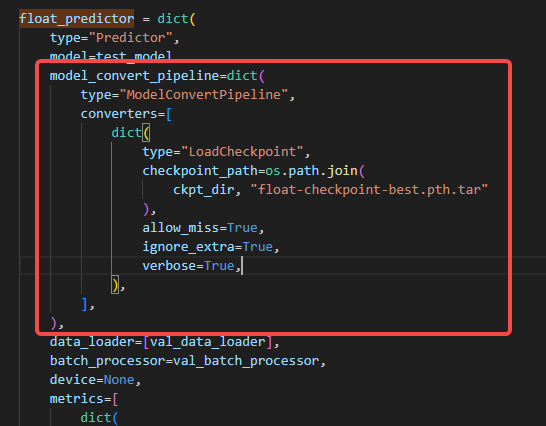

float_predictor["model_convert_pipeline"]如下,加载了浮点的ckpt:

运行export_onnx.py脚本

config文件修改完成后,使用以下代码导出float.onnx:

命令运行完成后会在ckpt_dir目录下生成float.onnx。