前言

在上一篇文章中,我们深入探讨了VLM 模型在自动驾驶中的应用。VLA(Vision Language Action)和 VLM(Vision Language Model)在 AI 领域皆指向超大规模的神经网络模型,然而,它们的侧重点存在显著差异。VLA 端到端特指融合视觉、语言和动作这三种能力的端到端自动驾驶架构。细致来讲,它是一种前沿的多模态机器学习模型,致力于达成从感知输入径直映射到机器人或汽车控制动作的完备闭环。

今天,我们就来全面介绍一下 VLA 模型在自动驾驶中的具体应用。

VLA与 VLM的区别

VLA模型是在视觉语言模型VLM的基础上发展衍生而来的。视觉语言模型(VLM)是机器学习模型中的一个重要类别,它具备强大的能力,可以对图像和自然语言文本进行处理。具体而言,视觉语言模型(VLM)在工作时,既可以将单张图片作为输入,也能够接收多张图片同时输入,然后经过一系列的计算和处理,生成一系列用于表达自然语言的标记。这些标记就像是一种特殊的“语言代码”,能够将图像中的信息以自然语言的形式表达出来。

然而,VLA模型相较于视觉语言模型(VLM),其功能更加丰富多样。VLA模型会利用机器人或者汽车运动轨迹的数据,对现有的视觉语言模型(VLM)开展进一步的训练。这种训练方式是在原有视觉语言处理能力的基础上,加入了关于实际运动轨迹的信息,使得模型能够学习到在现实物理世界中如何根据图像和语言指令进行行动。经过这样的训练后,VLA模型便可以输出可用于控制机器人或汽车的动作序列。这些动作序列就像是给机器人或汽车下达的具体行动指令,能够精确地指导它们在现实环境中做出相应的动作。通过这种独特的方式,VLA模型不仅能够解读复杂的指令,理解指令背后所蕴含的图像信息和语言意图,还能够将这些理解转化为实际行动,在现实物理世界中执行相应的动作,实现从语言理解到物理操作的跨越。

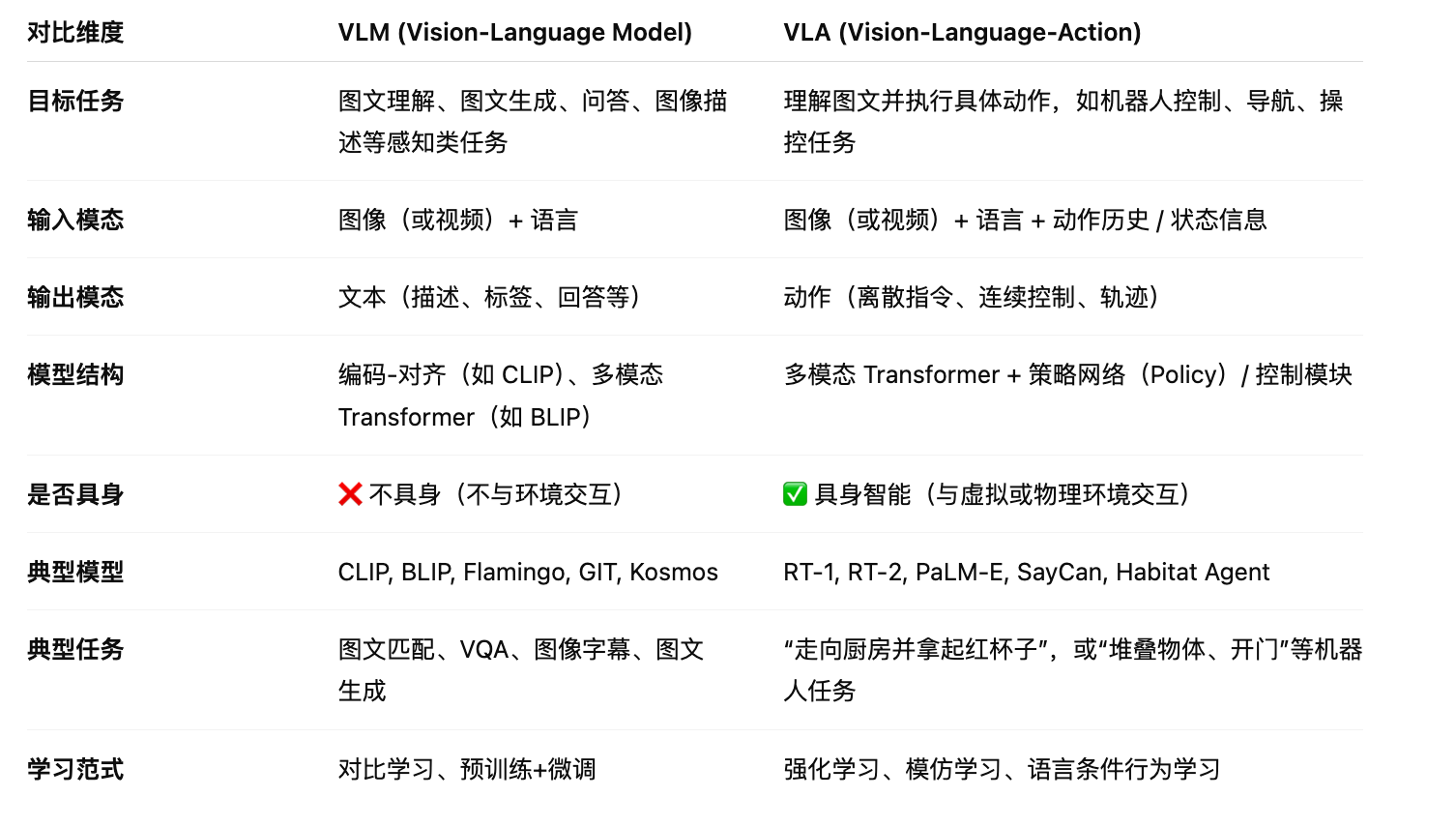

二者区别可以总结为:

VLA的核心技术

多模态融合(Multimodal Fusion)

- 技术目标:将视觉(图像/视频)、语言(自然语言指令)和动作(机器操作或导航行为)统一建模。

- 关键技术:

- CLIP/BERT + CNN/ViT + 动作空间编码:将图像、语言指令、历史动作序列编码为共享语义空间。

- Cross-modal Transformer:用于不同模态间的交互建模。

- 多模态对比学习:如 CLIP 式图文对齐技术,也可用于视觉与动作对齐。

具身智能(Embodied AI)中的感知-决策-动作闭环

- 技术目标:智能体在真实或模拟环境中通过感知和语言理解完成任务,如“走到厨房找到红色杯子”。

- 关键模块:

- 感知模块:使用视觉模型(如 Faster R-CNN、SAM、ViT)理解环境。

- 语言理解模块:自然语言指令转为结构化任务或目标。

- 策略学习模块(Policy Learning):使用强化学习、模仿学习或行为克隆等方法学习动作策略。

- 动作执行模块:将决策转为低级控制指令。

语言驱动的动作规划(Language-conditioned Planning)

将自然语言转化为中间目标(sub-goals)或高层规划,例如:

- ObjectNav / PointNav:导航到目标对象或地点。

- Task Planning:将“做一杯咖啡”分解为一系列具体动作。

- 技术手段:

语言嵌入 + 图搜索(如任务图 Task Graph)

LLM + Planner:大语言模型(GPT、PaLM-E 等)生成动作序列

Diffusion Policy 或行为生成模型用于语言到动作的直接映射

学习范式

- 模仿学习(Imitation Learning):从演示数据中学习,如 Dataset:ALFRED、Ego4D。

- 强化学习(RL)/ 层次强化学习(HRL):用于自主探索与动作学习。

- 大模型微调与指令调优:采用预训练大语言模型 + VLM(如 Flamingo、PaLM-E)进行指令跟随。

代表性技术体系或模型

VLA的主要结构

VLA 通过融合视觉感知(图像、视频)、语言理解(自然语言指令)和动作规划(强化学习或控制策略)来实现端到端的智能决策。

视觉编码器(Vision Encoder)

语言编码器(Language Encoder)

跨模态融合(Multi-Modal Fusion)

动作生成(Action Decoder / Policy Module)

视觉编码器

- CNN(ResNet, ConvNeXt):用于低级别视觉特征提取。

- Vision Transformer(ViT, Swin Transformer, BEiT):用于全局视觉理解。

- CLIP Vision Encoder:结合大规模文本-图像数据训练,适用于开放世界感知。

语言编码器

- BERT / RoBERTa:适用于结构化文本理解。

- T5 / GPT 系列:用于文本生成任务。

- CLIP Text Encoder:跨模态对齐的语言编码器。

跨模态融合

动作生成

典型 VLA 结构示例

- 视觉感知:使用 CLIP 提取环境视觉特征。

- 语言理解:使用 PaLM(大语言模型)解析用户指令。

- 跨模态融合:基于 CLIP 计算任务和环境的匹配度。

- 动作决策:结合强化学习选择最佳机器人行动。

未来优化方向

- 更高效的视觉-语言对齐(如 Video-Text Pretraining)

强化多模态记忆(Memory-Augmented Models)

自监督学习提升 VLA 训练效率

结合 MoE(Mixture of Experts)提升泛化能力