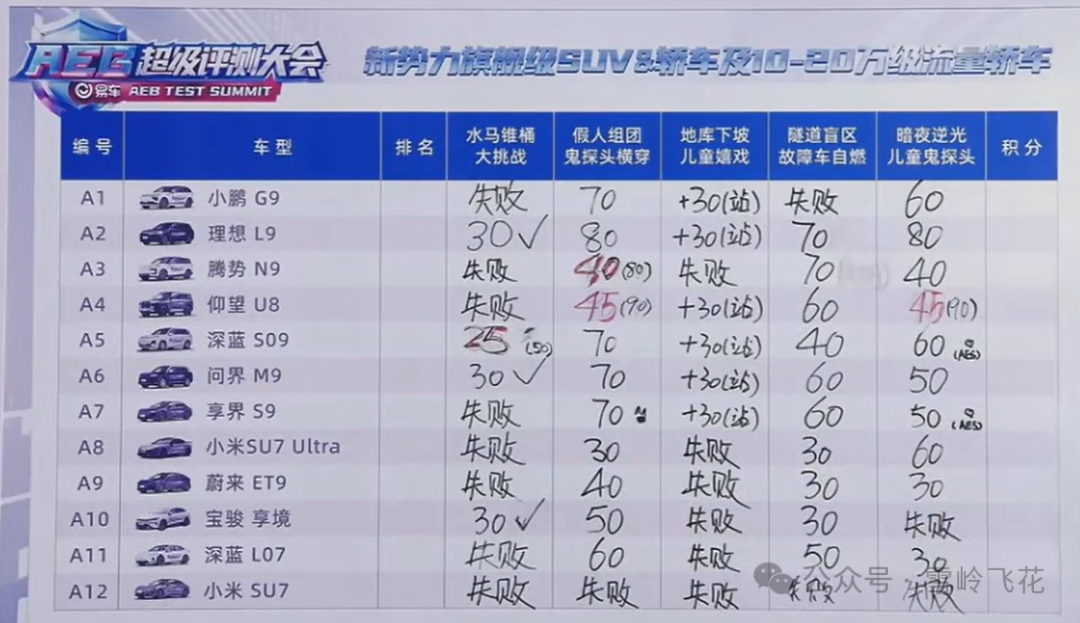

近日,太平洋汽车和易车网对于多个热门车型进行了AEB性能的横向评测,测试过程非常精彩。

如下是部分测试结果:

图片来源:太平洋汽车(https://www.bilibili.com/video/BV1MrdUYvEZ4/)

图片来源:易车(https://www.bilibili.com/video/BV1hMLRz8EHV/)

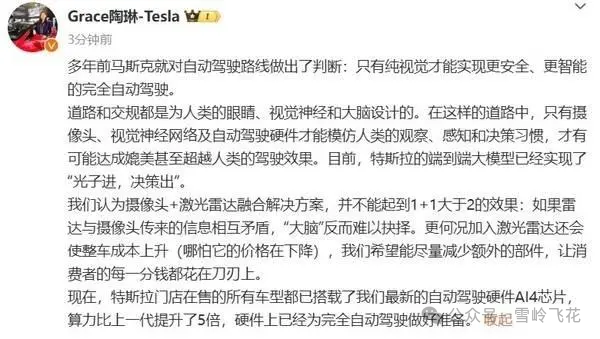

特斯拉是“纯视觉”方案的最早发起者,其出发点是“第一性原理”:既然人可以只通过眼睛开车,那么机器也可以。

1. “纯视觉”

从字面意思来说,“纯视觉”是指汽车智驾的传感器配置只采用视觉传感器(即摄像头)。

目前严格的“纯视觉”主要是特斯拉,全车采用了7个摄像头,没有任何的激光雷达、毫米波雷达和超声波雷达。大疆成行平台也有完全没有雷达的传感器配置方案。

而其他“纯视觉”的方案,并非严格的“纯视觉”,只是没有激光雷达,而依然使用了毫米波雷达和超声波雷达。例如:小鹏是11V3R12U、华为ADS基础版是10V3R12U、理想AD Pro是10V1R12U、乐道是11V1R12U、极越是11V5R12U等等。

图片来源:盖世汽车

本文所讨论的“纯视觉”主要是指严格的“纯视觉”,即仅使用摄像头,不使用任何激光雷达、毫米波雷达和超声波雷达。

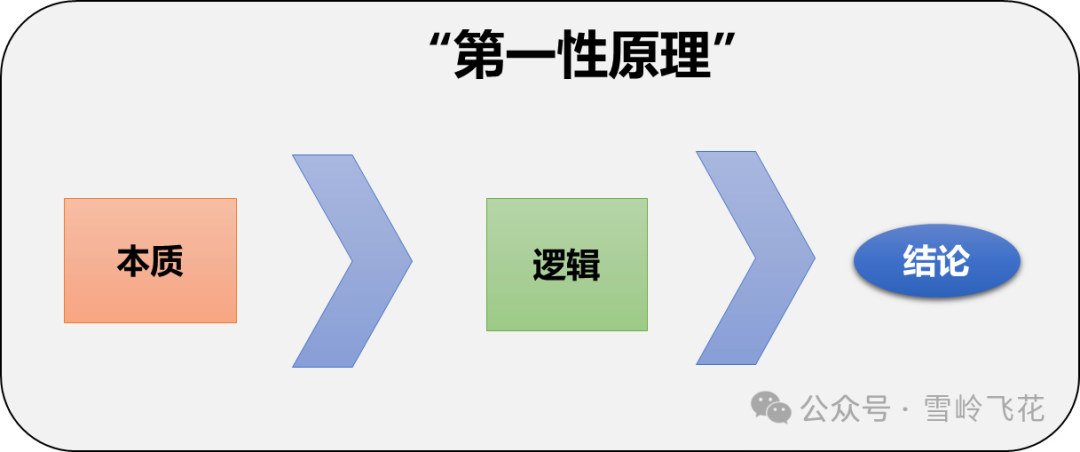

2. “第一性原理”

“第一性原理”不仅是科学研究的重要方法论基础,也成为许多创新者和思想家用以颠覆传统认知的工具。通常可以分解为以下三个步骤:

- 1-分解问题:将复杂的问题拆解为最基本的组成部分,找出其中不可再分的核心元素。

- 2-质疑假设:对现有的假设和框架提出质疑,剔除那些未经验证或可能错误的预设前提。

- 3-重新建构:基于第一性原理,构建新的解决方案或理论框架。

埃隆·马斯克将“第一性原理”的思想,应用在特斯拉汽车、脑机接口和SpaceX等产品的开发中,马斯克表示:

“借助第一性原理,我将事物的本质提炼出来,从最基础的层面进行推导……”

“采用第一性原理来思考问题,而非依赖比较思维,至关重要。我们常常习惯于比较,别人做过或正在做的事情,我们也跟着做,如此一来,只能实现微小的逐步改进。第一性原理的思维方式是从物理学视角审视世界,即一层层剥离事物的外在表象,洞察其内在本质,再从本质出发逐步构建。”

“类比思维”在日常生活中非常常见,因为它简便快速,并且在很多时候都可以得到正确的决策。然而,“类比思维”往往依赖于既有视角,而忽略了事物的本质。

所以相比之下,“第一性原理”要求摒弃已有的框架和假设,从最基本的真理或者最初的需求出发,重新构建认知体系。这种方法虽然耗时费力,但却能够帮助我们剔除经验主义的干扰,更深刻地揭示问题的本质,从而突破传统的限制,找到创新的解决方案。

3. 自动驾驶的“第一性原理”

所以,特斯拉的观点是,既然人只是通过视觉来开车,那么自动驾驶也应该只使用视觉来开车。

甚至有网友表示,如果“人开车只用眼睛”是第一性原理的话,由于人只有一双眼睛,那么汽车上超过两颗摄像头以外的部分,是不是也应该被拿掉?甚至,应该开发一个两只眼睛的机器人来开车,而不是开发域控制器和在车身上安装摄像头?

在2025年4月的禾赛发布会上,李一帆表示,如果用这种“第一性原理”造车,车应该是用腿走路的:

使用“第一性原理”的飞机(扑翼机):

这种飞机“耽误”人类“起飞”165年:

那么,自动驾驶的“第一性原理”到底是什么呢?

目前智能驾驶系统的感知和控制系统很难与人类眼睛和大脑相比。

同时,即便智能驾驶系统达到了人类的相同水平,人驾也不是出行“第一性原理”的最优解。

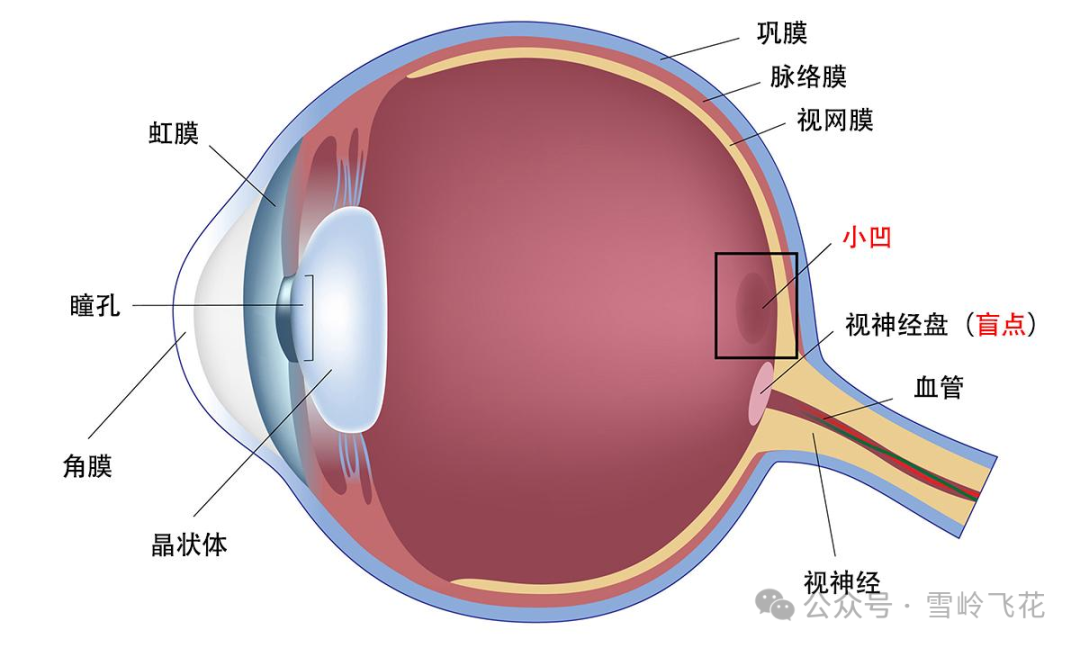

1. 人类眼睛的感知能力远高于摄像头

图片来源:https://zhuanlan.zhihu.com/p/20263068

加上配合头部的旋转,因此可以实现360°的视角。

目前,没有任何摄像头可以达到人类眼睛的感性性能。

2. 人类开车也不是出行的最优解

即便有一天科技的进步,机器的能力真的达到了人类的水平,这样就够了吗?

据了解,全球每年约发生400万起交通事故,导致约130万人死亡,受伤人数超过2000万。

视频来源:太平洋汽车

因此,许多驾驶辅助系统开始逐渐应用,用于降低驾驶员的操作负荷,提升行车安全性,降低事故率。例如各种基于雷达和摄像头的AEB系统、BSD系统和车道保持系统。

所以,即便是人类自己开车都无法保证足够的安全性,还需要其他系统辅助人类开车。

那还还远未达到人类能力的“纯视觉”系统,为什么就有信心是从“第一性原理”出发的最优解了呢?

1. “纯视觉”方案安全性缺陷

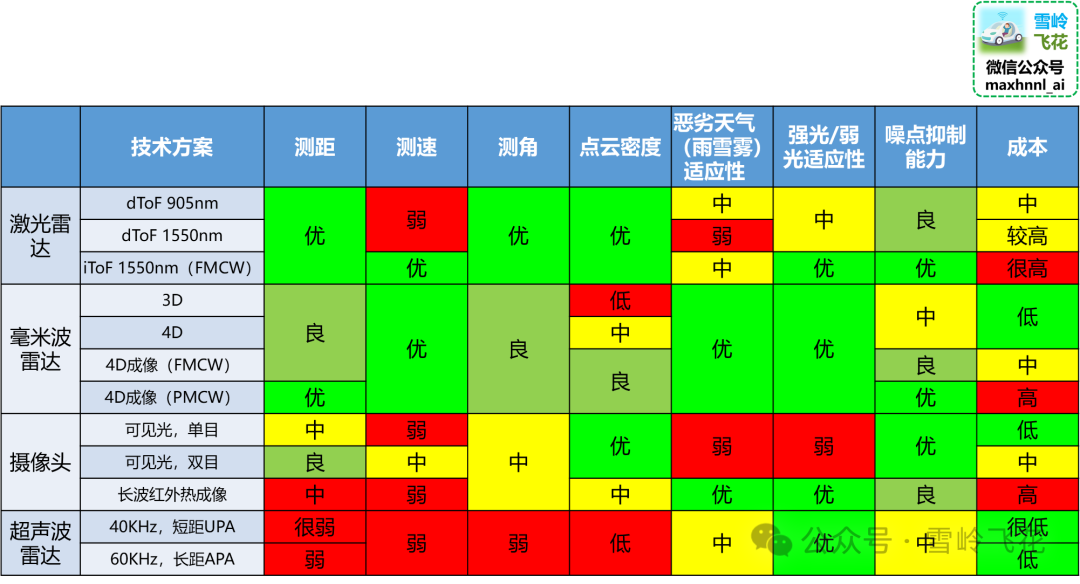

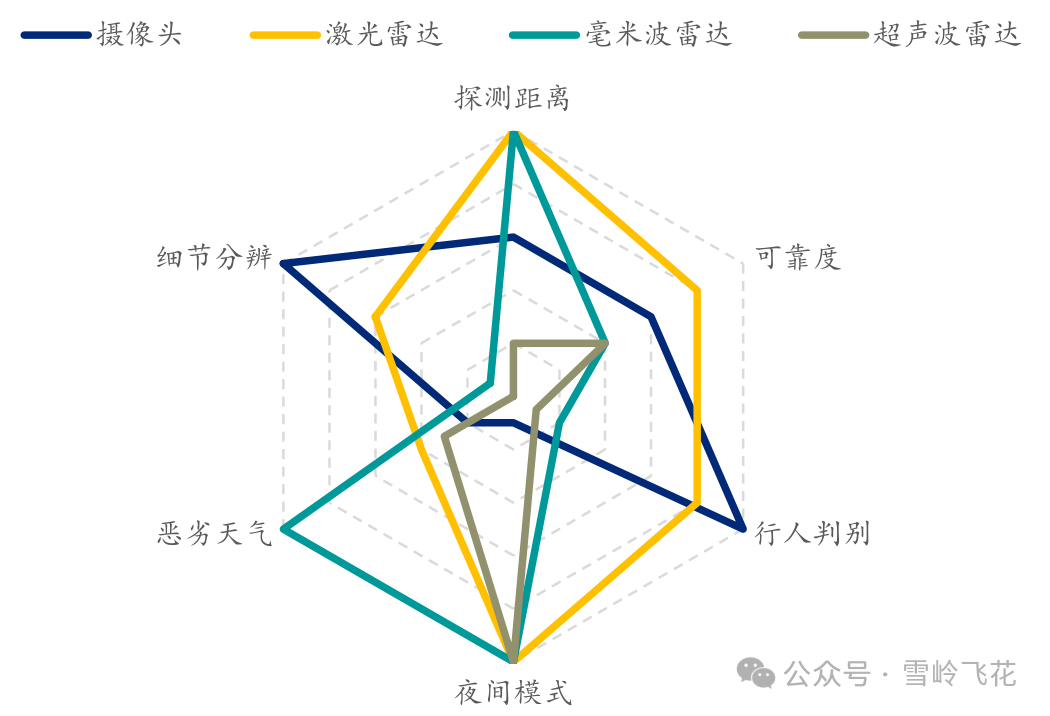

1)探测原理

摄像头、激光雷达和毫米波雷达的工作原理不同,它们各有优劣势,对比如下:

其中,摄像头可以提供的信息最多,不过激光雷达和毫米波雷达可以提供更为准确的距离和速度信息,并且光线和天气的适应性更强。

图片来源:中国信通院、浦银国际

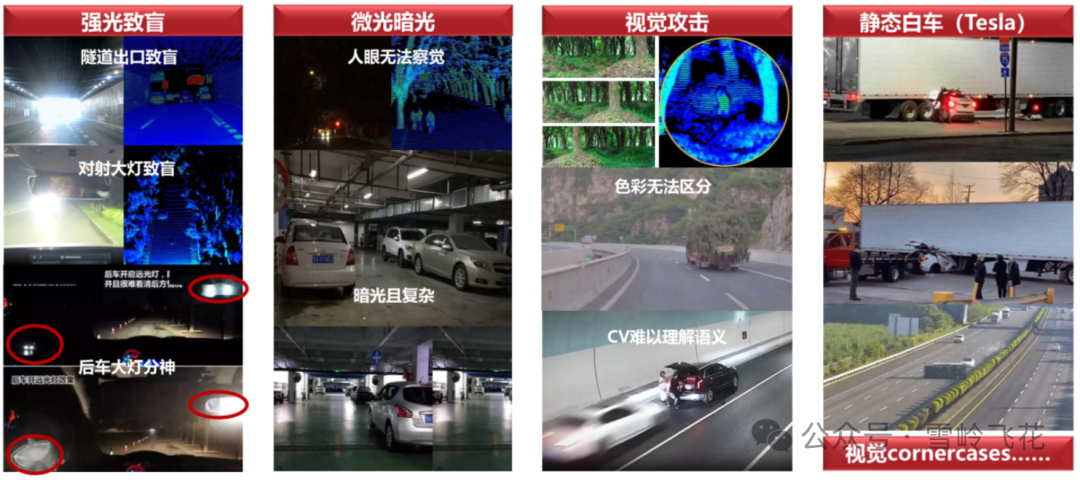

2)视觉容易失效的场景

视觉采用被动测量方案,因此外部环境对于感知性能的影响巨大。

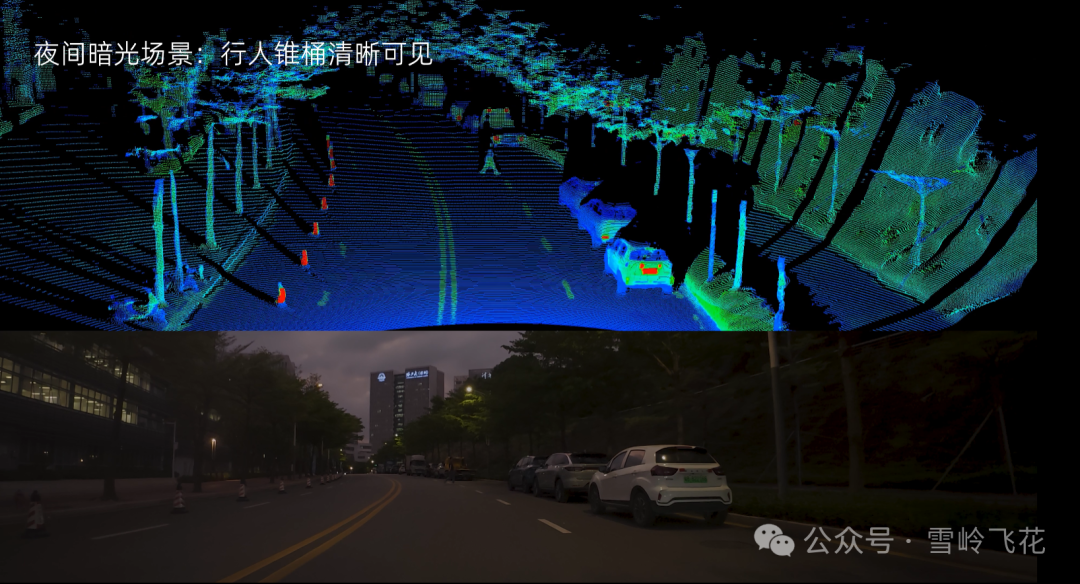

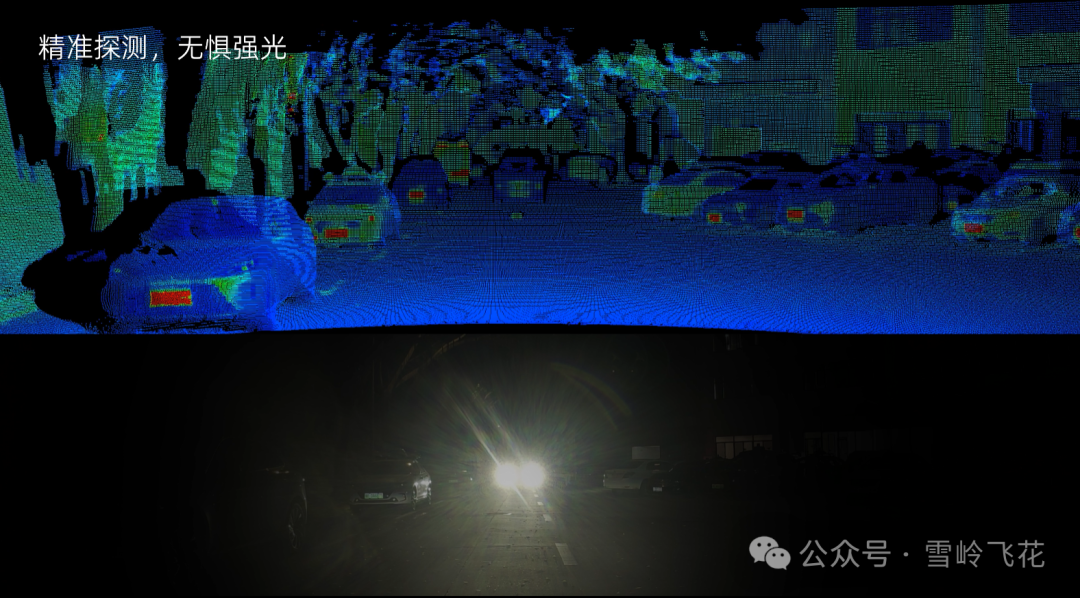

摄像头在在诸多场景会发生致盲失效或者性能大幅衰减,例如:隧道口、大灯眩光、暗光、背景重合等等。

图片来源:灵明光子

其中,对安全性影响最大的是:

在低光照环境下,如夜晚或室内停车场,相机图像的信噪比大幅降低,导致物体检测误差和有效监测距离均大幅恶化。强光直射时,相机过曝会严重影响相关区域的目标识别,甚至完全致盲。

对于不规则物体(翻倒车辆、树木等)、无纹理物体(例如白色卡车、玻璃幕墙等低对比度目标),视觉容易出现漏判或误判。

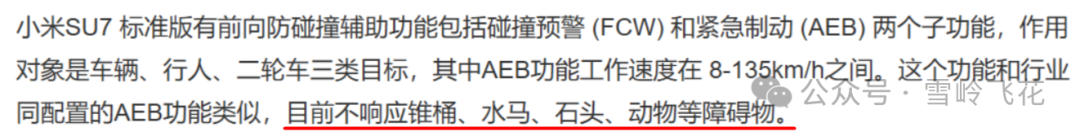

3)小米SU7的事故

图片来源:小米汽车《关于大家关心问题的回答》

图片来源:小米汽车《小米SU7答网友问(第五集)》

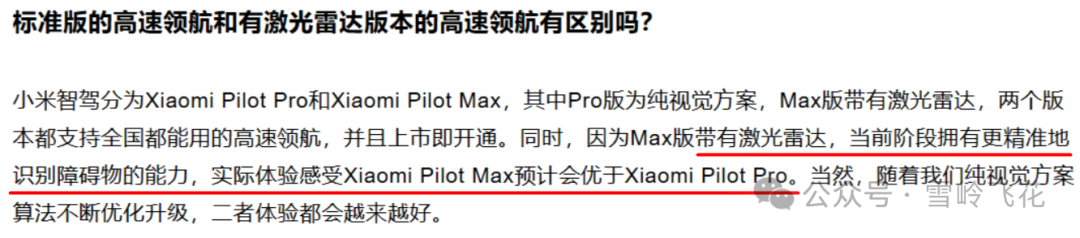

4)针对特斯拉FSD的调查

2024年10月,特斯拉的全自动驾驶(FSD)功能在美国遭遇了重大调查。此次调查由美国国家公路交通安全管理局(NHTSA)缺陷调查办公室发起,原因是在能见度降低的区域,启动了FSD功能的特斯拉车辆发生了多起碰撞事故,并造成了人员伤亡。

图片来源:激光雷达老炮儿微信公众号

2018年3月,一位苹果工程师开着特斯拉Model X在高速公路与护栏相撞后死亡,事故发生时,驾驶员在开着Autopilot智驾玩手机游戏。

2. 激光雷达可以提升安全性

1)激光雷达采用红外线主动测距,因此受外部光照影响较小,测距精度波动通常在1%以内。

由于测距和测角精度高,激光雷达对于特殊物体的识别能力强。

图片来源:速腾聚创

图片来源:速腾聚创

2)华为多次表示激光雷达可以提升安全性:

图片来源:激光雷达老炮儿微信公众号

华为智能驾驶成功在高速雨夜避撞事故车辆:

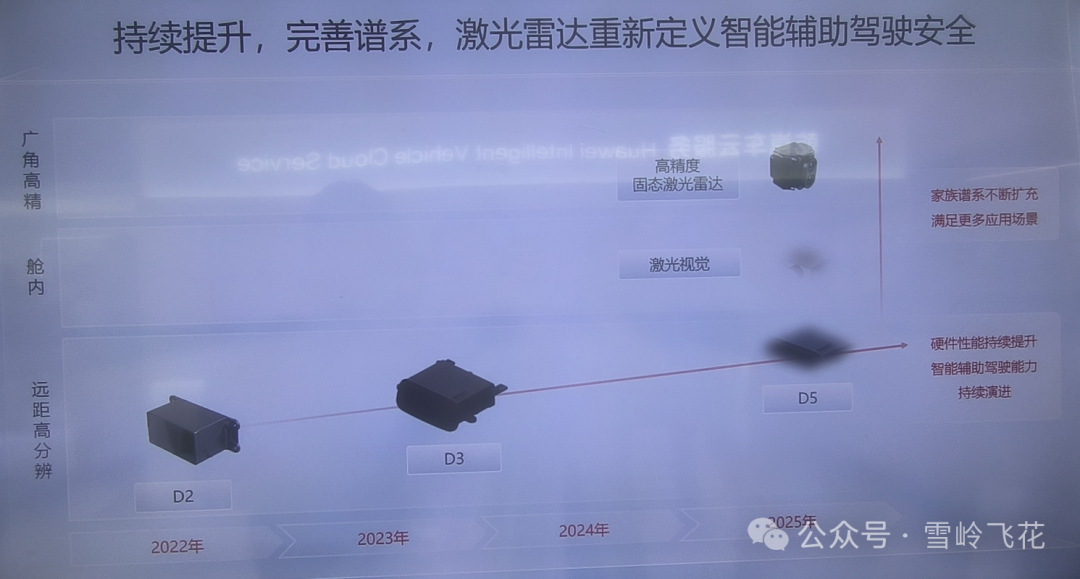

华为的激光雷达roadmap如下,今年还会推出高精度固态激光雷达,激光和视觉的融合产品,以及下一代高性能前向激光雷达D5。

3)2025年2月,理想汽车副总裁刘杰在其微博称,理想的基础版智驾系统AD Pro将重新增加激光雷达,后面理想的所有车型都将标配激光雷达。

理想汽车对于产品和技术的把控,往往有独到的洞察力,对于激光雷达的应用也是一样:

图片来源:网络

除了安全性之外,采用“纯视觉”路线的厂家之所以不使用雷达(尤其是激光雷达),经常提到这3个原因:

1)激光雷达昂贵,整车需要降本。

3)直接采用纯视觉方案在数据采集、算法训练上的效率更高。

其实,这几个原因其实随着传感器硬件的发展和算法的提升,影响已经越来越小。

1. 雷达成本逐年降低

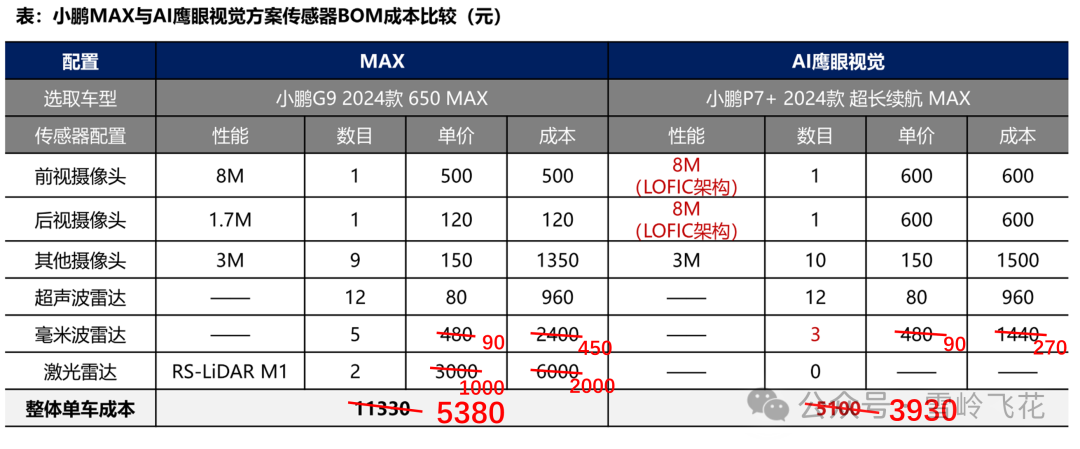

如下是有机构核算的小鹏的AI鹰眼视觉方案成本对比,其中结果显示,该方案在传感器维度实现了超过50%的降本空间。

图片来源:东吴证券

另外,除了BOM成本之外,不使用雷达的隐形成本其实更高。

为了解决一些暗光、眩光等Corner Case,纯视觉方案往往需要投入更多资源进行算法的精细优化,以及更多的数据和算力消耗。并且其中有相当部分case,即便是算法再优化也无法解决(例如在感知源头就没有任何检测)。

而对于这些Corner Case,如果采用了雷达,可能很容易就能进行优化。

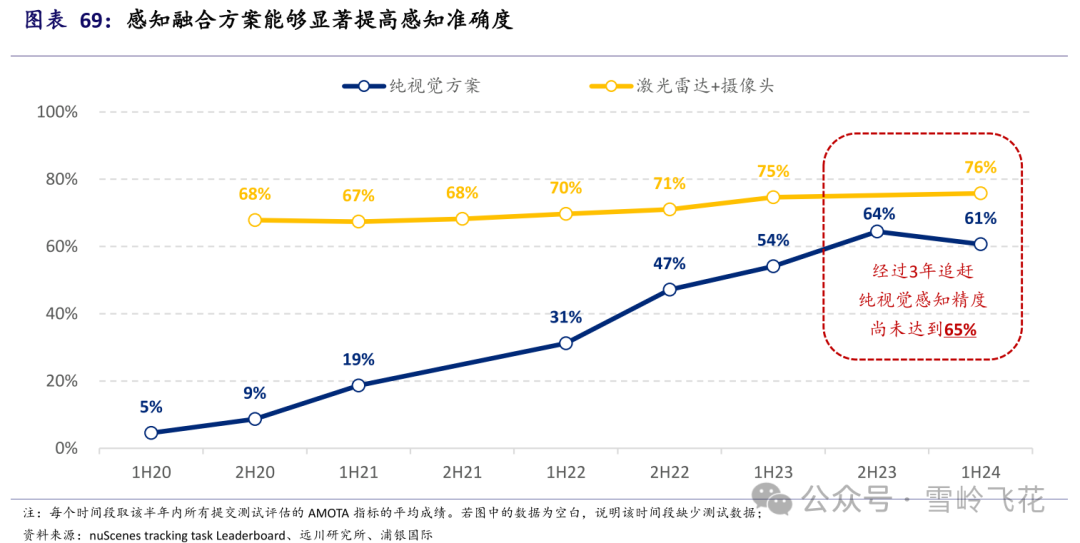

2. “纯视觉”感知性能难以追上融合方案

相机通过算法进行距离的估计,距离越远,估计误差越大,典型误差达5%-10%。例如Mobileye就曾经提到:90米误差大约10%,44米误差约为5%。由于距离误差大,导致速度估计误差更大。

激光雷达通过ToF原理直接测距,测距误差可以到3~5cm,并且远距离时测距误差也不会明显变差。激光雷达对于速度的估计也更为准确,毫米波雷达和FMCW激光雷达可以直接测速。

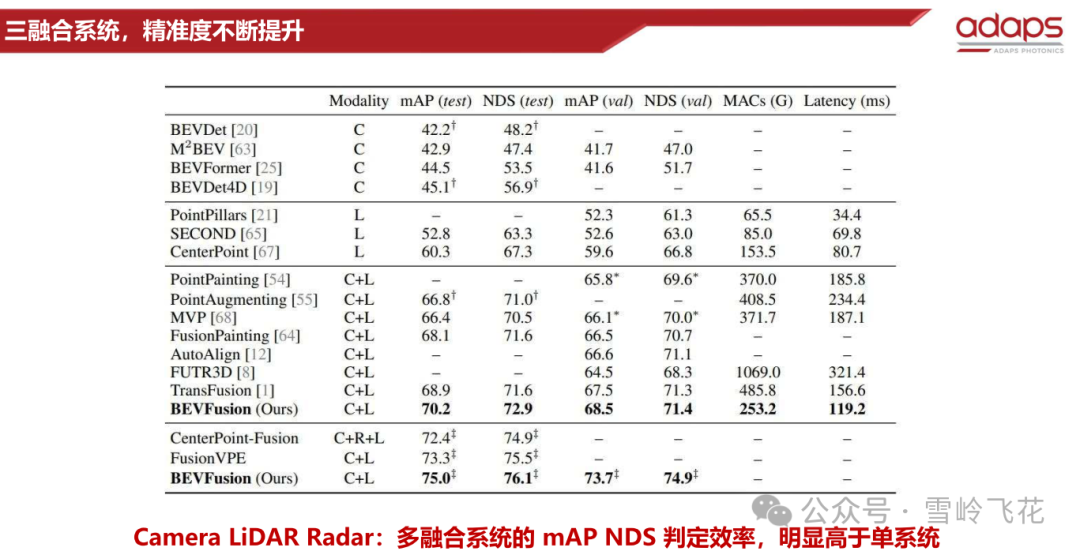

由于雷达可以直接测量距离和速度,因此融合方案的感知精度肯定比“纯视觉”要更好。

图片来源:灵明光子

3. 雷达同样接入大模型

摄像头和激光雷达的融合方案,目前在数据的采集和训练上并没有太大障碍。

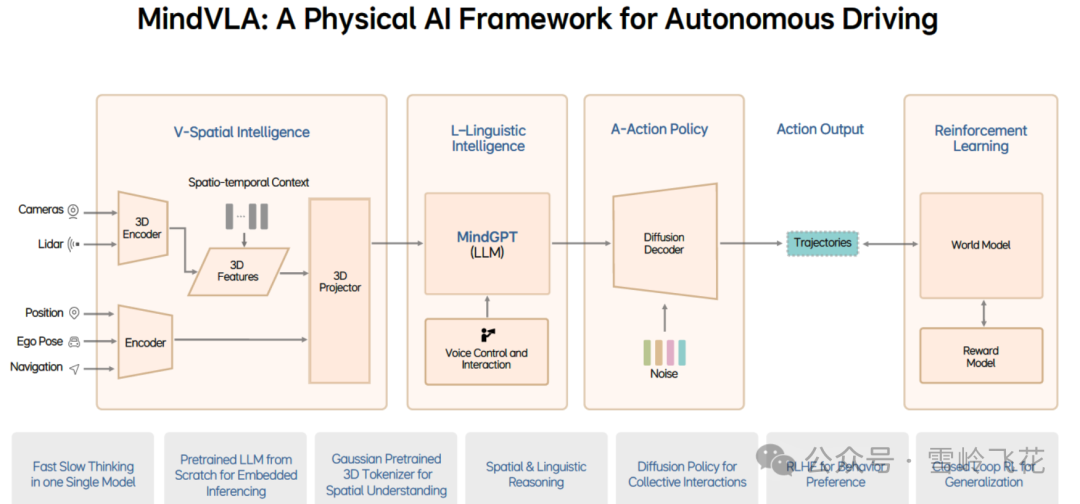

有许多厂家已经推出了同时接入摄像头和激光雷达数据的大模型,例如,理想刚不久发布的MindVLA:

图片来源:理想(为了更好的可视化,图片颜色相对于原图了做了调整)

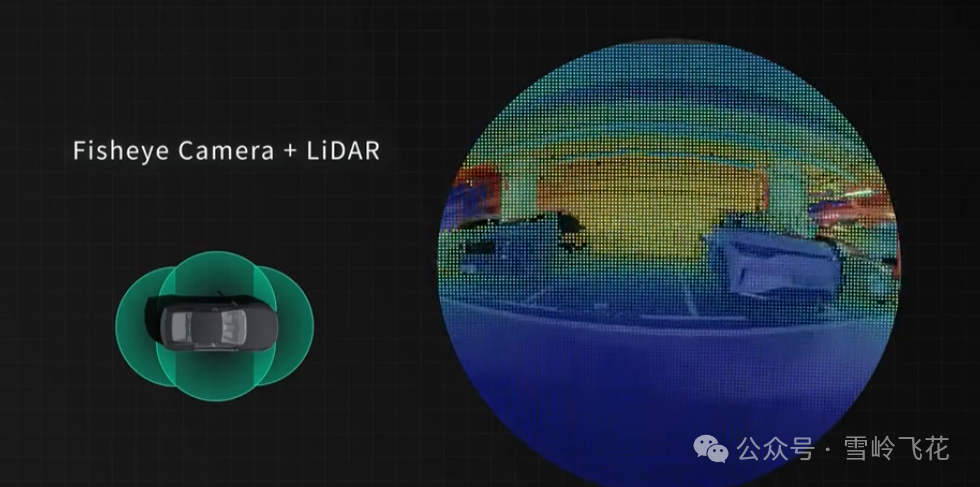

另外,激光雷达和摄像头做像素级别的融合,也是最近比较热的开发方向。

例如京瓷的摄像头和激光雷达融合产品:

图片来源:京瓷

在2025上海车展上,卓驭展出了第二代激目系统JIMU 2.0

图片来源:卓驭

图片来源:卓驭

卓驭近期还发布了纯固态激光雷达——知周:

知周激光雷达和鱼眼相机的像素级融合示意图:

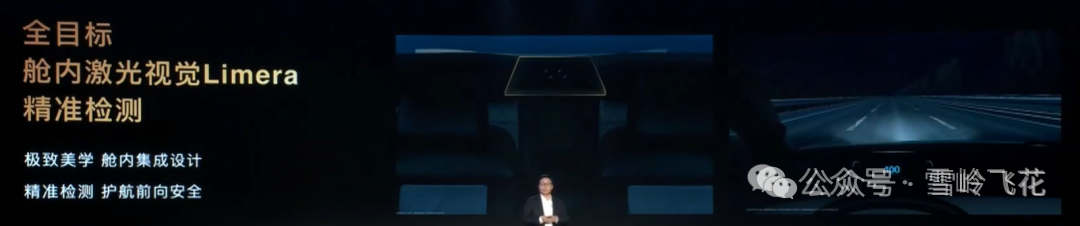

2025年4月22日,华为发布的Limera(Lidar+Camera)产品:

你在走一段山路,突然前面遇到一段万丈悬崖,而过了悬崖就可以到达另外一边。此时,旁边有两个人,都说自己可以帮忙带你过去。

其中一个说,自己的水平很高,只需要一根铁丝就可以,我在钢丝上骑自行车就可以把你带过去(方案1)。

另一个说,自己比较笨,没有那么高的水平,需要先架一座桥,然后我带你走桥过去(方案2)。

安全不是炫技,没有10倍安全的智能驾驶,不是智能驾驶。

转载自公众号:雪岭飞花

作者:雪岭飞花

原文链接:https://mp.weixin.qq.com/s/YDyJdJm1bcQXtSIM3JvLxA