1. 一分钟速览

- 问题:R1-style LRM(如 DeepSeek-R1、Kimi 1.5)在复杂任务上表现惊艳,却普遍存在 overthinking——推理链过长、冗余、重复,导致延迟 & 成本飙升。

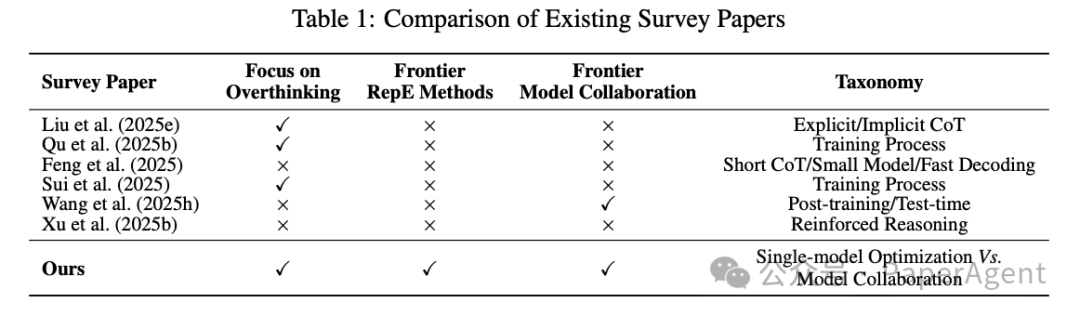

- 贡献:首篇系统综述高效推理的 survey,提出 「单模型优化 vs 多模型协作」 双层分类框架,覆盖 100+ 最新方法,并给出 4 大前沿应用展望。

2. 背景:当“想太多”成为瓶颈

现象 | 案例 | 后果 |

|---|---|---|

对简单问题仍生成超长 CoT | “2+3=?”→ 20+ 步推理 | 延迟↑、成本↑、准确率↓ |

不自信循环 | 反复自我验证、否定 | 输出方差↑ |

安全隐患 | 长推理链暴露更多攻击面 | 越狱、提示注入↑ |

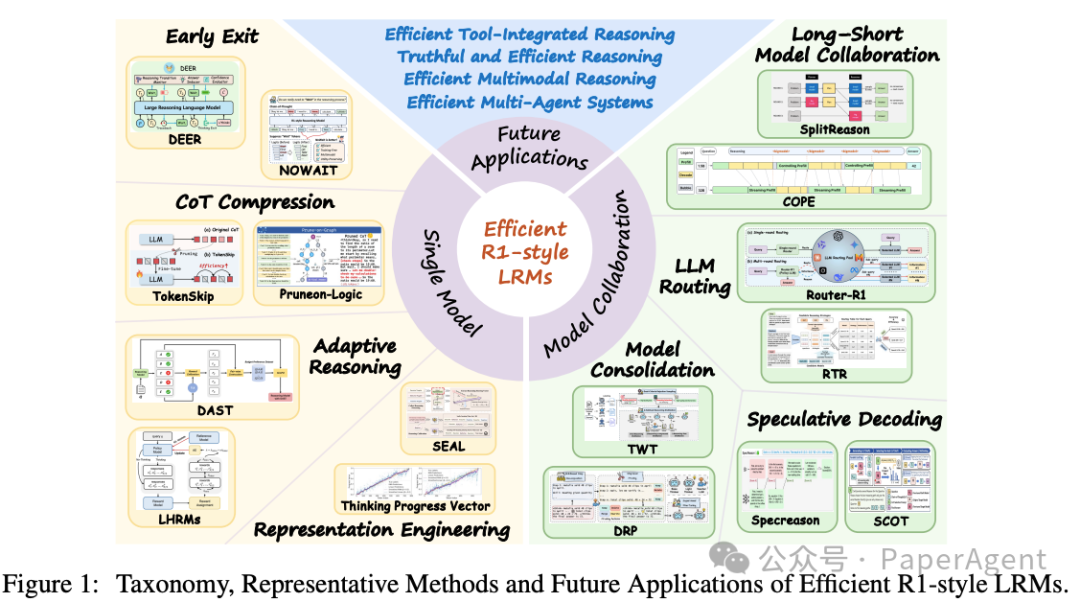

图 1:高效 R1-style LRM 方法分类与未来应用蓝图。

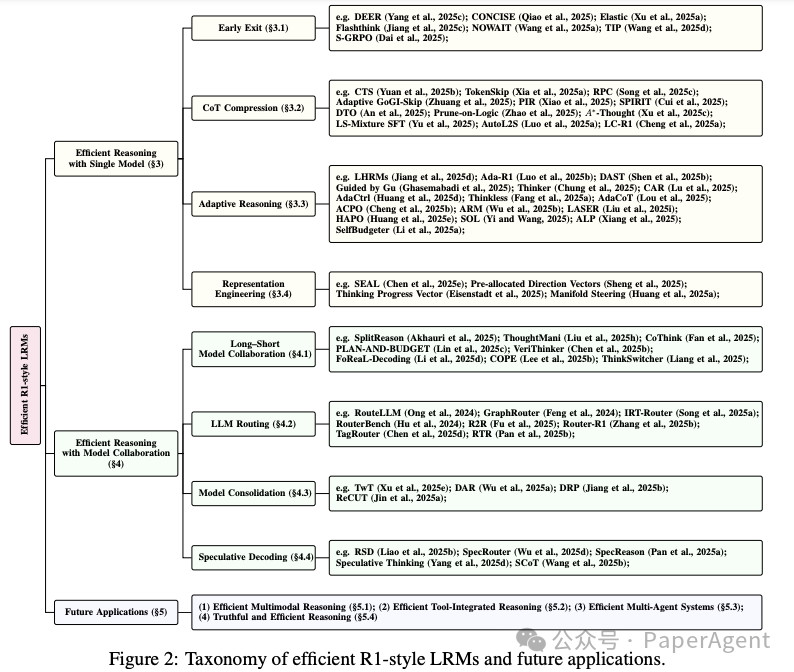

3. 方法全景:两条主线

范式 | 目标 | 代表策略 | 关键思路 |

|---|---|---|---|

单模型优化 | 在 一个 模型内部“减支增效” | Early Exit / CoT 压缩 / 自适应推理 / RepE | 提前停、剪枝、动态深度、潜空间操控 |

多模型协作 | 多个 模型“分工协作” | Long–Short 协作 / LLM Routing / 模型融合 / 投机解码 | 轻量模型打草稿,大模型把关 |

3.1 单模型优化:让模型“自省”

技术 | 子类 | 关键论文 | 一句话亮点 |

|---|---|---|---|

Early Exit | 监控/生成控制/自适应 | DEER | 发现“aha”token 立即刹车 |

CoT 压缩 | Token/Step/Chain 级 | CTS | 用参考模型给 token 打重要性分数 |

自适应推理 | RL 奖励 / 模式切换 / 长度惩罚 | Ada-R1 | 难度高→长链,简单题→直接答 |

RepE | 潜向量操控 | SEAL | 注入“少想”向量,抑制冗余反射 |

3.2 多模型协作:打组合拳

协作模式 | 代表方法 | 工作流程 | 速记 |

|---|---|---|---|

Short-to-Long | SplitReason | 轻模型先答,难题丢给大模型 | “小模型主刀,大模型支援” |

模型路由 | RTR | 为每个输入动态挑选最合适的模型(或模型组合) | 路由 |

模型合并 | TwT | 把长、短模型的优势“蒸馏”或“融合”成一个新模型,兼顾性能与效率。 | 蒸馏、融合 |

投机解码 | SpecReason | 小模型一次写多步,大模型并行验证 | “草稿+批改” |

4. 未来 4 大应用方向

方向 | 痛点 | 高效化思路 | 推荐阅读 |

|---|---|---|---|

多模态推理 | 视觉-语言链更长 | 阶段式 Caption → Reason → Answer | Visionary-R1 |

工具集成推理 | 过度调用 API | RL 奖励惩罚冗余调用,先过滤文档再推理 | Search-R1 |

多智能体系统 | 群体 overthinking | Router 按任务复杂度动态分配模型 | MASrouter |

可信高效推理 | 压缩后幻觉↑ | 同时优化“可信-简洁”双目标 | SafeMLRM |

5. 实验洞察 & 落地建议

- Early Exit 可在 零训练 场景下把 token 消耗 ↓30-50%,准确率几乎不掉。

- 模型融合(如 ReCUT)平均缩短回复长度 55%,适合已有多模型的团队。

- 投机解码 对 GPU 并行友好,延迟↓2-3×,适合在线服务。

📌 实践 Tips:

“让模型学会‘想得快且准’,而不是‘想得久且乱’。”