概述

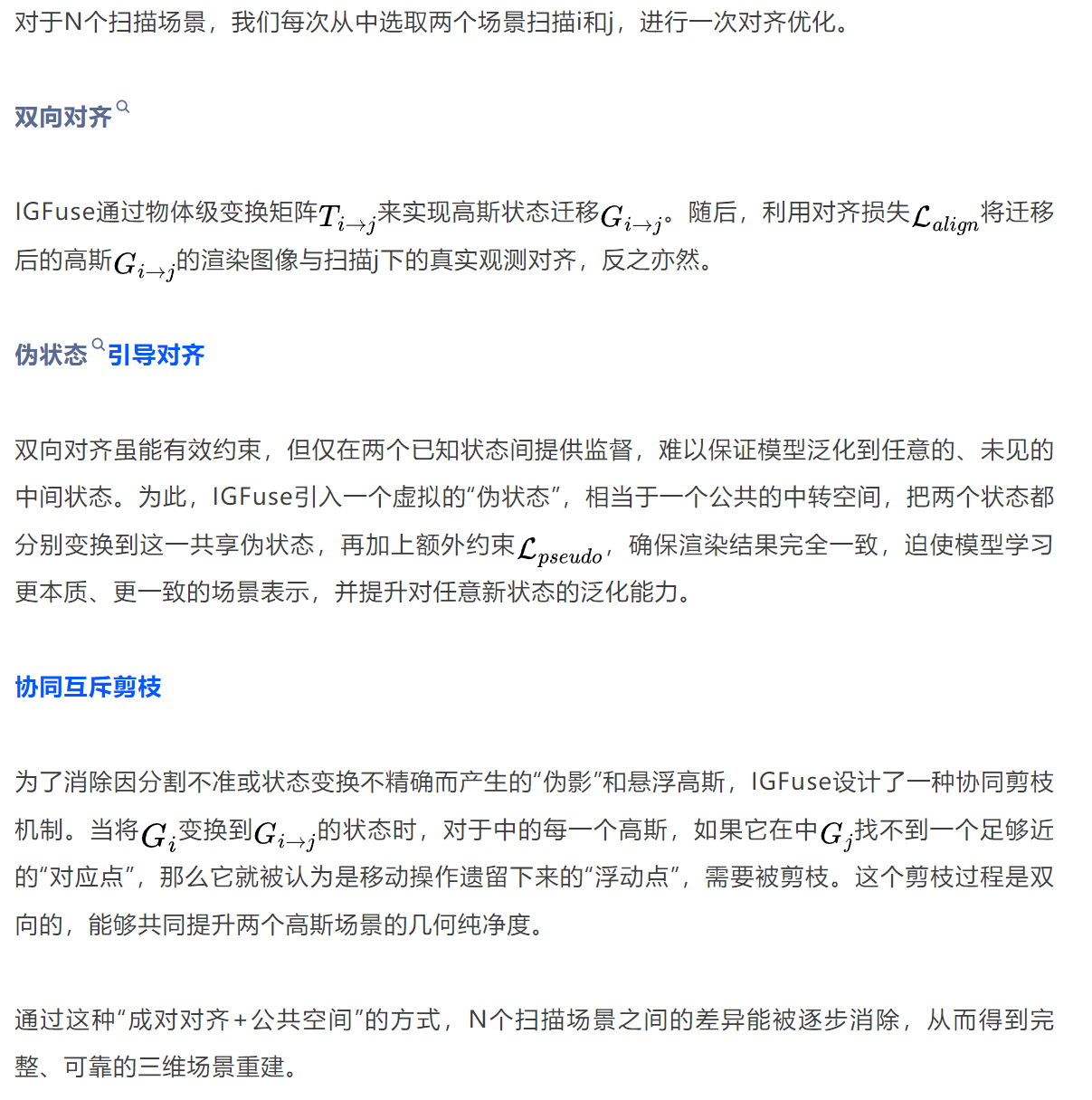

可交互三维场景重建是推动计算机视觉与机器人智能发展的关键。然而,真实世界的频繁遮挡使单次扫描无法完整捕捉场景信息,也因此限制了后续的全面交互。传统方法往往依赖复杂流程或逐物体扫描,难以兼顾效率与完整性。为此,我们提出IGFuse,一个基于多次观测融合的可交互三维高斯场景重建框架。它能够利用多次扫描不同物体布局下的场景揭示被遮挡区域,并通过分割感知的高斯场和一致性约束实现高保真重建。用户无需繁琐步骤,即可获得完整、可交互的三维场景。目前,IGFuse网站已上线,代码也将于近期开源,欢迎大家关注与体验。

• 项目主页:

https://whhu7.github.io/IGFuse/

• 文章链接:

https://arxiv.org/pdf/2508.13153

https://github.com/whhu7/IGFuse-code

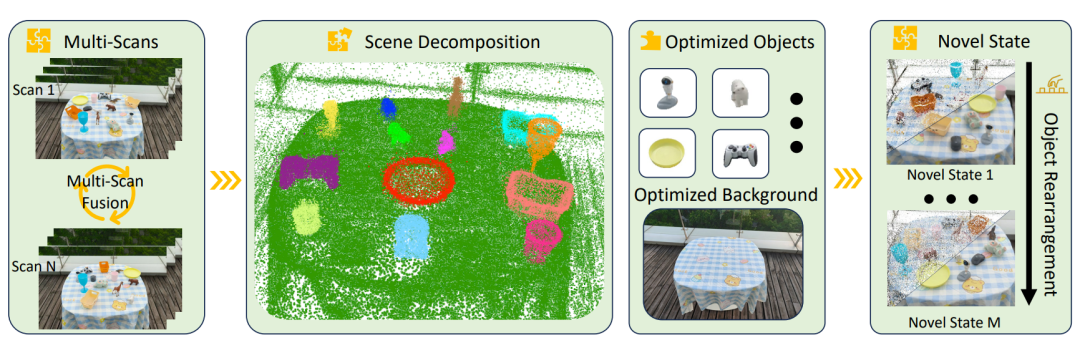

输入(左):同一个场景的多次扫描 (Multi-Scans) ,每次扫描中的物体布局都不同。

融合与分解(中):IGFuse通过一个多状态联合优化过程,将所有扫描的信息融合成一个统一的、一致的场景表示,并将其分解为独立的可动物体 (Optimized Objects) 和完整背景 (Optimized Background) 。

交互式生成(右):最终,用户可以随意地重新排列 (Object Rearrangement) 这些物体,生成全新的、高保真的场景状态。

背景方法

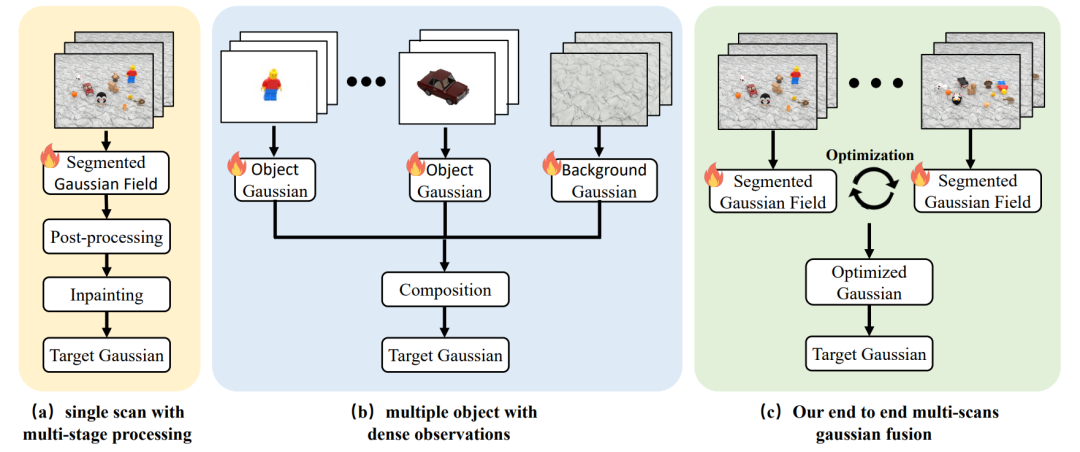

在构建可交互的三维高斯场景时,不同范式有着明显差异:

(a) 传统单次扫描方法:依赖繁琐的多阶段后处理与修复操作,但往往会引入累积误差与伪影;

(b) 基于物体的重建方法:需要对场景中每个物体进行密集多视角扫描,再进行显式组合,过程复杂且成本高;

(c) 我们提出的IGFuse:则通过端到端的多次观测融合,在跨状态监督下联合优化多状态高斯场,不仅能有效补偿不同扫描视角下的遮挡,还能实现高质量的可交互三维高斯重建。

总体框架

通过这种“成对对齐+公共空间”的方式,N个扫描场景之间的差异能被逐步消除,从而得到完整、可靠的三维场景重建。

新状态合成结果

在新状态合成任务中,我们的方法取得了最优表现。相比之下,基于分割的算法如Gaussian Grouping容易在物体边界处产生明显的瑕疵,而DecoupledGaussian采用分割加修补的思路,但在复杂场景中修补区域与真实背景之间依然会出现不协调感。

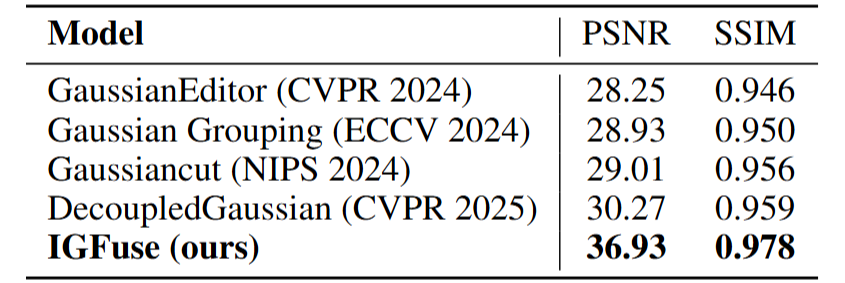

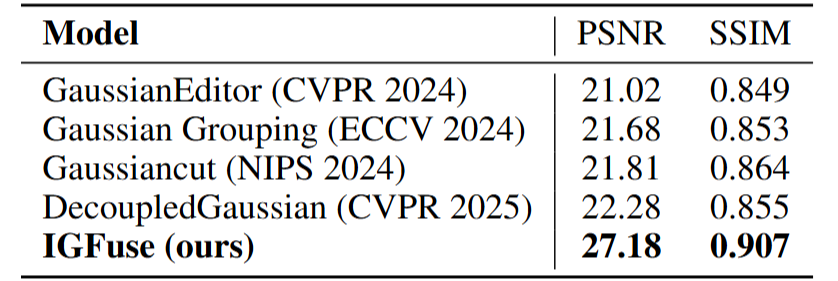

在定量实验上,我们在训练场景扫描之外拍摄了物体随机排布的一个测试场景扫描,用作衡量高斯场在新状态合成的真实性。在虚拟数据(上)和真实数据(下)的新状态任务上,我们跟Ground Truth相比的PSNR和SSIM都显著高于对比算法。

前背景信息融合

我们的方法融合了不同场景扫描下的前景信息,从而在小车翻滚的不同状态下实现更加逼真的模拟效果。

仅考虑背景时,我们的方法能够融合多次扫描的信息,从而重建出完整的背景。

分割与深度结果

与基线方法Gaussian Grouping在新状态下的表现相比,我们的方法能够生成更加干净的分割结果。Gaussian Grouping在二维分割中往往会在物体边界处产生空洞或多余区域;在深度层面,其基于特征的分割无法覆盖所有三维点,导致物体移动后遗留大量残余点,并在物体移出的位置留下深度空洞。

总结与展望

IGFuse通过融合多次场景扫描信息,有效提升了新状态合成的质量,打通了从场景重建到多状态真实模拟的完整流程。双向对齐设计与伪状态监督相结合,有效解决了遮挡处理和边界分割中的难题,进一步保证了新状态合成的准确性与完整性。未来,该方法将作为一种融合式重建的范式持续演进,重点拓展到更加复杂和多样的场景中,特别是面向长序列观测下的高质量融合重建。这不仅为真实环境中的持续感知与状态合成提供了坚实基础,也为具身智能体在长期交互和复杂任务中的应用开辟了新的可能。

文章转载自公众号:地平线HorizonRobotics

原文链接:https://mp.weixin.qq.com/s/VbnZEz6TeEeldQWW0EP_mQ