2025年6月4日,全国标准信息公共服务平台公示关于征求《智能网联汽车 组合驾驶辅助系统安全要求》拟立项强制性国家标准(以下简称标准)项目意见的通知。

该标准对组合驾驶辅助系统的安全性,做了详细的要求。其中包括大量常见的驾驶辅助系统弱势场景(或者称为极端工况、边缘工况、Corner Case等),例如:特殊目标的识别,包括侧翻的车辆、锥桶、水马、隔离桶、纸箱等,以及特殊的道路,包括隧道、弯道等,和突然切出、“鬼探头”等极端工况。

并且,很多测试项都要求同时在白天(光照强度不低于2000 lx)和夜晚(光照强度不高于1 lx)、雾天、雨天都进行测试。

- “快”:检测速度快,在一些极端工况,例如弯道、突然切出、“鬼探头”等,可以迅速识别危险目标。

- “准”:检测目标准确,检测的距离、速度、角度信息精度高。

- “稳”:对于各种目标能够稳定检出,例如侧翻的车辆、锥桶、水马、隔离桶、纸箱等。能够适应不同的光照、天气情况,检测稳定,不漏检、不误检。

01

隧道内故障车

1. 场景要求

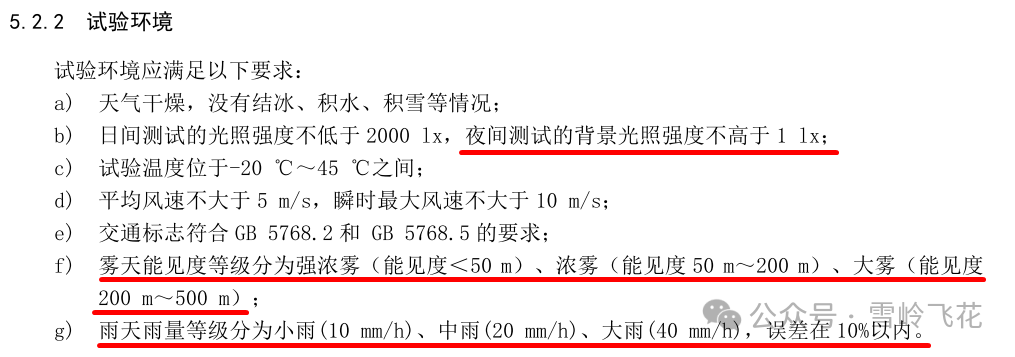

标准中设置了多个隧道内故障车的场景,具体如下:

2. 场景分析

这个场景对于摄像头(可见光)的挑战主要是:

1)隧道内外光照强度差异较大,对于摄像头的动态范围要求较高;

2)隧道内车辆不是正常角度,尤其是侧翻的车辆,这类目标训练集往往较少,漏检的概率较大。

动态范围不足的摄像头在隧道进出时,会短暂“致盲”,即常说的“黑洞”和“白洞”效应:

在“致盲”时间内,如果道路中有车辆或者障碍物,非常容易发生事故,例如:

3. 应对方案(摄像头)

“黑洞”和“白洞”效应的主要原因是摄像头的动态范围不足。

隧道场景下,动态范围不同的摄像头检测效果对比如下:

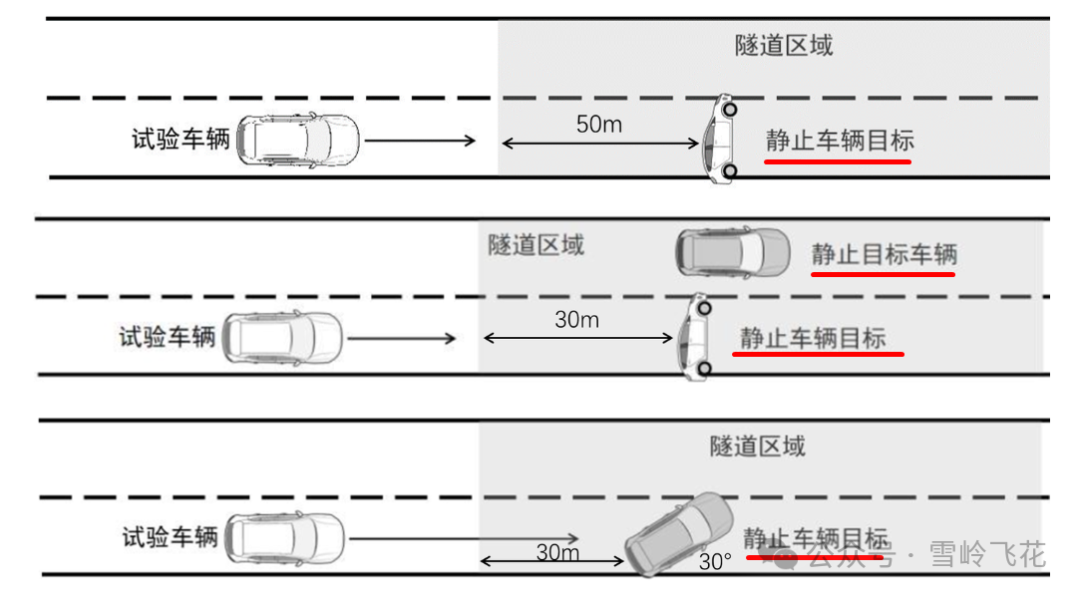

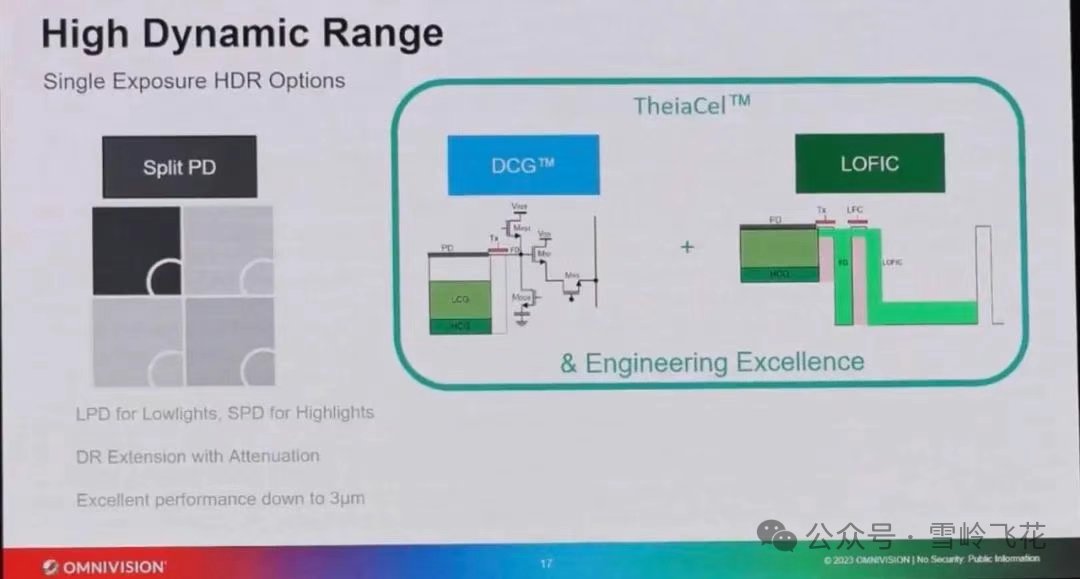

目前业界在采用各种方案,提升摄像头的动态范围,例如多曝光合成技术(多帧合成)、大小像素/双增益分层技术、LOFIC(横向溢出积分电容)技术、以及AI ISP技术等等。

TheiaCel™技术主要采用OmniVision的DCG™高动态范围(HDR)技术和横向溢出集成电容器(LOFIC)技术:

TheiaCel的原理示意如下:

这种方法就像用一个水桶来接雨水,如果雨水溢出了水桶,使用一个更大的盆来装多余的水。“桶”内的信号可以非常精准地读取,因此能够实现出色的低光表现。而溢出的盆中则容纳了所有超出的部分,从而扩展了动态范围,并具备捕捉明亮物体和场景真实色彩的能力。整个像素区域可应用于低光条件,而在亮光条件下不会饱和。

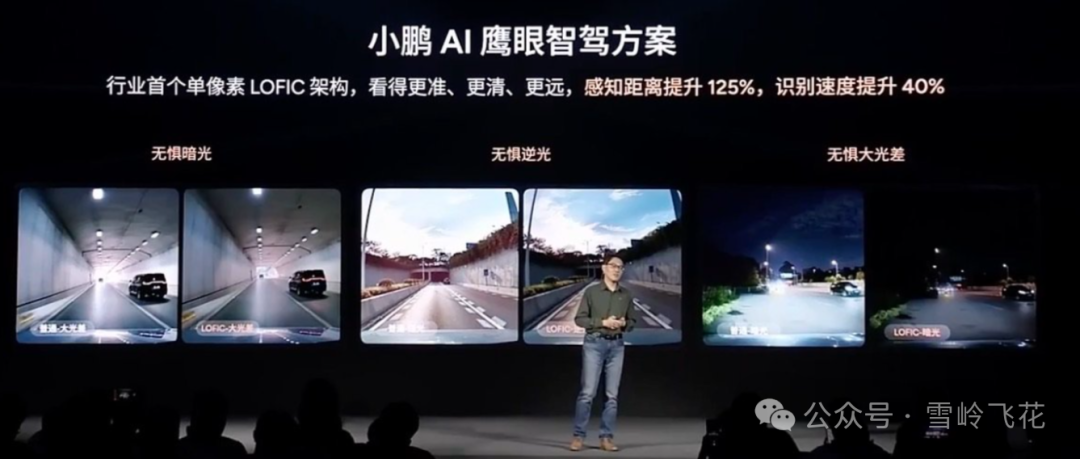

小鹏使用豪威OX08D10开发了“AI鹰眼视觉系统”:

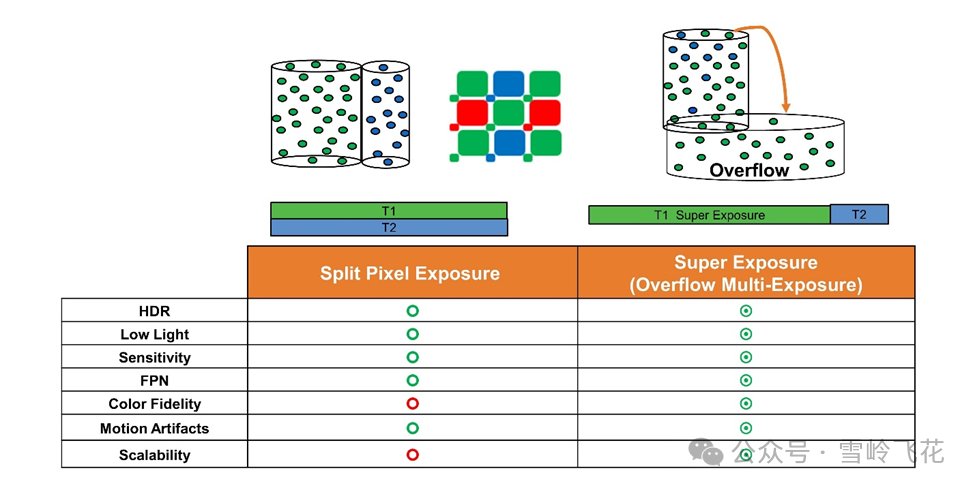

安森美早期使用大小像素技术来实现HDR,不过,由于大小像素技术会导致图像质量下降、暗噪声增加以及性能降低,尤其是在较高温度下表现更为明显。安森美目前主要采用超级曝光技术(Super Exposure),也被称为溢出多重曝光技术,该技术和LOFIC原理类似。

两种技术性能对比如下:

图片来源:安森美

AR0823AT的感知效果对比:

图片来源:安森美(下图是AR0823AT,上图是其他产品)

4. 应对方案(激光雷达)

摄像头是一种被动感知器件,感知效果会直接受到环境光的影响。

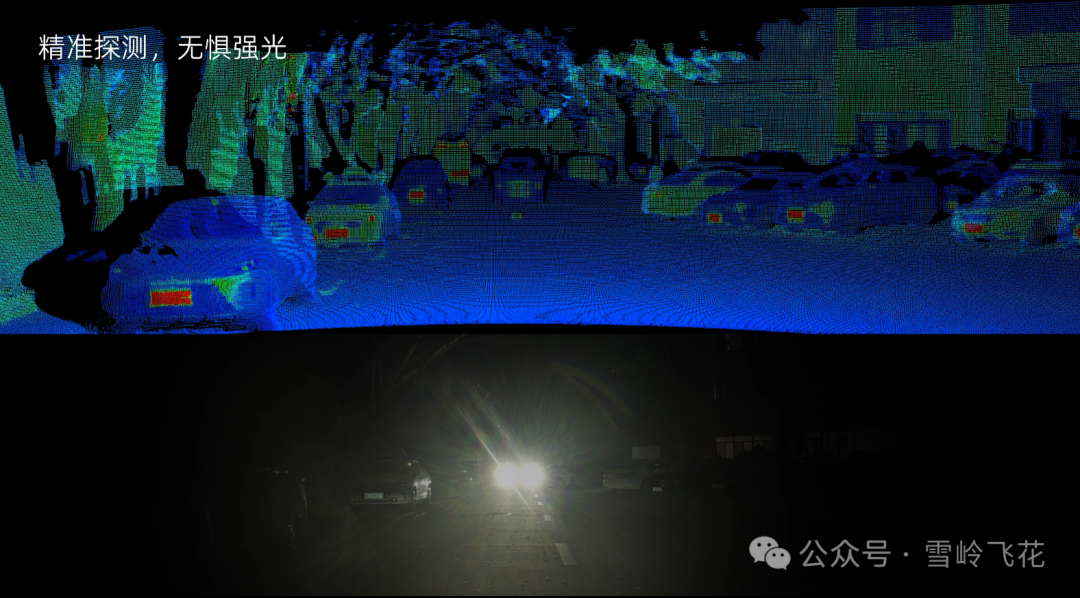

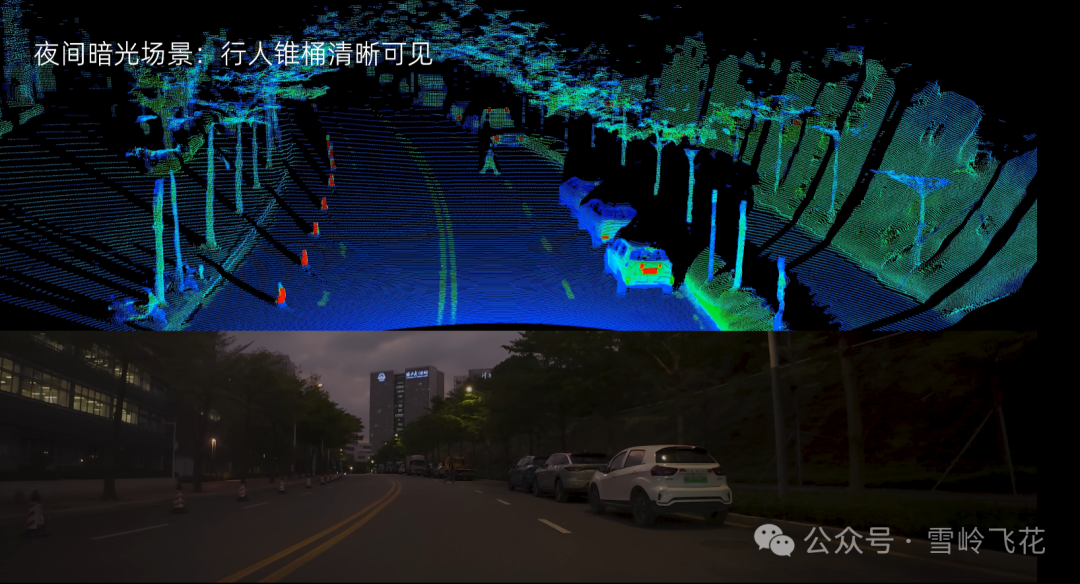

相对来说,激光雷达是一种主动感知器件,通过主动发射红外激光束进行探测,因此环境光照强度的变化,对激光雷达影响较小(强日光直射,也会对激光雷达有一定影响)。

例如,AT128激光雷达在隧道出口的检测效果:

图片来源:禾赛科技

在黑夜强光照射,也不影响周围目标的检测:

图片来源:速腾聚创

5. 应对方案(毫米波雷达)

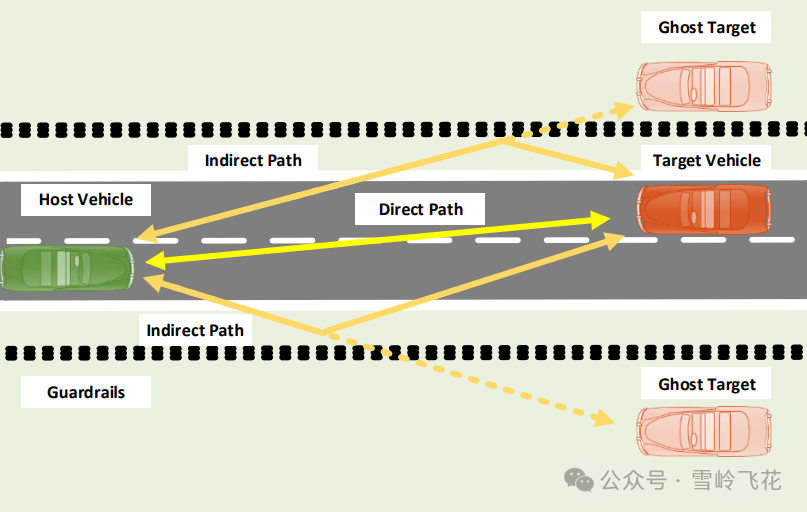

毫米波雷达同样是主动感知单元,和激光雷达不同的是,毫米波雷达是通过发射毫米级别波长的电磁波进行探测,环境光线的变化对于毫米波雷达没有影响。

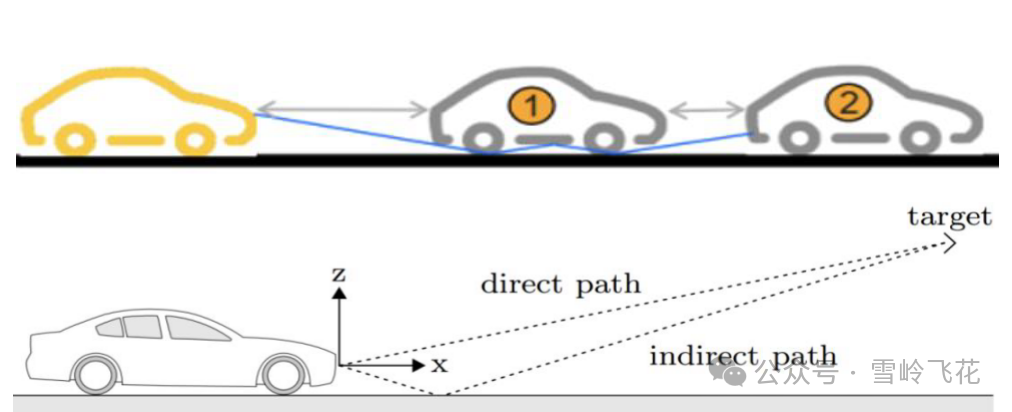

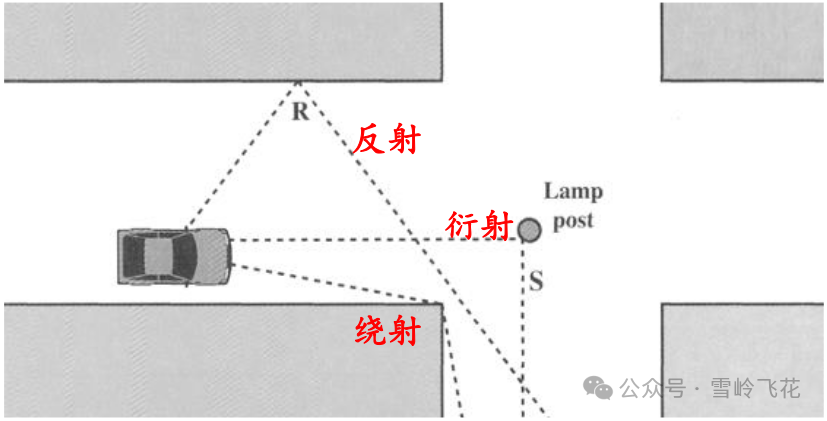

不过,由于隧道是密闭空间,因此电磁波在隧道内的多径效应更为严重,多径导致的大量虚假目标,会影响真实目标的判断。

多径效应的示意图:

02

施工路障

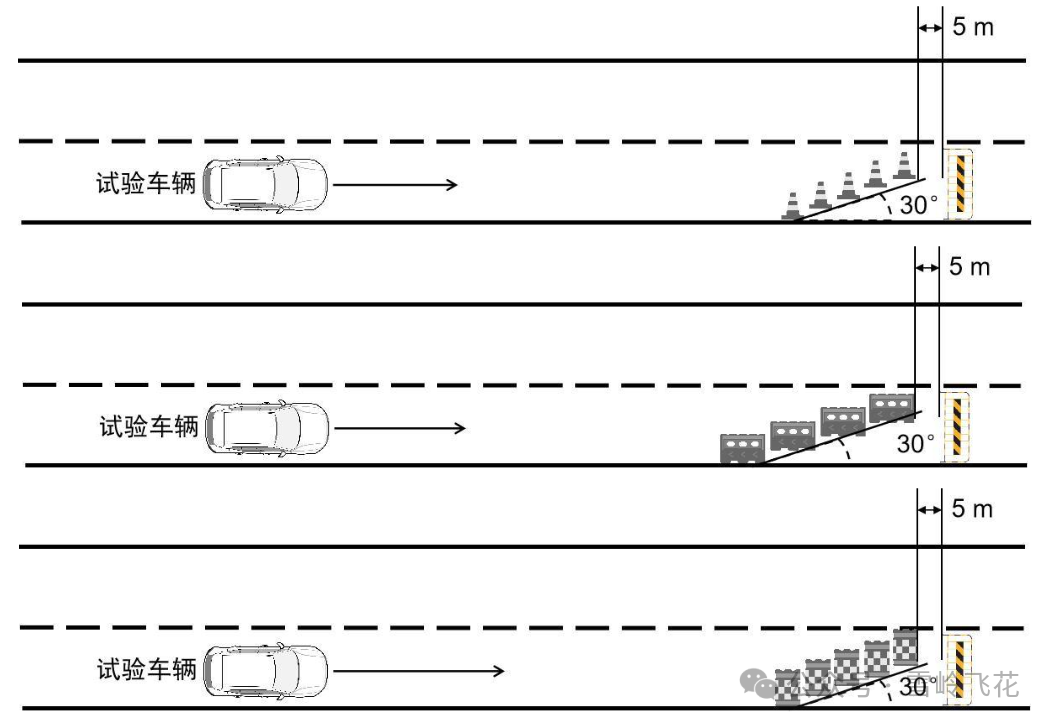

1. 场景要求

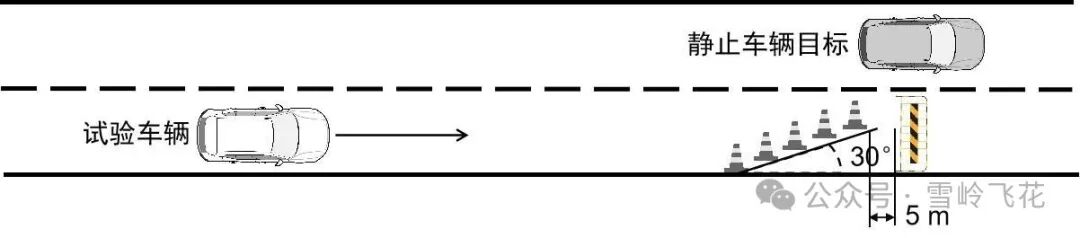

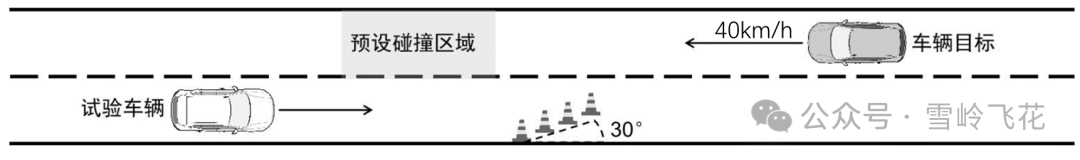

施工路障是驾驶辅助系统常见的弱势目标,标准中设置了多个测试场景,如下包括按照一定角度拜访的锥桶、水马和隔离桶。

为了进一步增加难度,标准中还设置下面两种场景,在临近车道放置了静止车辆和来向运动车辆。对于这样的场景,驾驶辅助系统只能刹停,不能转向避撞。如果是在晚上,由于有对向车辆,没有拉起远光灯的话,感知识别的挑战会更大。

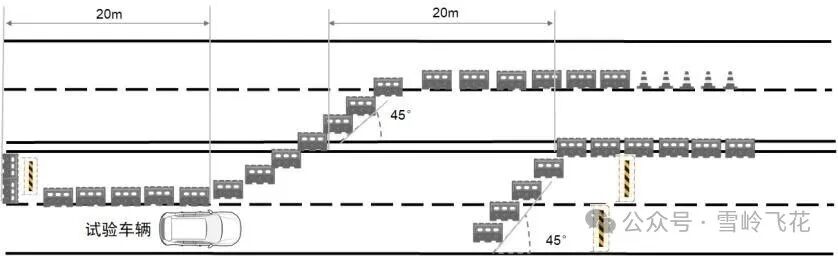

另外,标准中还增加了改道的施工场景:

这个场景和2025年3月29日小米SU7的事故场景非常类似:

2. 场景分析

施工场景往往比较复杂,障碍物形态各异,由于训练集的缺乏,对于视觉的识别有较大的挑战。

此类事故经常发生。2025年5月19日,李某驾驶一辆新能源小汽车开启驾驶辅助功能,来到一处弯道路段时,车辆并未正常入弯,而是直冲左侧的防撞水马:

2024年10月4日,一辆特斯拉在开启Autopilot辅助驾驶功能时,撞入了施工区域:

图片来源:观察者网

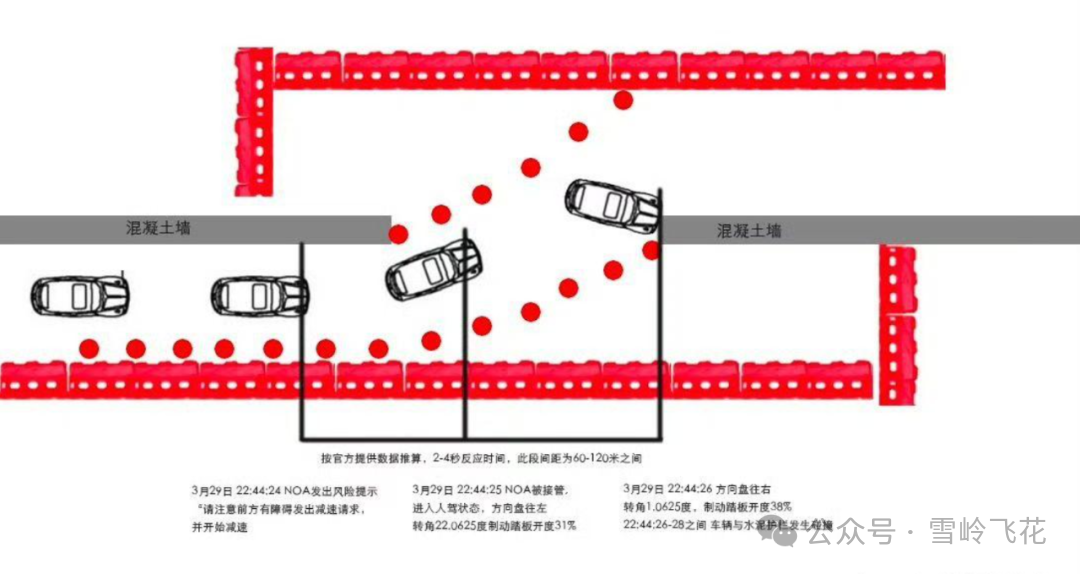

2025年3月29日,一辆小米SU7在安徽德上高速公路池祁段发生交通事故,造成车上3名女大学生不幸死亡,事故发生前车辆处于NOA智能辅助驾驶状态。

3. 应对方案(摄像头)

对于摄像头来说,需要在训练感知模型是增加足够的相关样本,确保识别的准确性。

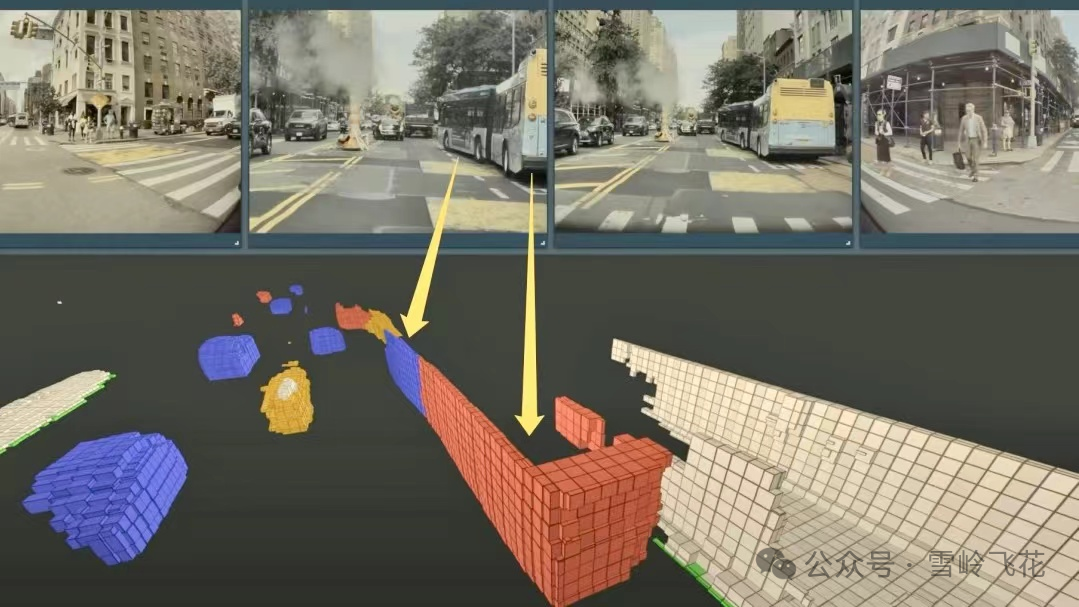

2022年,特斯拉提出了Occupancy Network(占用网络),将占用网格技术推向了自动驾驶等领域的前沿应用。该技术可以直接判断道路是否被占用,而不被白名单物体所限制。

4. 应对方案(激光雷达)

对于激光雷达来说,由于测距范围和测角精度比较高,对于这些物体的识别能力较强。

图片来源:速腾聚创

5. 应对方案(毫米波雷达)

对于毫米波雷达来说,有些障碍物(例如水马)对于电磁波的反射率有可能较低,有可能发生漏检。

03

小目标

1. 场景要求

车道上放置了褐色纸箱,长宽高分别是50cm*50cm*50cm。

2. 场景分析

标准中的这个场景主要考察驾驶辅助系统对小目标的检测能力。

在快速路上,尤其是高速上,撞击或者碾压小物体,同样可能非常危险。例如车辆碾压一个啤酒罐之后,车辆失控:

3. 应对方案(摄像头)

摄像头对于小目标的检测有相当大的挑战,一方面还是训练数据集的问题,训练集中可能根本没有这类目标。另一方面,由于小目标体积较小,摄像头分辨率不足,反映到图像上可能只有几个像素,很难识别。

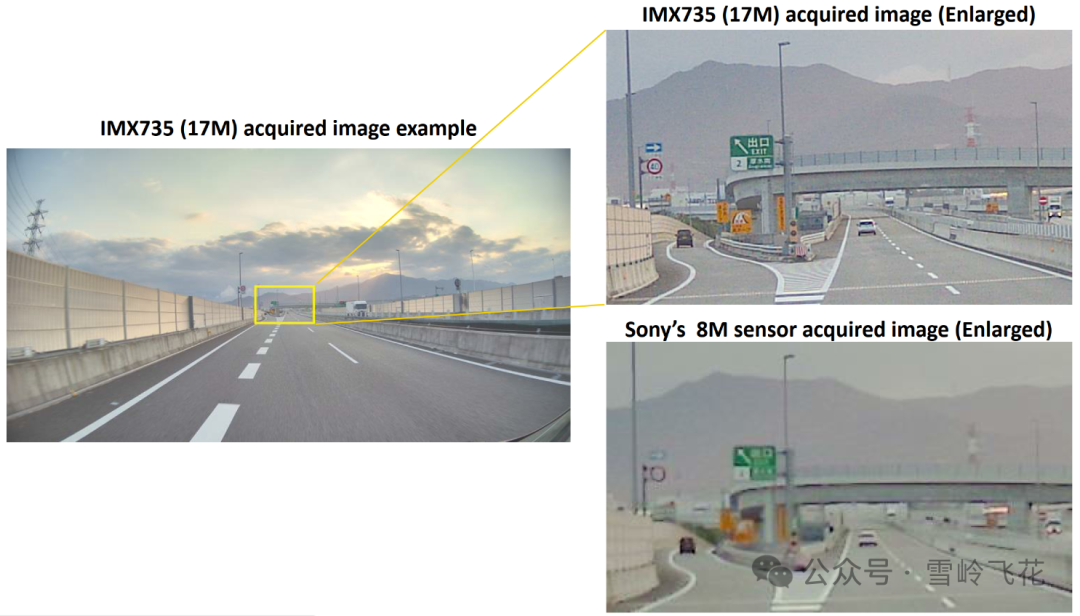

提高摄像头的分辨率,能够进行一些改善,提升对远距离小目标的识别能力。

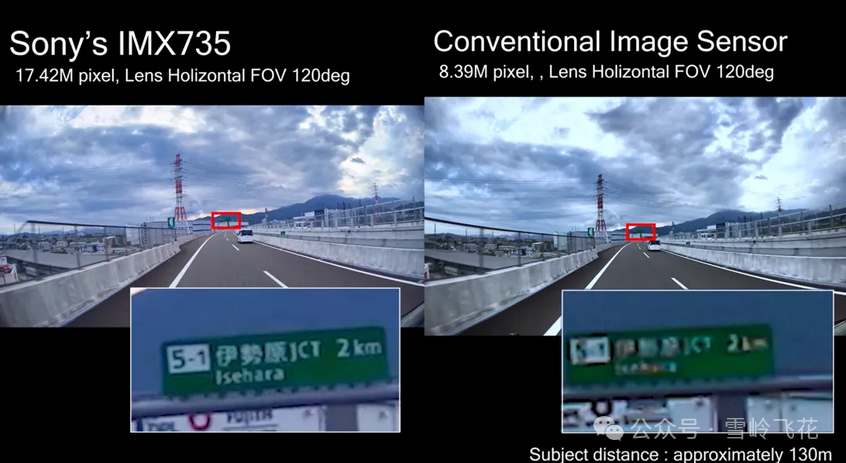

1)2023年9月,Sony发布1742万像素的CMOS图像传感器IMX735。对于远距离目标的识别更清晰:

图片来源:索尼

清晰度对比:

图片来源:索尼

2)2024年10月30日,豪威发布了采用TheiaCel技术的OX12A10,这是一颗1200万像素CMOS传感器。豪威科技表示,OX12A10将于2025年第三季度投入量产。

4. 应对方案(激光雷达)

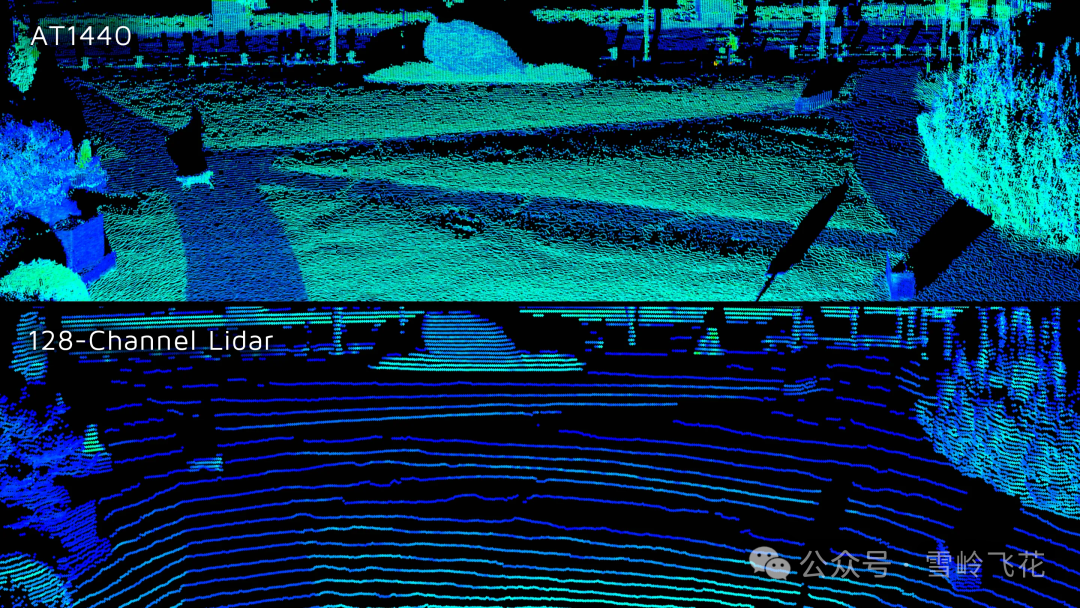

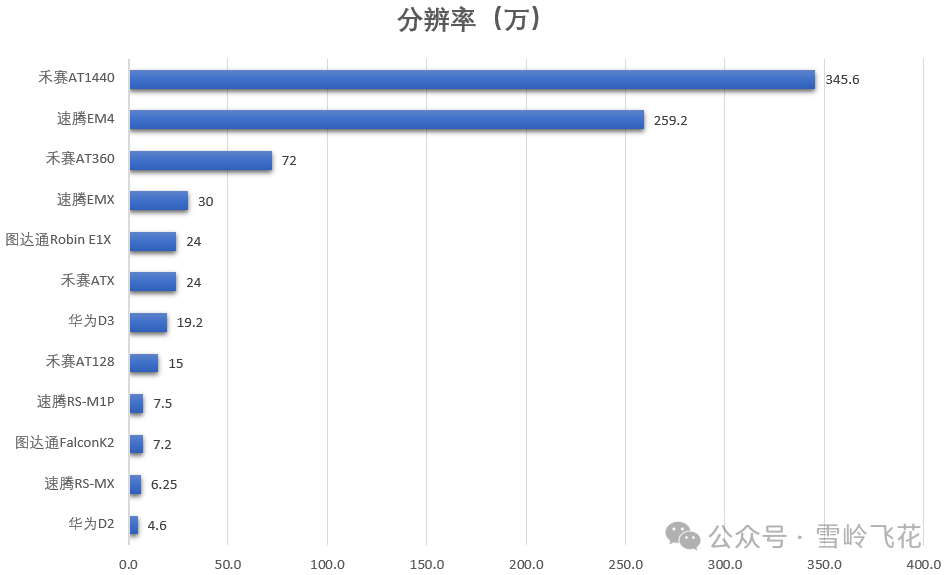

激光雷达也需要提升分辨率,用于提升小目标的检测能力。

禾赛和速腾都已经发布了超过1000线的高线束激光雷达,即禾赛的AT1440(1440线)和速腾的EM4(1080线):

禾赛的AT1440检测效果:

速腾EM4的检测效果:

千线激光雷达成本比较高,另外对于系统通信带宽和处理能力,也有相当大的压力。

5. 应对方案(毫米波雷达)

如果小目标是金属材质的,对于毫米波雷达的检测会更为容易一些。

例如,4D成像毫米波雷达检测250米之外的可乐瓶:

图片来源:傲图科技

Mobileye采用PMCW技术开发的4D成像毫米波雷达,可以稳定检测和跟踪237m处的低矮木质货物托架:

图片来源:Mobileye

由于毫米波雷达的噪点较多,小目标或许可以提前检测,但是在实际应用中,目标的稳定性以及和噪声的区分度,会决定实际的应用效果。这个实际使用的过程中,还是有相当大的挑战。

04

强弱目标混合

1. 场景要求

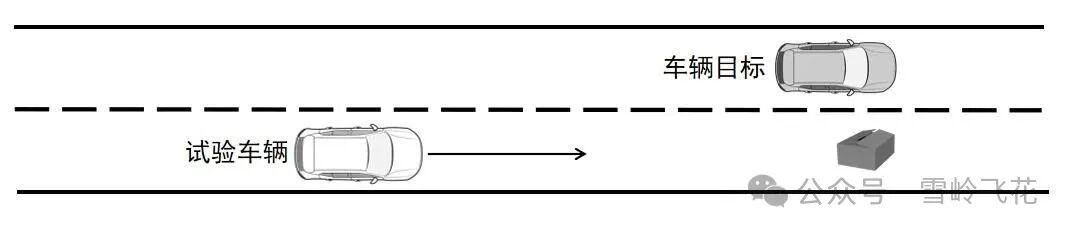

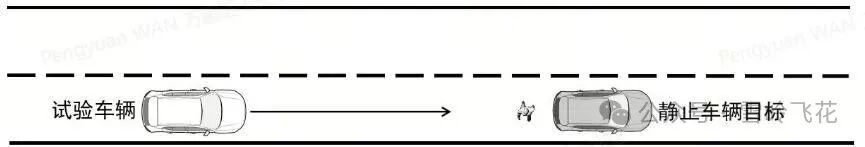

标准中设计了几个强弱目标的合并场景,例如在纸箱子旁边增加了一个车辆目标:

以及,行人站在静止车辆的后面:

2. 场景分析

小目标单独检测本来就比较困难,如果还有大目标(或者强反射目标)在旁边,由于会有混叠,将会进一步增加检测的难度。

2022年8月10日,一辆小鹏P7在宁波市高架桥路段最左侧车道快速行驶,随后撞上一辆停靠在同一车道的故障车辆,并且将站在故障车尾部的人员撞飞。

3. 应对方案(摄像头)

对于摄像头来说,如果小目标和车辆目标混叠,由于训练集的不足,有可能导致视觉漏检。

4. 应对方案(激光雷达)

这种场景对于激光雷达检测没有影响。

5. 应对方案(毫米波雷达)

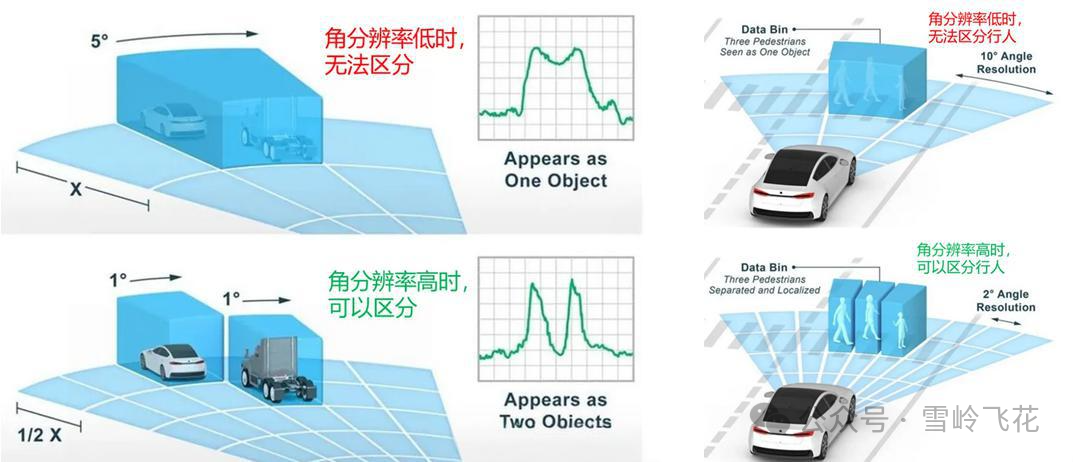

对于分辨率较低的毫米波雷达,大小目标合并的场景对于小目标很容易漏检。

分辨率对于目标检测的影响示意如下:

4D成像毫米波雷达通常角分辨率更高,大小目标的区分能力会更强。

05

弯道内静止目标

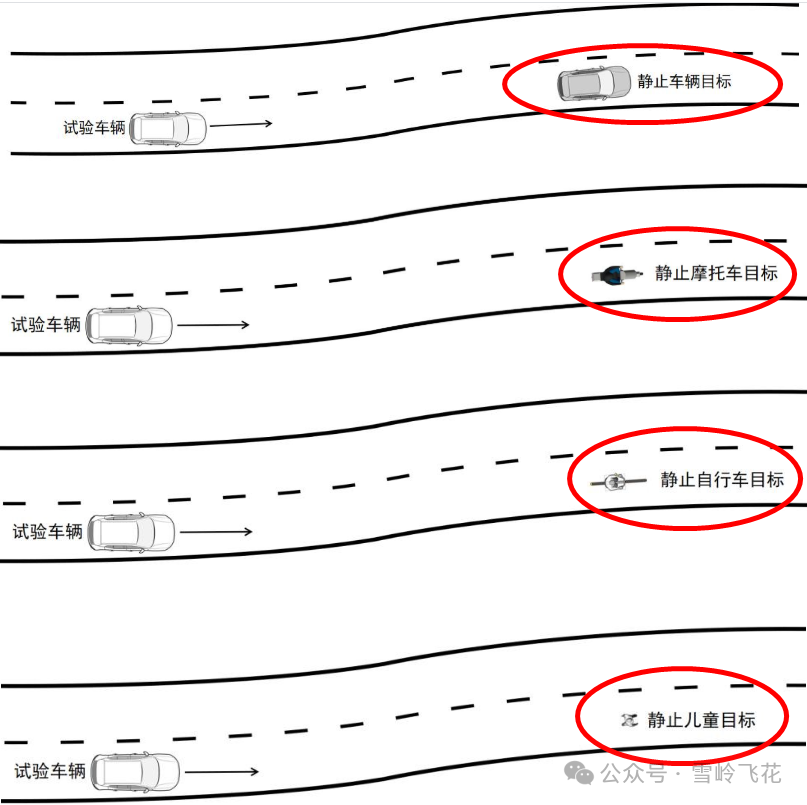

1. 场景要求

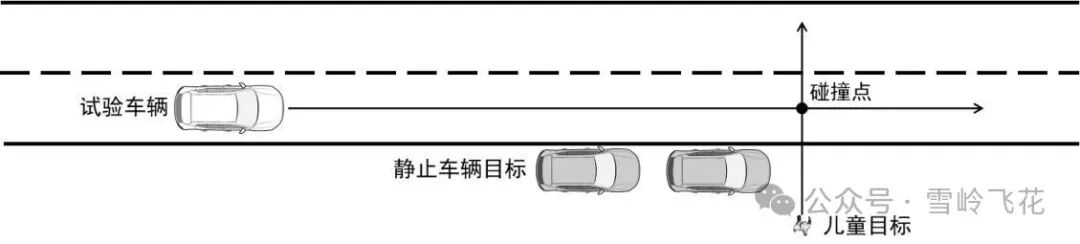

标准中设置了S型弯道内存在静止目标的场景,静止目标包括静止的车辆、摩托车、自行车和儿童:

2. 场景分析

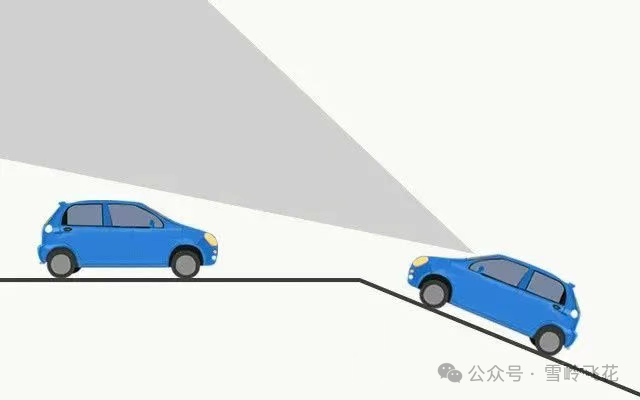

当道路有弯曲时,由于道路遮挡或者车辆的姿态的原因,目标进入智驾系统的感知区域较晚:

类似的,车辆在上坡时,对于对向车辆及坡道上的其他障碍物会检测较晚。

3. 应对方案

这种场景由于超出传感器感知范围,感知单元能做的是尽量增大水平和垂直FOV,尽量减小盲区,从而尽早提前发现危险目标。

更重要的是,在智驾策略中,当识别到类似路况时,需要提前降低车速,给感知单元预留足够的检测时间。

06

前前车静止,前车突然切出

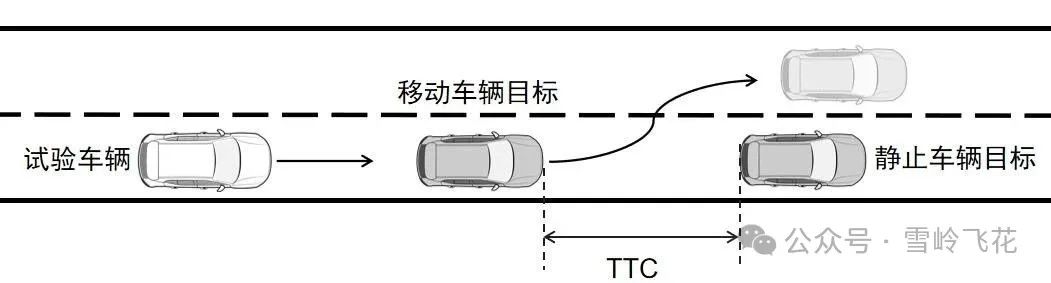

该场景是前面移动的车辆突然切出,而前前车是一个静止车辆。

2. 场景分析

该场景有时也被称为“消失的前车”,由于前车的突然切出,往往会导致后车来不及反应,是一种非常危险的工况,因此相关事故也经常发生,例如:

3. 应对方案(摄像头、激光雷达)

由于有前车遮挡,视觉和激光雷达很难检测前前车。

能做的还是提高检测速度,在目标出现之后,以尽量短的时间完成检测。

4. 应对方案(毫米波雷达)

毫米波雷达的电磁波由于有反射特性,可以通过多径效应,检测“前前车”。

图片来源:大陆汽车

检测前前车的毫米波雷达:

图片来源:华为

不过,由于很多噪声也是由于多径导致的,通过多径生成的目标强度一般较弱,很容易被当做噪点滤除。另外,如果前前车是静止的,毫米波雷达的检测难度将更高。

07

静止车辆后横穿

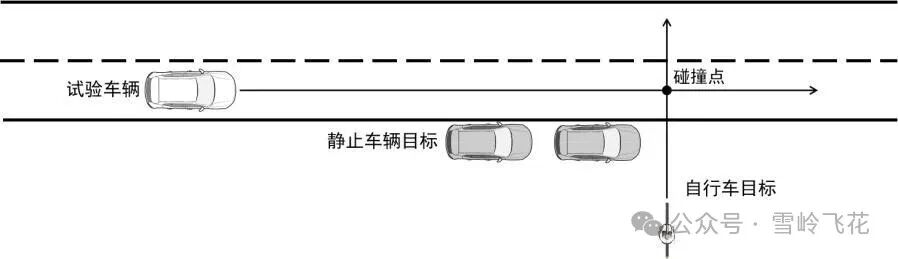

1. 场景要求

这个场景就是通常讲的“鬼探头”。

2. 场景分析

“鬼探头”在交通事故中非常常见:

3. 应对方案(摄像头、激光雷达)

这类场景对于摄像头来说,较难处理。

之前有观点提到,摄像头可以透过旁边静止车辆的玻璃,来提前识别横穿的车辆或者行人,实际上这个实现起来非常困难。

对于激光雷达来说,也没有太好的方法。

主要能做的还是提高检测速度,在目标出现在FOV范围内之后,以尽量短的时间完成检测。

4. 应对方案(毫米波雷达)

相对来说,毫米波雷达可能有机会更早的检测目标。借助于电磁波有衍射和绕射特性,可以一定程度的检测障碍物之后的目标:

检测示意图:

08

感知系统的持续进步

标准中提到的“危险工况”很多,再叠加不同的光照和天气要求,组合得到的测试案例会更多。不过,相对于真实世界中的“危险工况”来说,这些案例仍然是冰山一角。

如何保证智驾系统的安全,是一个需要长期研究的命题。其中,感知系统的性能,很大程度上决定了智驾系统能应对多少“极端场景”。

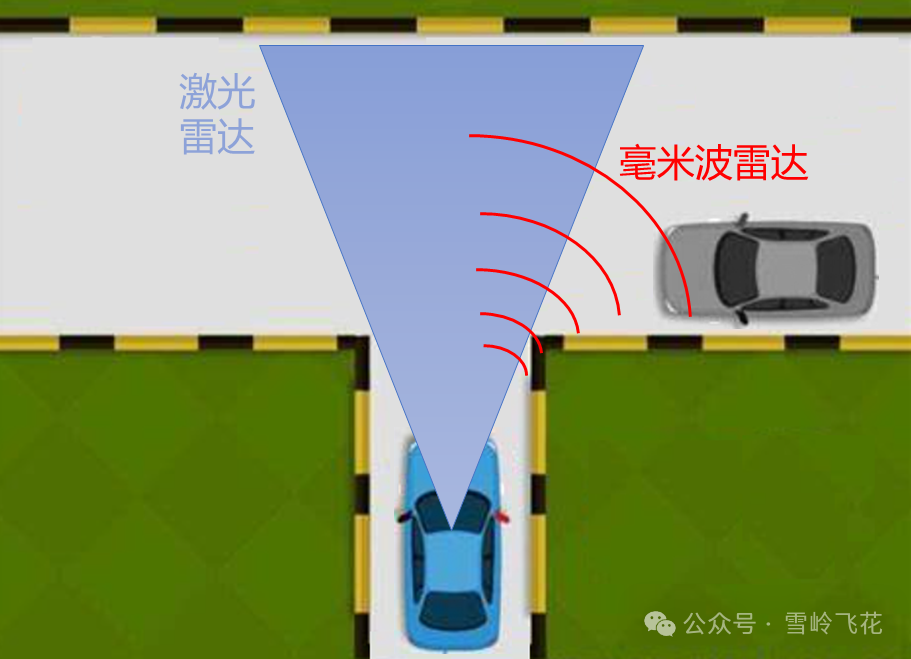

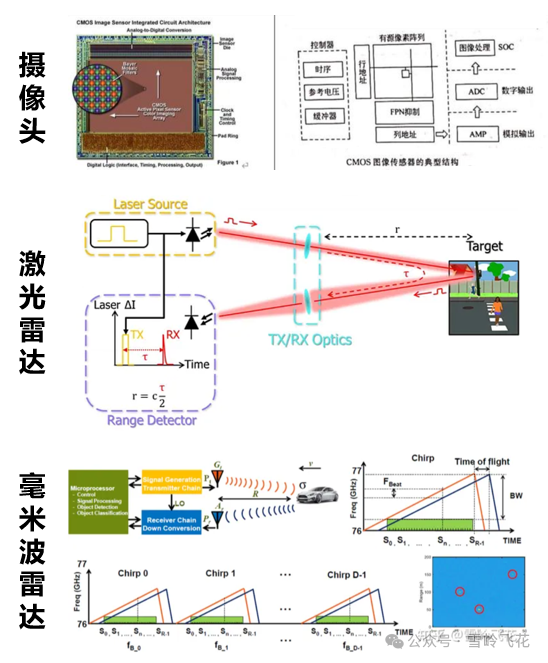

摄像头、激光雷达和毫米波雷达作为驾驶辅助系统的主力传感器,工作过程各异:

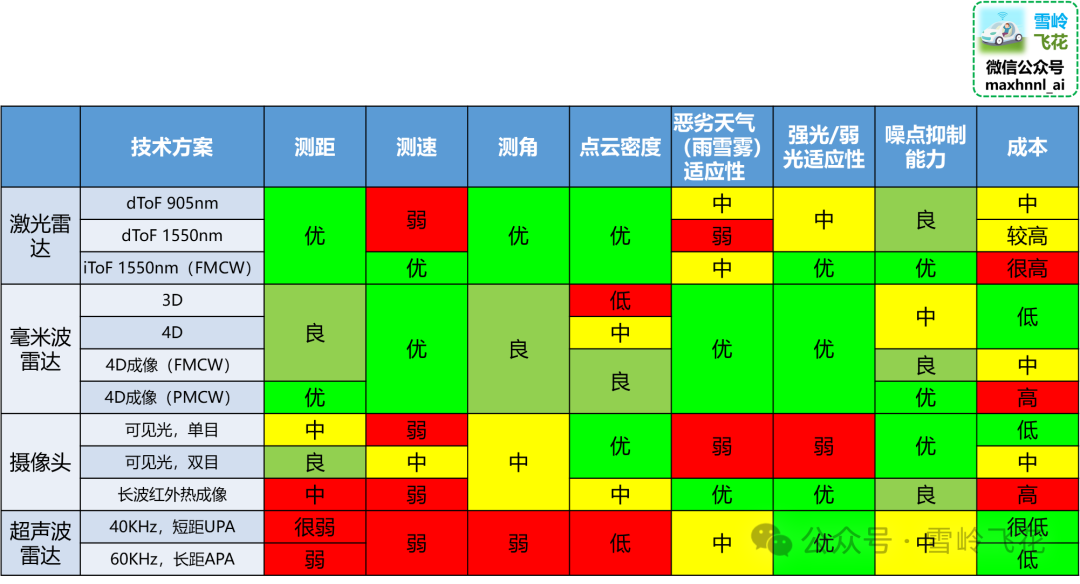

每种传感器各有优劣势:

1. 摄像头

目前车载摄像头的主要发展方向是:

不过,作为一种被动感知部件,感知效果必然会受到环境的影响。在低光照、高动态、低纹理环境,以及雨雾等恶劣天气下,目前的改进方案只能尽量的减小性能衰减,而很难彻底避免。

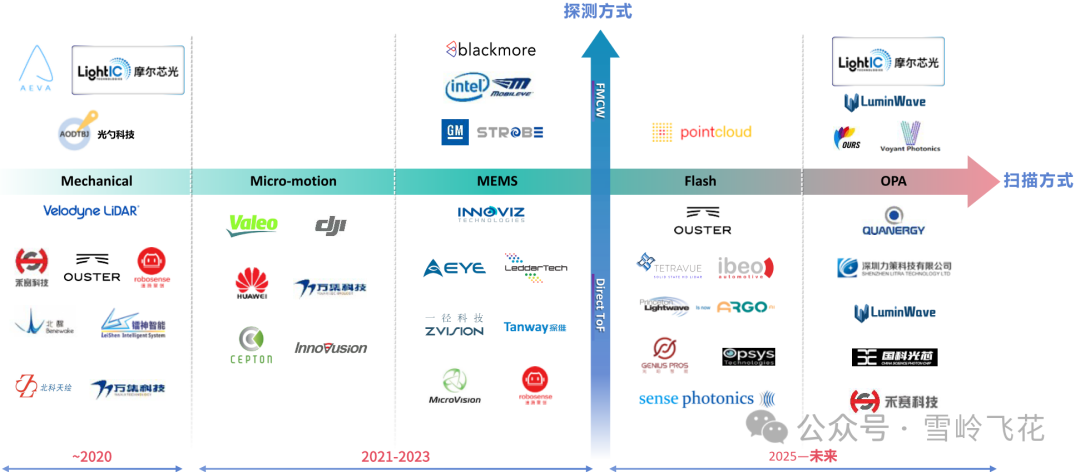

2. 激光雷达

激光雷达通过主动发射红外激光束,通过ToF或者FMCW原理,来进行目标测量。由于是主动感知单元,激光雷达受环境光照强度的影响很小,甚至环境光照越低,激光雷达的检测效果越好。

图片来源:摩尔芯光

目前激光雷达的主要发展方向是:

激光雷达受到雨雾影响也比较大,对于高反目标经常会出现高反膨胀、鬼影等问题。高线束激光雷达的成本还比较高,纯固态激光雷达短期内还无法解决大角度和远距离的矛盾。

3. 毫米波雷达

在这三种主要感知部件中,毫米波雷达是最早应用于智能驾驶辅助系统中的传感器。早在上个世纪90年代初,毫米波雷达就被搭载在汽车上,实现ACC、AEB等功能:

图片说明:24 GHz VORAD radar mounted at the front side of a Greyhound bus. Photograph by W. Menzel.

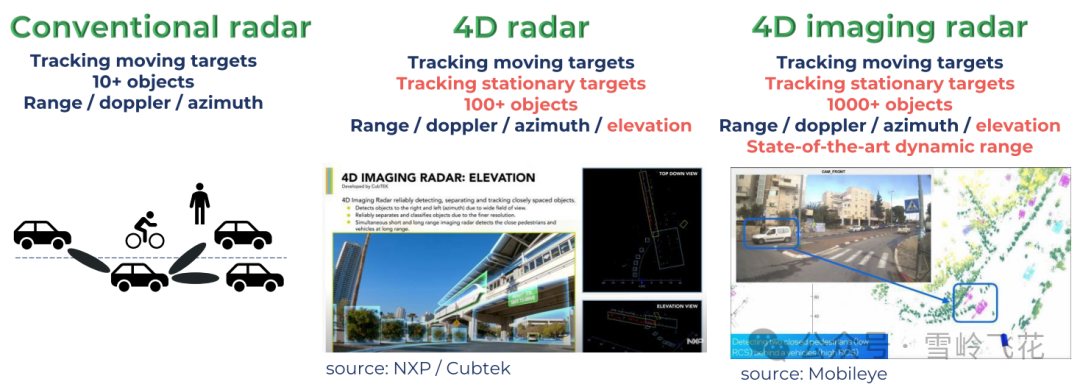

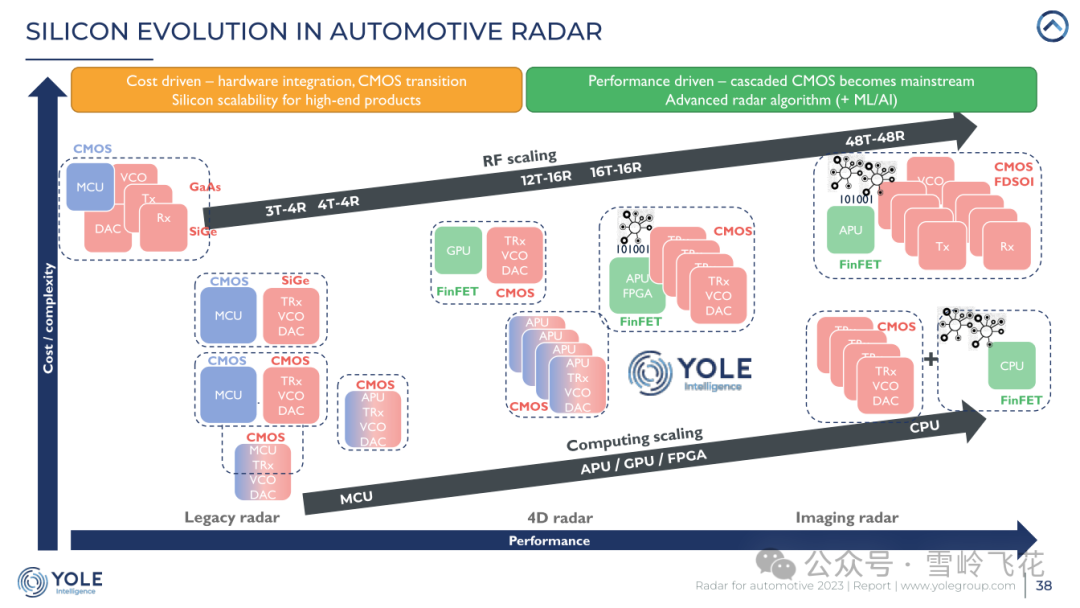

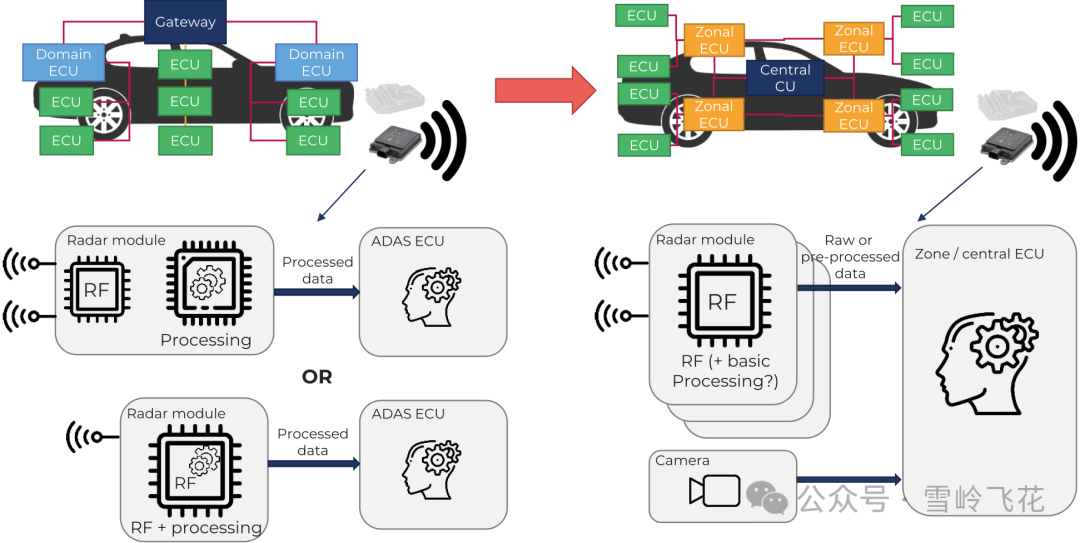

毫米波雷达目前主要的发展趋势:

图片来源:Yole

4. 感知融合

由于每种传感器优劣势各异,感知融合成为感知系统的重要发展方向,例如,激光雷达和摄像头可以做像素级别的融合。

图片来源:欧司朗

京瓷推出的摄像头和激光雷达的融合产品:

图片来源:京瓷

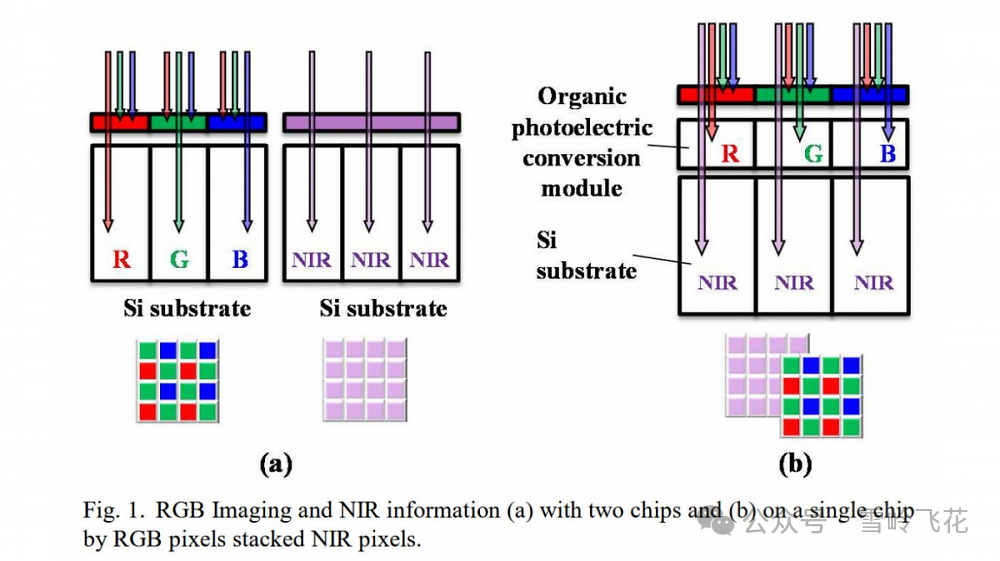

在IEDM 2024上,索尼展示了一款组合式摄像头和ToF传感器,能够同时输出RGB和深度信息,实现高分辨率的无失真图像。

如下是索尼这款堆叠传感器的详细结构,其中可见光被RGB像素吸收,TOF像素记录的红外波长可以穿过底层彩色滤光片,从而实现深度信息的测量:

图片来源:索尼

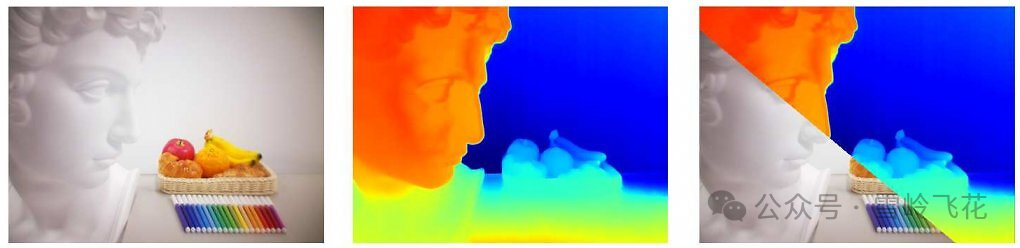

检测效果如下:

图片来源:索尼

此类融合传感器一旦能够量产,将带来感知系统的革命性变革。

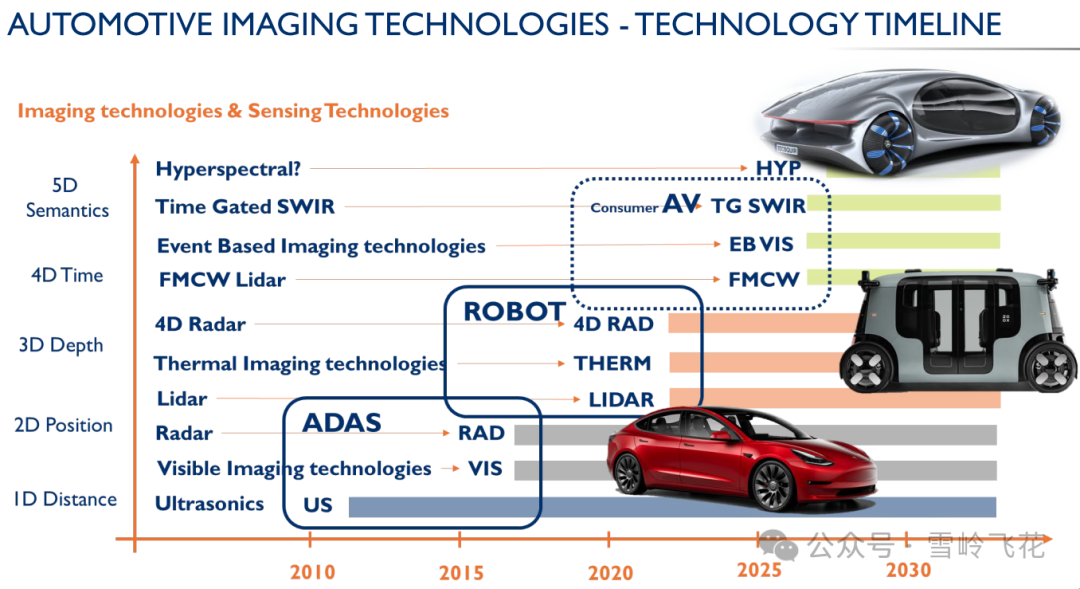

感知系统正在从1D、2D到3D、4D方向发展,未来甚至有5D的感知单元:

图片来源:Yole

09

结语

汽车作为一个商品,也一样面临性能和成本的权衡。通常来讲,摄像头分辨率越高、激光雷达线束数越多、毫米波雷达通道数越密集,传感器数量越多,能够覆盖的“极端场景”越多,但是成本往往也更高。

但是,智驾毕竟不是“冰箱彩电大沙发”,宕个机、运行出现偏差,可能顶多影响点心情。

智驾一旦出问题,可能影响的不仅仅是一点心情。作为一个要代替驾驶员开车的设备,智驾系统的安全性,应该被分配足够的权重。

文章转载自公众号:雪岭飞花

作者:雪岭飞花

原文链接:https://mp.weixin.qq.com/s/L9plTykXkMWNqOW6MQ7EOw