灵巧抓取为什么这么难?

近两年,具身领域在认知、感知和规划层面取得了显著进展,但让机器人在物理世界中实现精细手部操控、像人类一样执行复杂的灵巧操作,仍是非常大的难题。目前具身领域已经突破了人类语言理解、物体和场景识别、规划具体任务步骤,但在灵活抓握、感知调节力度等方向还存在很多问题。

真实场景中,灵巧抓取会面临精确控制、高维运动规划和实时适应动态环境等挑战,任务复杂性要求强大的机械设计和先进控制算法。

而灵巧操作背后的硬件主要是灵巧手,又可以分为两类:两指夹爪和多指拟人化手。两指夹具因其可靠性、简单性和易于控制而被广泛使用。但这类硬件通常只有一个自由度,很难适配一些复杂任务。为此,类人的具备20+自由度的灵巧手应允而生。这些拟人化手更适合与为人类设计的物体和环境进行交互。

1)现有灵巧抓取与数据采集方案

目前灵巧抓取的学习方法主要分为2类:强化学习和模仿学习。

模仿学习无需构建复杂世界模型和设计奖励函数,机器人通过观察和模仿演示学习任务。而强化学习(RL)无需特定数据做监督,设定奖惩来完成任务的学习。这种方式绕开了人工采集数据的麻烦,但RL需要大量训练、大规模交互数据,以及精心设计的机制来确保稳定性和有效性。

而灵巧操作的数据采集主要依赖遥操作,而遥操本身又可以分为基于视觉的方案、动捕方式、VR/AR等。

基于视觉的遥操系统成本低,但也常常受到遮挡、光照、分辨率、背景等因素的影响。动作捕捉系统通常使用稳定的硬件设备,这些设备对光照变化、遮挡和复杂背景具有较强的鲁棒性。VR设备通常包括头戴式显示器、跟踪系统和输入装置,便于映射与交互。

2)灵巧操作数据脱离不开的定律

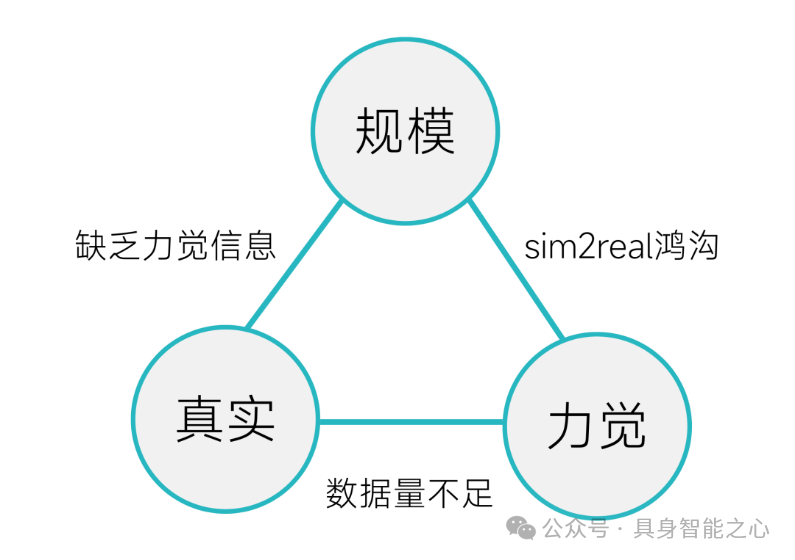

虽然国内外各大机器人公司都在发布海量数据集:百万级轨迹、千小时演示,但却缺乏相关力控信息。灵巧手数据好像一直脱离不开这样的定律:scale、真实、力觉只能三选二。

数据获取方式决定了不能既要、又要、还要!

对于具身领域来说,真实场景下的灵巧操作数据采集非常昂贵,开源或实验室级别往往最多只有数万条,而且不包含触觉和力的信息。如果上仿真呢?确实可以拿到百万级甚至亿万级别的数据,但真实场景的泛化存在很大问题,sim2real有的甚至达不到70%成功率。

如果采集真实场景下的力觉数据,这个成本则更高,目前的数据集都不足以支持大规模的预训练。

3)灵巧操作任务的瓶颈

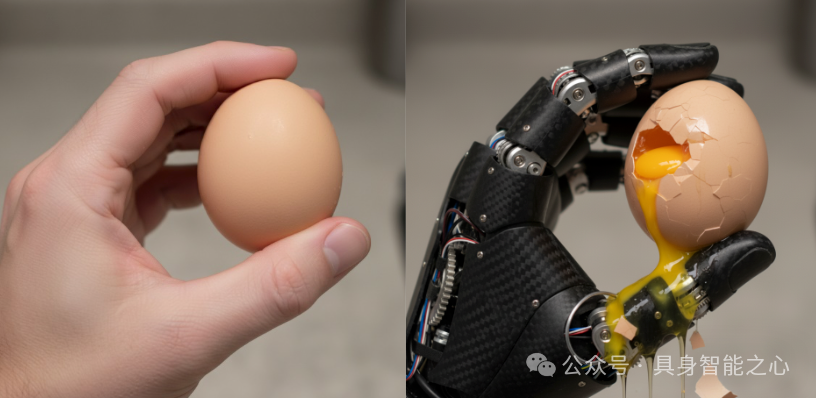

现有方法难以在复杂操作中(如抓取易碎物)实时感知微小力度变化,对传感器的要求也很高。除此之外,传统的基于模型的方法由于灵巧操作的高维度和复杂接触动力学,难以在不同任务和物体变化中进行泛化。

这其中,最大的瓶颈就是缺乏能够精准刻画人手操作中微力觉、高精度几何与复杂接触关系的大规模高质量数据。

如何有效解决这类问题?

突破这一难题的关键在于解决大规模、高质量、多模态灵巧操作数据的缺失问题。

缺乏了力控,即使运动和轨迹再完美,也不是真正的灵巧操作。

DexCanvas数据集正式推出!

1)这个数据集是什么?

2)DexCanvas的突破

之前的痛点,DexCanvas解决了。

开源数据集的力和触觉信息缺失,这一次彻底做了弥补。DexCanvas中的每条轨迹都有完整的多指力/接触标注,专门针对20+自由度系统优化。

不知道怎么生成这类数据?别慌!里面还提供了动捕→MANO拟合→物理重演→五指灵巧手执行,开源所有处理代码。

很多时候下载的数据不知道怎么用?HuggingFace上给大家提供了完整的预处理、可直接训练的版本。

3)综合指标优于常规数采方案

和常规数据采集方案对比,DexCanvas的采集效率、数据质量、采集成本综合优势非常突出,

除此之外,DexCanvas还有更多优势!

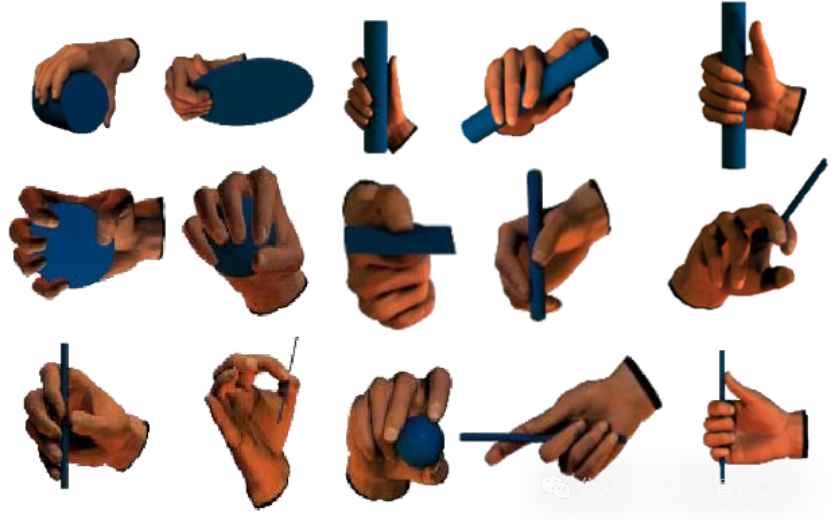

基于22类人手操作模式,为数据采集和组织提供结构化框架。汇聚超1000小时真人多模态演示数据与10万小时物理仿真合成数据,涵盖亚毫米级位置轨迹和物理一致的接触力信息,包含4种模态同步数据。

采用独创的物理信息完备的操作轨迹复刻流程,自动生成了缺失的力觉和接触信息。

泛化能力极佳,数据源于纯人类演示,不依赖特定机器人形态,为跨平台技能迁移提供通用基础。

4)如何“复活”规模级真实力控轨迹数据

知道物体的运动方式,质量和几何,理论上物理学中可以推出反作用力。但是逆动力学和优化方法都不行,一个是接触点未知方程无解,另外一个是非凸问题。

那么DexCanvas究竟是如何生成带有真实力控的轨迹呢?按照顺序,可以分为三个步骤:

真人演示,精准采集

已关注

关注

物理仿真反推,恢复力控

将真实轨迹放进物理仿真环境,借助强化学习智能体尝试复现这些动作。

值得注意的是智能体必须施加正确的力、选择正确的接触点,才能在仿真中成功重现人类的演示。这个过程为我们复原了原始数据中缺失的关键信息。

已关注

关注

通过多种数据增强方式,扩充数据

DexCanvas通过改变物体质量、调整摩擦系数、扰动初始位置将1000小时的人类演示扩充为10w小时增强数据。

数据规模明显提升,力控数据依旧保持。

不同于纯仿真

5)模型在真机上的效果如何?

加速产业落地!期待开源

整个领域正在经历数据收集的爆发期,但大部分努力都集中在扩大规模上。现有的大规模数据集推动了视觉和模仿学习的进步,却始终缺少物理交互这个关键维度。我们期待能够尽早开源这个数据集,加速相关领域的进展。

文章转载自公众号:具身智能之心

原文链接:https://mp.weixin.qq.com/s/IzKME2Xln5TkG84Ztr_IpQ