1. 研究背景

本工作面向“地面视角生成空中视角图像”这一跨视角图像合成问题,即依据街景图生成对应的鸟瞰或卫星影像。该任务在城市建设规划、应急救援评估、旧城区数字化重建等应用方向具有潜在价值。

由于地面视角与卫星视角在成像角度、遮挡情况以及场景表达上存在显著差异(如建筑立面 vs 屋顶)、城市密集环境中目标被遮挡、不同来源数据的统计分布差异等因素,使得生成结果在结构一致性与真实感方面仍难以兼顾。因此,迫切需要一种可在跨视角条件下实现视角对齐、信息融合并提升生成质量的模型框架。

由于地面视角与卫星视角在成像角度、遮挡情况以及场景表达上存在显著差异(如建筑立面 vs 屋顶)、城市密集环境中目标被遮挡、不同来源数据的统计分布差异等因素,使得生成结果在结构一致性与真实感方面仍难以兼顾。因此,迫切需要一种可在跨视角条件下实现视角对齐、信息融合并提升生成质量的模型框架。

2. 创新贡献

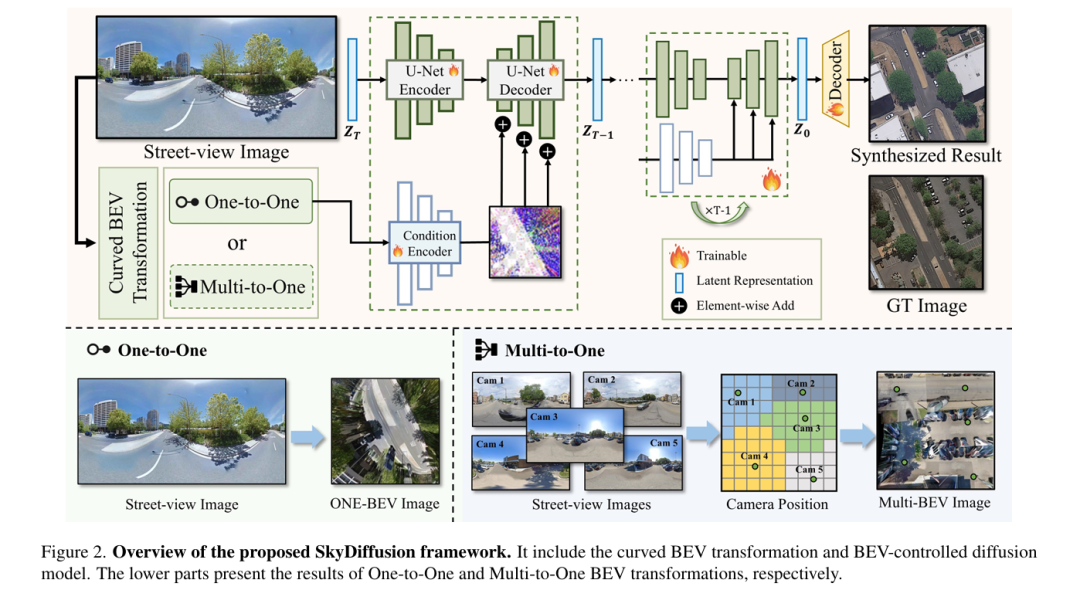

本研究提出 SkyDiffusion,并主要包含以下创新点:

- SkyDiffusion:BEV 与扩散模型结合的生成框架

首次将 Bird’s-Eye View 表示与扩散式生成架构融合,实现从街景图像合成结构保持性更强、纹理更真实的卫星/空中视图。 - Curved-BEV 视角变换机制

相较于传统平面假设的 BEV 表示,引入曲面式投影以缓解高层建筑、远距离目标造成的视角畸变问题,从而更好地保持跨视角内容一致性。 - Multi-to-One BEV 信息整合策略

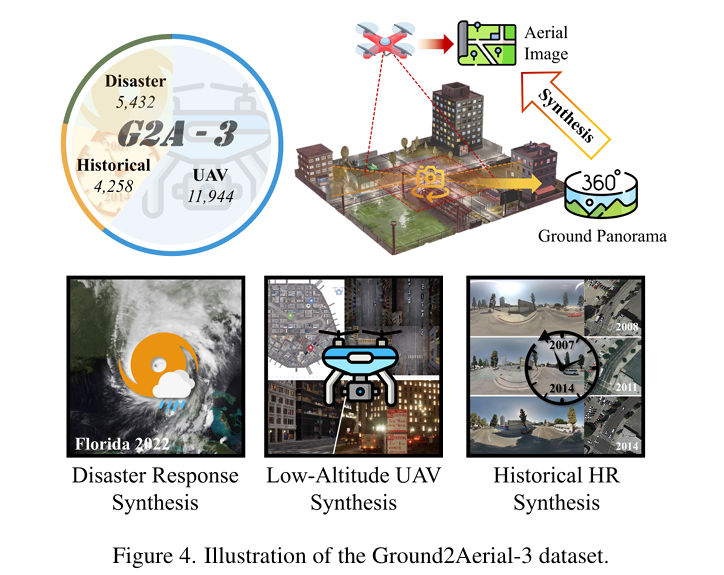

针对城区环境中可视范围受限的问题,提出从多个地面视角汇聚 BEV 表征的方法,以生成更完整、更少遮挡的空中图像。 - Ground2Aerial-3(G2A-3)数据集构建

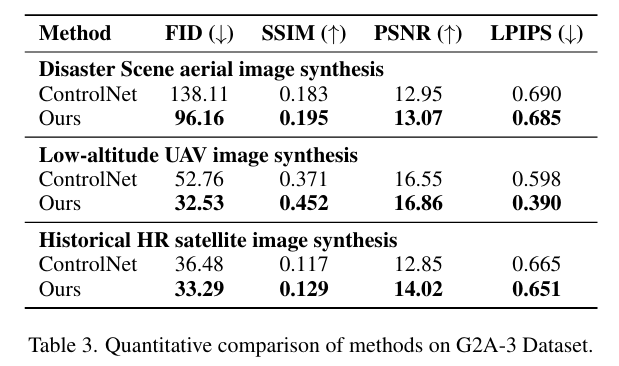

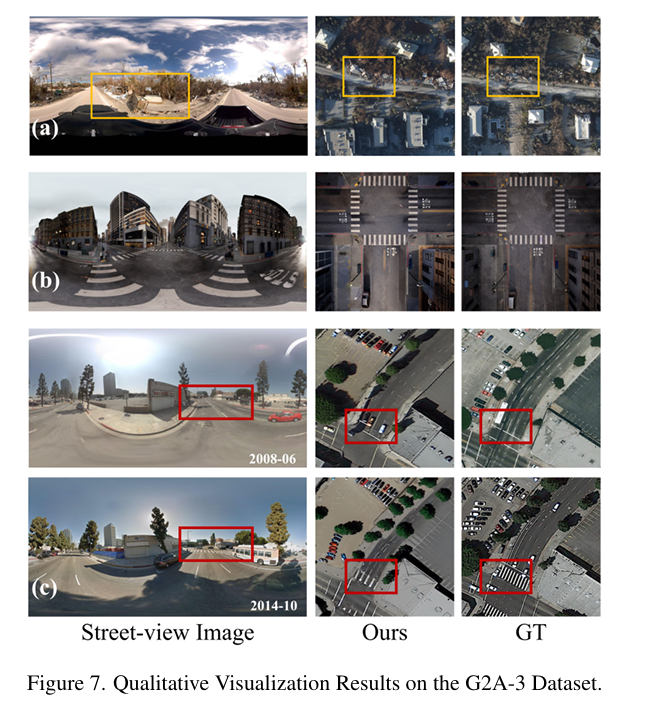

搭建全新的跨视角图像生成数据集,覆盖三类典型应用场景:

灾后评估任务:基于 CVIAN 飓风后影像,包含 2700 对样本

低空 UAV 子集:使用 UE 引擎渲染生成地面视角与低空无人机视角

历史影像补全任务:结合 2007–2014 年街景图与 MassGIS 高分辨率卫星图

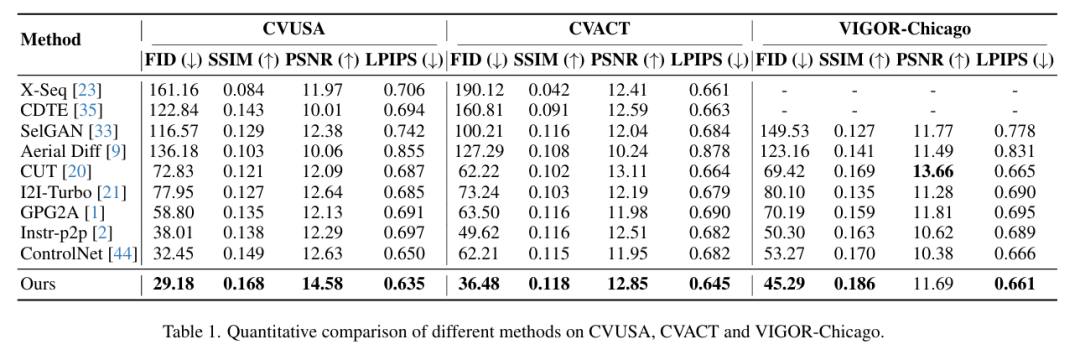

3. 数据对比概述

CVUSA / CVACT:郊区环境,单地面视角与卫星图匹配,视角一致性较高

VIGOR-Chicago:城市场景,存在多地面视角对应同一卫星图的情况

- G2A-3(本文提出):覆盖灾害、低空无人机、历史重建等多类型跨视角生成任务,更贴合真实应用需求

4. Method

SkyDiffusion:

SkyDiffusion 是一种从地面街景图像生成对应空中图像的跨视角图像合成框架。

Curved-BEV 转换(曲面鸟瞰图转换)

该组件用于将来自地面视角的街景图像重新映射为鸟瞰视角(BEV)表示,从而减弱地面图与卫星影像之间由于观察角度差异带来的“视域错配”,并提升跨视角语义对齐效果。

打破传统平面 BEV 假设:以往 BEV 转换通常基于“所有场景均位于同一水平面”的前提,即默认建筑、树木等目标与道路共面。这种简化在城市高密度区域会产生明显局限,导致建筑上层、远端道路等非地平面结构在转换过程中被扭曲或直接缺失。

打破传统平面 BEV 假设:以往 BEV 转换通常基于“所有场景均位于同一水平面”的前提,即默认建筑、树木等目标与道路共面。这种简化在城市高密度区域会产生明显局限,导致建筑上层、远端道路等非地平面结构在转换过程中被扭曲或直接缺失。

Curved-BEV:曲面化视角建模:为解决上述问题,SkyDiffusion 引入曲面化 BEV 表达,将 BEV 投影空间建模为向上弯曲的虚拟表面,使视域中心之外的区域能够以更符合人类观察直觉的方式映射到俯视视角。这种非线性空间变换能够更完整保留高处与远处的信息,例如楼宇顶部、树冠层等,从而提升生成结果的结构完整度与几何连贯性。

无需相机标定与深度估计:该转换策略通过图像内容本身推导视角重构,不依赖相机内参、外参或显式深度预测,因此在实际部署中对数据采集条件要求更低,具有更高的可操作性与适用性。

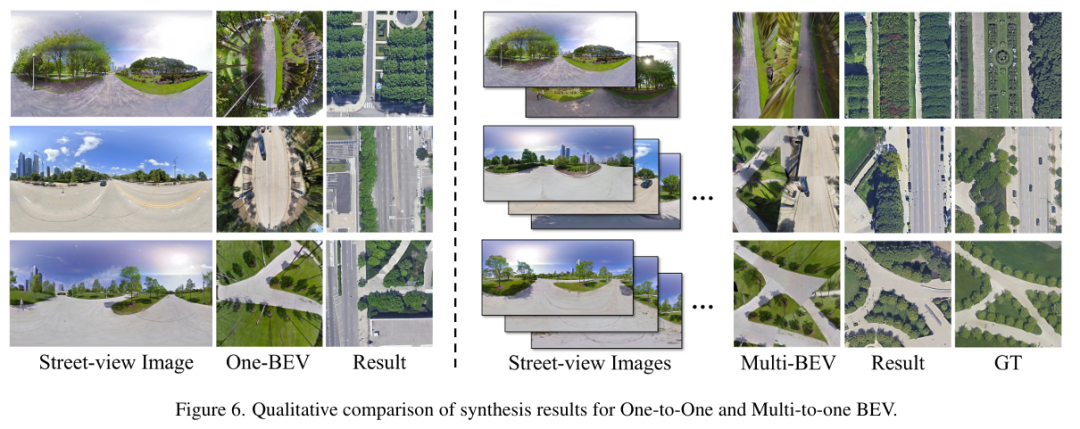

Multi-to-One BEV 融合机制

在城市街区,由于高楼、植被等遮挡因素,单一地面视角往往难以覆盖完整区域。为扩大可见范围,SkyDiffusion 引入了一种将多张街景图统一映射到同一 BEV 表达中的融合策略。

多视角 BEV 表达整合:来自邻近位置的多张街景影像首先分别转换为独立的 BEV 表征,随后依据它们在空间中的相对位置与拍摄点分布,被合并到共享的俯视坐标系内,从而形成更广阔的有效视域。

基于空间关系的选择与对齐:融合过程中,以街景采集点与目标空中图区域之间的空间距离作为权重依据,优先采用覆盖效果更佳、视角更合适的 BEV 结果进行叠加,以保证映射区域的连续性与几何一致性。

针对高密度城区的适应能力:该方案在视线受阻、遮挡明显的城区场景中尤为有效,来自不同角度的观测能够互补缺失区域,使最终生成的空中视图具备更完整的结构信息与更高的内容还原度。

BEV 引导的扩散生成模块

在完成 BEV 转换后,SkyDiffusion 利用改进的扩散生成网络将地面视角的 BEV 表征映射为卫星图像,从而实现跨视角内容的一致性与结构保真。

条件引导机制:参考 ControlNet 的设计思想,本模块在 Stable Diffusion 架构基础上增加了条件编码支路,将 BEV 图像嵌入主扩散模型的中间特征层,从而在生成过程中对图像内容提供有效指导,确保生成结果与地面视图保持空间对应关系。

空间注意力特征提取:鉴于 BEV 图可能存在局部信息扭曲,网络引入空间注意力机制以增强关键区域的特征响应,例如道路走向、建筑轮廓等,同时抑制不相关或干扰信息,从而提高生成图像的结构精度与语义一致性。

训练策略:模型训练采用标准噪声-还原流程,学习从随机噪声中恢复真实卫星图像。整个过程仅依赖 BEV 条件输入,无需文本提示或语义分割图作为辅助,提升了方法在实际场景中的可用性与普适性。