华为

华为 ADS 硬件迭代:多传感器融合方案

从 ADS1.0 到 4.0 的迭代过程中,华为坚持多传感方案,通过激光雷达、毫米波雷达、摄像头等多传感器互补融合感知,达到全天候全天时的高效感知能力。

- 摄像头作为基础图像信息传感器,起到不可或缺的作用。

- 激光雷达可以丰富周边环境信息并生成 3D 环境图像,不受光照条件的影响。

- 极端恶劣天气条件下,毫米波雷达(4D 毫米波雷达)可以辅助完成环境信息的采集及障碍物的探测。

- 超声波雷达成本低、对短距感知探测强,为泊车的辅助的必备元件。

华为技术方案进程

华为 ADS1.0

ADS 1.0 采用有图智驾,与导航地图不同,高精地图包括了传统地图的道路网数据、车道网数据(车道线的位置、类型、宽度、坡度和曲率等车道信息)以及交通标志等。

有图方案存在两大缺点:

一是新城渗透速度慢,从政府开放城市采集名单、图商制图到车企研发适配需要 2-3 年的时间;

二是更新不及时,由于高精地图测绘耗时耗力,需依赖四维图新、高德等图商,高精地图的更新频率在 1-3 个月左右,无法应对道路改造等情况。

华为 ADS2.0:GOD2.0+RCR2.0

主要核心能力是识别异形障碍物。

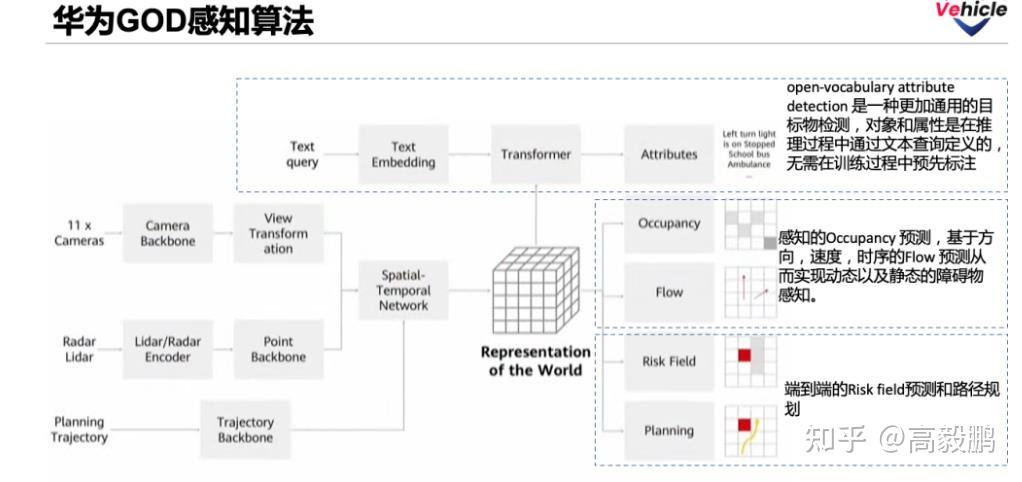

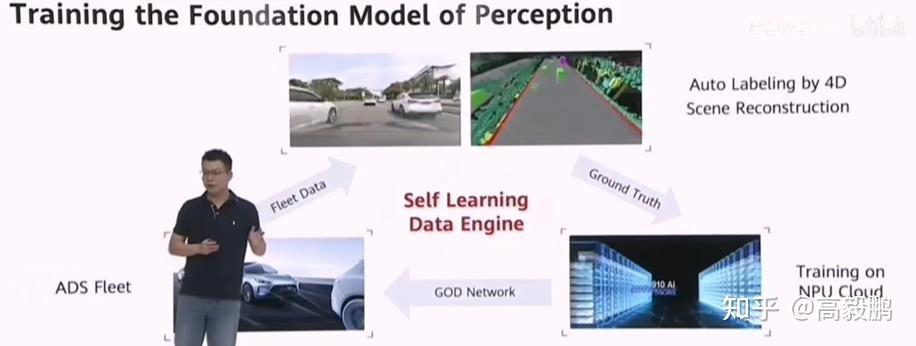

GOD

通用障碍物检测网络(GOD)是华为智能驾驶的关键算法,英文全称为 General Obstacle Detection Network。GOD 构建在自学习数据引擎之上:该网络部署在车辆端,利用车辆传感器收集的驾驶数据,通过自学习数据引擎挖掘有价值的信息。这些数据被发送到云端进行自动标注,随后在虚拟世界中进行 4D 场景的重建,每天能够产生大量的有价值数据,华为利用上千个 NPU 和上亿公里的驾驶数据对 GOD 网络进行训练,这些专门用于训练驾驶神经网络的 NPU 使自动驾驶系统不断优化和提升。

RCR

华为 ADS3.0

1. 端到端仿生大脑设计

ADS3.0 采用“端到端”(End-to-End)的仿生神经网络架构,通过海量真实驾驶数据的训练与学习,使系统能够模仿人类驾驶决策的逻辑,实现更自然、流畅的驾驶体验。例如,在变道、加减速等场景中,系统的反应更接近人类驾驶员的直觉判断。

2. 多传感器深度融合

系统整合了激光雷达、毫米波雷达、高清摄像头等多类传感器,构建了全景信息综合感知能力。其中,激光雷达(探测距离达到 200 米)负责高精度三维建模,毫米波雷达强化恶劣天气下的感知稳定性,摄像头则通过 AI 视觉算法识别交通标志、行人及车辆动态。多源数据融合后,系统可实时生成 360 度环境模型,显著提升复杂场景的应对能力。

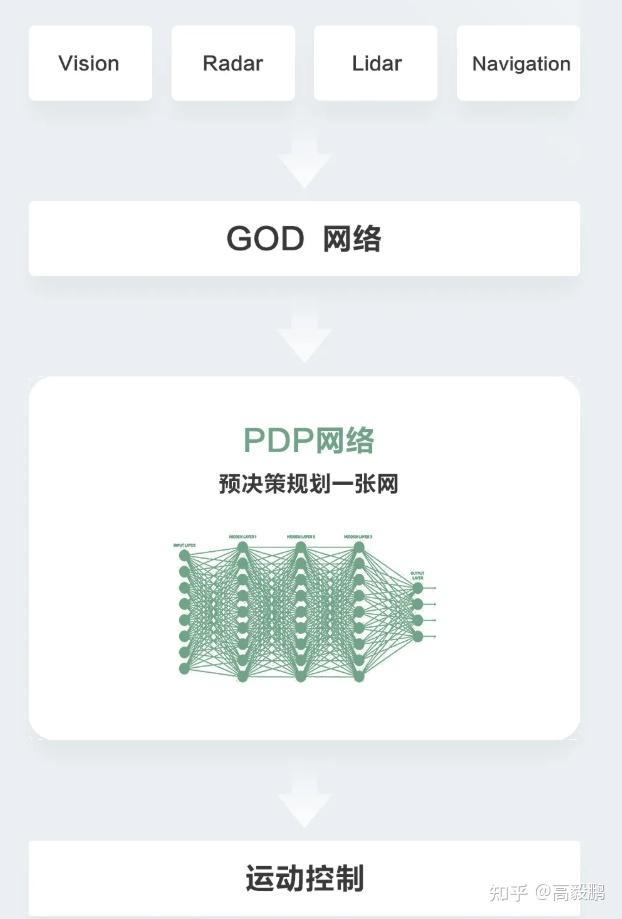

3. GOD 大网与 PDP 路径规划

- GOD(General Obstacle Detection)网络:升级后的 GOD 大网通过云端训练与车辆端实时学习,能够识别包括异形障碍物(如掉落货物、动物)在内的多种目标,识别精度较前代提升 30%。

- PDP(Path Decision Planning)算法:引入深度强化学习技术,系统可根据实时路况动态优化路径规划,减少对固定规则的依赖,例如在拥堵路段主动选择更高效的变道策略。

创新功能

ADS 3.0 的功能设计覆盖了从高速到城区、从驾驶到泊车的全场景需求,核心突破包括:

1. 车位到车位(Park-to-Park)智驾

系统支持从停车场入口到目标车位的全程自主导航与泊车,无需依赖高精地图。通过云端数据与实时感知的结合,车辆可自动识别车位类型(如斜列式、异形车位),并完成泊入操作。测试显示,其泊车成功率在复杂场景下可达 95% 以上。

2. 全场景智能防撞系统(CAS 3.0)

华为首创的 CAS 3.0 系统整合了 23 项主动安全功能,包括:

eAES 边刹边让技术:在紧急制动时同步调整车身姿态,避免二次碰撞;

防误踩加速踏板:通过行为预判阻止因分神导致的误操作;

全向防碰撞:覆盖前后左右四个方向的实时监测与避障。

据统计,该系统已累计避免潜在碰撞事故超 200 万次。

3. 城区与高速双域 NCA(Navigation Cruise Assist)

区别于仅支持高速场景的中阶智驾(如 ADS SE),ADS 3.0 实现了城区 NCA 功能,可应对红绿灯识别、无保护左转、行人横穿等复杂城市路况。在实测中,系统对交通信号灯的识别准确率达 99%,且能自主完成环岛通行和 ETC 车道通过。

文章转载自公众号:自动驾驶之心

作者:高毅鹏

原文链接:https://mp.weixin.qq.com/s/znoflUrZ_RMjAHtlPdkxpw