自动驾驶的世界模型,不仅要 “画得像”,更要 “动得对”—— 车辆交互、行人运动、场景演化都得符合物理与社会规则,而多数通用视频生成模型,更擅长外观逼真,却很难稳定地建模多智能体之间的结构化运动关系。

为了弥补这一差距,近年的自动驾驶世界模型往往选择“大力出奇迹”:用海量驾驶数据、长时间算力,把通用模型强行拉进驾驶领域。但这种方式成本极高,也很难复用通用模型已有的能力。

如果先把“怎么动”这件事单独想清楚,再去生成外观,会不会更高效?

这篇工作的出发点,其实并不复杂。

于是他们借鉴了动画制作中的一个常见流程。动画师在正式渲染之前,往往会先做一版“动作分镜”,只用极简的线条确定角色如何移动、如何互动,等动作逻辑成立后,再去补充外观细节。

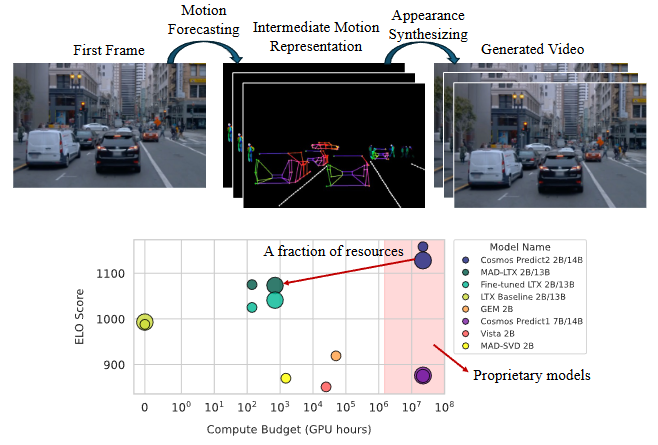

具体来说,整个方法分为两个阶段。

第一阶段,模型只负责预测“怎么动”。它生成的不是彩色视频,而是一种姿态视频:背景是黑的,画面中只保留车辆、行人和车道线的结构轮廓,用来描述它们的运动轨迹和相互关系。这一步的目标不是好看,而是确保运动本身合理。

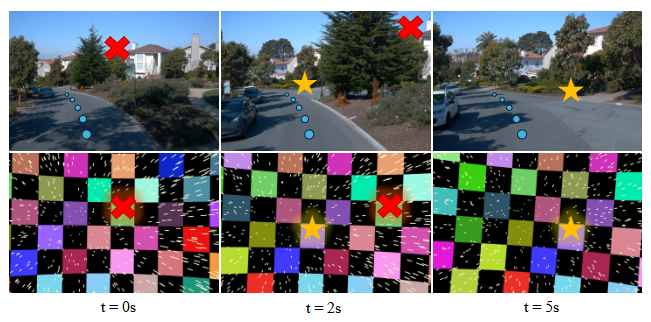

图1|姿态视频一览(主要体现为人或者车辆的骨架)©️【深蓝AI】编译

第二阶段,在已经确定好的运动结构上,模型再生成最终的 RGB 视频,把真实的外观、光照和细节补全出来。

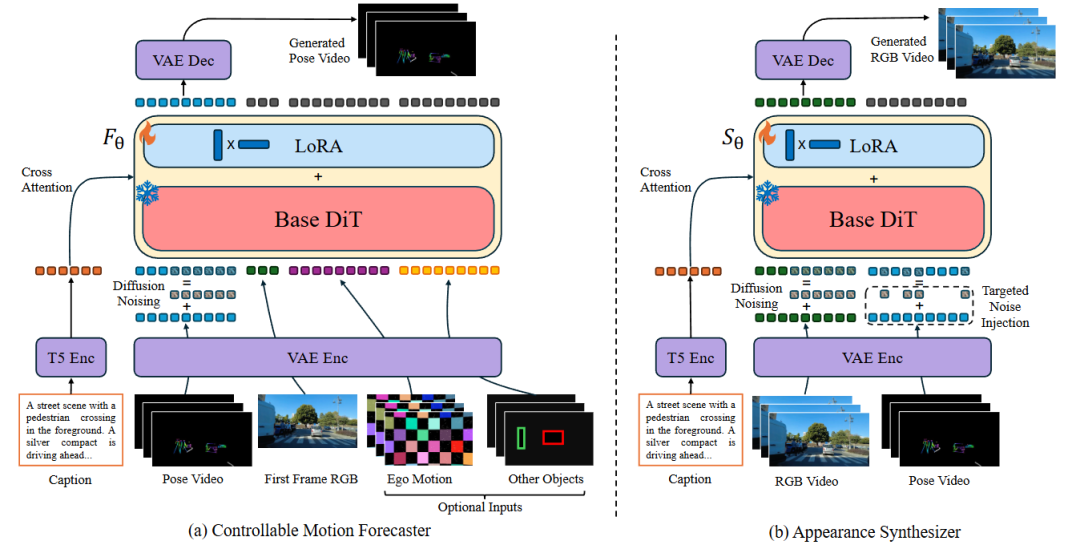

为了实现这一点,作者并没有重新训练一个复杂的新模型,而是复用了现有的视频扩散模型,只通过轻量的参数适配,让同一个模型在“预测运动”和“生成外观”之间切换角色。

图2|这张图细化了 MAD 中两个核心模型的训练流程。左侧展示的是运动预测模型:姿态视频在扩散过程中被逐步加噪,并与文字描述、首帧图像以及自车运动信息一起输入模型,最终学会还原合理的运动结构。右侧是外观生成模型:它在接收同样的文字条件和姿态信息的同时,只对“骨架相关”的部分加入噪声,从而学会在不完美运动预测下依然生成稳定、真实的 RGB 视频。推理时,这两个模型按顺序工作,前者的输出直接控制后者的生成©️【深蓝AI】编译

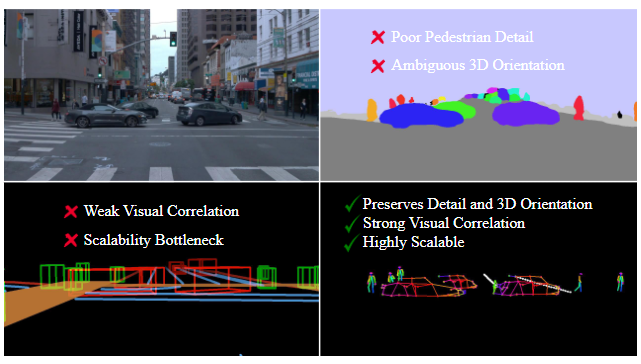

用“姿态视频”承载驾驶世界的运动结构

MAD 引入了一种中间表示形式——姿态视频,用简化的骨架结构来描述车辆和行人的运动状态。这种表示不关注纹理或颜色,只关心“谁在动、怎么动、彼此之间是什么关系”,因此更接近驾驶世界中真正决定安全与规划的核心信息。这相当于把“动作结构”从像素细节中单独抽离出来,让模型先学会理解行为本身。

图3|这张对比图解释了作者为何引入姿态作为中间表示。传统 HD 地图虽然抽象,但难以扩展;全景分割则缺乏三维结构,对行人细节尤其不友好。相比之下,基于姿态的表示既保留了三维信息,又以“对象”为中心组织结构,更适合用来同时做运动预测和视频生成,是一种更贴近驾驶行为本身的表达方式©️【深蓝AI】编译

最大限度复用通用视频模型,而不是推倒重来

无论是文本提示、初始画面,还是中间的姿态视频,MAD 都通过同一个编码器映射到统一的视觉潜空间中。这意味着模型始终在自己熟悉的表示空间里工作,而不是被迫适配一套全新的、驾驶专用的数据格式。结果是,模型可以直接继承通用视频生成模型已有的能力,用极少的额外训练,就适配到复杂的驾驶世界建模任务。

图4|这张图展示了 MAD 使用的一种自车运动视觉表示方式。通过在相机周围放置一个带纹理的静态球体和粒子,系统可以从背景纹理的相对运动中推断车辆的转向和速度变化。简单来说,背景的旋转反映方向变化,粒子的视差反映速度大小,让模型在不依赖显式数值输入的情况下,也能“看懂”自车运动状态©️【深蓝AI】编译

主动考虑“预测不完美”的现实情况

在真实应用中,第一阶段生成的运动预测不可能永远准确,姿态信息也会存在噪声和偏差。

MAD 在训练外观生成阶段,刻意对与骨架相关的表示加入扰动,而保持背景信息相对稳定,从而提升模型对不完美运动输入的容忍度。这种设计让系统在行为层面更贴近真实世界:即使感知有误差,模型依然能维持合理的世界演化。

在实验上,作者重点验证了两件事:效率与世界建模质量。

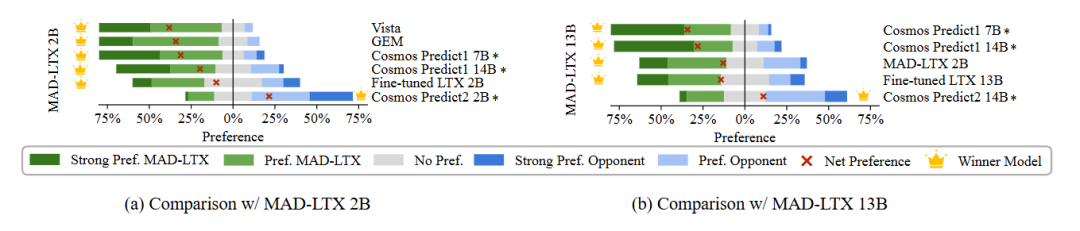

图5|这是一组人工偏好对比实验的结果。研究者让人类评审在两两对比中选择更“可信”的生成结果,统计每个模型被偏好的比例。可以看到,MAD-LTX 在大多数对比中都占据优势,而图中带“*”的模型则依赖私有数据和更高算力,这进一步凸显了 MAD 在效率上的优势©️【深蓝AI】编译

更有意思的是规划能力评测:

在不进行闭环控制的情况下,MAD-LTX 在 5 秒预测中取得更低的轨迹误差,同时保持更高的轨迹多样性。这说明,把运动建模从像素空间中“抽离”出来,反而更有利于学习真实的动态结构。

视频详情

视频1|画面中没有真实纹理,也没有复杂光照,只保留了车辆和行人的骨架结构,专注描述它们是如何移动、如何相互影响的。通过这种“姿态视频”,模型先学会理解谁在动、怎么动、彼此之间是什么关系,而不是被外观细节干扰©️【深蓝AI】编译

从结果来看,这套方法并不是“画得更花”,而是在具身层面更像一个会推演世界的系统。

MAD 提供了一种很有代表性的答案:

在复杂的具身场景中,与其追求一步到位的端到端生成,不如先明确哪些信息真正决定“行动是否合理”。

这对于自动驾驶、机器人仿真乃至更广泛的具身智能系统,都是一个值得反复琢磨的方向。

当模型开始先“想清楚怎么动”,再决定“世界长什么样”,

也许我们离真正可用的世界模型,又近了一步。

论文标题:MAD: Motion Appearance Decoupling for Efficient Driving World Models

论文作者:Ahmad Rahimi, Valentin Gerard, Eloi Zablocki, Matthieu Cord, Alexandre Alahia

论文链接:https://arxiv.org/pdf/2601.09452

文章转载自公众号:深蓝AI