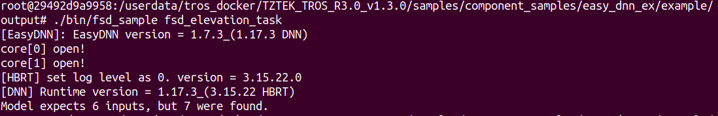

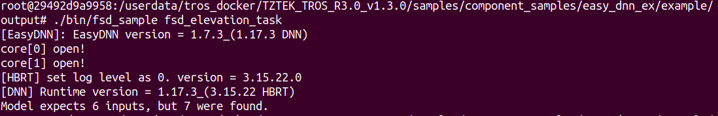

您好,现在我们对bevformer算法量化完成得到了.hbm文件,现在正在使用该模型文件进行任务推理,但是在使用的过程中出现了输入不正确的问题。我们将6张图像作为输入,但是在运行的时候报错显示模型需要的输入数量为7.

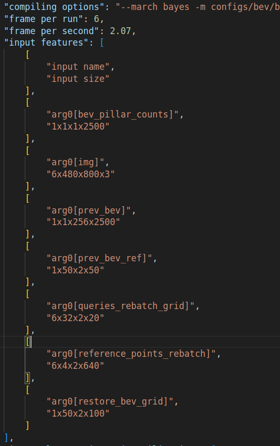

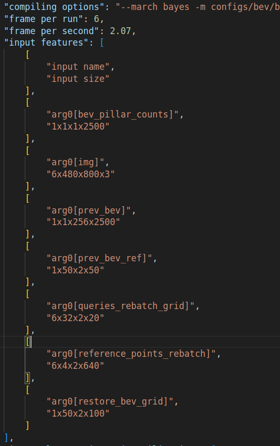

另外就是在量化后生成的文件中,看到了下图中的信息,这7项input具体它们代表的是什么意思我们现在不理解?在进行模型推理时我们该如何使用?

希望您能帮我们解决一下我们的难题,谢谢。

您好,现在我们对bevformer算法量化完成得到了.hbm文件,现在正在使用该模型文件进行任务推理,但是在使用的过程中出现了输入不正确的问题。我们将6张图像作为输入,但是在运行的时候报错显示模型需要的输入数量为7.

另外就是在量化后生成的文件中,看到了下图中的信息,这7项input具体它们代表的是什么意思我们现在不理解?在进行模型推理时我们该如何使用?

希望您能帮我们解决一下我们的难题,谢谢。

你好,复现了一下你的问题。

问题1: 将6张图像作为输入,但是在运行的时候报错显示模型需要的输入数量为7. .这个是你理解错了,模型确实是7个input, 也就是是vector的size为7,你说的6张图片只是说其中的一个Tensor的batchsize为6。

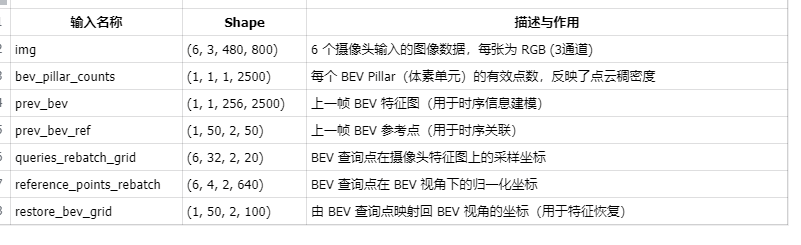

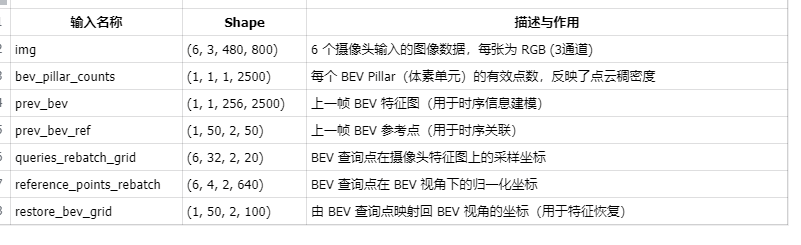

问题2: 7项input具体它们代表的是什么意思 ?目前了解到的信息如下,至于怎么生成数据还在看,有结果的同步你。

你好,复现了一下你的问题。

问题1: 将6张图像作为输入,但是在运行的时候报错显示模型需要的输入数量为7. .这个是你理解错了,模型确实是7个input, 也就是是vector的size为7,你说的6张图片只是说其中的一个Tensor的batchsize为6。

问题2: 7项input具体它们代表的是什么意思 ?目前了解到的信息如下,至于怎么生成数据还在看,有结果的同步你。

你好,复现了一下你的问题。

问题1: 将6张图像作为输入,但是在运行的时候报错显示模型需要的输入数量为7. .这个是你理解错了,模型确实是7个input, 也就是是vector的size为7,你说的6张图片只是说其中的一个Tensor的batchsize为6。

问题2: 7项input具体它们代表的是什么意思 ?目前了解到的信息如下,至于怎么生成数据还在看,有结果的同步你。

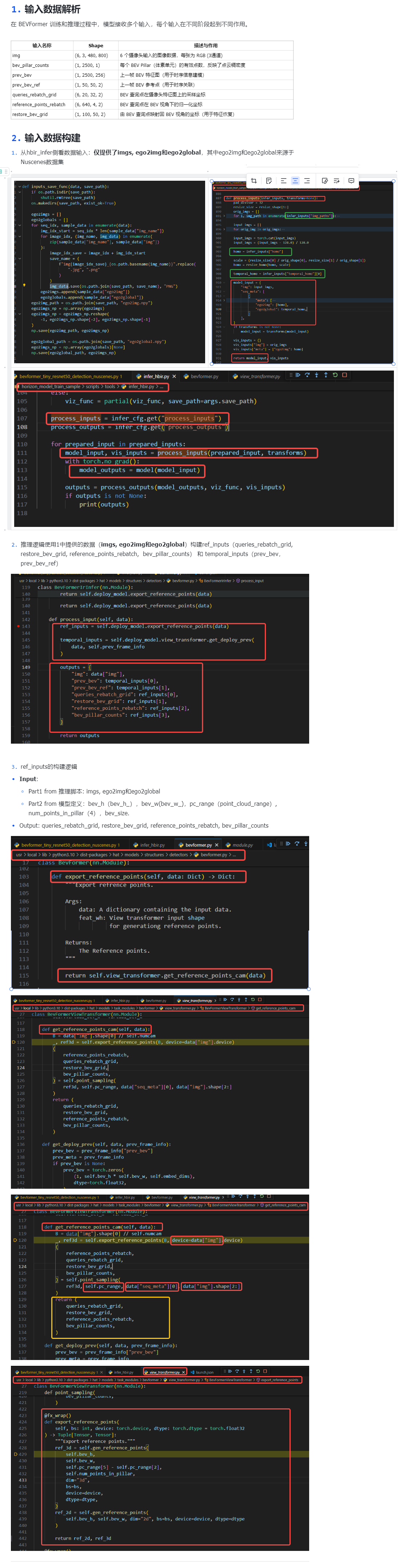

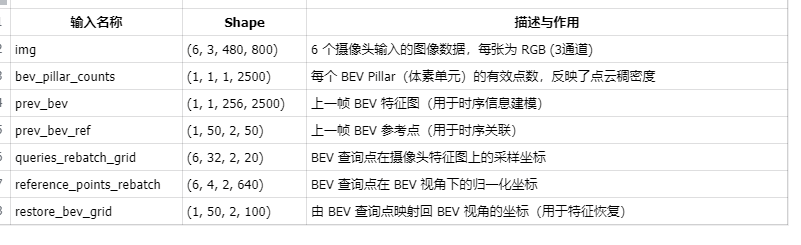

你好,对于问题2:7个输入数据来源信息从代码逻辑中了解到的信息如下:

1.用户需要提供的信息包括, 提供了imgs, ego2img,ego2global,bev_h,bev_w,point_cloud_range, num_points_in_pillar,bev_size。其中ego2img和ego2global来源于Nuscenes数据集,应该可以通过相机的内外参得到。 bev_h,bev_w,point_cloud_range, num_points_in_pillar,bev_size是模型定义是的参数。

2. 上述数据与7个输入的关系是输入img由 imgs 得到,其他参数是由 imgs, ego2img,ego2global 结合 模型定义参数计算得到,部署时除了 img 和pre_bev是动态的,其他的参数都是可以提前计算后存成二进制使用的。在示例中可以将推理DEMO计算出的数据导出。

计算过程截图如下供参考: