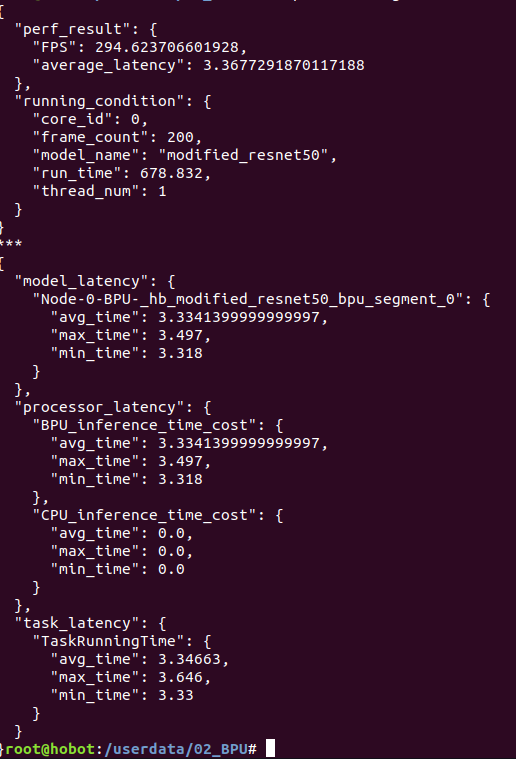

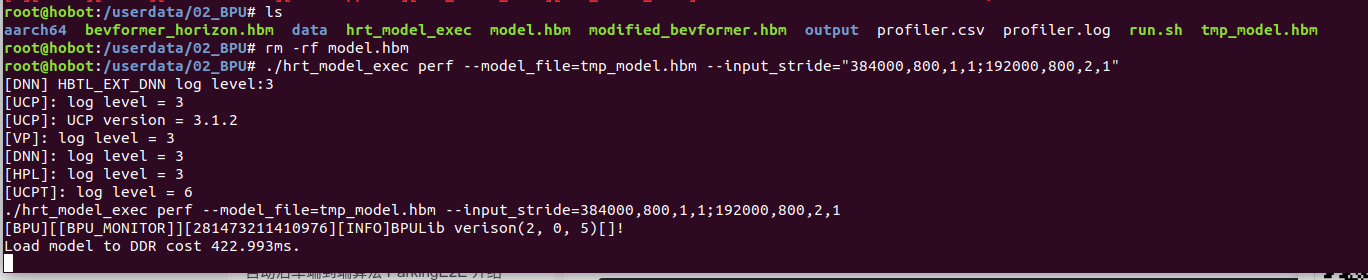

您好,我在PC端可以成功check我的模型,也能成功转为.hbm模型,但是移植到板端使用hrt_exec工具时,界面卡在Load model to DDR cost 422.993ms.不动,请问是什么原因。

附件在百度云:链接: https://pan.baidu.com/s/1enkrbPn-pnN-q3YDoEAysA 提取码: 6mn5

您好,我在PC端可以成功check我的模型,也能成功转为.hbm模型,但是移植到板端使用hrt_exec工具时,界面卡在Load model to DDR cost 422.993ms.不动,请问是什么原因。

附件在百度云:链接: https://pan.baidu.com/s/1enkrbPn-pnN-q3YDoEAysA 提取码: 6mn5

我发现我这里的输入是[6,3,480,800],如果输入是[1,3,480,800]就可以得到结果,请问是batchsize不能大于1吗?如果是的话那bevformer的6张图是怎么输入的?