你好,这边已经复现了你的问题,对了这个状况目前有两个考虑点:

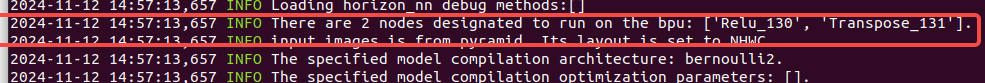

1. 不排除是工具链迭代中的bug,目前正在请求研发同事进行检查。

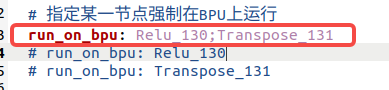

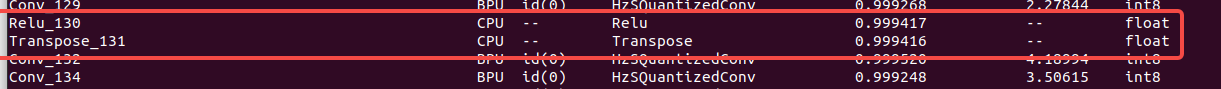

2. 这个模型附带有后处理逻辑(relu)本身就不太合理,建议将其从模型中移除,同时在yaml中通过配置项remove_node_type: 'Quantize;Transpose;Dequantize;Cast;Reshape;Softmax'将这些操作从模型转入后处理逻辑中。以下为移除后的板端耗时评估:

"processor_latency": {

"BPU_inference_time_cost": {

"avg_time": 67.95100500000001,

"max_time": 79.247,

"min_time": 65.126

},

"CPU_inference_time_cost": {

"avg_time": 0.012414999999999999,

"max_time": 0.046,

"min_time": 0.011

}

},

可以看出模型基本跑在BPU

另外,从之前的历史版本中的optimized.onnx你可以看出,模型尾部的conv输出为int8,而新的版本本着精度考虑模型尾部的conv输出已经是int32,从而保证了模型的精度,新版本尾部的conv输出转为int32后,使用手册4.1.1.10.3部分的信息应该可以解释目前的问题。