1. 芯片型号:J6

2. 板卡类型:地平线Matrix-6E

3. 天工开物开发包 OpenExplorer 版本:例如 J6_OE_3.0.22

4. 问题定位:模型转换

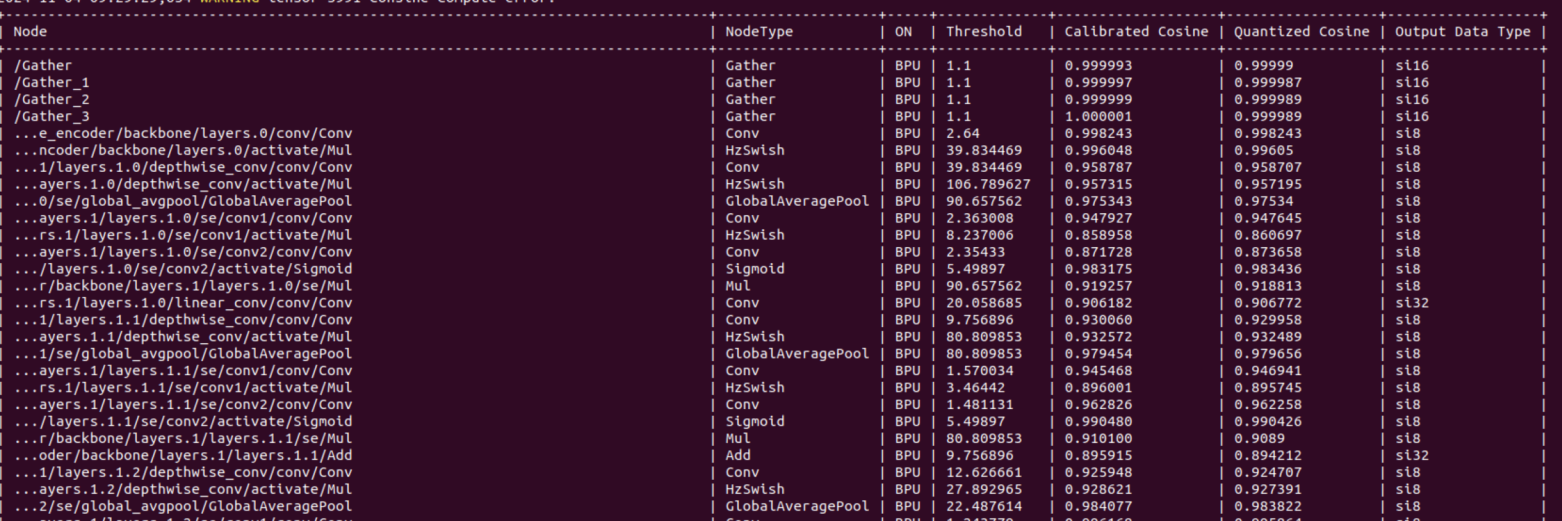

5. 问题具体描述:j6 ptq量化时打印的节点信息,中间部分算子输出数据类型为si32,如图,出现si32的原因是工具链自动判断si8量化精度不足而使用高精度量化吗?

j5上默认都是int8数据类型的,可以手动指定int16量化,int32运算是j6 bpu新增的支持项吗?

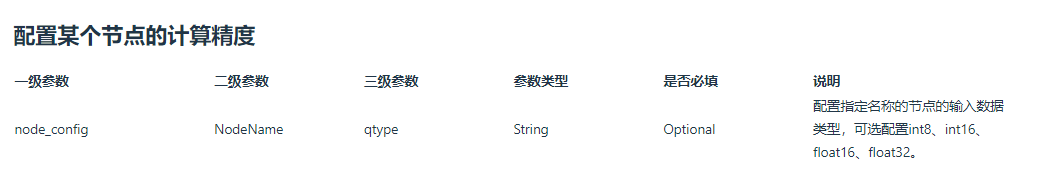

在j6文档中看到可以在量化配置:quant_config中配置:

这个配置的是节点输入数据类型,不包括int32。输入数据类型、输出数据类型、计算的数据精度这三项怎么理解呢?

int16 int32 fp16 fp32都是bpu支持的计算精度吗?