官方提供的分类samples中horizon_model_convert_sample的01_mobilenet进行模型推理的前处理和horizon_runtime_sample生成板子上运行的可执行文件的前处理不一致。

1. 芯片型号:j3

2. 天工开物开发包 OpenExplorer 版本:例如 J3_OE_1.16.4 等

3. 问题定位:模型转换、板端部署

4.在horizon_model_convert_sample文件03_build.sh中模型的推理前处理是transformers = [

ShortSideResizeTransformer(short_size=256),

CenterCropTransformer(crop_size=224),

RGB2BGRTransformer(data_format="HWC"),

ScaleTransformer(scale_value=255),

BGR2NV12Transformer(data_format="HWC"),

NV12ToYUV444Transformer((224, 224),

yuv444_output_layout=input_layout[1:]),

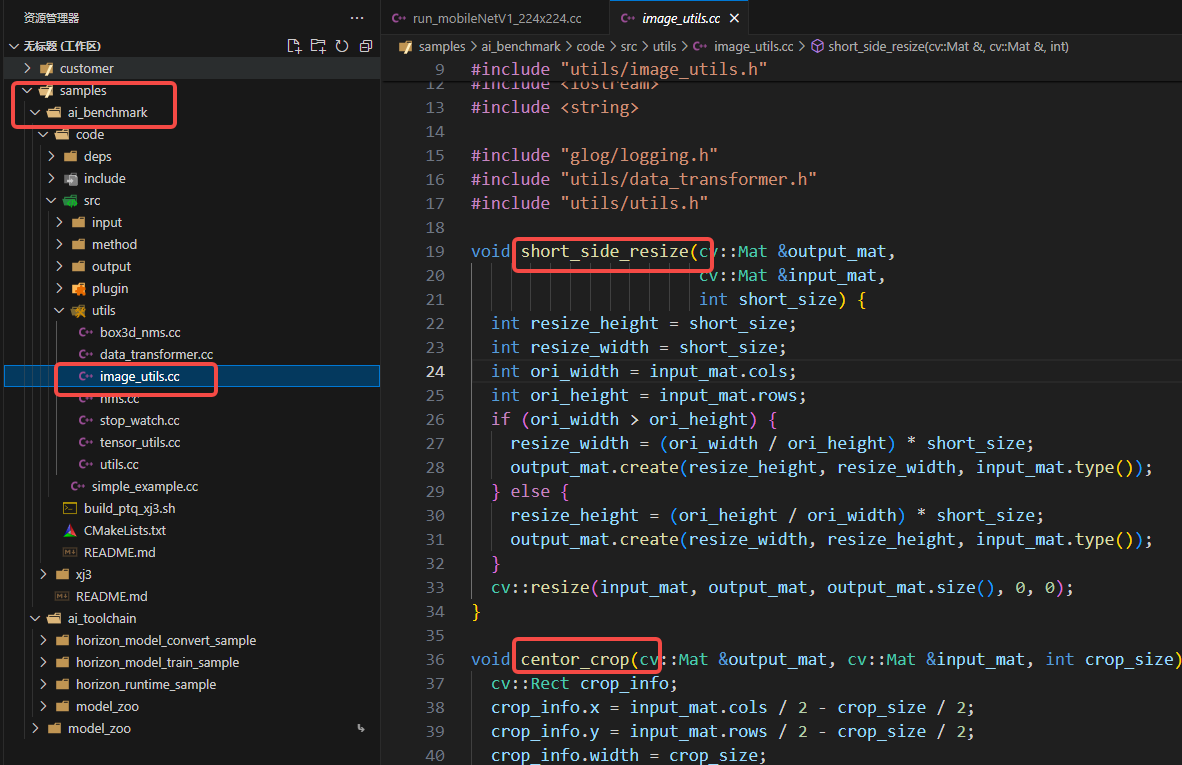

]但是在horizon_runtime_sample提供的样例,函数read_image_2_tensor_as_nv12中,只对图像进行resize到224*224,省去了 ShortSideResizeTransformer和CenterCropTransformer的步骤,虽然在j3上进行测试没什么问题,置信度后3位对的上,但是从理论上是不是应该加 ShortSideResizeTransformer和CenterCropTransformer,有没有大佬可以解答下,谢谢大佬们。