您好~Thanks♪(・ω・)ノ

1. 芯片型号:J6E

2. 天工开物开发包 OpenExplorer 版本:V3.0.22

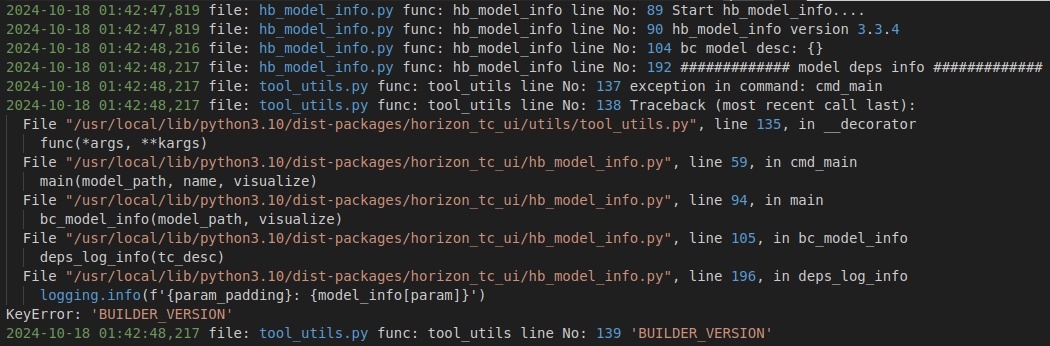

3. 问题定位:模型转换

4. 问题具体描述:PTQ量化后得到的模型,使用hb_model_info查看模型信息时存在以下报错。

注:量化编译前的模型是通过沿batch维度拆分后得到的bc模型。

编译后得到的模型见附件中的sparse_256x704_nv12_quantized_removed_model.bc

您好~Thanks♪(・ω・)ノ

1. 芯片型号:J6E

2. 天工开物开发包 OpenExplorer 版本:V3.0.22

3. 问题定位:模型转换

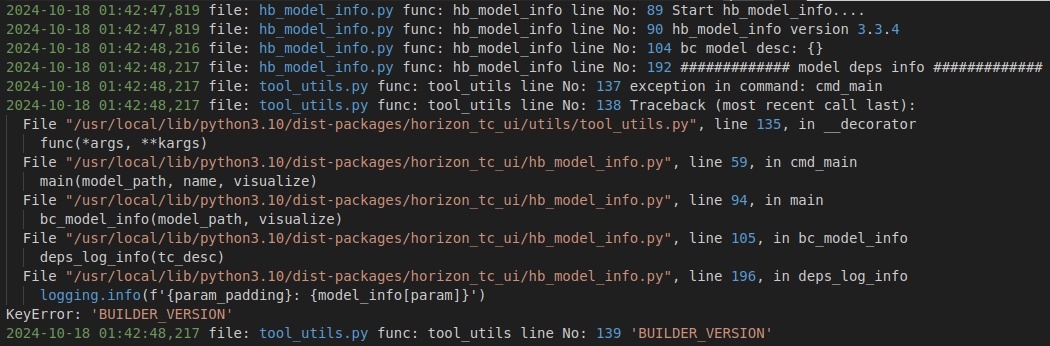

4. 问题具体描述:PTQ量化后得到的模型,使用hb_model_info查看模型信息时存在以下报错。

注:量化编译前的模型是通过沿batch维度拆分后得到的bc模型。

编译后得到的模型见附件中的sparse_256x704_nv12_quantized_removed_model.bc

在docker里面量化编译,是没有问题的吧,有没有异常?

感谢回复!查看您提供的编译过程日志发现存在以下问题没有对齐:

另外还有一个问题请教一下:

原模型沿batch维度拆分后由原来的4个输入现在变成了15个输入,在后面量化编译时,yaml文件中的为什么不需要配置成15个输入而保持为原来的4个输入进行量化编译?