您好,~Thanks♪(・ω・)ノ

1. 芯片型号:J6E

2. 天工开物开发包 OpenExplorer 版本:V3.0.22

3. 问题定位:模型转换

4. 问题具体描述:

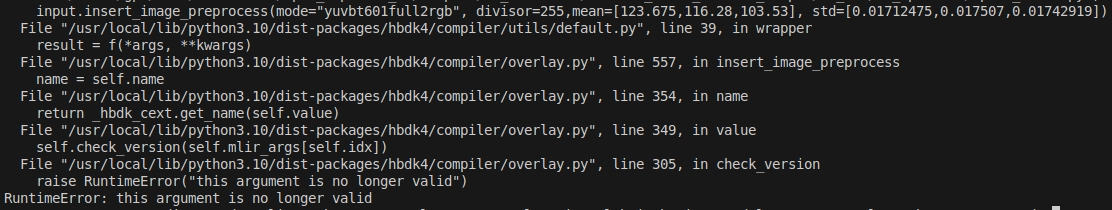

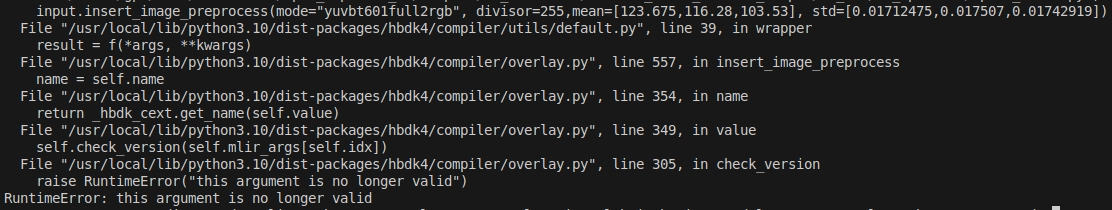

使用以下代码在对模型输入沿batch维度拆分时出现以下报错:

相关*_ptq_model.onnx模型及配置文件已放入如下网盘中, 链接: https://pan.baidu.com/s/1pW44m0Bg0qxHR7-pErRHXg?pwd=1234 提取码: 1234

您好,~Thanks♪(・ω・)ノ

1. 芯片型号:J6E

2. 天工开物开发包 OpenExplorer 版本:V3.0.22

3. 问题定位:模型转换

4. 问题具体描述:

使用以下代码在对模型输入沿batch维度拆分时出现以下报错:

相关*_ptq_model.onnx模型及配置文件已放入如下网盘中, 链接: https://pan.baidu.com/s/1pW44m0Bg0qxHR7-pErRHXg?pwd=1234 提取码: 1234