您好,问题如下,~Thanks♪(・ω・)ノ

1. 芯片型号:j6e

2.计算平台: x86仿真环境

2. 天工开物开发包 OpenExplorer 版本:v3.0.22

3. 问题定位:模型推理

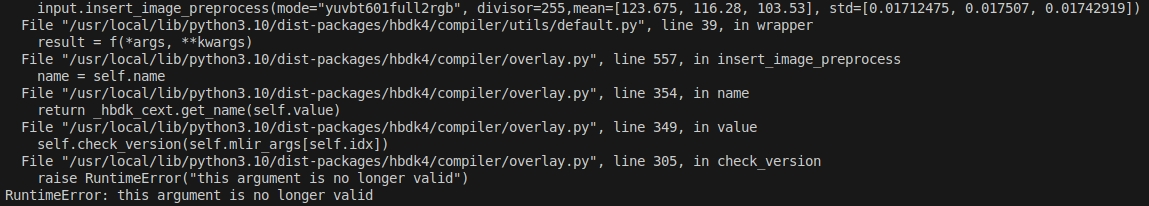

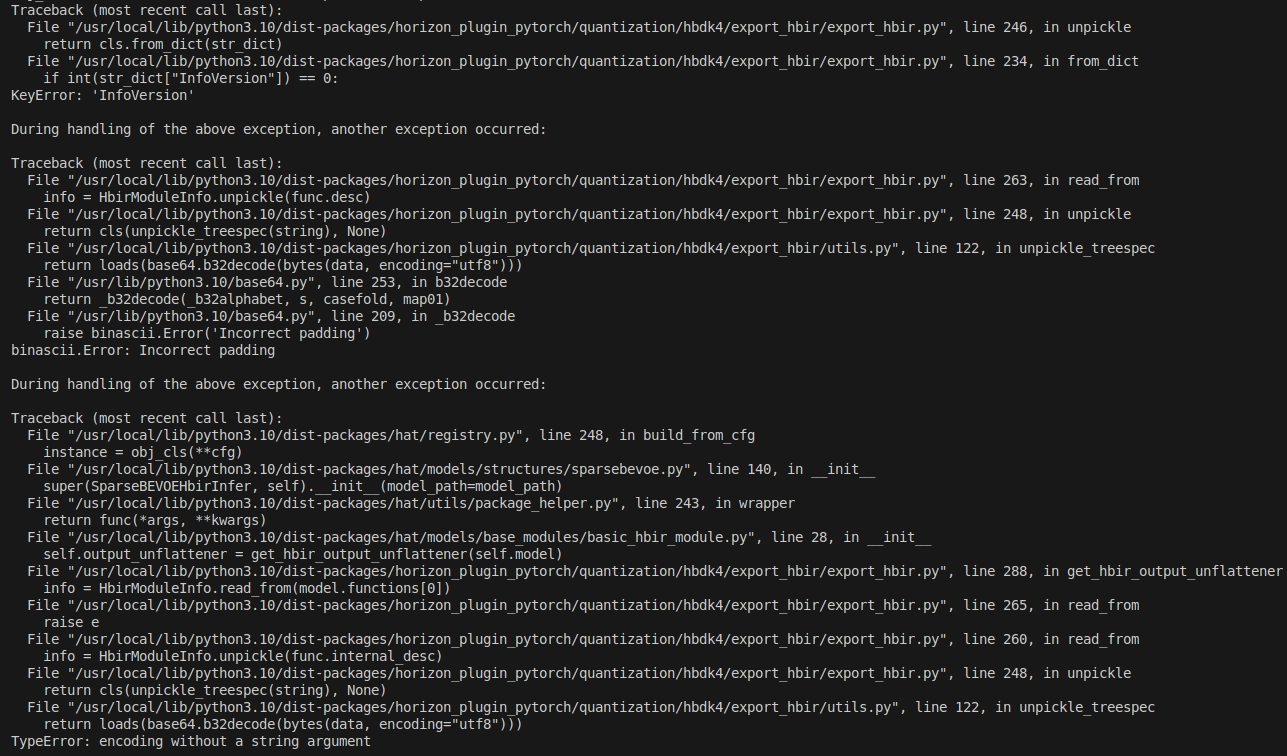

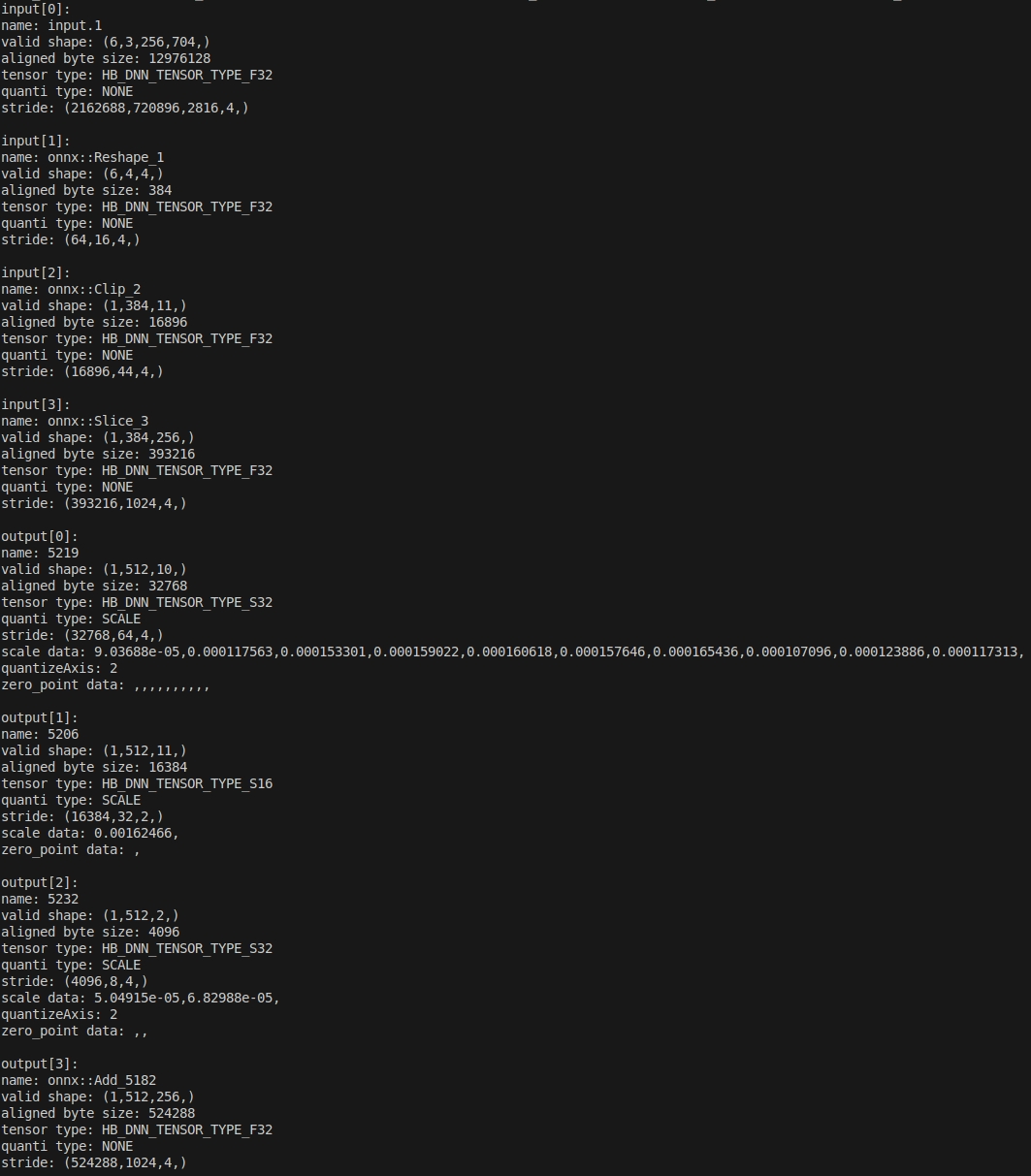

转换结束后成功后生成hbm模型。使用hrt_model_exec工具查看model_info有如下结果:

目前存在两个问题需要请教一下:

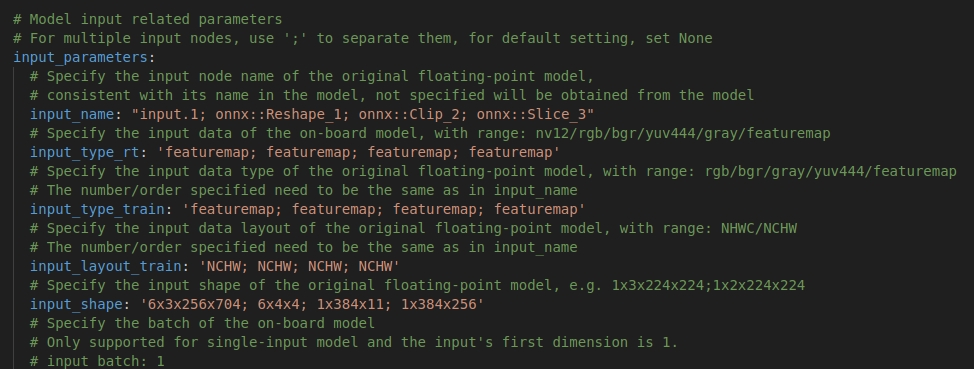

在X86仿真环境中基于C++对hbm模型进行推理时,input.1的格式要求是featuremap,请问在设置这个输入时是否可以直接使用一个简单的卷积网络将6张图片转换为6x3*256*704的featuremap,还是有其他特殊操作?

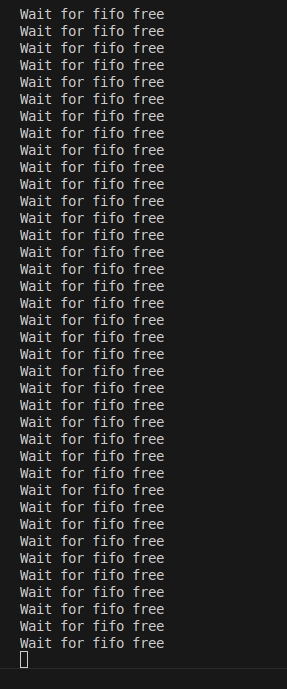

- 工作目录:samples/ucp_tutorial/dnn/sparse4d/code/00_quick_start,依据modelinfo提供的四个输入,按照维度设置简单输入,执行运行脚本后,一直出现以下log,可以成功推理但推理时间很长,请问导致以上问题出现的原因可以从哪些方面排查?