在python的preprocess是:

在C++里应该是在tensor_utils.cc里,image_data_type== HB_DNN_IMG_TYPE_NV12:

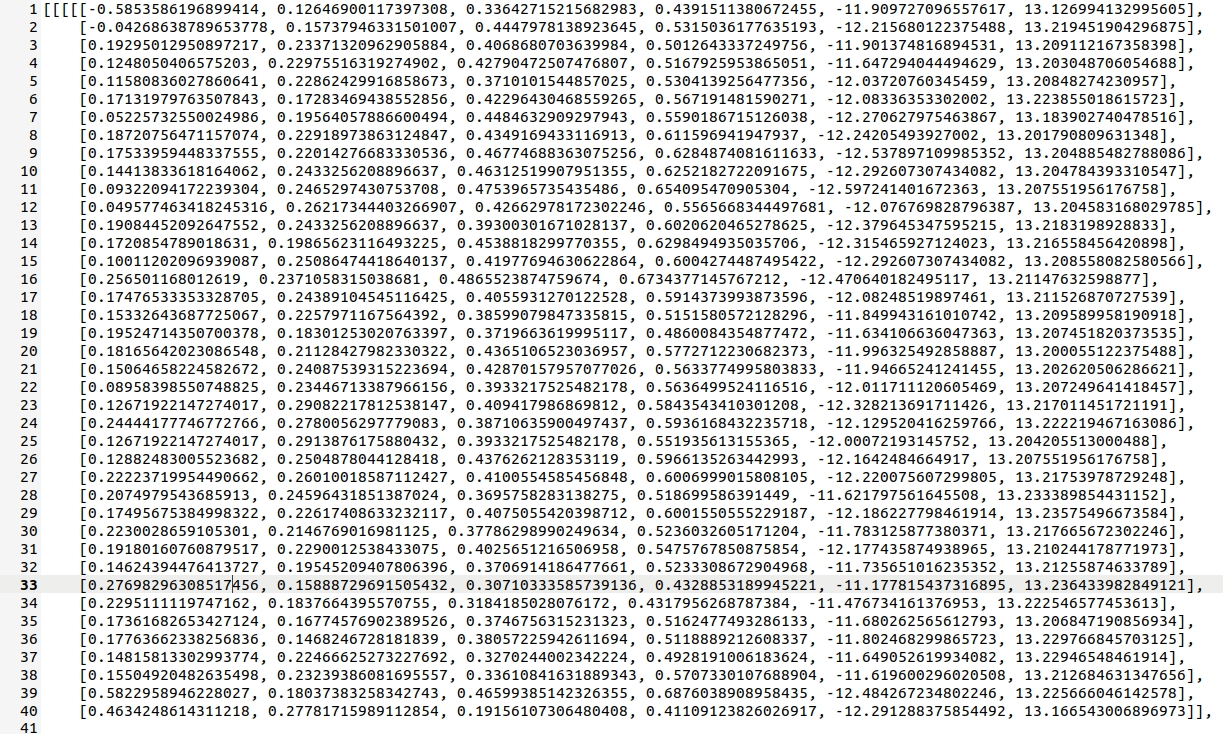

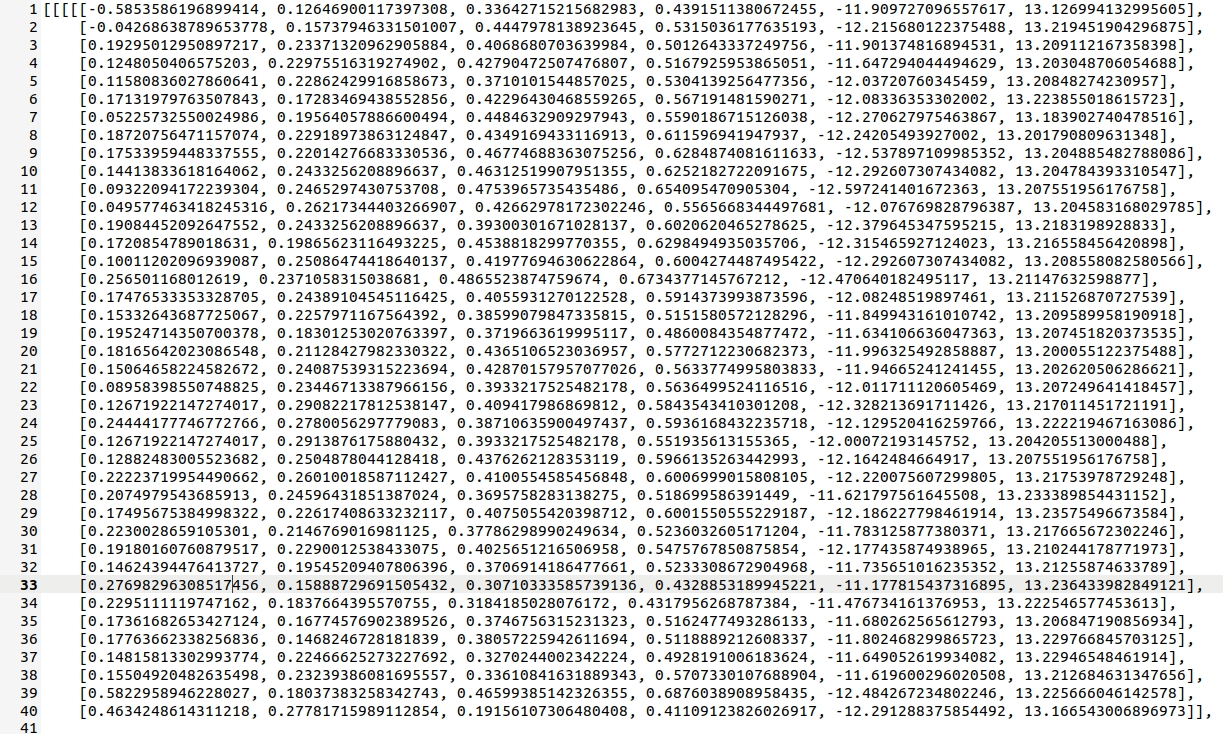

x86端保存结果和bin模型输出不一致:

在这里存的output。

x86:

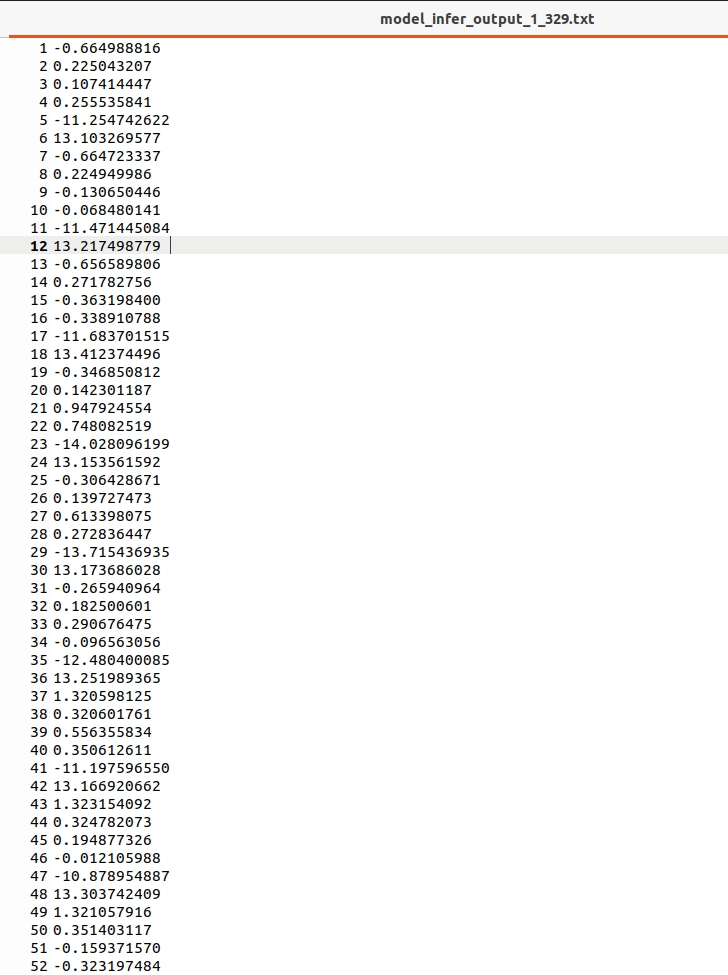

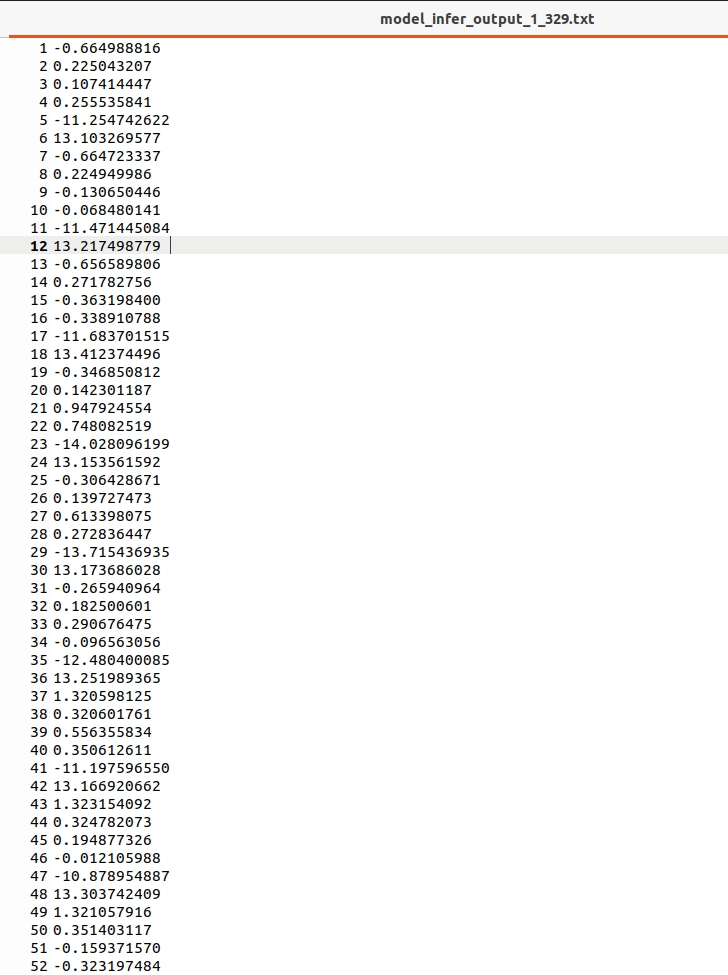

板端:

目前用的模型是yolov5s,类别为一类,

上传了演示图片和onnx和bin模型。有大佬可以看看问题吗

在python的preprocess是:

在C++里应该是在tensor_utils.cc里,image_data_type== HB_DNN_IMG_TYPE_NV12:

x86端保存结果和bin模型输出不一致:

在这里存的output。

x86:

板端:

目前用的模型是yolov5s,类别为一类,

上传了演示图片和onnx和bin模型。有大佬可以看看问题吗