J5 J5_OE_1.1.74

我们尝试跳过验证模型评价指标的阶段,先试着将模型编译出来烧录上板,出现了以下错误:

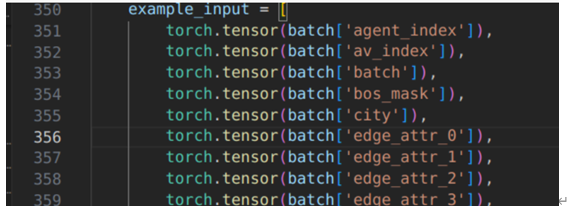

模型检查报错dict里面没有is_floating_point关键字(quantized_model是前面转换后的定点模型,example_input是我们自己定义的tensor列表。)

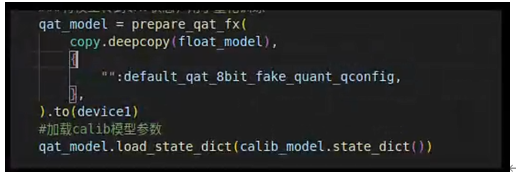

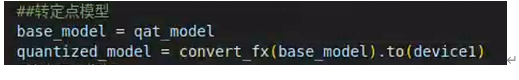

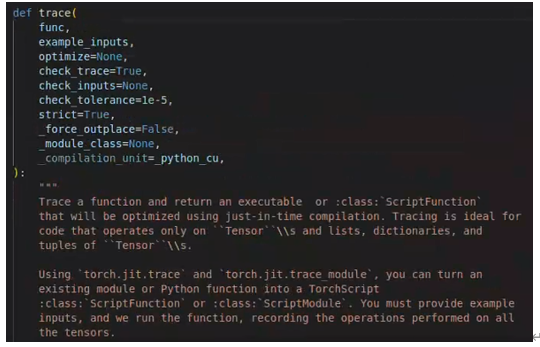

我们对quantized_model的生成,及torch.jit.trace函数进行了查看:

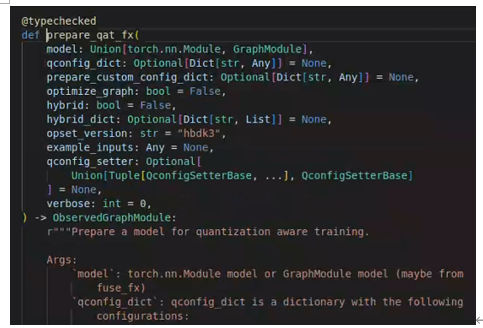

这里接受的model是要进行量化感知训练的模型。它可以是一个常规的 PyTorch torch.nn.Module 模型,也可以是 torch.fx.GraphModule 模型(通常通过 torch.fx 进行图级别的操作后得到的模型)。

trace函数是 PyTorch 中用于将一个函数或 nn.Module 模块转化为 TorchScript 的工具,通过记录张量操作生成可执行的 ScriptFunction 或 ScriptModule该函数适合用于只处理张量(Tensor)以及张量列表、字典或元组的代码,但是这里每种数据格式我们都进行了尝试,无法解决。

所以想要请教一下,这边是不是我们的qat_model或者是quantized_model的生成出现了问题,如果我们不使用Torch.nn.module中的基础模块去构建我们自己的深度模型的话,这里的prepare_qat_fx函数该如何使用?或者是有没有其他的替代函数?您这边是否可以给出相关示例?