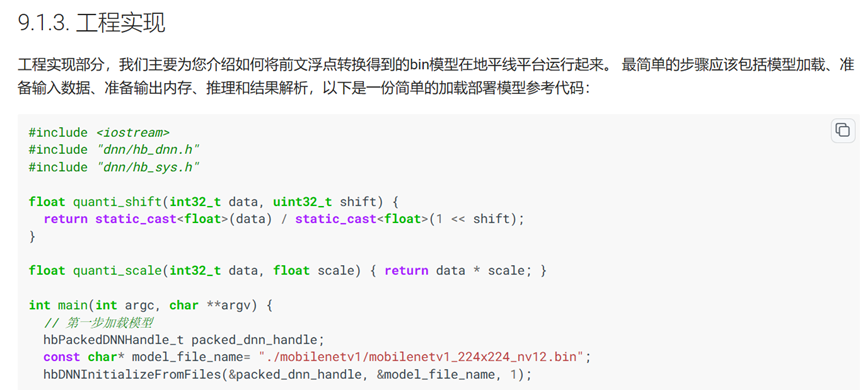

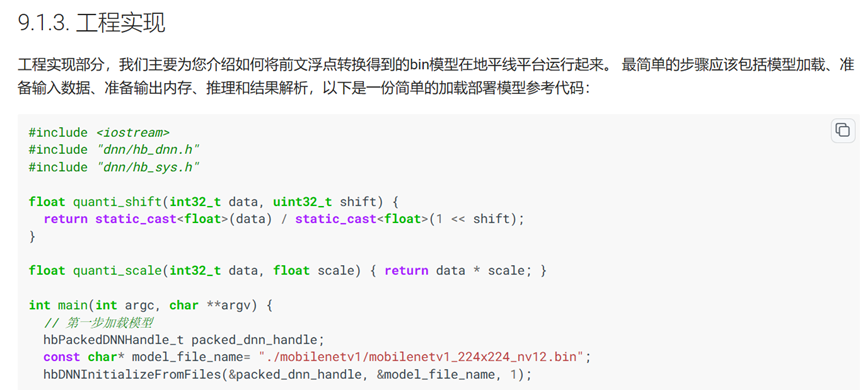

J5 J5_OE_1.1.74 请问使用算法工具链将模型量化后,模型从fp32变成了int8,(上板部署)还可以使用原模型test里面加载模型的方式加载模型进行推理吗?还是只能用算法工具链里面9.1.3这种加载方式,或者有其他加载量化后模型(.hbm文件)的方法吗?

J5 J5_OE_1.1.74 请问使用算法工具链将模型量化后,模型从fp32变成了int8,(上板部署)还可以使用原模型test里面加载模型的方式加载模型进行推理吗?还是只能用算法工具链里面9.1.3这种加载方式,或者有其他加载量化后模型(.hbm文件)的方法吗?