问题如下,感谢解答 ~Thanks♪(・ω・)ノ

1. 芯片型号:J6E

2. 天工开物开发包 OpenExplorer 版本:V3.0.17

3. 问题定位:模型推理

4. 问题具体描述:

PTQ 量化转换得到的 hbm模型 存在多输入多输出(7个输入,6个输出)

7个输入依次为input.1_y、input.1_uv、 projection_mat、cached_anchor、cached_feature、cached_confidence、mask;

6个输出分别为classification、prediction、quality、cached_anchor、cached_feature、cached_confidence。

已使用hrt_model_exec验证hbm模型可以正常推理。

当前为验证算法跑通,前两个输入input.1_y和input.1_uv由6张图片转nv12生成,其它五个输入按照维度及数据类型给的随机值。

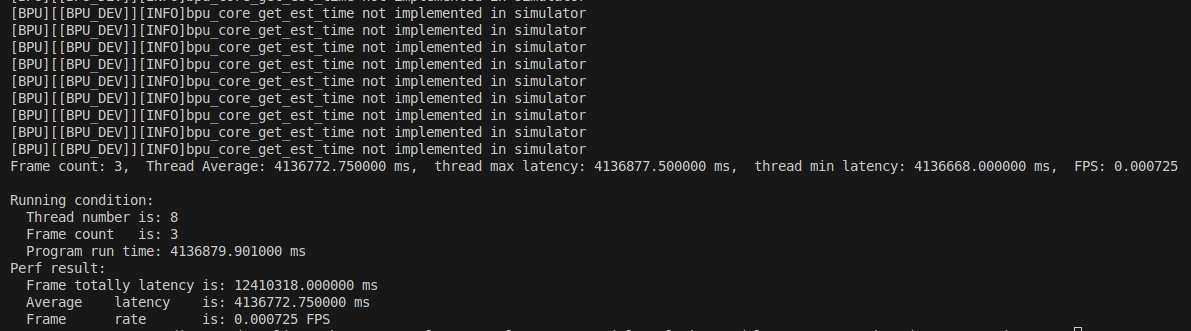

在执行命令:sh ./samples/ucp_tutorial/dnn/sparse4D/runtime/script_x86/00_quick_start/run_sparse4d.sh后报如下错误: