关于YOLOV5模型部署的一些问题:

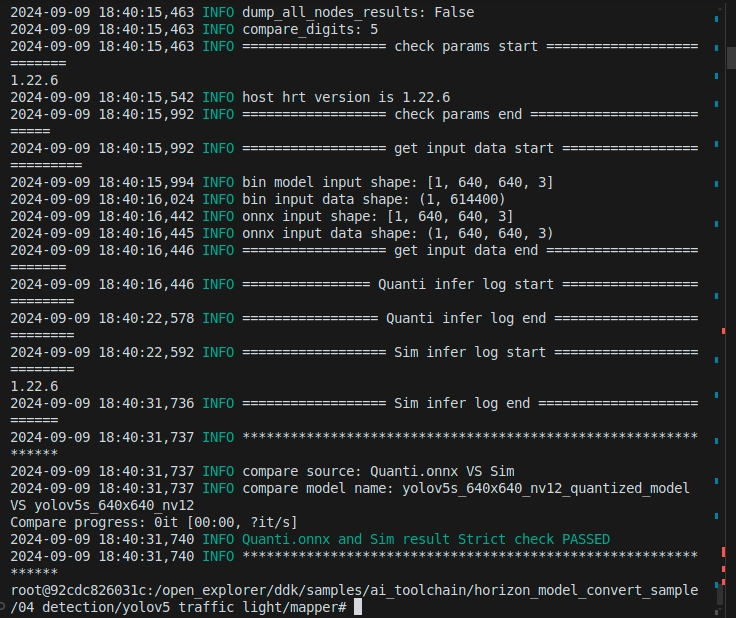

通过OE中提供的转换示例,已经训练好的YOLOv5模型转到.bin;

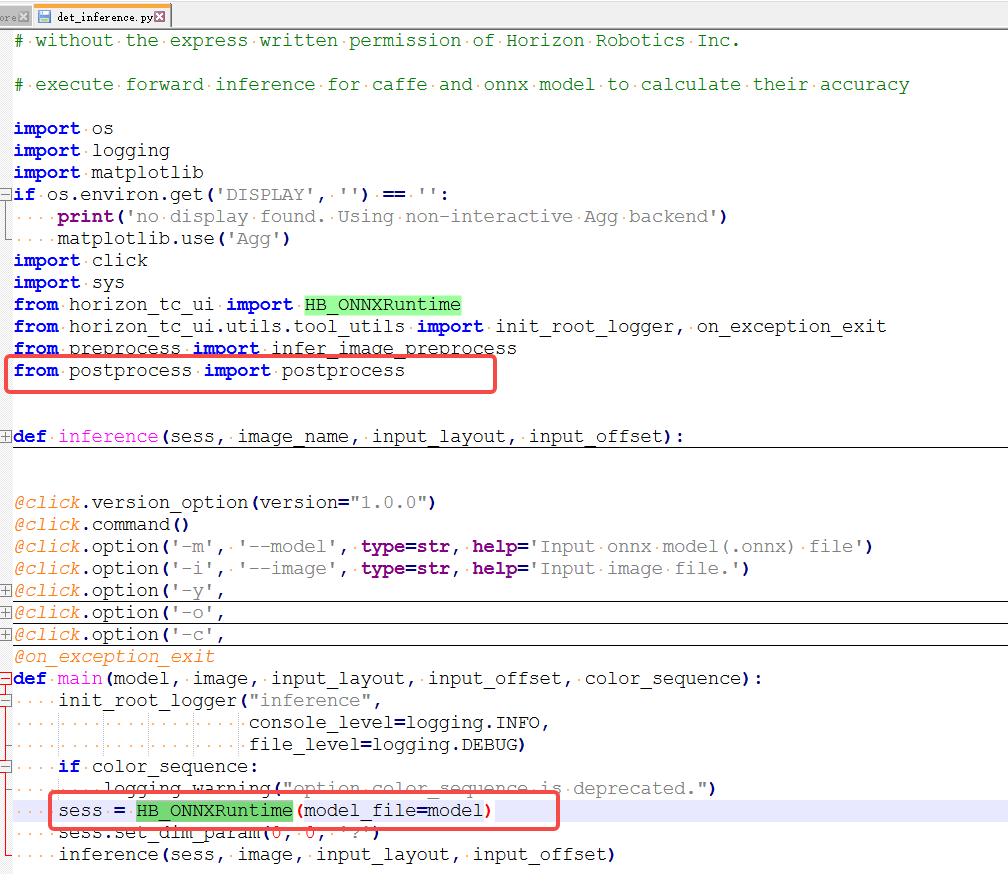

通过ai_benchmark中提供的示例,尝试在板端推理该模型,出现了一些问题:

原本的ptq_yolov5x的模型输出tensors.size()=3,且shape=(1,84,84,255),(1,42,42,255),(1,21,21,255), 但是自定义的yolov5模型输出size=4,shape分别为(1,25200,6,1),(1,3,80,80,6),(1,3,40,40,6),(1,3,20,20,6),这与python版本的输出是一致的。

在后处理中尝试直接根据shape解析输出结果,对于&tensors[0]:

更新:发现tensors[0]的quanti_type = 0,也就是说应该是不需要反量化的,但这样的话直接看tensors[0]的数值又不对了: