用户您好,请详细描述您所遇到的问题,详细的描述有助于帮助我们快速定位,解决问题~Thanks♪(・ω・)ノ

1. 芯片型号:J6

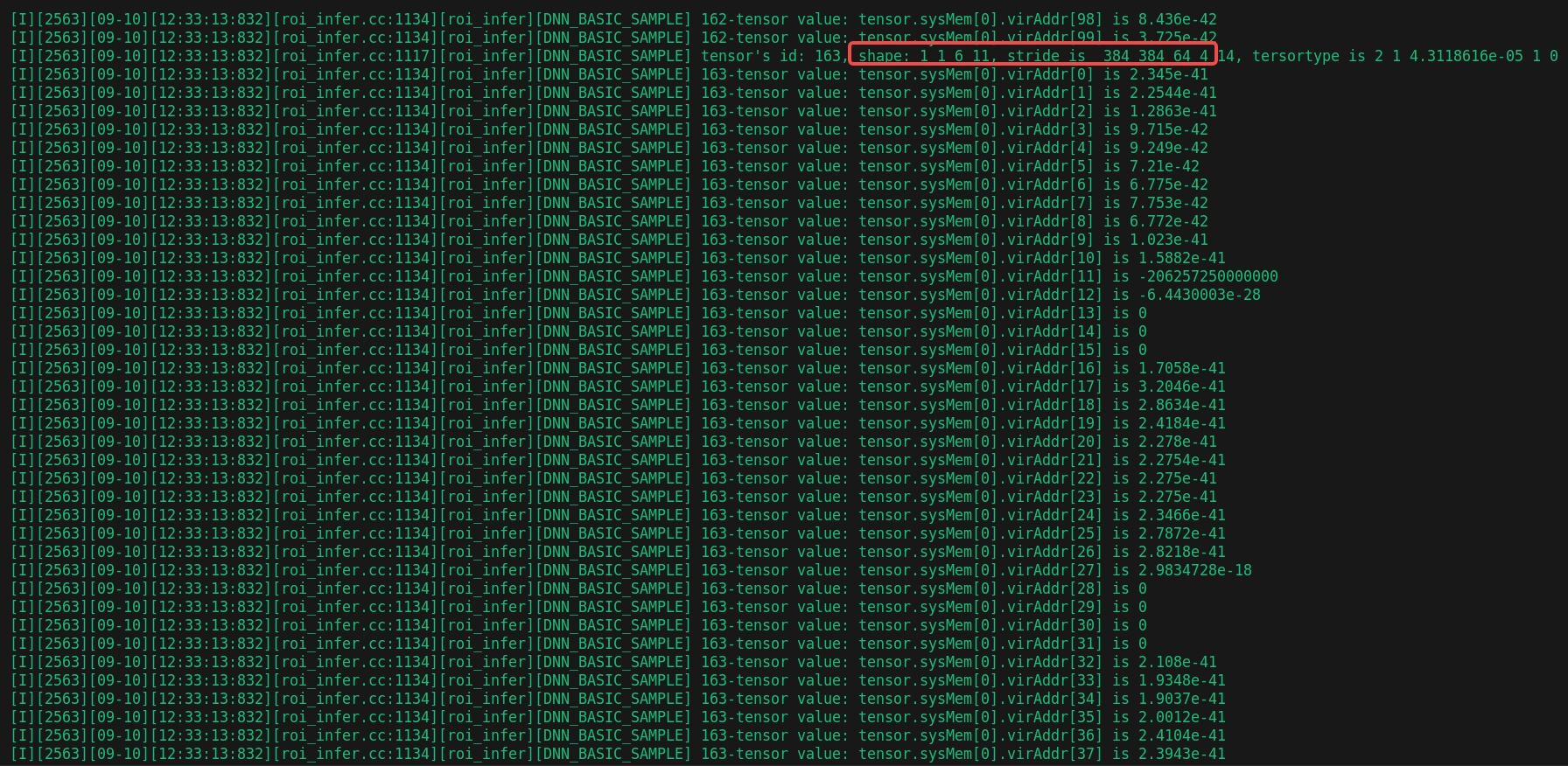

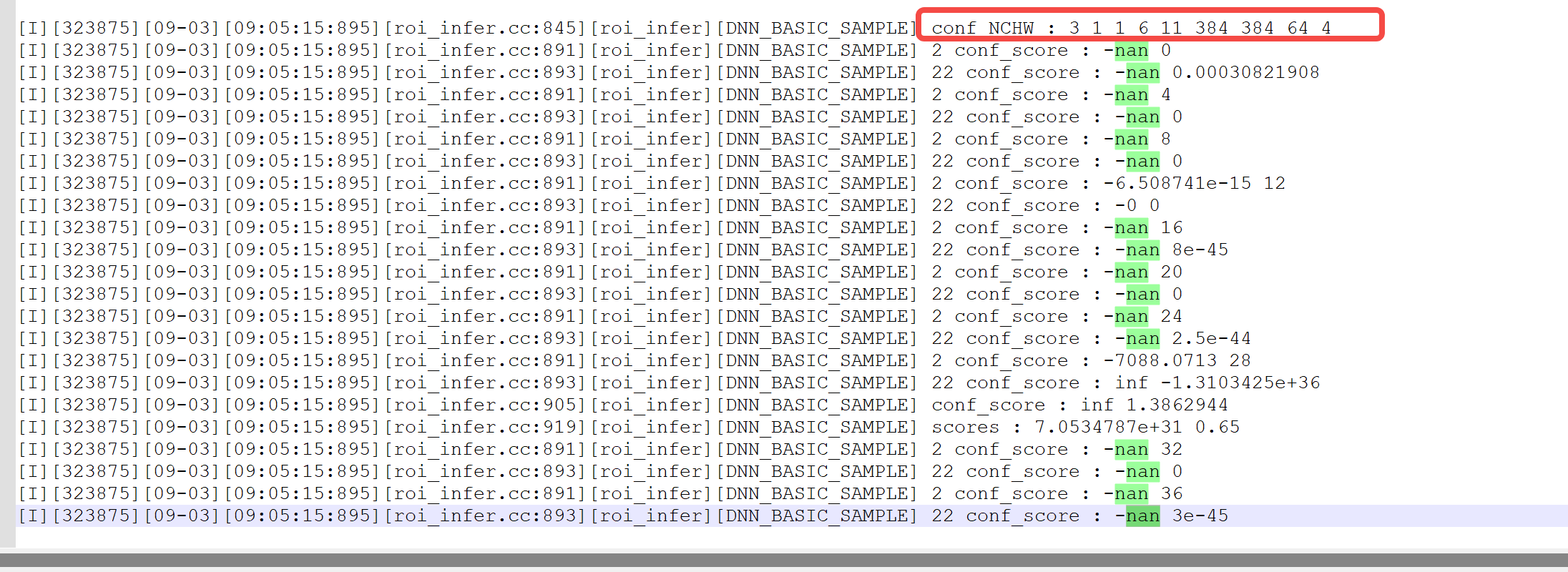

3. 问题定位:hbm推理结果置信度低

5. 问题:

5.1 hbm和bc模型的推理结果差异会很大吗?如何确定是由于hbm掉点导致的推理无结果?

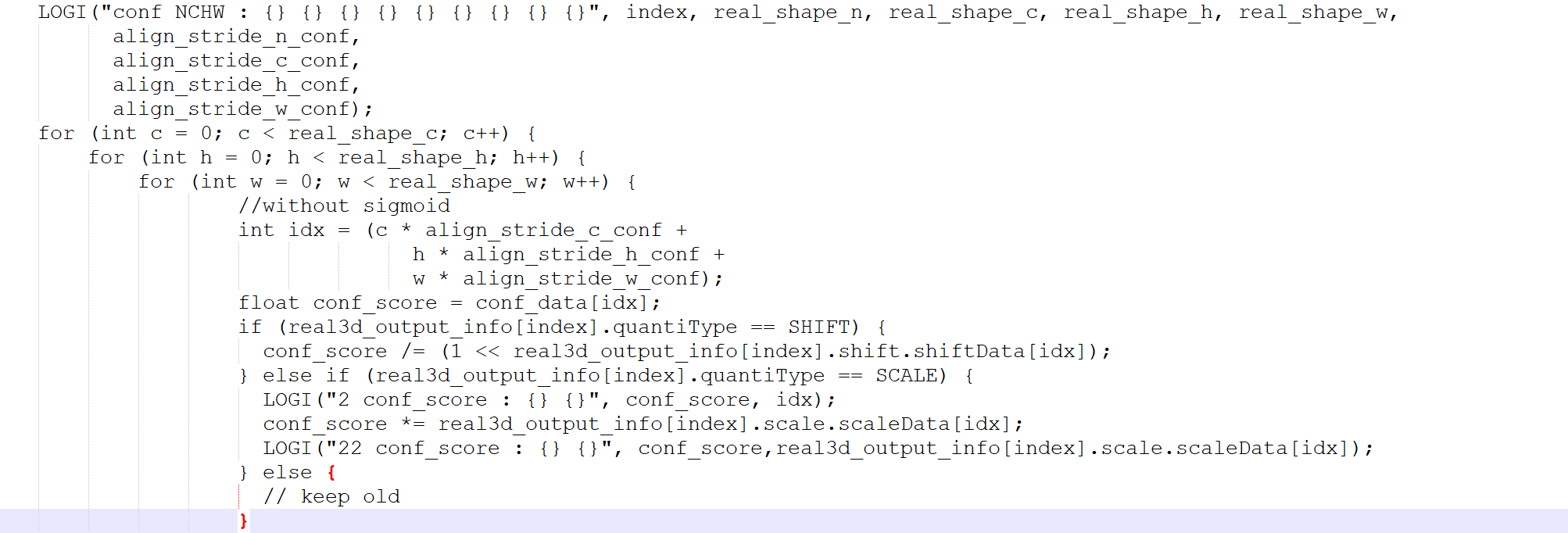

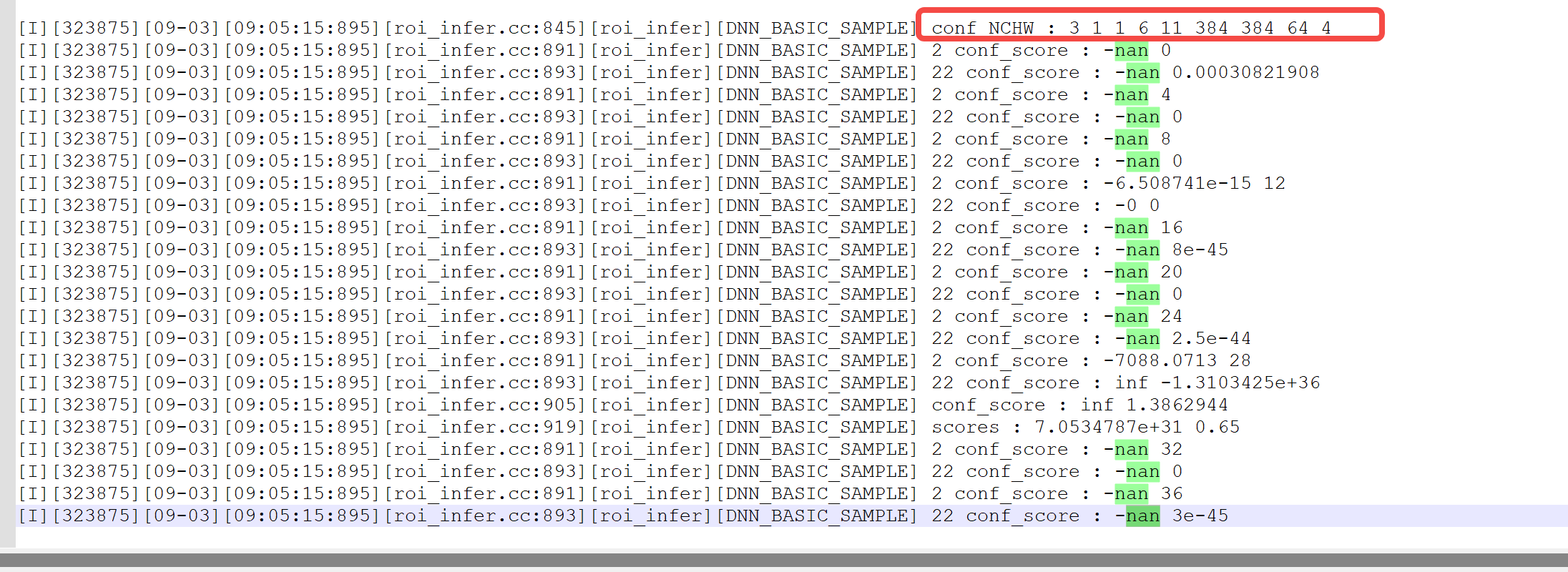

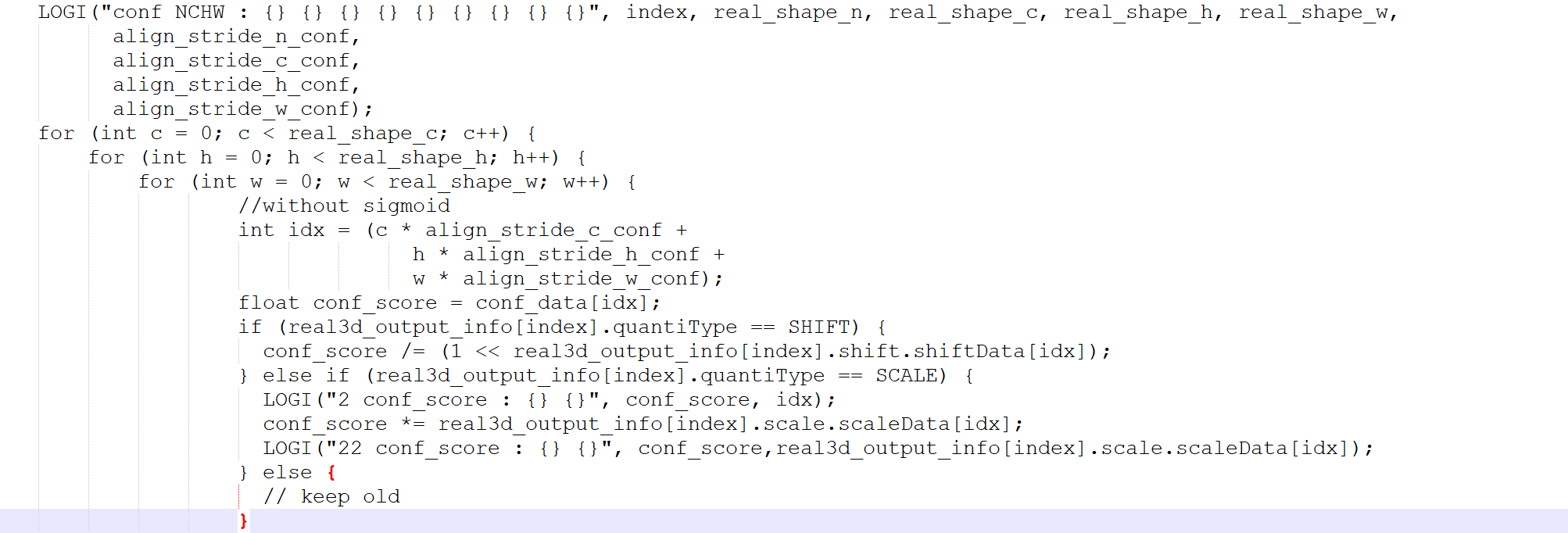

是否是模型推理结果的取值错误导致的?以下是模型后处理的代码,有几个疑问:

5.3 quantiType的类型是SCALE,但是我看示例中只做了*scaleData的操作,理论上是不是还需要进行-zeroPointData?

用户您好,请详细描述您所遇到的问题,详细的描述有助于帮助我们快速定位,解决问题~Thanks♪(・ω・)ノ

1. 芯片型号:J6

3. 问题定位:hbm推理结果置信度低

5. 问题:

5.1 hbm和bc模型的推理结果差异会很大吗?如何确定是由于hbm掉点导致的推理无结果?

是否是模型推理结果的取值错误导致的?以下是模型后处理的代码,有几个疑问:

5.3 quantiType的类型是SCALE,但是我看示例中只做了*scaleData的操作,理论上是不是还需要进行-zeroPointData?

5.1 hbm和bc模型的推理结果差异会很大吗?如何确定是由于hbm掉点导致的推理无结果?

单独推理bc模型和浮点对比,若bc模的结果已经出现误差则export或者convert阶段就有异常了。建议检查export前后和convert前后的bc模型推理是否正常。

是否是模型推理结果的取值错误导致的?以下是模型后处理的代码,有几个疑问:

stride可以简单理解为,某个维度的数,代表输出 shape 对应维度的值 +1 时,在内存上需要跳过的字节大小

表明 shape 的最后一维 padding 了 36 个字节大小

表明其他维度均不存在 padding

在编写 remove padding 代码时,仅需将最后一维下标 28~63 的值略去即可

5.3 quantiType的类型是SCALE,但是我看示例中只做了*scaleData的操作,理论上是不是还需要进行-zeroPointData?

zeroPoint是0,为对称量化

您好,

5.1 目前是bc模型推理没问题,但是hbm推理结果异常;且log显示两者同一tensor差异很大?这个是什么原因呢,有什么工具可以继续排查呢?