用户您好,请详细描述您所遇到的问题,详细的描述有助于帮助我们快速定位,解决问题~Thanks♪(・ω・)ノ

1. 芯片型号:J5

2. 天工开物开发包 OpenExplorer 版本: J5_OE_1.1.74

3. 问题定位:模型转换

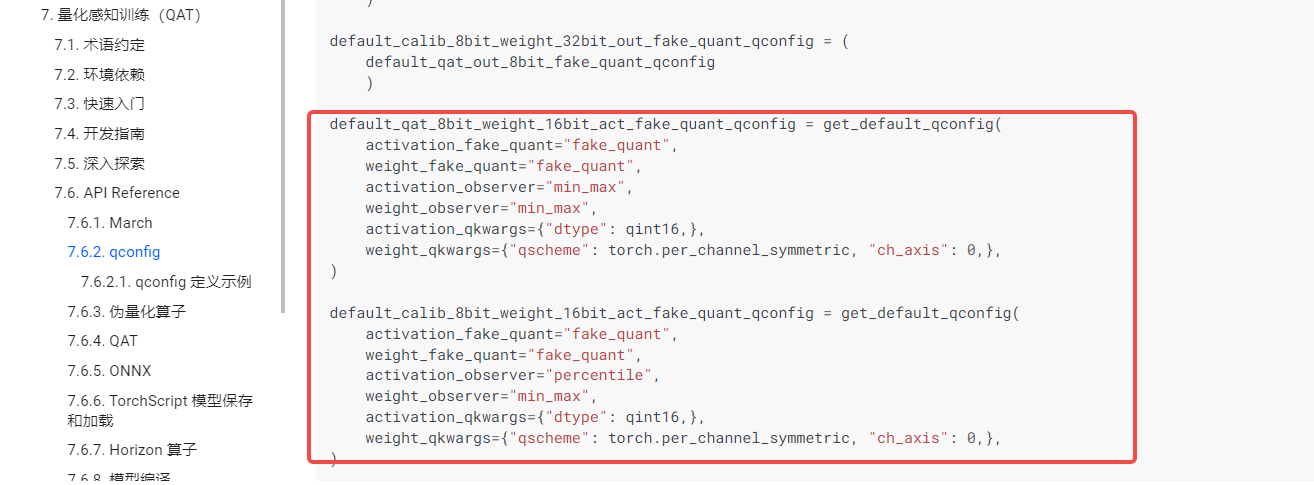

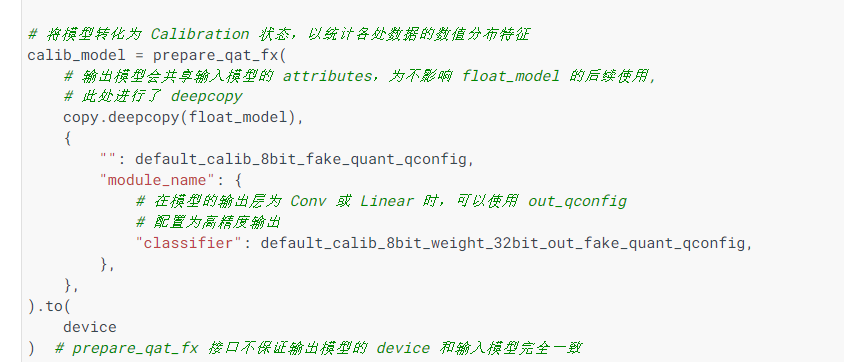

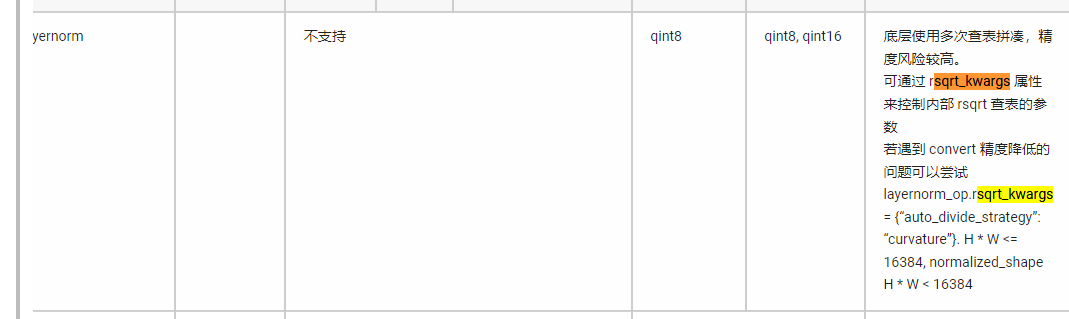

4. 问题具体描述:您好,请问模型量化损失,通过精度debug已经定位到是softmax,layernorm中敏感算子引起,量化有损失,qat收益也不太大,有什么办法降低量化损失吗。

用的是论坛公开的petr模型,换自己小批量数据训练后浮点与量化后结果比较一致。但用了全量数据训练后量化精度损失比较大。