J5 J5_OE_1.1.74

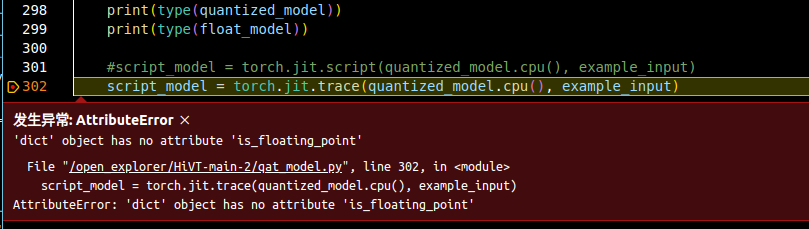

我们在根据算法工具链量化模型,模型部署部分的第一步,模型检查部分,我们已经将模型的传入参数变成了tensor,但是在torch.jit.trace报错,报错如下:

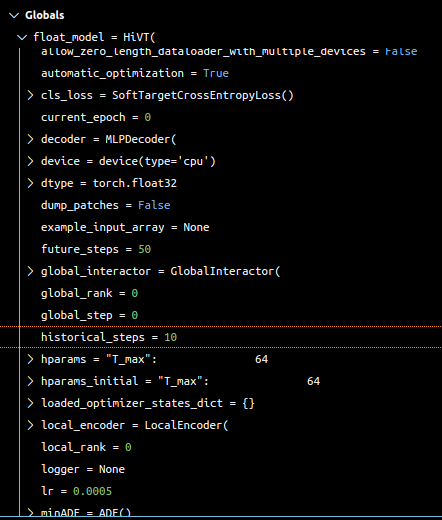

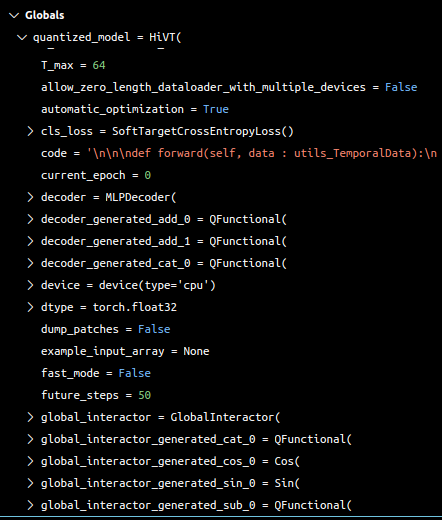

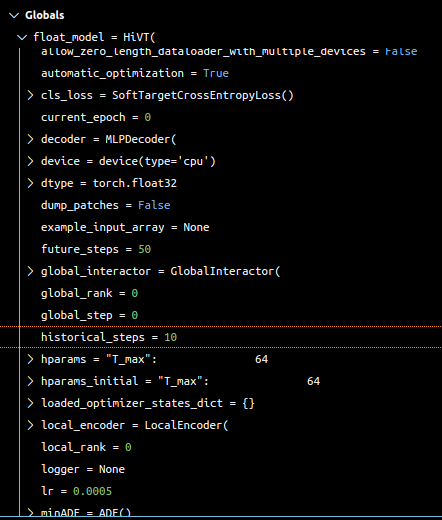

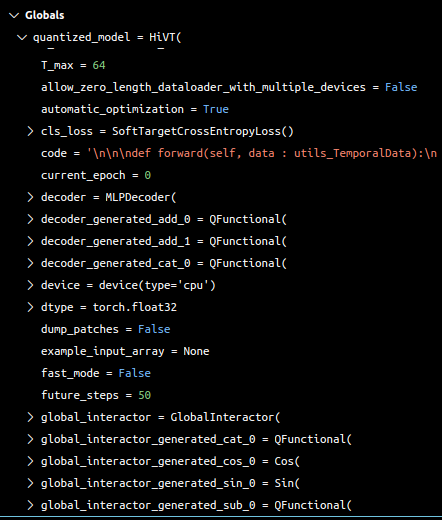

我们也打印了float_model和quantized_model,发现quantized_model比float_model多了许多QFunctional,

float_model:

quantized_model:

1、这是由于使用了包装函数的原因吗?

2、请问这个报错该如何解决呢?

J5 J5_OE_1.1.74

我们在根据算法工具链量化模型,模型部署部分的第一步,模型检查部分,我们已经将模型的传入参数变成了tensor,但是在torch.jit.trace报错,报错如下:

我们也打印了float_model和quantized_model,发现quantized_model比float_model多了许多QFunctional,

float_model:

quantized_model:

1、这是由于使用了包装函数的原因吗?

2、请问这个报错该如何解决呢?