J5 J5_OE_1.1.74

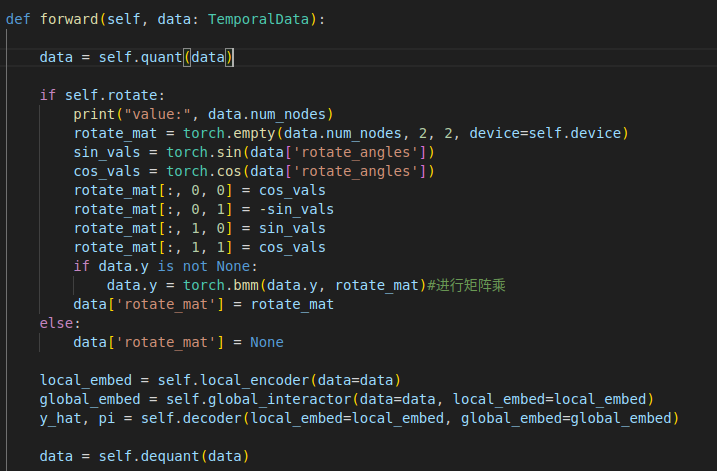

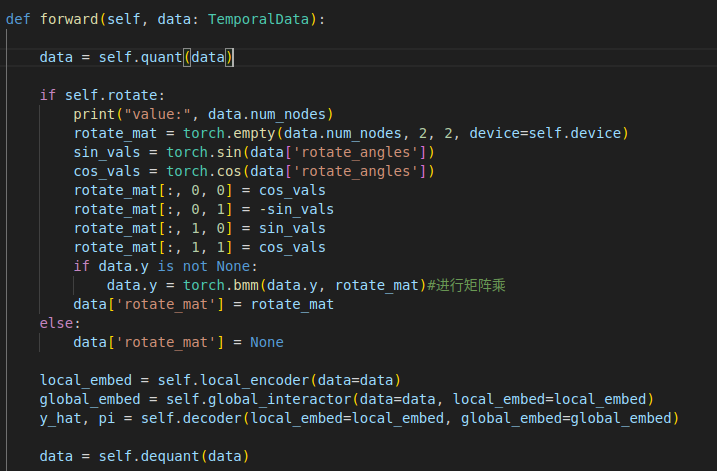

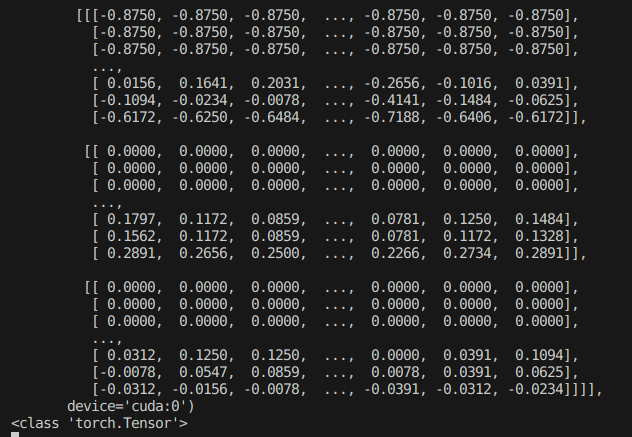

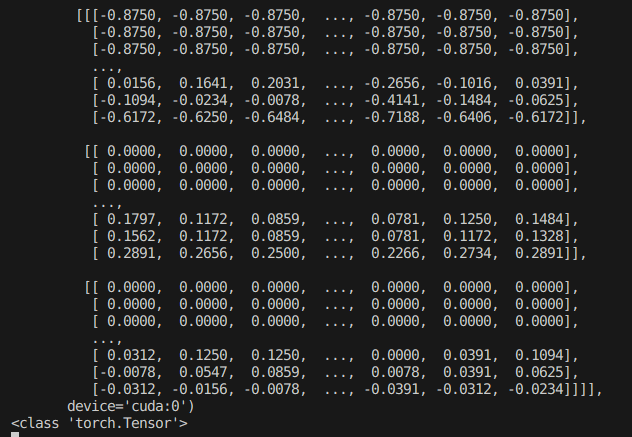

在插入了quant与dequant以后,模型还是可以正常训练的,对num_nodes变量print出来也是具体的数值data value: 207,这里一切正常。

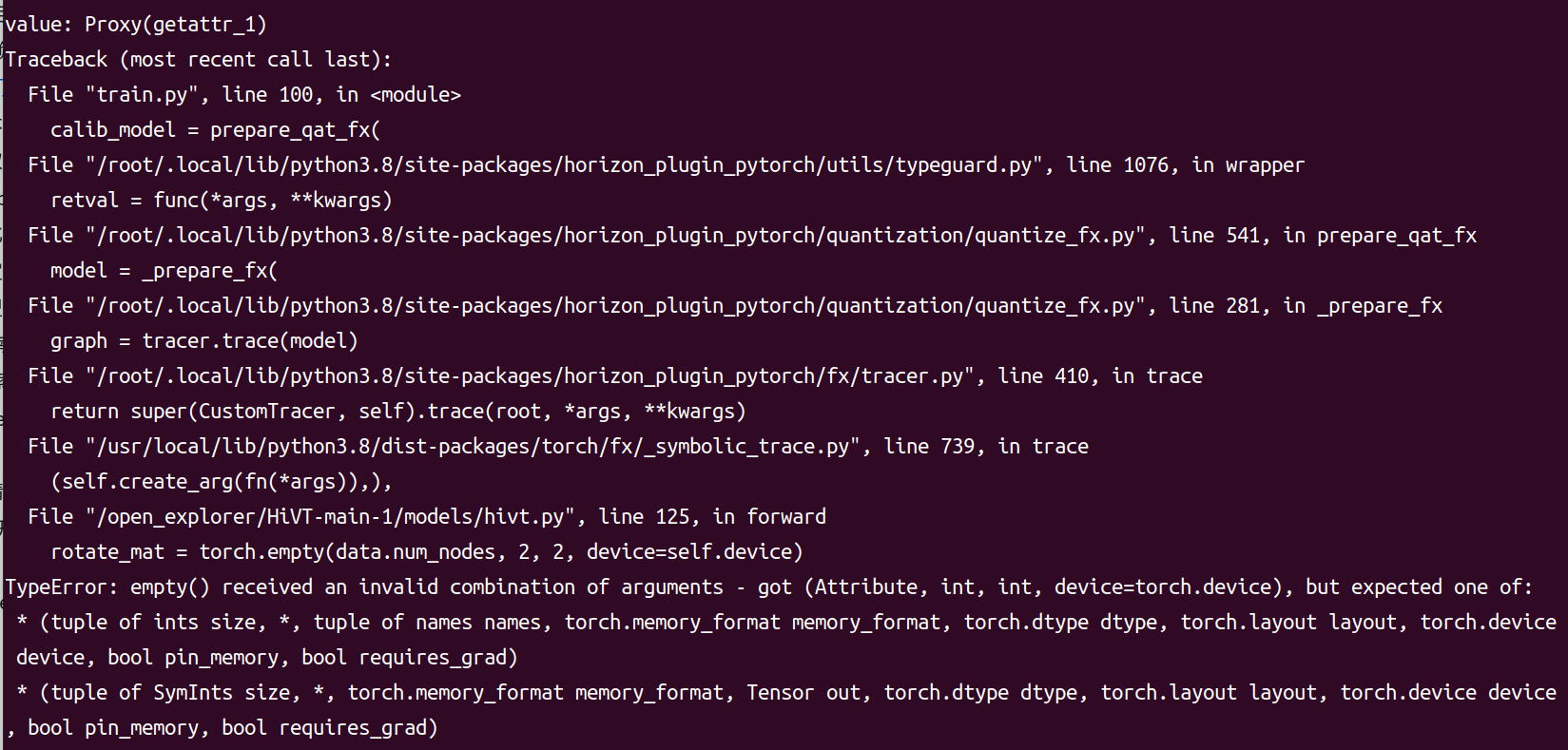

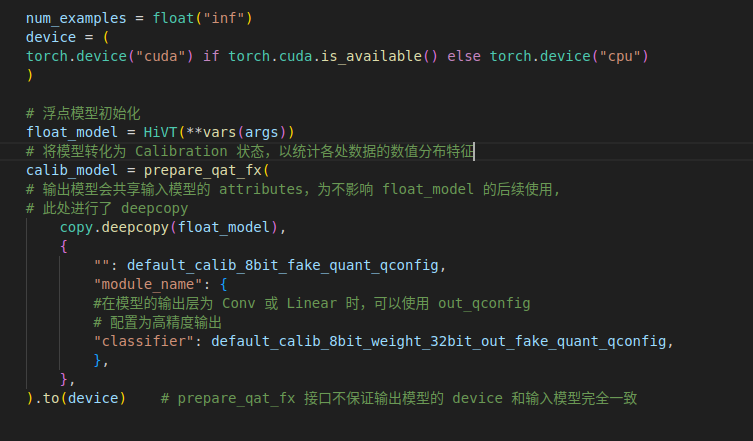

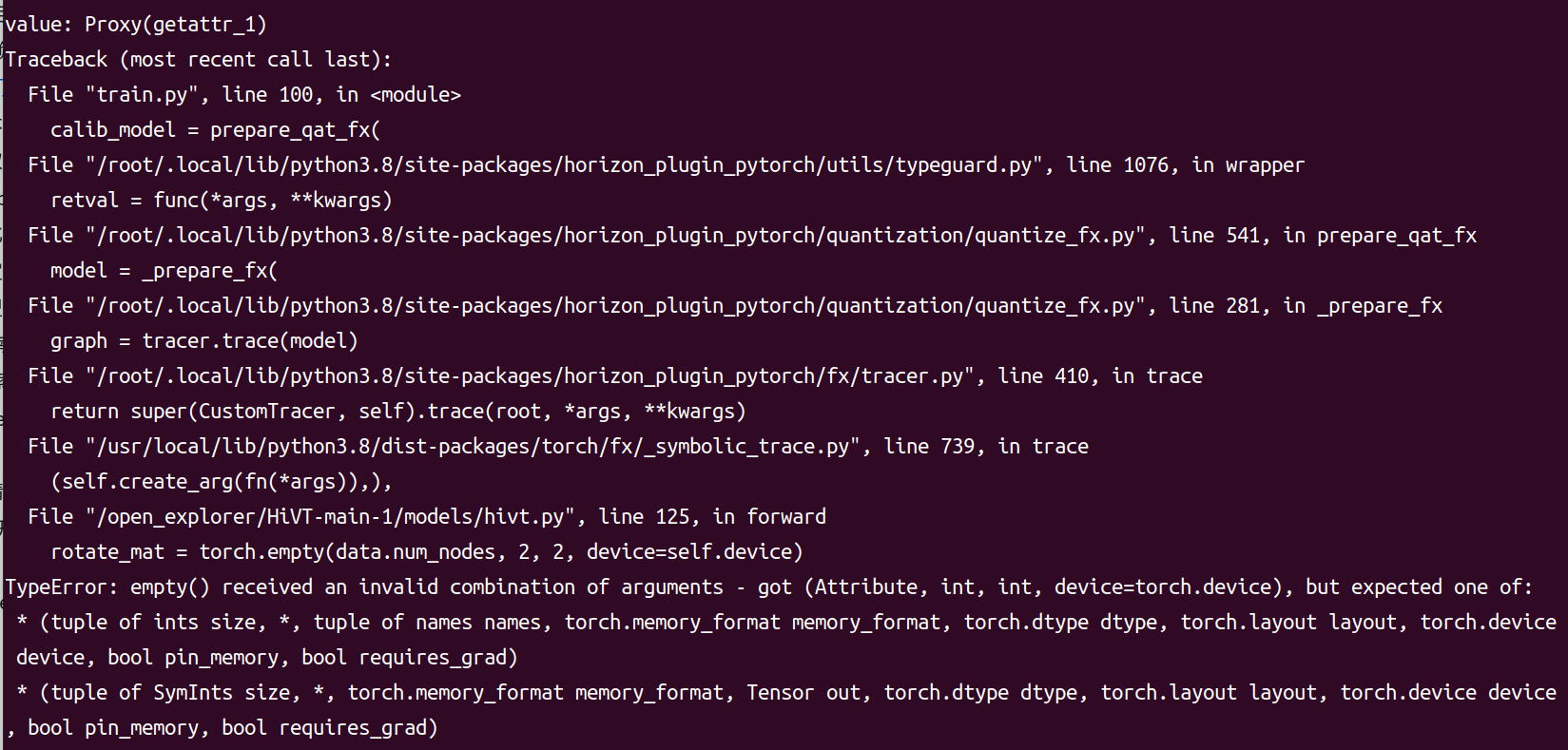

请问为什么会出现这种错误?类似这样的原始数据在插入了calib_model = prepare_qat_fx以后发生改变的错误该如何解决?

J5 J5_OE_1.1.74

在插入了quant与dequant以后,模型还是可以正常训练的,对num_nodes变量print出来也是具体的数值data value: 207,这里一切正常。

请问为什么会出现这种错误?类似这样的原始数据在插入了calib_model = prepare_qat_fx以后发生改变的错误该如何解决?

你好,从错误看是torch.empty fx后的问题,以下两个方法你可以尝试:

根据目前的错误进行调整,empty 需要tuple类型,你可以用()包装一下:torch.empty((data.num nodes, 2, 2), ....)

该报错可能是trace的时候不支持这种attr的用法,尝试直接将empty wrap起来,参考如下print封装方式:

一、

我们参考了QAT快速入门文档,在MobileNetV2的demo以及我们自己的算法进行debug时,发现data进入quant()前后是一样的,那么这个函数的功能或作用是什么呢

file:///home/ch/OE/OE1.1.74/horizon_j5_open_explorer_v1.1.74_py38cn_doc/plugin/source/quick_start/quick_start.html#%E8%8E%B7%E5%8F%96%E6%B5%AE%E7%82%B9%E6%A8%A1%E5%9E%8B

二、

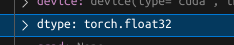

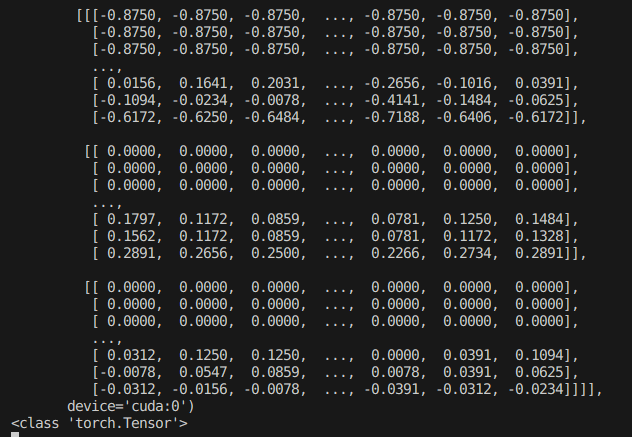

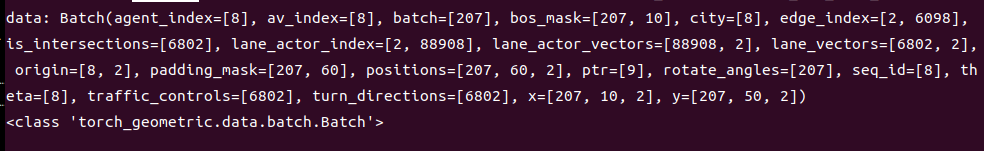

但我们的算法中的data是torch_geometric中的batch类型,如下图

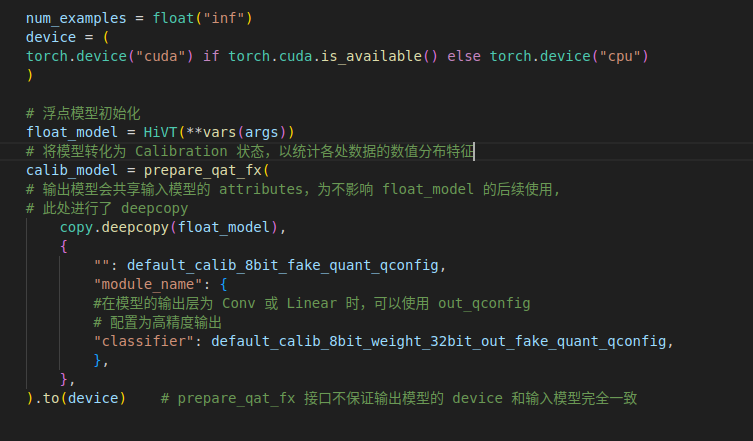

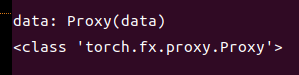

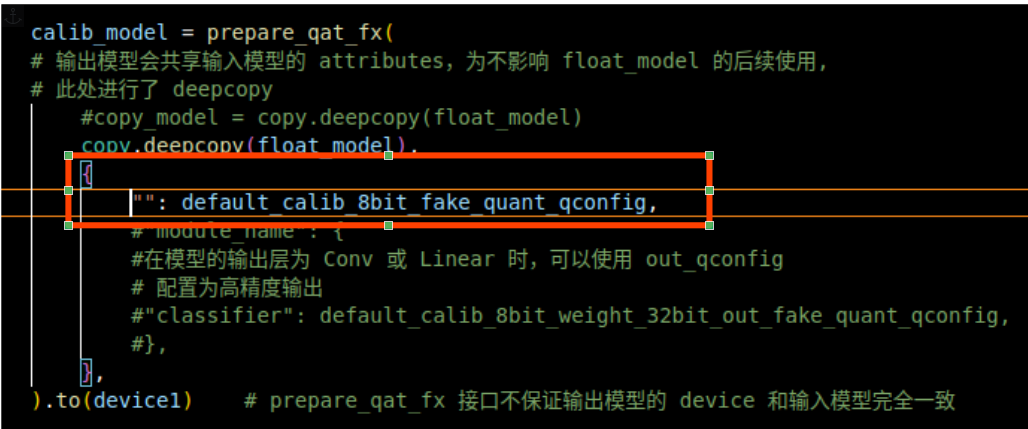

而在经过了calib_model之后都变成了Proxy(如下图),demo中可以顺利calibration,但在我们的算法中会报如上文提问的empty()函数的接受类型的错误。

请注意:问题帖用于对开发过程遇到的特定问题进行跟踪和交流,请配合注意以下两点

帖子的标题以及分类可以基本反馈所遇到的问题。

具体问题具体跟踪,不在同一问题帖中跟踪不同的问题。感谢理解支持。