1. 芯片型号:xJ3

2. 天工开物开发包 OpenExplorer 版本:例如 J3

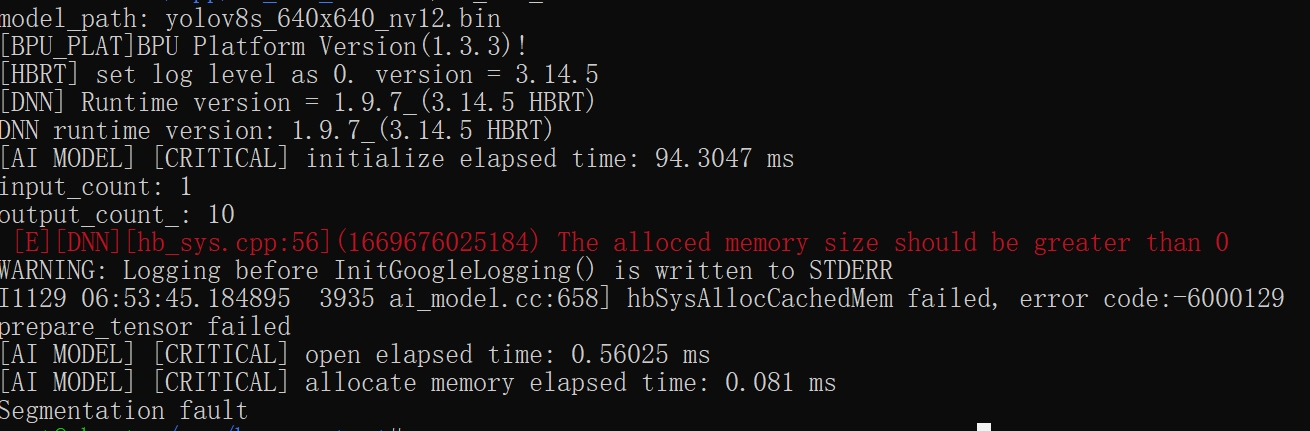

3. 问题定位:板端部署等

4. 问题具体描述:在使用网络进行推理时候, 在 docker 中使用 x86 编译程序一切正常, 但是在 上板子端编译时候,定位到问题出现在下面这句话上.

for (int i = 0; i input_count_; i++) {

if (hbDNNGetInputTensorProperties(&input_tensor[i].properties, dnn_handle_, i) != 0) {

std::cerr "hbDNNGetInputTensorProperties failed" std::endl;

return -1;

}

int input_memSize = input_tensor[i].properties.alignedByteSize

if (hbSysAllocCachedMem(&input_tensor[i].sysMem[0], input_memSize) != 0) {

std::cerr "hbSysAllocCachedMem failed" std::endl;

return -1;

}

定位问题在 input_memSize = 0 所以回报错, if (hbDNNGetInputTensorProperties(&input_tensor[i].properties, dnn_handle_, i) != 0) 这个里面, dnn_handle_ 句柄正常不为空,

现在不清楚 在板子端编译和 x86 的运行结果为什么不同,是编译的问题吗.