1. 芯片型号:J5

2. 天工开物开发包 OpenExplorer 版本: J5_OE_1.1.47

3. 问题定位:板端部署

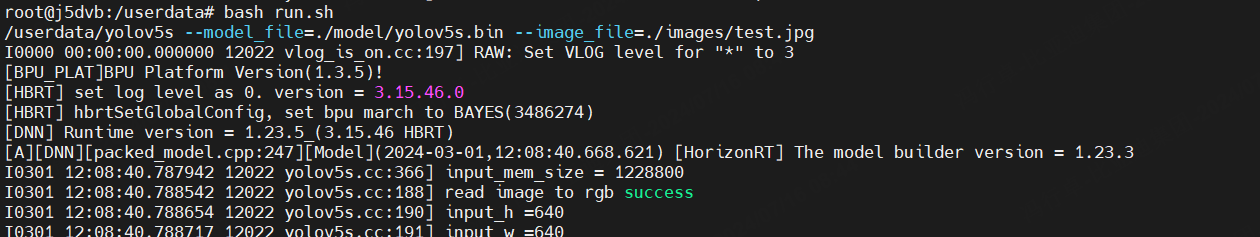

4. 问题具体描述:我们有一个YOLOV5s的模型,经过地平线转换后得到.bin文件,根据OE包示例代码修改了我们自己的代码生成arm可执行文件部署在J5板端,理想结果应该是:模型的输入为640*640的rgb格式,经过推理后得到的结果是一个框的中心坐标,一个置信度,两个检测类别。

现在遇到的问题是,对于不同的图片,打印推理前的输入数据,看着是正常的。但是经过推理后,从输出张量中打印出来的结果明显不正常,数值不正确并且数值具有重复性。现在找不到原因,麻烦指导一下,代码放在附件中了。