专栏算法工具链关于征程6的几个问题2

关于征程6的几个问题2

已解决

快乐的打工人2024-06-04

97

9

算法工具链

征程6

+5

评论9

0/1000

DR_KAN

DR_KANLv.4

J6的BPU升级到了纳什架构,针对各种视觉Transformer,以及端到端的自动驾驶方案做出优化,并且J6家族全面覆盖低算力到大算力,为从低阶到高阶的智驾方案落地和差异化的市场需求提供更全面的基础支撑。

Transformer高效支持

J6的BPU提供了VAE(Vector Acceleration Engine)计算单元用于vector计算加速,DTE(Data Transformer Engine)计算单元提供灵活高效的数据排布变换,AAE(Auxiliary Acceleration Engine)计算单元处理Transformer中的部分特定计算,因此相比于J5和J3,J6对Transformer的推理性能有了显著的提升。

浮点计算支持

J6的BPU提供了一个针对浮点数据的VPU(Vector Processing Unit)计算单元,支持FP16和FP32,可高效处理vector数据。

分支能力支持

J6的BPU还提供了SPU(Scaler Processing Unit)计算单元用于标量计算,支持处理if条件判断、loop循环等,从而减少了J5上必须要拆图(放在CPU上处理)的数据换入换出性能开销。

更强的CPU算力

J6E和J6M均使用了6个A78,J6E的CPU主频为1.5GHz,J6M的CPU主频为2GHz,因此对于模型中存在的CPU算子,J6的计算会更加高效。

更大的带宽支持

J6计算平台分配给模型推理的DDR带宽有显著的提升,因此模型编译时可以专注在延时的优化而非带宽占用。

多batch模型

对于J5等中高计算能力平台,小分辨率输入或者小计算量的模型往往不能获取高效的计算效率,针对这种情况,可以通过多batch模式来部署模型。

大分辨率输入

除了多batch模式外,增大模型的输入分辨率也可以获取更加高效的计算效率,如采用720P、1080P等更贴合实际业务落地场景的分辨率进行评测。

GroupConv结构

J5计算平台针对GroupConv以及DepthwiseConv都做了针对性的优化,所以更推荐使用MobileNet、EfficienNet等结构作为模型的Backbone。

批量推理小模型

推理任务每执行一次,系统底层都需要响应一次中断,如果每个小模型都放在一个单独的推理任务中,那么中断出现的频率会升高,导致耗时增加。如果将多个小模型绑定到一个推理任务中,就会减少系统底层中断次数,从而降低系统开销,减少耗时。

2024-06-0400 遥看瀑布挂前川

遥看瀑布挂前川Lv.2

问:在征程6上进行模型训练时,有哪些推荐的超参数优化策略?

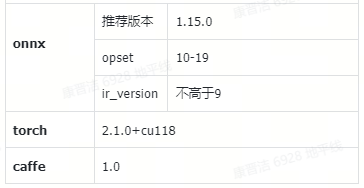

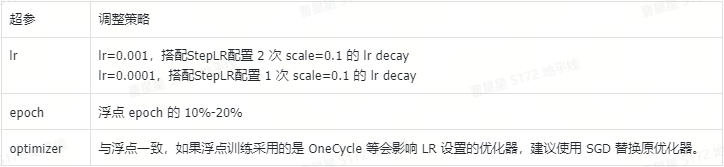

答:征程6是做部署的,是基于训好的浮点模型做量化,然后编译生成二进制文件,部署到板端做推理。浮点训练和J6部署问题不想管,如果想咨询QAT训练的超参数配置,可以参考建议1:QAT模型训练上,训练策略选择建议使用以下方式:建议1:QAT模型训练上,训练策略选择建议使用以下方式: 建议2:QAT模型量化上,建议将输出的conv配置int32量化,如果 BPU 性能等原因需要量化输出,建议使用 int16 量化,保证量化精度。建议3:在qat前做calib,calib尝试代价较低,可以为QAT提供更好的初始参数,缩短QAT训练时长,加速收敛。甚至对部分模型仅做calib就可以达到预期量化精度。2024-06-1300

建议2:QAT模型量化上,建议将输出的conv配置int32量化,如果 BPU 性能等原因需要量化输出,建议使用 int16 量化,保证量化精度。建议3:在qat前做calib,calib尝试代价较低,可以为QAT提供更好的初始参数,缩短QAT训练时长,加速收敛。甚至对部分模型仅做calib就可以达到预期量化精度。2024-06-1300

目录