1.芯片型号:X3

2.天工开物开发包OpenExplorer版本:hbdk-3.47.5、horizon_nn-0.20.1、horizon_tc_ui-1.20.1

3.问题定位:模型转换

4.问题具体描述:

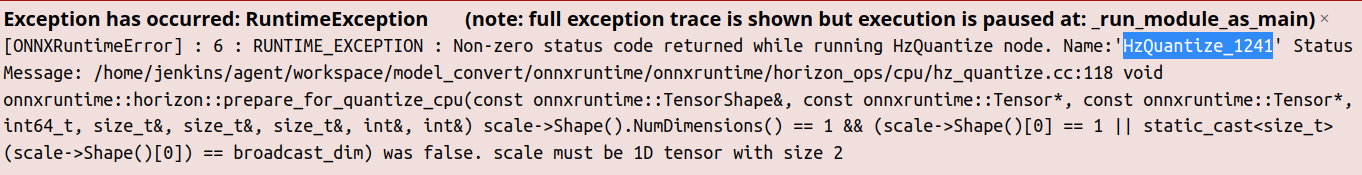

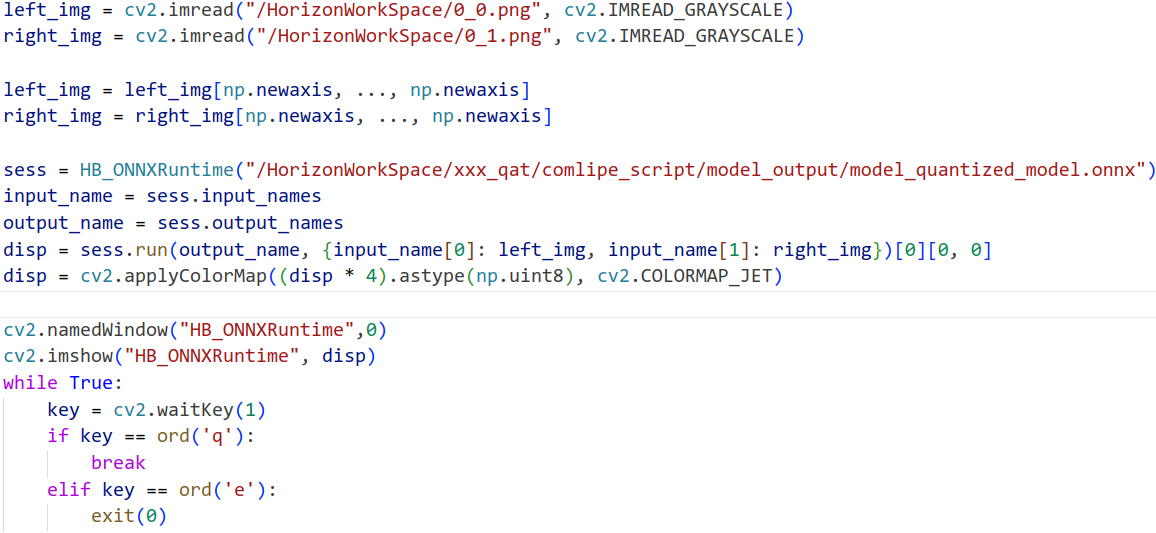

使用HB_ONNXRuntime推理QAT模型与convert_fx结果不一致,具体步骤如下

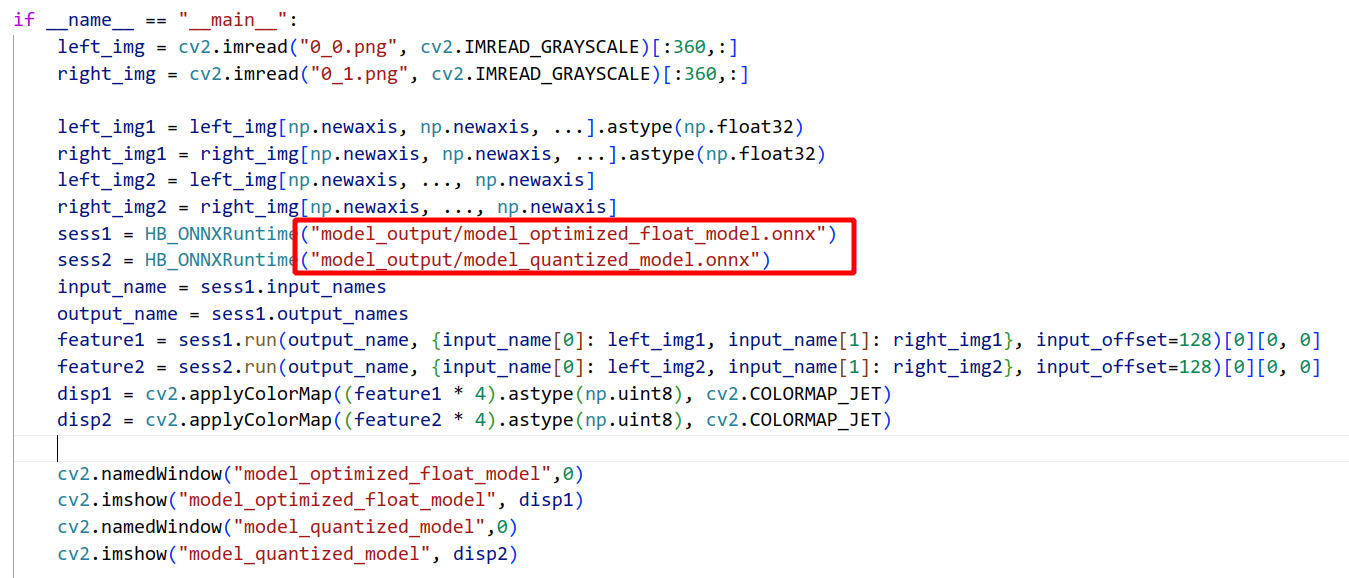

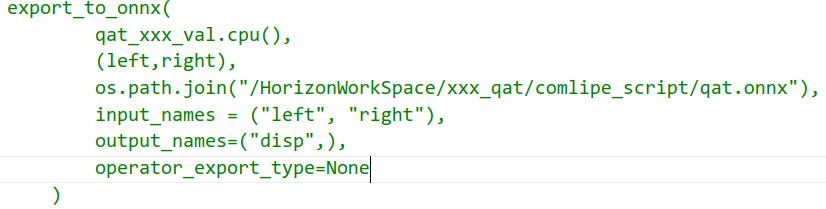

1. 使用QAT训练完异构(softmax在CPU)模型后,转换onnx,转换部分代码见图1

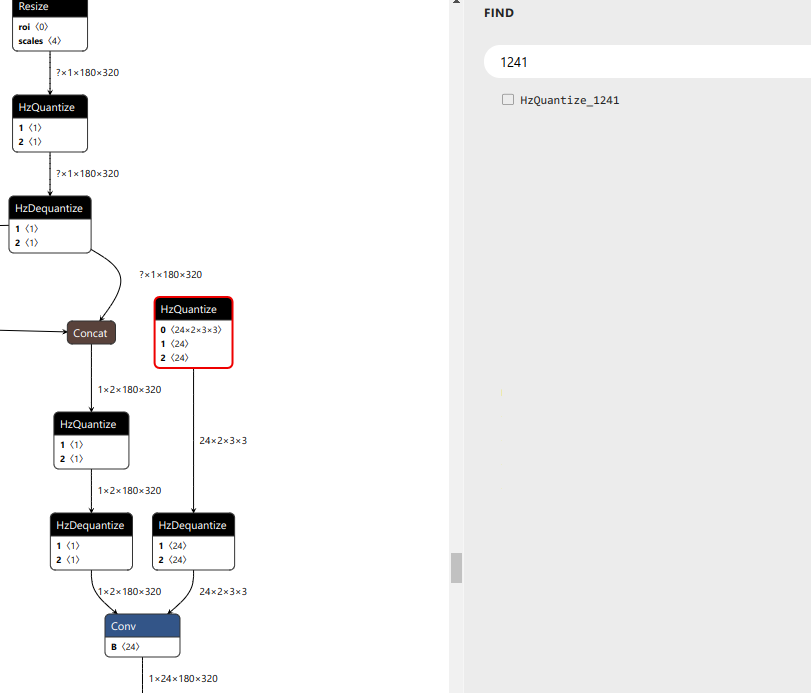

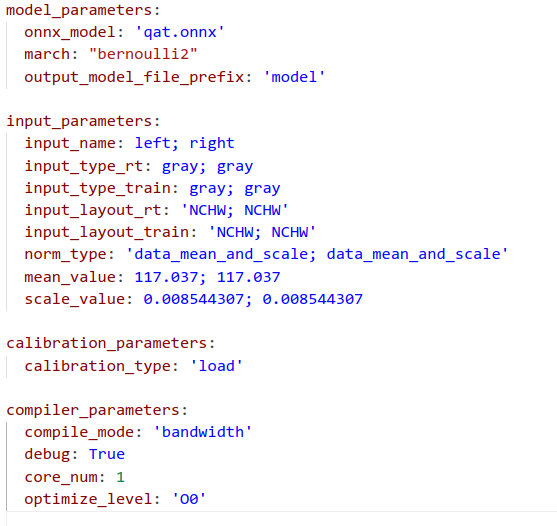

2. 使用hb_mapper嵌入前处理,得到量化onnx,转换部分代码见图2

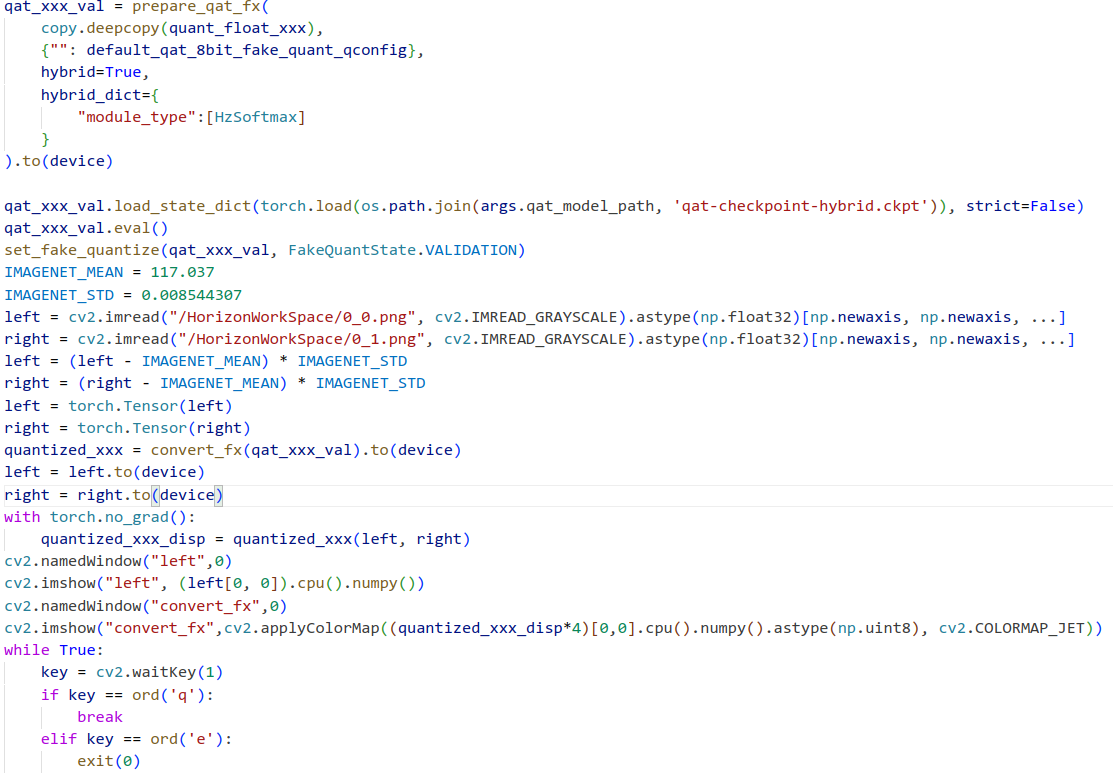

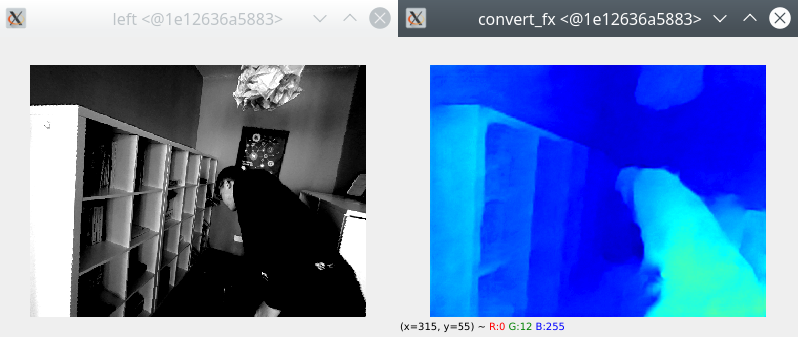

3. 将qat模型使用convert_fx转换,并手动前处理进行推理,部分代码和结果见图3,4

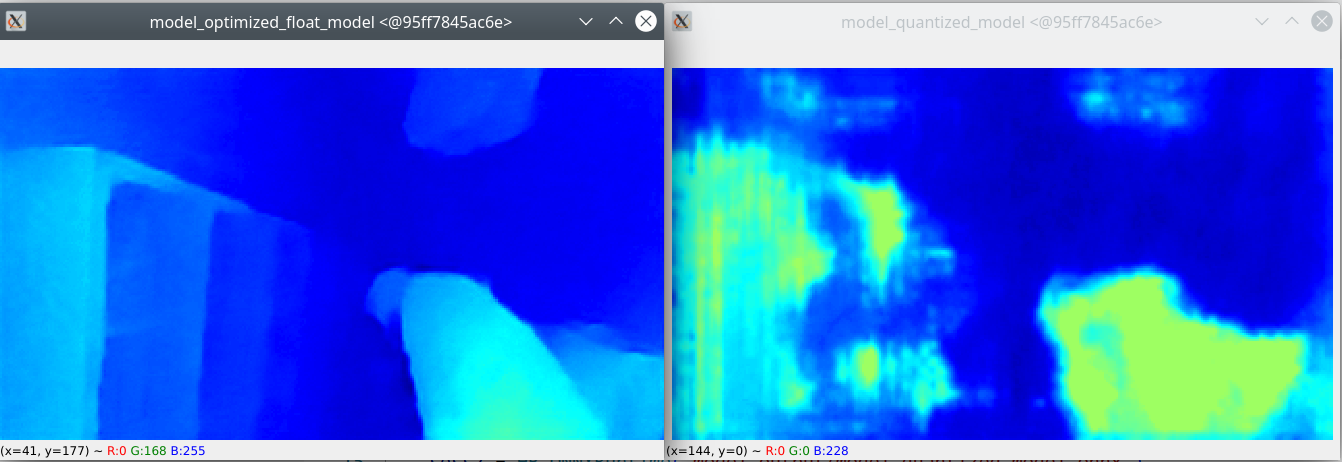

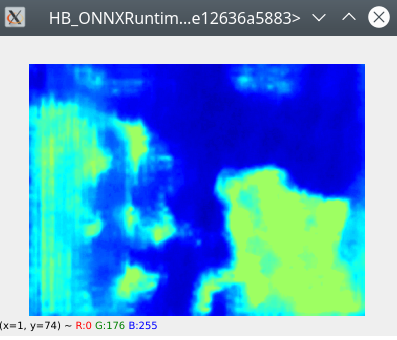

4. 使用HB_ONNXRuntime推理与步骤3一致的图片,不进行前处理,部分代码和结果见图5,6

图1

图2

图3

图4

图5

图6