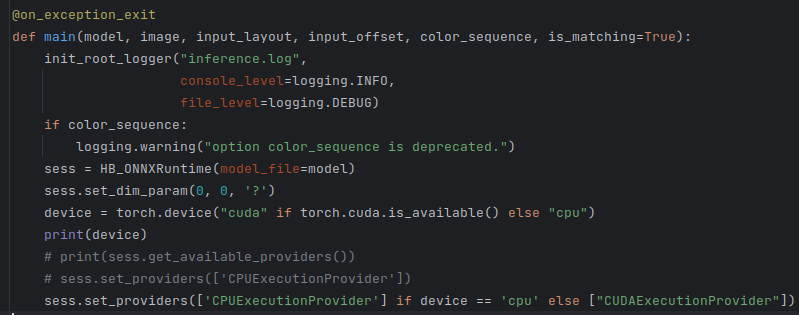

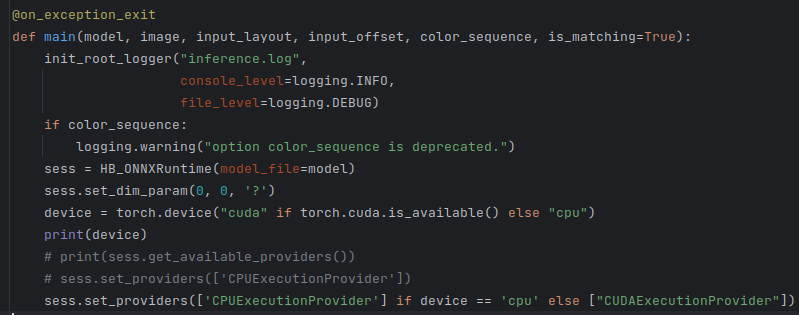

在04_inference.sh中调用的match_inference2.py,其中我可以调用GPU吗?cuda是可以使用的。

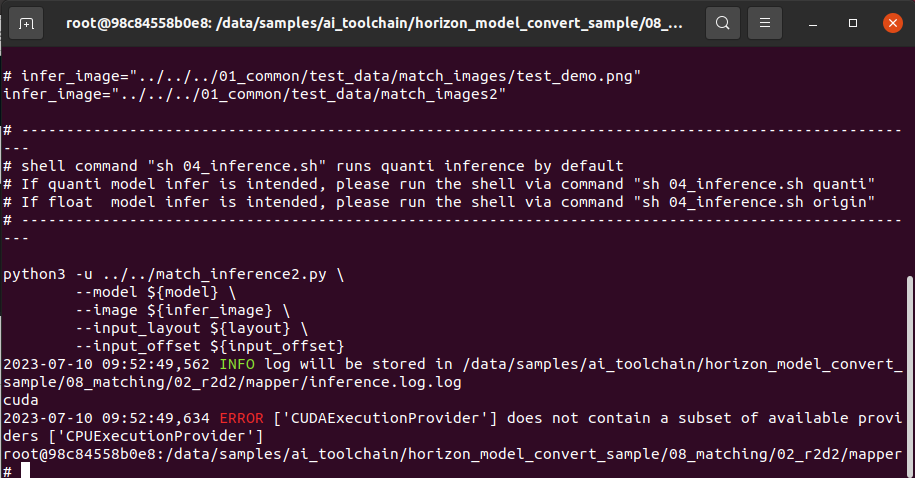

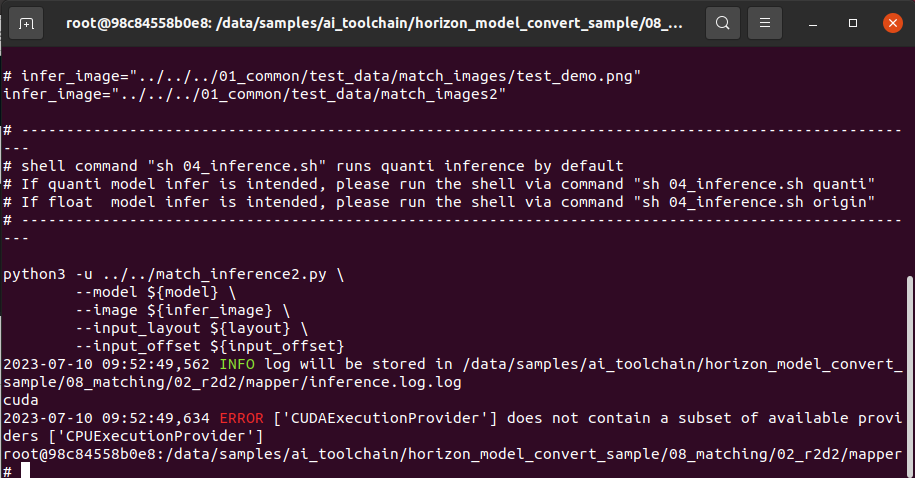

但是会报错:

请问我该怎么解决?

在04_inference.sh中调用的match_inference2.py,其中我可以调用GPU吗?cuda是可以使用的。

但是会报错:

请问我该怎么解决?

你好,推荐您使用CPU版本进行精度验证,因为CPU版本是经过全量测试的。

如果您一定要使用GPU来进行加速的话,也是可以的,但必须使用GPU版本的docker,然后设置

sess = HB_ONNXRuntime(model_file=model)

sess.set_dim_param(0, 0, '?')

sess.set_providers(['CUDAExecutionProvider'])

现在问题是我装的是GPU版本的docker,但是并不能调用GPU:

1.安装过程GPU版本的docker执行的脚本是:

sudo docker run -it --gpus all -d -v /home/lpp/workspace/horizon_xj3_openexplorer_v2.5.2_py38_20230331/horizon_xj3_open_explorer_v2.5.2-py38_20230331/ddk:/data --name horizon_GPU d292bc9ff2d9

3.但是在代码中:sess.set_providers(['CUDAExecutionProvider'])会报错。

改为sess.set_providers(['CPUExecutionProvider'])运行是没有问题的,但是速度很慢,所以我想试试GPU