使用ptq量化方式生成的bin模型精度正常,使用qat量化方式生成的bin模型精度异常

我使用了异构的qat训练方式,流程是:原始pth模型、qat训练后的pth模型、qat的onnx模型、bin模型

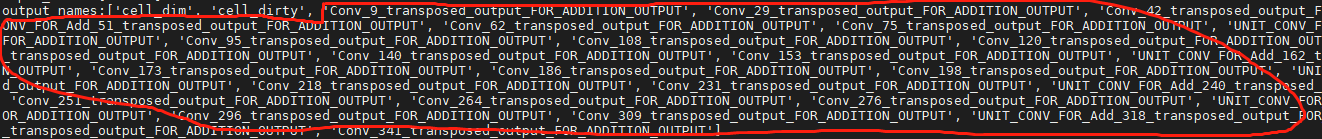

出现问题之后,我对应测试了原始pth模型和qat训练后的qat模型,模型精度正常;对应测试了原始onnx,模型精度正常;对应测试了quantized_model.onnx,qat版本的onnx模型多了很多的输出节点,舍弃多余节点后精度正常,

个人理解这些节点不会影响bin模型精度。转bin参数位置config.yaml差别不大,qat版本,增加remove_node_type: "Quantize;Dequantize";修改了calibration_type: 'load',其他地方没有改变。

参考了精度调优的网址https://developer.horizon.ai/forumDetail/71036815603174578!

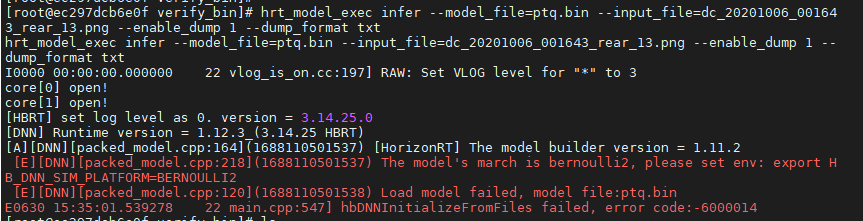

但是 hb_model_verifier这个工具安装失败了,公司板子没有开放安装环境的权限

hrt_model_exec这个工具使用也失败了,

想问一下这个精度异常问题应该如何解决,有没有ptq和qat量化流程的详细对照文档