在进行yolov5模型转换后,发现生成的bin模型在J3板上推理运行时间(280ms每帧)远远大于使用onnx模型在pycharm中的推理时间(20ms每帧)。

其中原因是否是因为模型转换后部分结构放到了CPU上运行导致?是否可以通过配置yaml文件,强制在BPU上运行来解决?

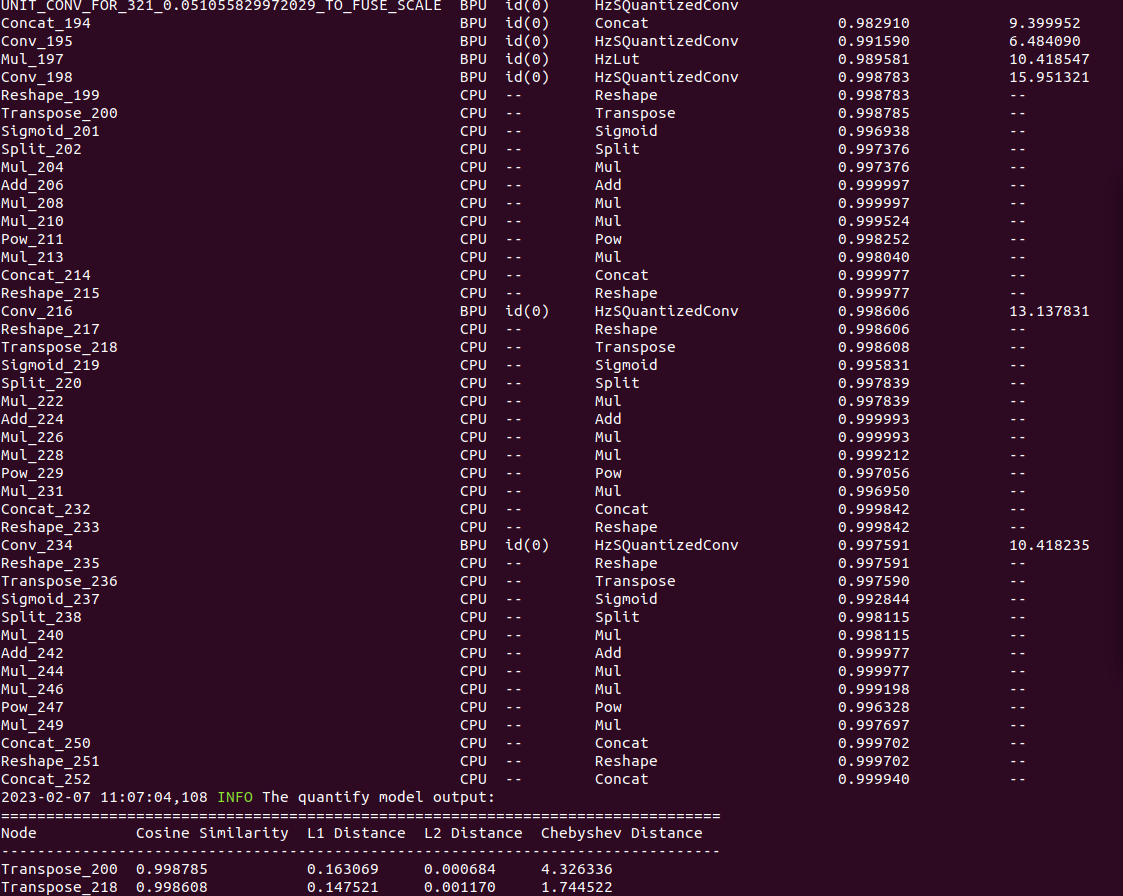

模型转换时输出如下图所示:

如果想强制在BPU上运行请问该如何配置yaml文件中的:run_on_bpu:{OP_name}?op_name是否替换为对应节点名列表,如{"Reshape_251","Concat_252"}?