用户您好,请详细描述您所遇到的问题:

在将yolov5部署上板时,发现运行时间过长,在model_inference代码中,发现在首先使用infer_method输出了一个output ,然后进行后处理postmethod,在后处理过程中要先等待推理结束在进行后处理,在这个过程中等待推理结束的过程耗时约270ms左右,这个时间是正常的吗?

infer_method输出的output不是代表前向推理完成吗?为什么还要在后处理中等待推理结束?

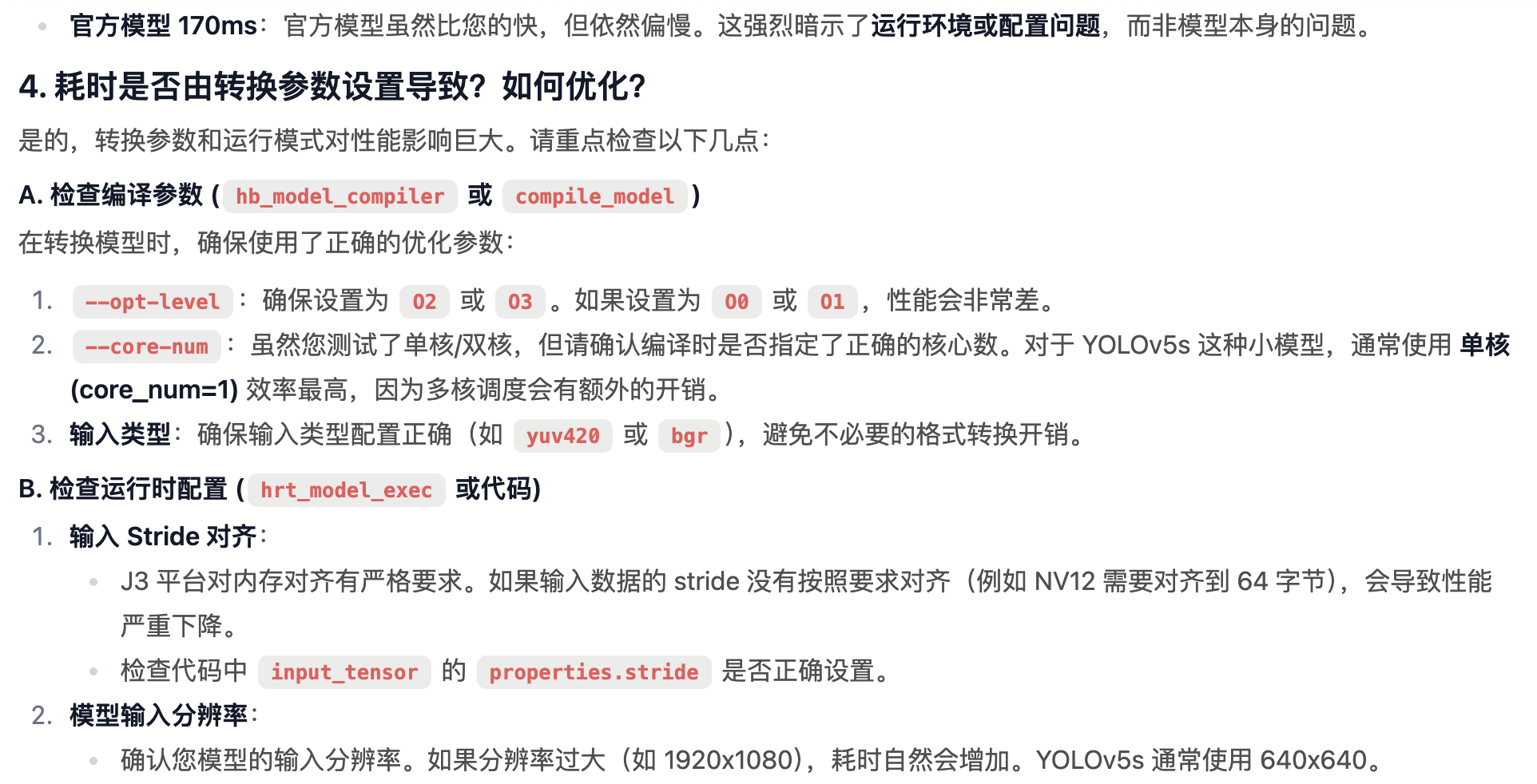

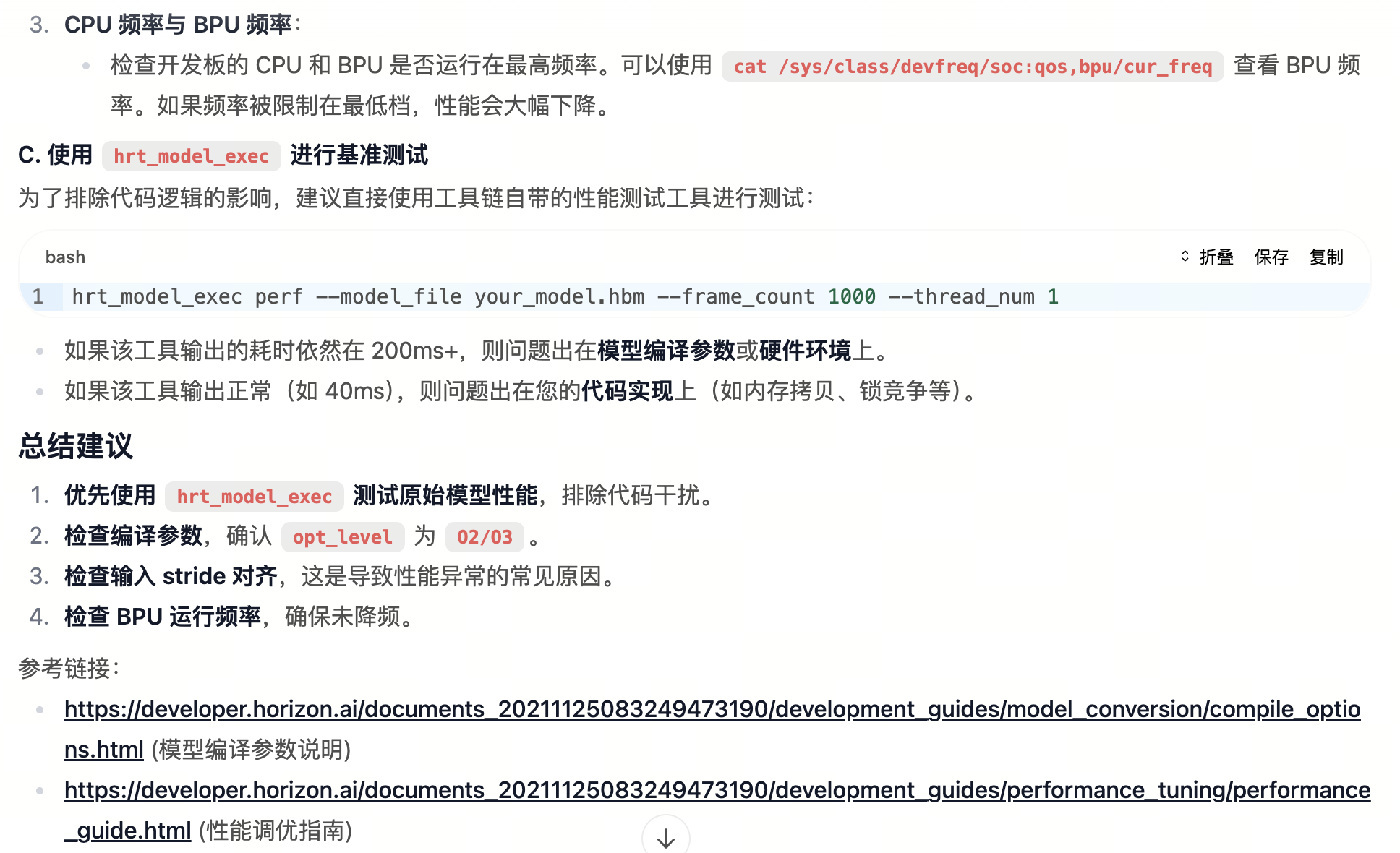

问题1中我使用的是自己训练的模型,耗时270ms,然后又测试了官方给定的yolov5s的bin文件,耗时为170ms,依旧达不到实时的要求。同时测试了多线程,该段等待时间没有任何减少。

这个耗时是因为我转换bin模型的时候某个参数设置的问题吗?同时也测试了单核/双核(core_num)模型,时间依旧没有减少。

OE包版本:转换时使用2.2.3,使用的是J3