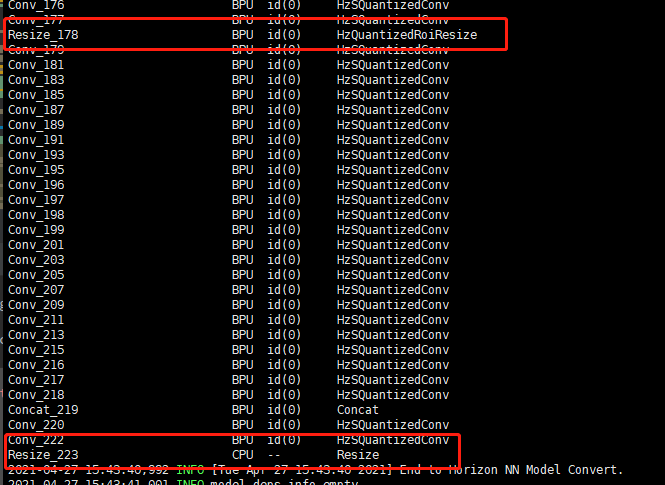

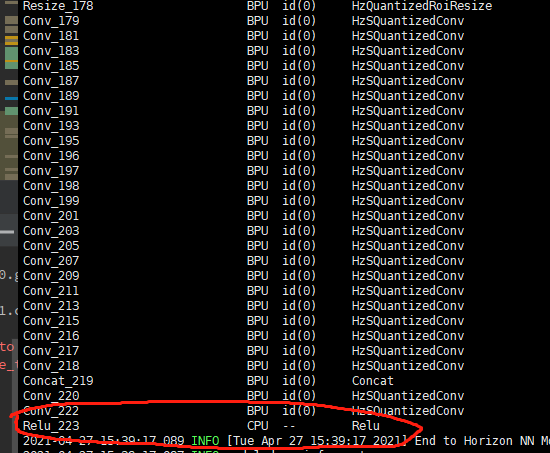

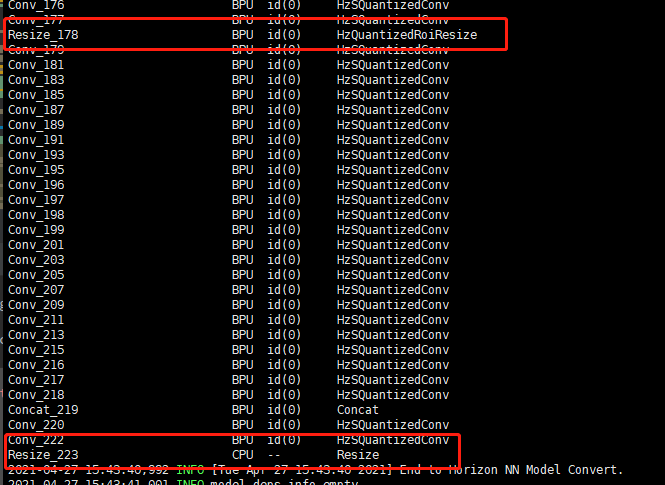

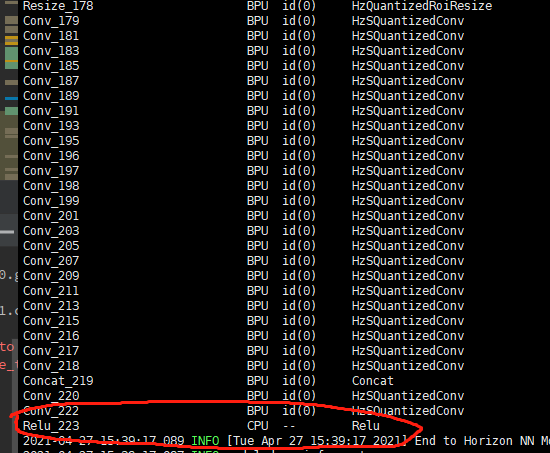

多次尝试发现最后一层如果有relu或者interpret/concat算子的话检测无法优化到BPU,这两个算子在中间层可以优化到BPU中。

使用pytorch1.6

relu为self.relu = nn.ReLU(inplace=True)

interpret为torch.nn.functional.interpolate()

concat为torch.cat

多次尝试发现最后一层如果有relu或者interpret/concat算子的话检测无法优化到BPU,这两个算子在中间层可以优化到BPU中。

使用pytorch1.6

relu为self.relu = nn.ReLU(inplace=True)

interpret为torch.nn.functional.interpolate()

concat为torch.cat