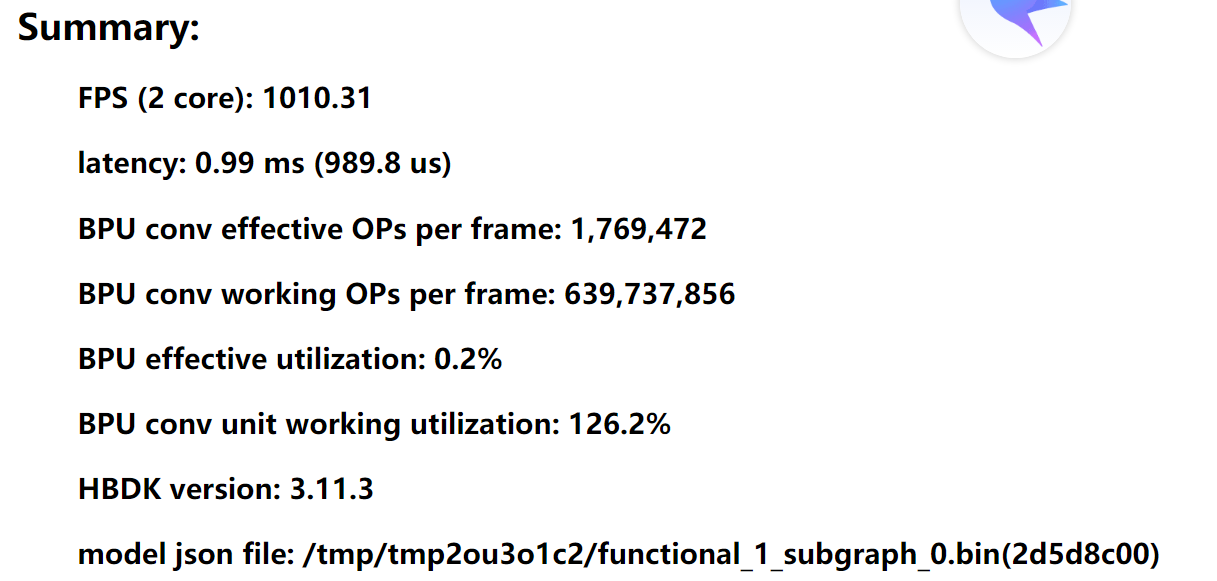

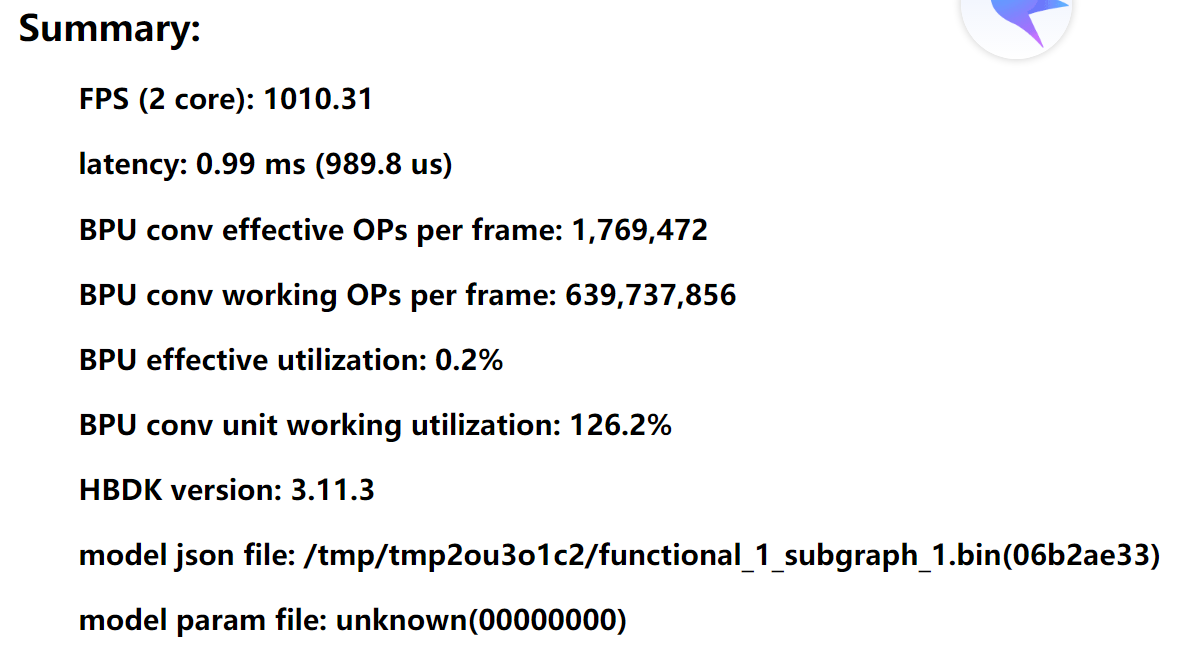

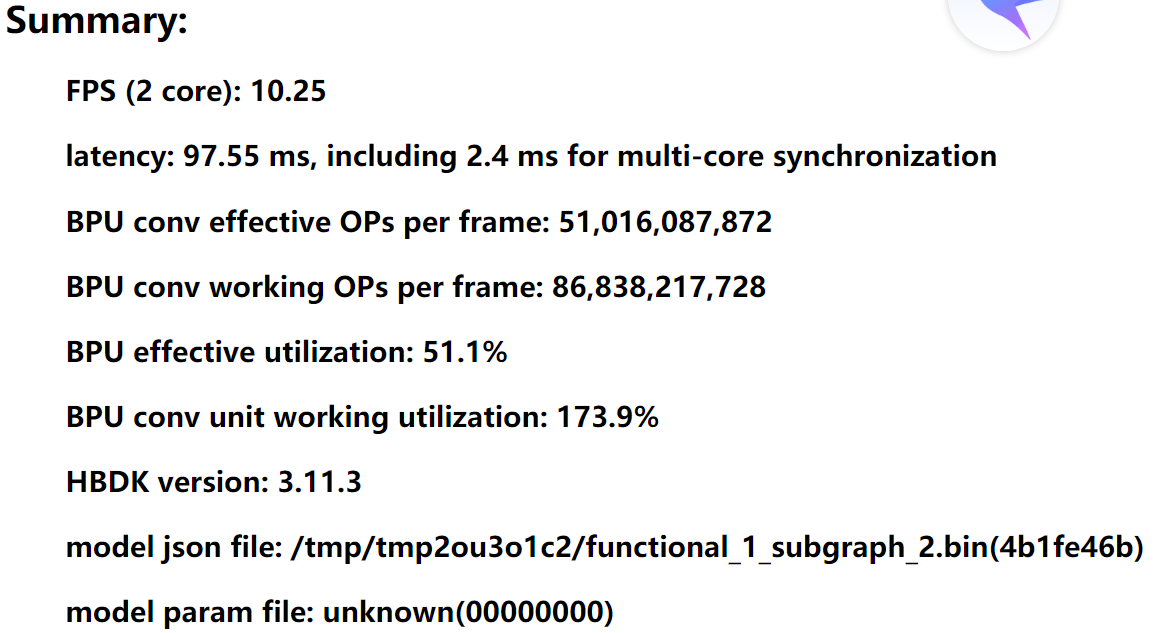

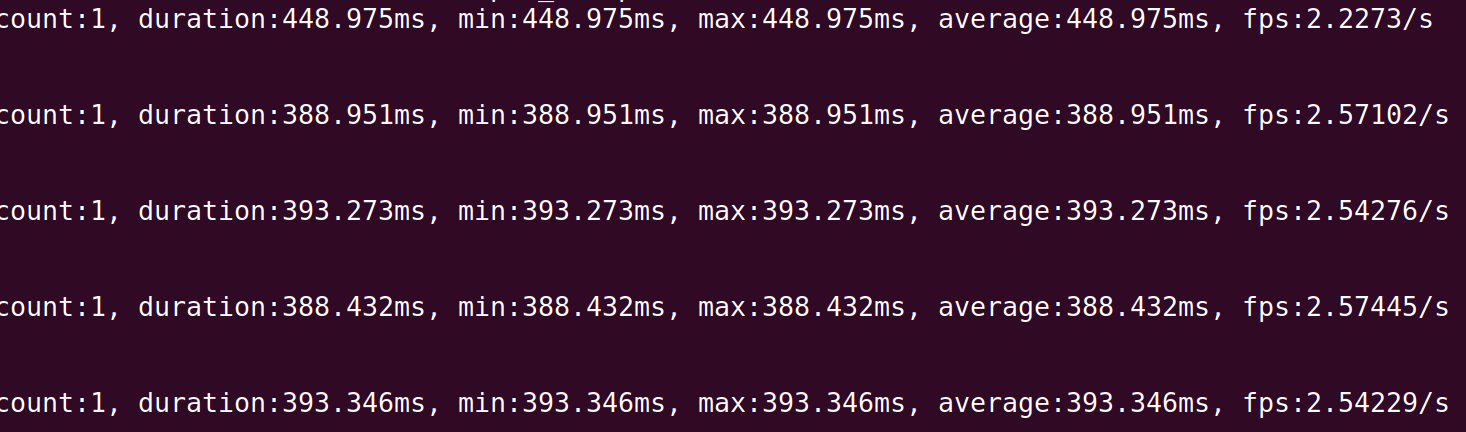

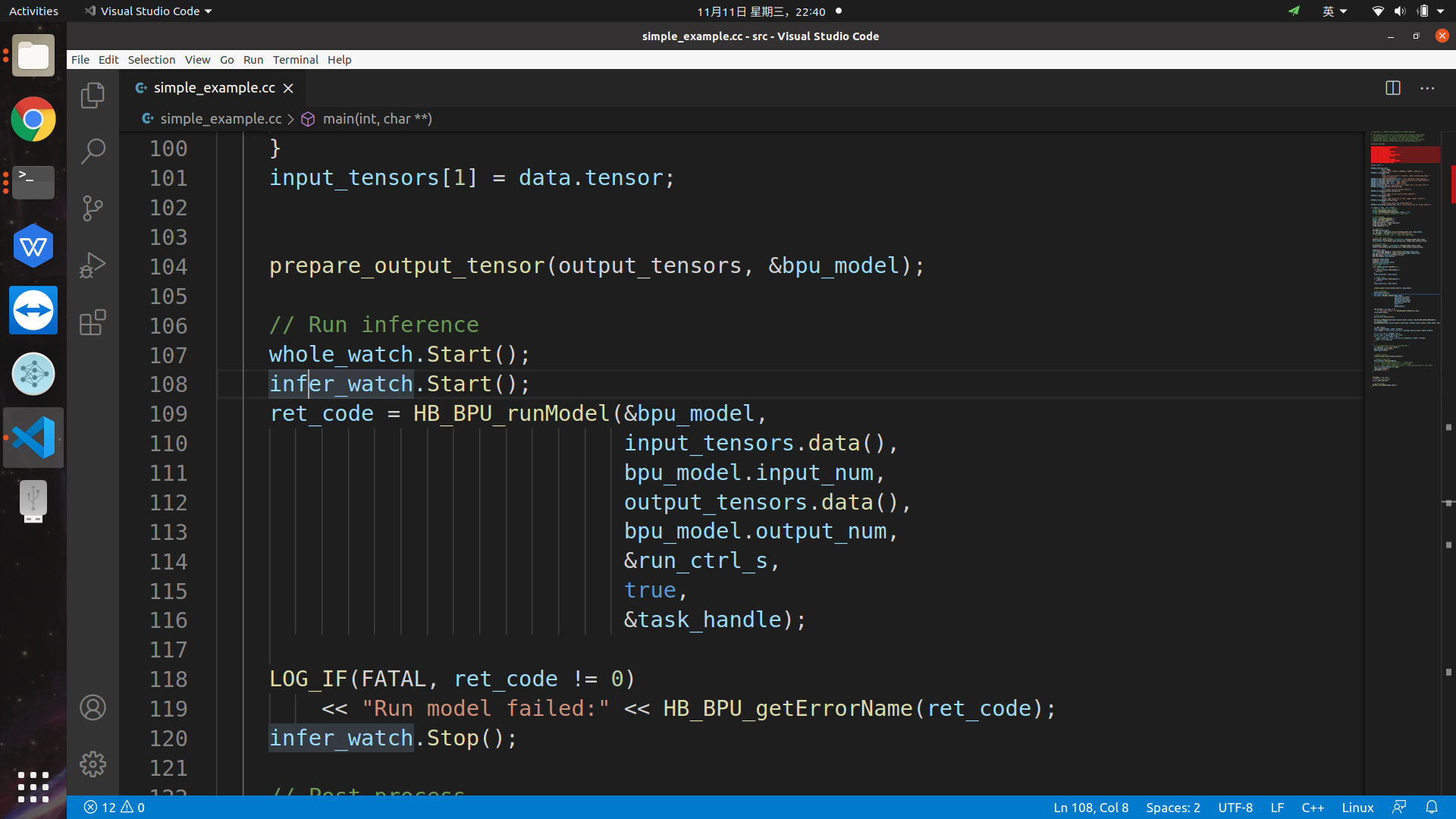

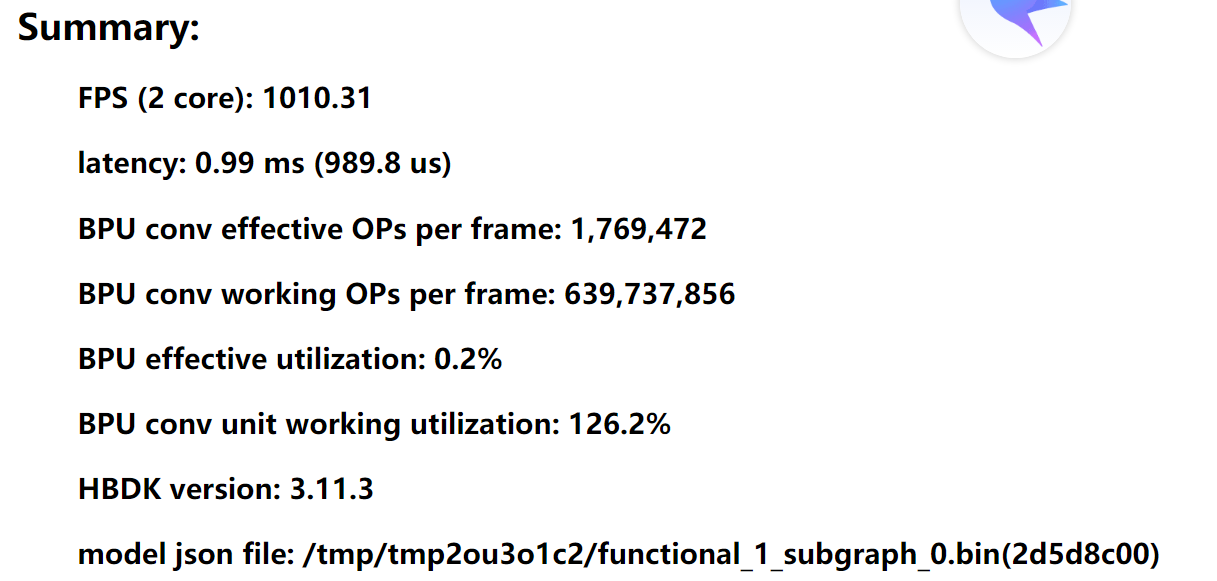

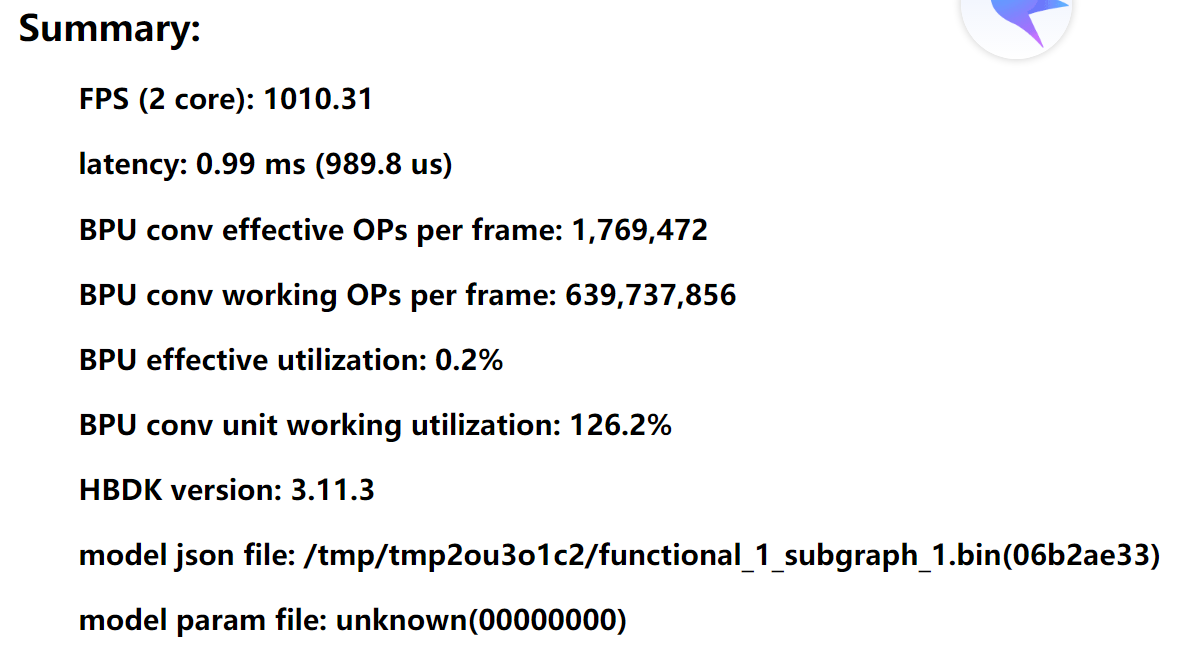

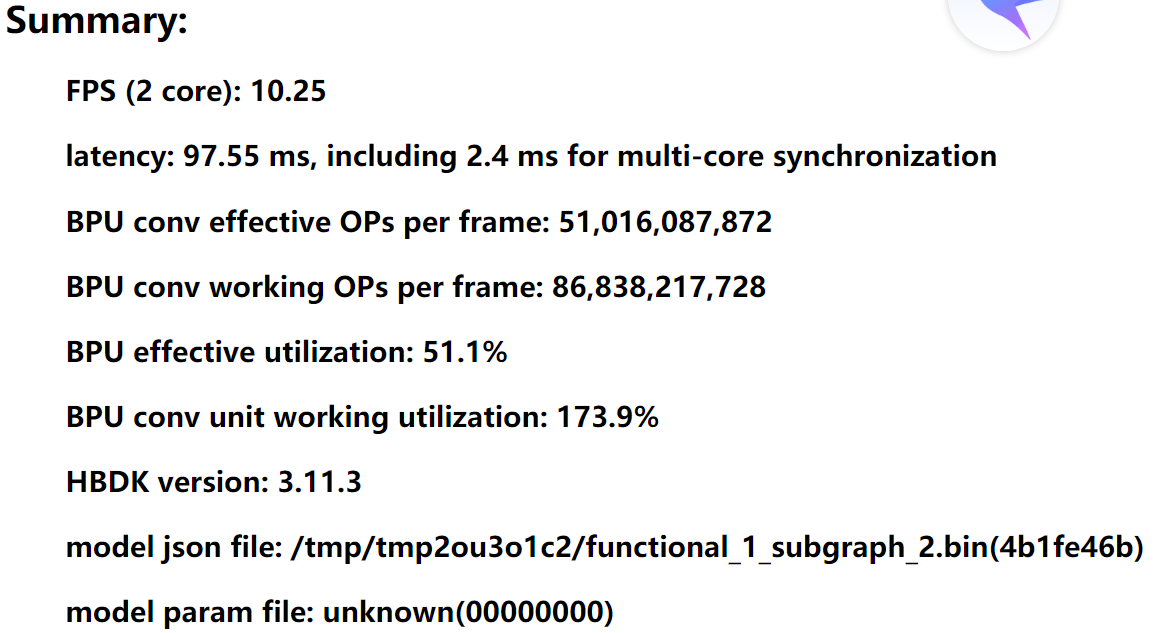

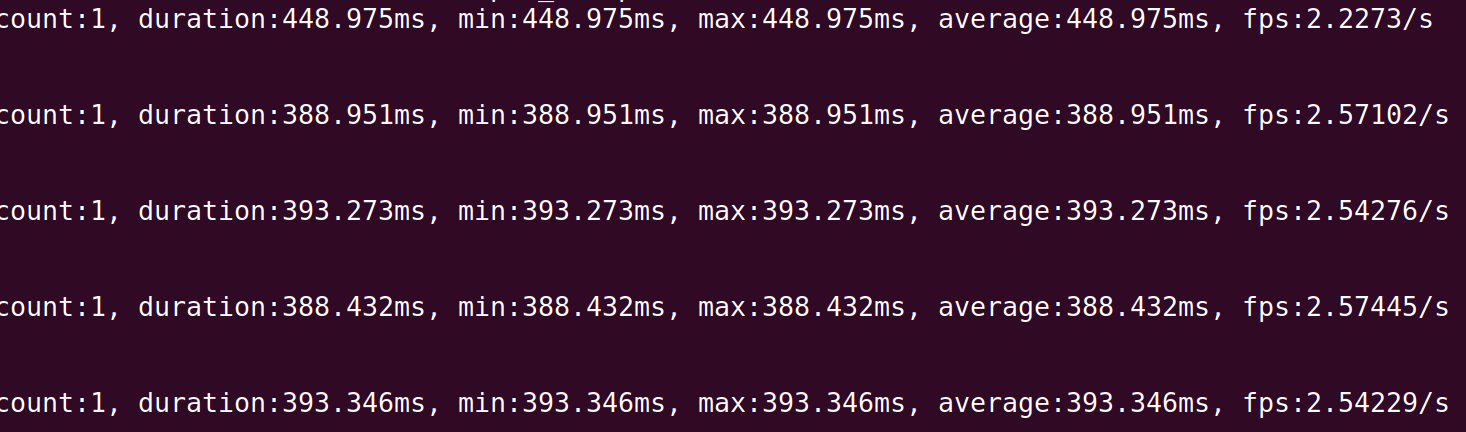

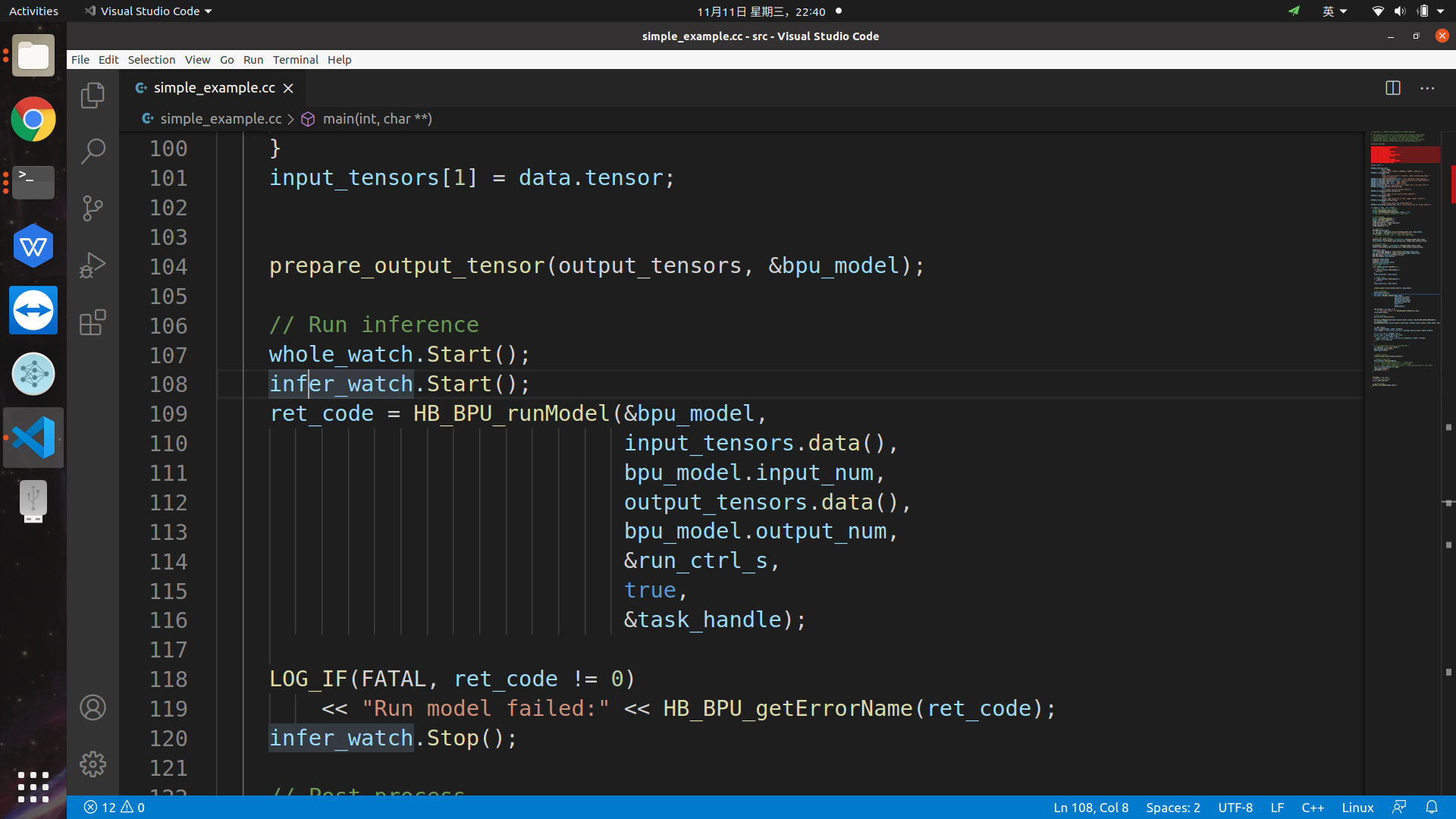

模型build后的pref信息如最上面三个图所示,估计的latency是100ms,但是板上验证时间400ms左右,相差有些大了,请问如何优化

模型是384x768x3的双输入(推理视差的),在内部进行concat,此处的时间仅为infer_watch

模型build后的pref信息如最上面三个图所示,估计的latency是100ms,但是板上验证时间400ms左右,相差有些大了,请问如何优化

模型是384x768x3的双输入(推理视差的),在内部进行concat,此处的时间仅为infer_watch