遇到一个问题,就是发现输入张量大小对推理时间影响很大

当输入张量大的时候,即使模型非常小推理速度还是很慢

但是根据源码程序在推理之前已经把输入张量调加载了

所以想请教一下是不是在推理时又重新加载了一次输入。如果是,有没有方法实现内存共享

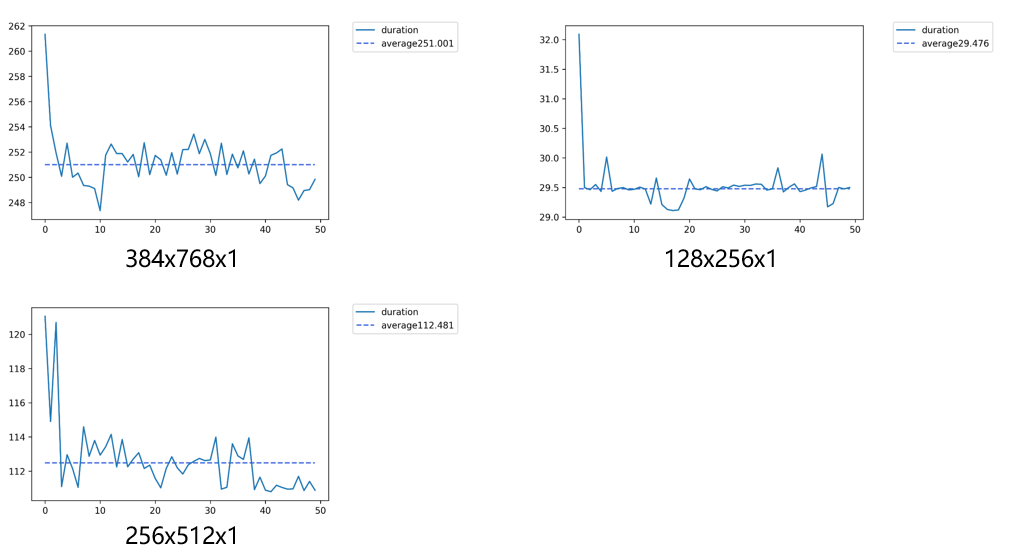

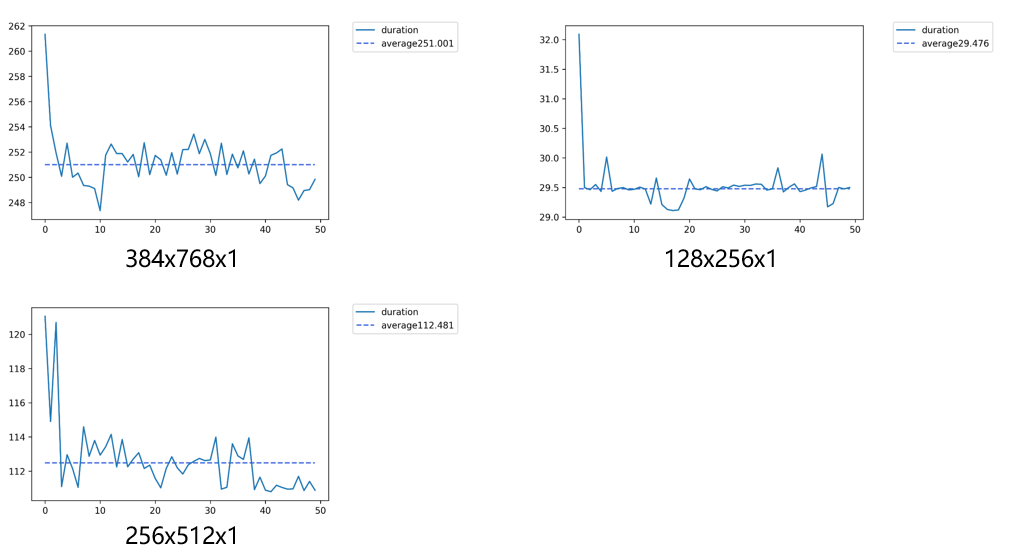

这是我相同模型不同大小输入的推理耗时,average是50次infer_watch的平均时间(ms)

遇到一个问题,就是发现输入张量大小对推理时间影响很大

当输入张量大的时候,即使模型非常小推理速度还是很慢

但是根据源码程序在推理之前已经把输入张量调加载了

所以想请教一下是不是在推理时又重新加载了一次输入。如果是,有没有方法实现内存共享

这是我相同模型不同大小输入的推理耗时,average是50次infer_watch的平均时间(ms)