请问目前装配到车上实现自动驾驶和一些智能化应用需要部署几个硬件神经网络。在实际应用时是否会考虑不同场景间加速器的调度使用。

专栏底层软件关于车载AI中神经网络的数量

关于车载AI中神经网络的数量

已解决

EricXu2020-04-15

398

1

底层软件

评论1

0/1000

dingerjun

dingerjunLv.1

您提到的问题,在AI芯片量产过程中,是必然要面对的问题。

端到端的场景,从数据接入,到模型的级联,到感知结果的输出,需要非常顺滑的处理。

举个车内算法量产的方案:

1,所有量产功能的AI模型数量在20+

2,接入2颗摄像头 30fps处理速度。

车内IMS摄像头要能够处理多个人脸,比如眼睛,如果车内5个人脸都存在的话,眼睛模型每帧需要处理10次预测,30fps。其他模型类推。极限工况下单单眼睛模型的预测,就是在300fps。当然一般场景下,2-3个人脸。3,综合来看,从人脸的多目标检测,到后续功能的的处理,大模型,小模型的综合调度,1000+fps是有的。

对于AI芯片方案的落地:

1,单模型的预测时耗,精度。

2,多模型的调度。方案难点在:

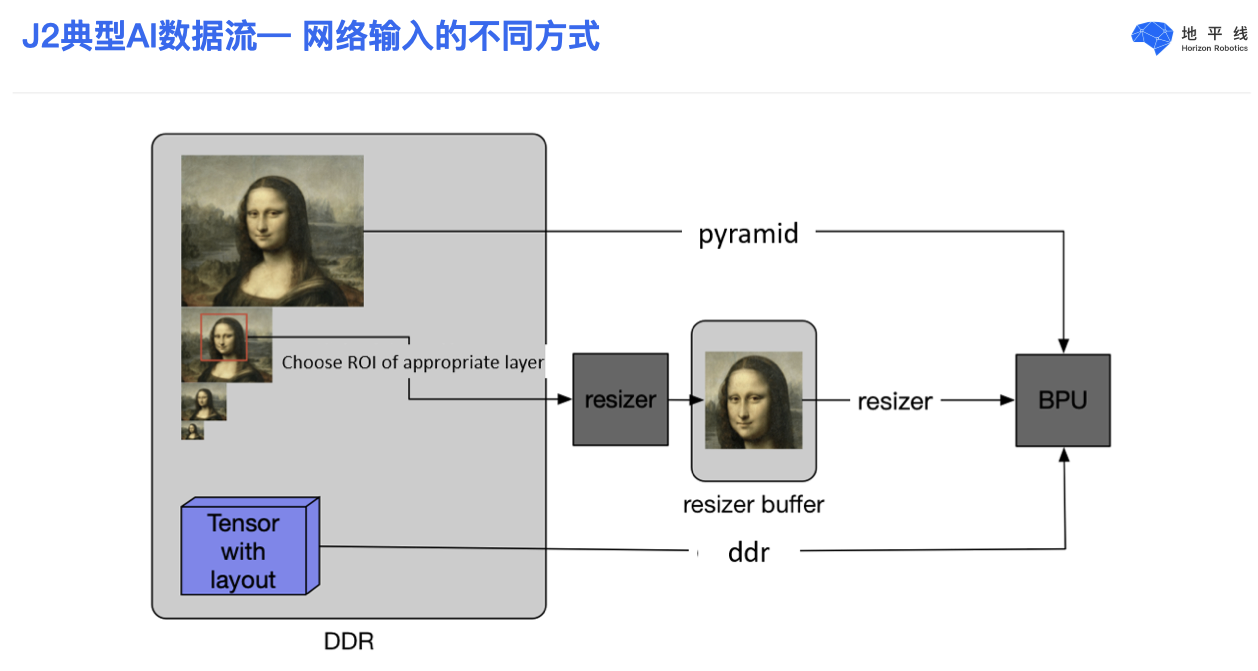

1,芯片的架构设计,是否有阻塞点。每个模型的预测的前处理,后处理如果都需要DDR带宽的DMA来搬运,基本芯片是扛不住这么大的数据量。

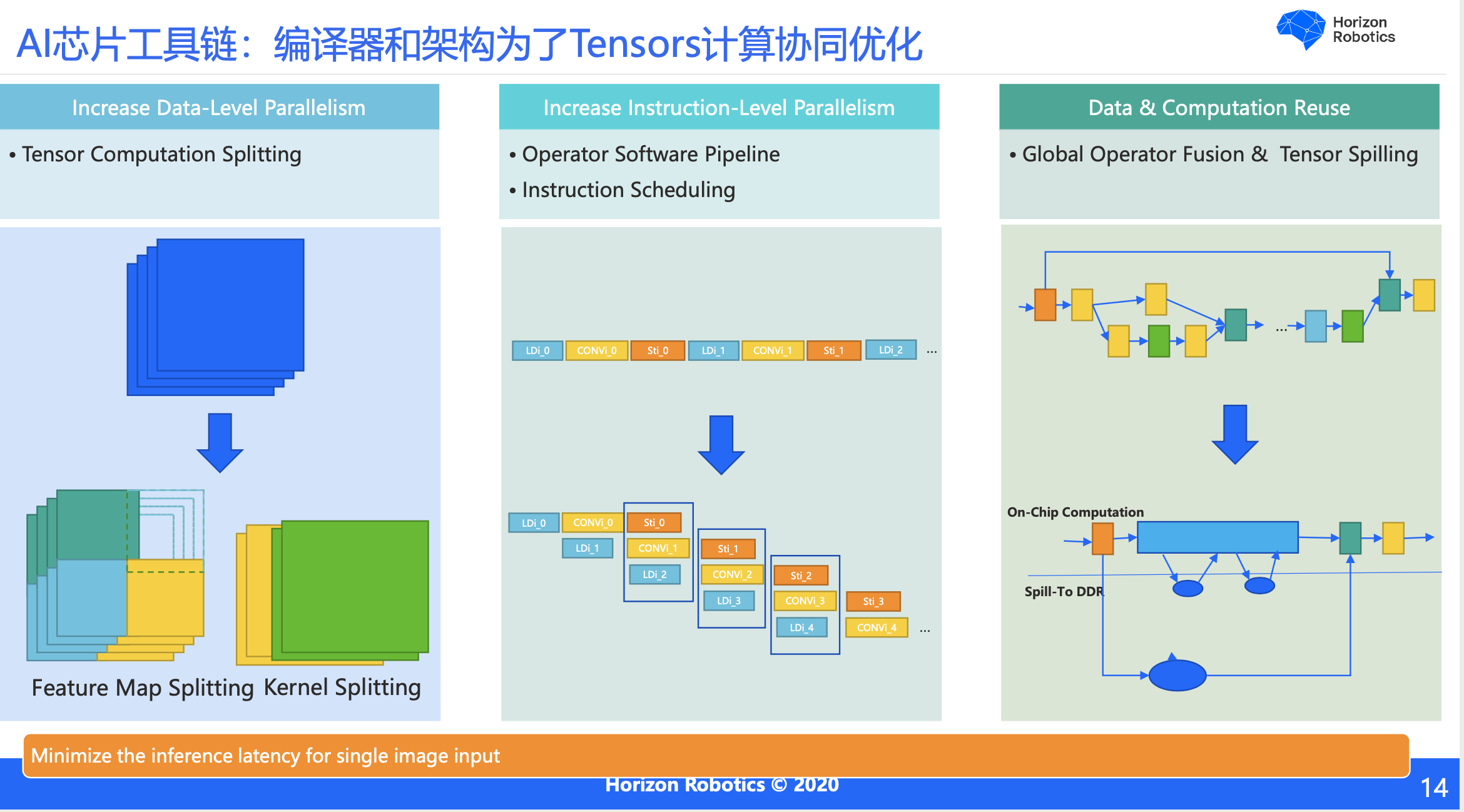

2,模型的调度:

这块类似linux kenrel的调度策略。

芯片这块也要有非常好的流水线设计支持。再加上编译工具链的动态张量的调整,才能支撑巨量模型的调度。

在J2芯片方案的量产落地,以及对标了很多标称自己有很强AI能力的芯片。

最后表达一下自己个人的感受:

算法定义芯片才是AI芯片的正道,

只有有经历过AI量产痛点的算法专家牵引定义的AI芯片才能精确解决端到端的AI量产。我们在很多算法产品化的过程中,一直深刻感受到算力限制的痛苦,我们愿意非常Open的share我们在量产化落地的knowhow给到更多的算法同学,让中国的AI产业尽快脱离算力钳制的窘境。

2020-05-0960