OE包版本:3.0.27

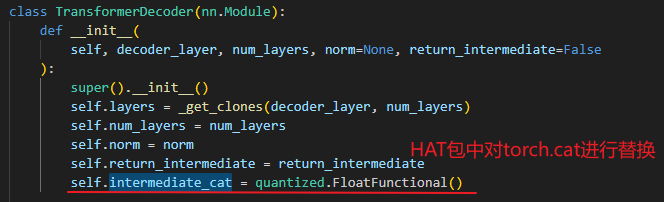

在查看OE包中的QAT示例DETR模型时,发现调用的HAT包中定义的DETR模型,对出现torch.cat、torch.add的地方全部使用quantized.FloatFunctional().cat或quantized.FloatFunctional().add替换。可是在3.0.27的用户手册上J6E/M Torch 算子支持列表中,显示torch.cat、torch.add算子全都支持BPU或CPU执行,请问HAT包中为什么不直接使用torch的算子,而是要进行替换?

在查看OE包中的QAT示例DETR模型时,发现调用的HAT包中定义的DETR模型,对出现torch.cat、torch.add的地方全部使用quantized.FloatFunctional().cat或quantized.FloatFunctional().add替换。可是在3.0.27的用户手册上J6E/M Torch 算子支持列表中,显示torch.cat、torch.add算子全都支持BPU或CPU执行,请问HAT包中为什么不直接使用torch的算子,而是要进行替换?