跑hb_compile的时候,怎么指定gpu id啊?我发现我用了export CUDA_VISIBLE_DEVICES=1没有用额,还是用的gpu0。

专栏算法工具链J6 PTQ量化怎么指定gpu id

J6 PTQ量化怎么指定gpu id

已解决

长城上贴瓷砖2024-12-31

76

7

算法工具链

征程6

评论2

0/600

HuangHui

HuangHuiLv.5

hb_compile你为什么要用GPU呢

2024-12-3105 HuangHui回复长城上贴瓷砖:

HuangHui回复长城上贴瓷砖:关于 hb_compile 对GPU的使用,这里整体跟你说明一下:

hb_compile在calibration阶段会尝试使用GPU执行模型的forward推理以为calibration节点首收集校准数据,推理过程使用的就是onnxruntime的 InferenceSession,所以推理规程如果要用到GPU,也是通过 onnxruntime的 InferenceSession 进行设置的。所以:

1. 从常规onnx执行的过程看,可以通过设置环境变量 CUDA_VISIBLE_DEVICES设置 InferenceSession推理时所用的gpu id。

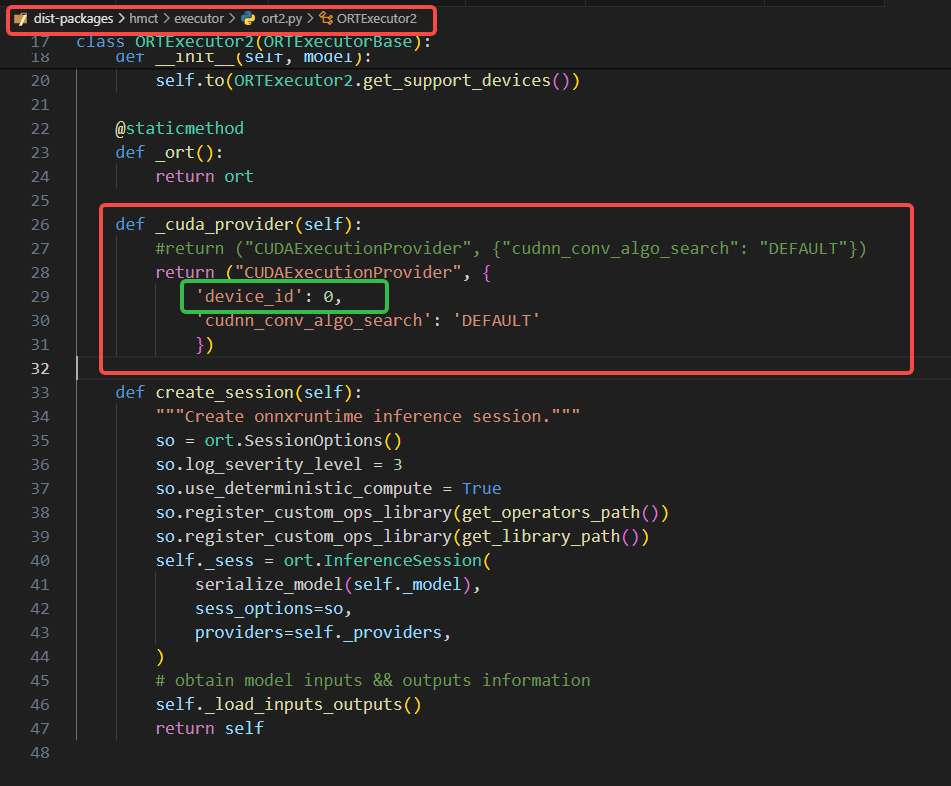

2. 如果1确实尝试过了不行,那你可以通过修改一下工具链的脚本文件(/usr/local/lib/python3.10/dist-packages/hmct/executor/ort2.py)进行设置和测试,修改的文件和方式如下:

2025-01-030

2025-01-030