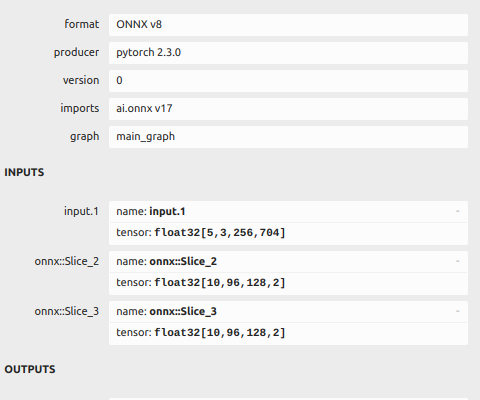

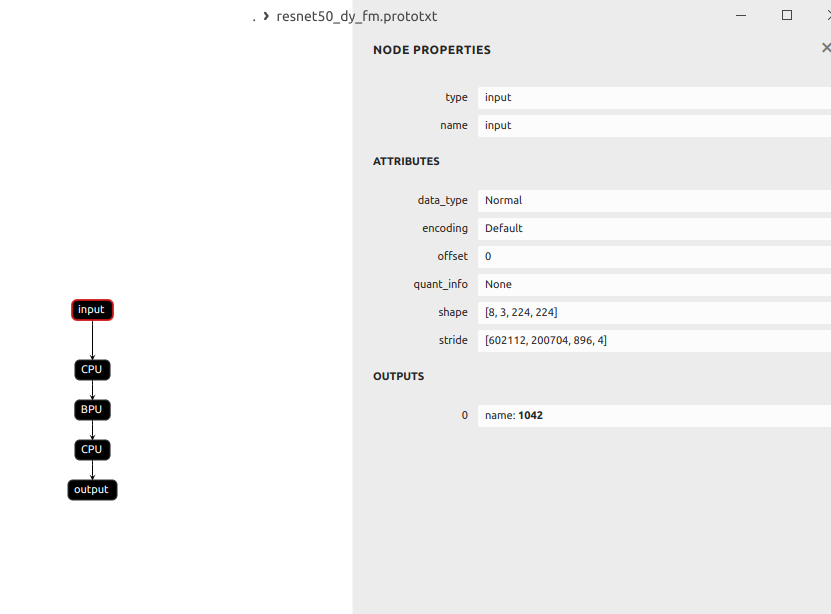

设置calib batch > 1 , 网络输入是单batch的 但是为了calib更快以及calib 收集scale 更优,

2025-03-05 10:39:10,998 INFO Start to calibrate the model.

2025-03-05 10:39:11,355 INFO There are 371 samples in the dataset.

2025-03-05 10:39:17,629 INFO Provided calibration data md5: 217904568588cdfd32f7bc6b7b4b5c48

2025-03-05 10:39:17,630 INFO Run calibration model with modelwise search method.

2025-03-05 10:39:18,182 INFO Calibration using batch 1