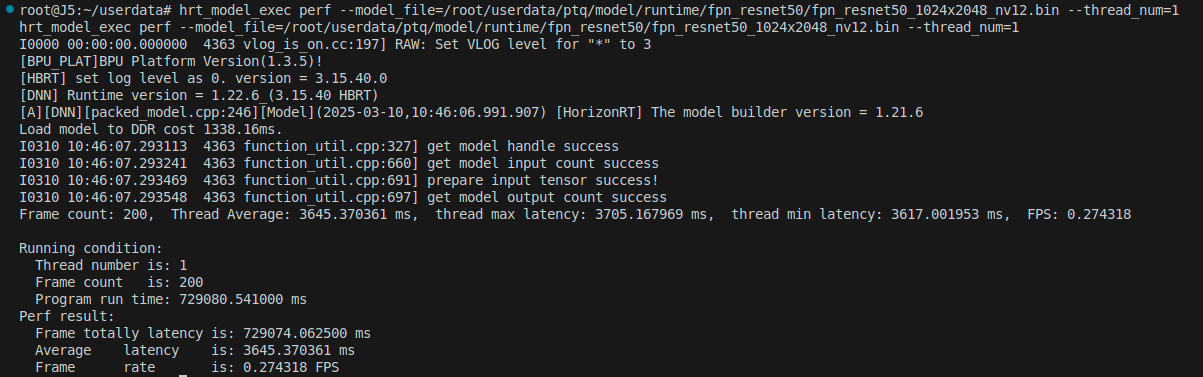

我自己通过PTQ方法量化了FPN模型,用hb_mapper makertbin量化显示成功转换,相关log在附件中。但当我在J5板端想部署模型测帧率时,出现了图中所示的错误,请问是什么原因?

专栏算法工具链J5板端部署模型时出现内存分配问题

J5板端部署模型时出现内存分配问题

已解决

默认383362025-03-07

75

13

附件:

算法工具链

征程5

评论3

0/1000

默认38336

默认38336Lv.1

我的fps_workflow.json文件配置如下

上述问题是在调用fps.sh时出现的,fps.sh脚本内容如下

我的fps_workflow.json文件配置如下

上述问题是在调用fps.sh时出现的,fps.sh脚本内容如下

我的fps_workflow.json文件配置如下

上述问题是在调用fps.sh时出现的,fps.sh脚本内容如下

我的fps_workflow.json文件配置如下

上述问题是在调用fps.sh时出现的,fps.sh脚本内容如下

我的fps_workflow.json文件配置如下

上述问题是在调用fps.sh时出现的,fps.sh脚本内容如下

2025-03-0701 DR_KAN

DR_KANLv.4

模型太大,ION内存不够了,试下单线程能不能推理

2025-03-1009 Huanghui回复默认38336:https://developer.d-robotics.cc/forumDetail/216687795937475073 bpu内存不足的问题 可能可以参考这个修改,希望对你有帮助2025-03-120

Huanghui回复默认38336:https://developer.d-robotics.cc/forumDetail/216687795937475073 bpu内存不足的问题 可能可以参考这个修改,希望对你有帮助2025-03-120