borad: J6-E

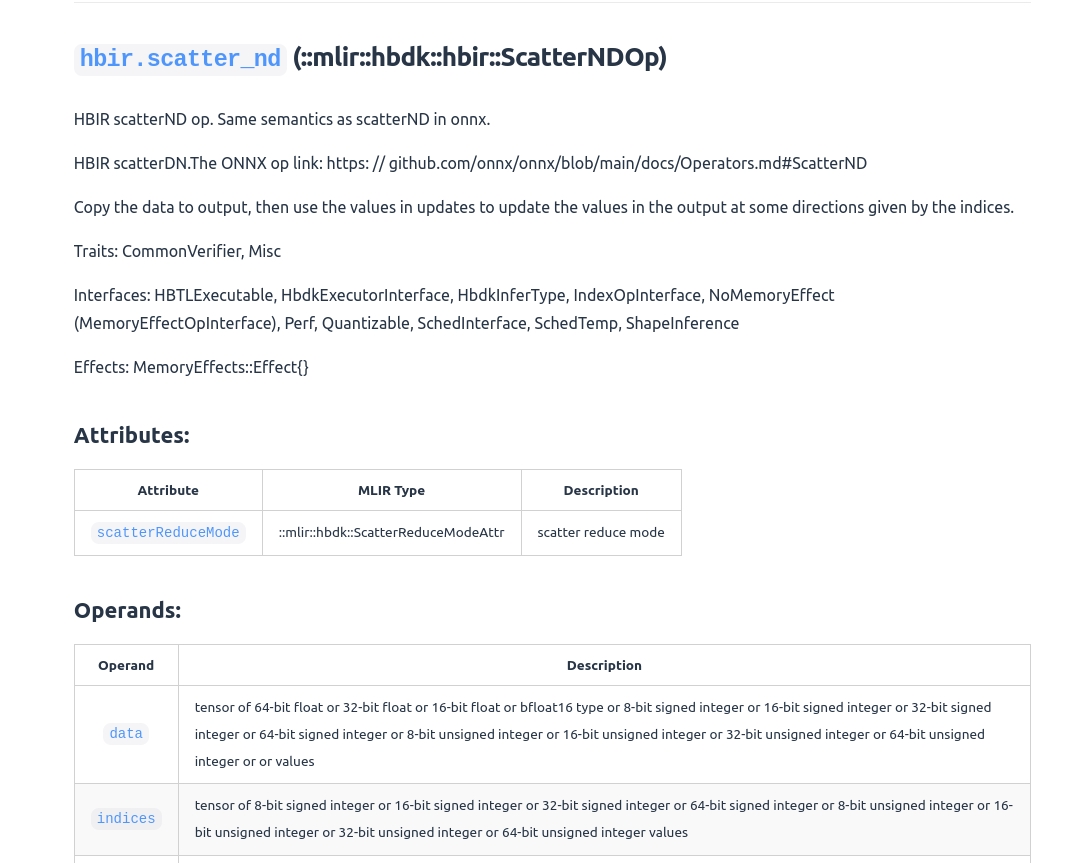

scatternd 算子是在cpu上运行的,量化参数是以"all_node_type": "int16"进行。

scatternd 算子是在cpu上运行的,量化参数是以"all_node_type": "int16"进行。

"Node-10-quant::quantize-ScatterND_25_id_29_cpu_segment_10": {

"avg_time": 31.224700000000002,

"max_time": 31.399,

"min_time": 30.905

},

"Node-4-quant::dequantize-ScatterND_25_id_29_cpu_segment_4": {

"avg_time": 5.48812,

"max_time": 5.606,

"min_time": 5.178

},