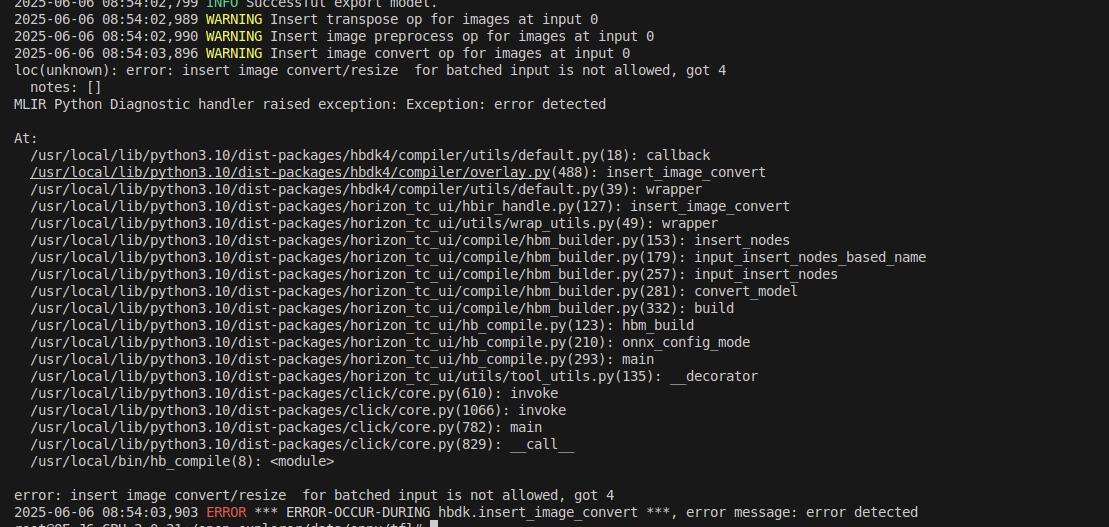

你好,这个问题你可以使用如下方式进行处理:

1.input_shape 的batch可以为4,但是请务必先将input_type_train和input_type_rt参数配置为featuremap,然是 使⽤ hb_compile⼯具⽣成 *ptq_model.onnx 进行模型编译,提示:编译命令可以使用--skip compile参数加速。

2. 使用如下代码对生成的 *ptq_model.onnx 进行二次处理:沿batch维度拆开,并插⼊ 前处理节点和格式转换节点 ,并进行编译。

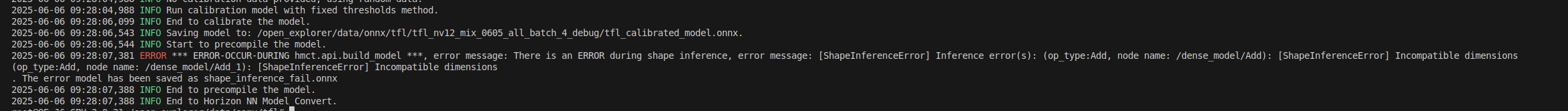

你好,这个问题你可以使用如下方式进行处理:

1.input_shape 的batch可以为4,但是请务必先将input_type_train和input_type_rt参数配置为featuremap,然是 使⽤ hb_compile⼯具⽣成 *ptq_model.onnx 进行模型编译,提示:编译命令可以使用--skip compile参数加速。

2. 使用如下代码对生成的 *ptq_model.onnx 进行二次处理:沿batch维度拆开,并插⼊ 前处理节点和格式转换节点 ,并进行编译。

你好,这个问题你可以使用如下方式进行处理:

1.input_shape 的batch可以为4,但是请务必先将input_type_train和input_type_rt参数配置为featuremap,然是 使⽤ hb_compile⼯具⽣成 *ptq_model.onnx 进行模型编译,提示:编译命令可以使用--skip compile参数加速。

2. 使用如下代码对生成的 *ptq_model.onnx 进行二次处理:沿batch维度拆开,并插⼊ 前处理节点和格式转换节点 ,并进行编译。

你好,这个问题你可以使用如下方式进行处理:

1.input_shape 的batch可以为4,但是请务必先将input_type_train和input_type_rt参数配置为featuremap,然是 使⽤ hb_compile⼯具⽣成 *ptq_model.onnx 进行模型编译,提示:编译命令可以使用--skip compile参数加速。

2. 使用如下代码对生成的 *ptq_model.onnx 进行二次处理:沿batch维度拆开,并插⼊ 前处理节点和格式转换节点 ,并进行编译。