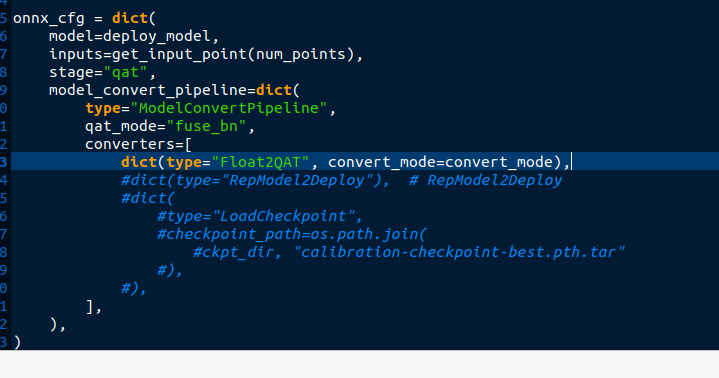

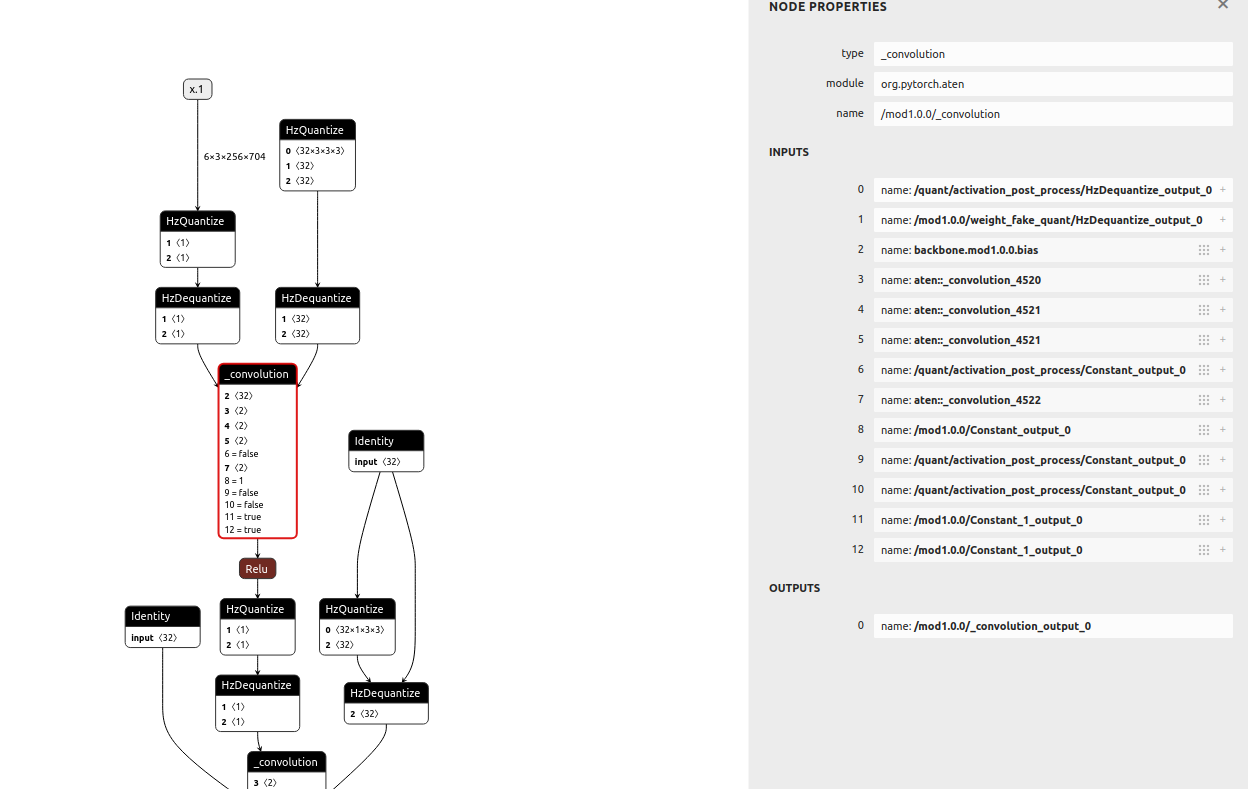

采用J6的V3.0.17和v3.0.22版本中的export_onnx.py导出qat模型,使用的是configs/bev/bev_lss_efficientnetb0_multitask_nuscenes.py,导出的qat.onnx模型中的卷积为什么还属于pytorch域中_convolution算子,并未转换到onnx域中。怎么样操作才能到onnx域。

采用J6的V3.0.17和v3.0.22版本中的export_onnx.py导出qat模型,使用的是configs/bev/bev_lss_efficientnetb0_multitask_nuscenes.py,导出的qat.onnx模型中的卷积为什么还属于pytorch域中_convolution算子,并未转换到onnx域中。怎么样操作才能到onnx域。使用指令:python3 tools/export_onnx.py --config configs/bev/bev_lss_efficientnetb0_multitask_nuscenes.py