J6

OE包V3.031

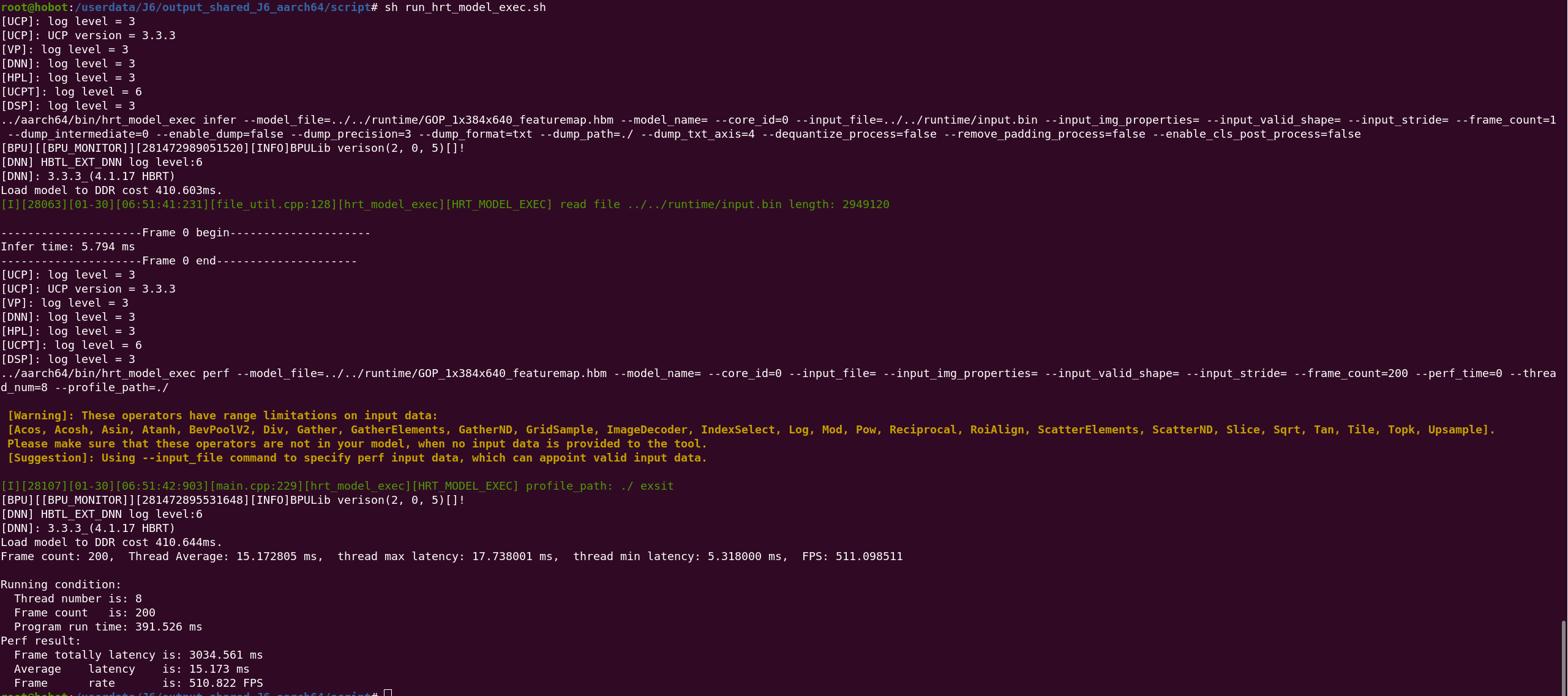

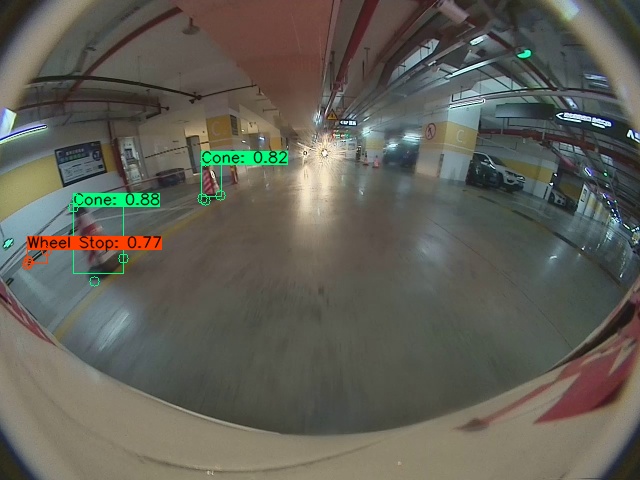

x86端验证hbm和bc模型输出一致且正确做图,上板部署遇到输出为0情况,图像及tensor处理使用示例代码进行操作,进行如下几种尝试输出皆无结果

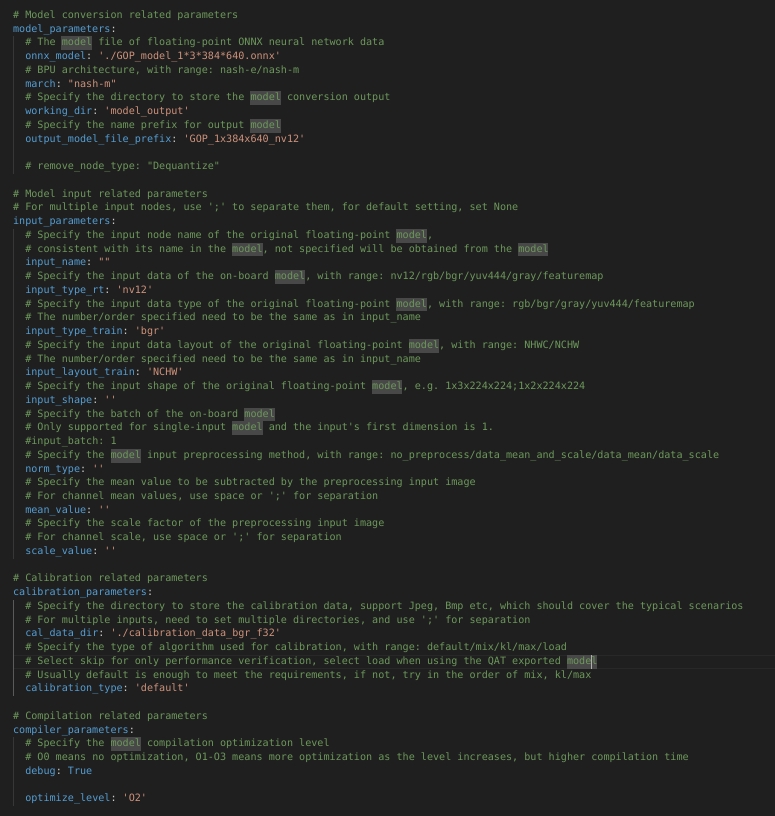

ptq input_type_rt : nv12 使用00_quick_start/resnet_nv12示例代码里面的 prepare_tensor 及read_image_2tensorasnv12函数进行数据预处理,模型推理后解析出来结果都为0

ptq input_type_rt : nv12

extra_params: {"input_no_padding": True, "output_no_padding": True}使用00_quick_start/resnet_nv12示例代码里面的 prepare_tensor 及read_image_2tensorasnv12函数进行数据预处理,模型推理后解析出来结果都为0

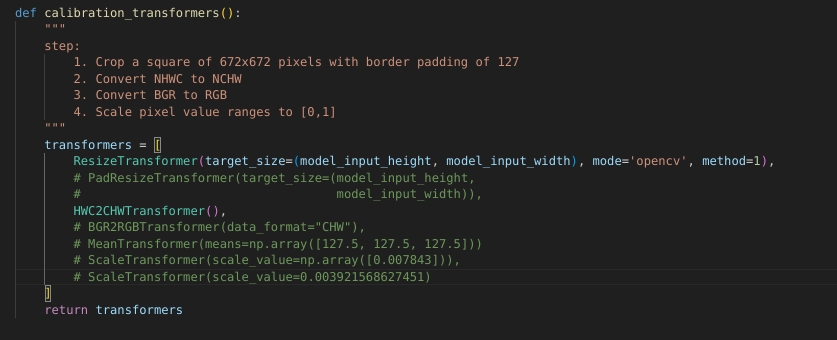

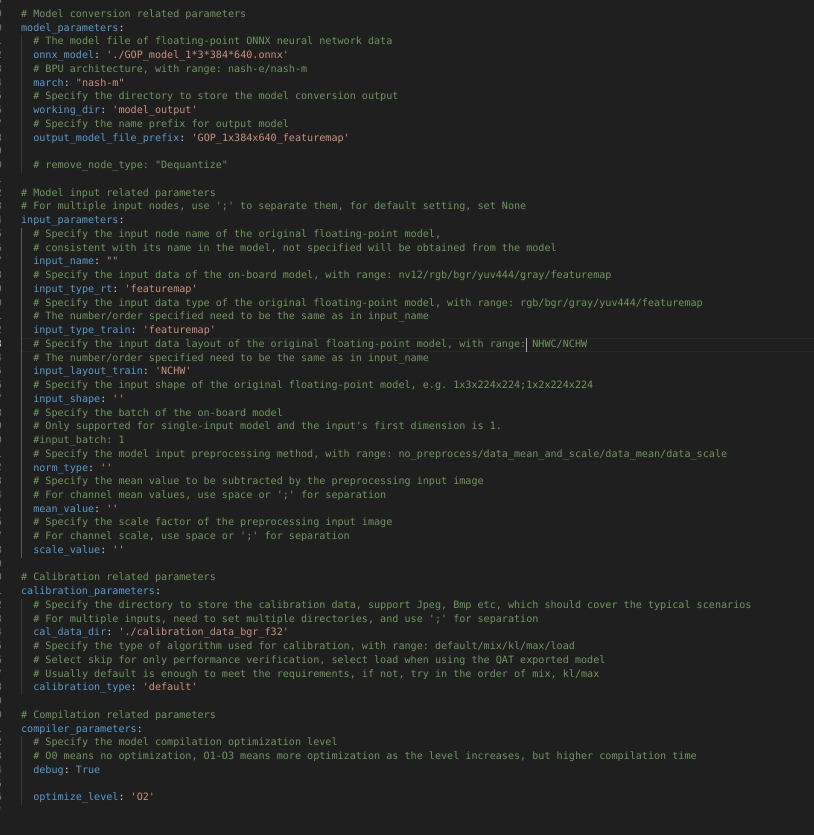

- input_type_rt: 'featuremap'input_type_train: 'featuremap'

使用00_quick_start/resnet_rgb示例代码里面的 prepare_tensor 及 OE包文档里的读取.bin(校准集)文件示例进行数据预处理,模型推理后解析出来结果都为0

专栏算法工具链J6 量化部署,板端output输出全是0,使用的数据前处理及后处理示例代码

J6 量化部署,板端output输出全是0,使用的数据前处理及后处理示例代码

已解决

默认579842025-07-30

353

44

算法工具链

征程6技术深度解析

评论7

0/600

我就是按照OE包第一个部署示例读binary文件做的,输出也全是0

我就是按照OE包第一个部署示例读binary文件做的,输出也全是0 https://nxzby0gauqy.feishu.cn/wiki/DKhowfg5IiFW0ZkTBPlcwLAGnBd?from=from_copylink

https://nxzby0gauqy.feishu.cn/wiki/DKhowfg5IiFW0ZkTBPlcwLAGnBd?from=from_copylink