【j5】

使用C++接口

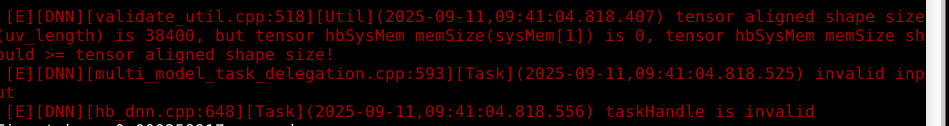

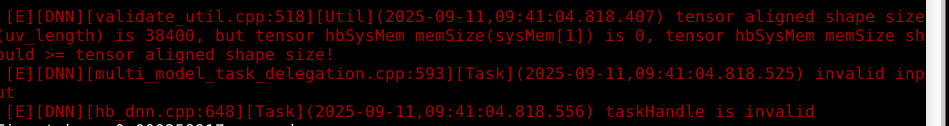

如果按照sample中的示例编写,运行的时候会报一个输入数据的错误,应该是和nv12_separate相关(我的模型输入alignedSize是115200):

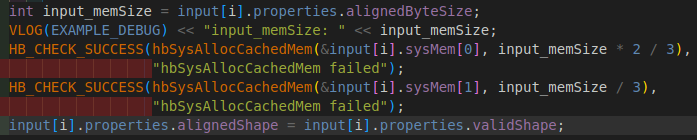

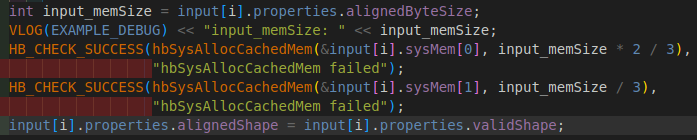

因此我做了如下修改:

修改之后到推理那一步直接segmentation fault了。

请问我这样的修改是不是有问题呢?

请问我这样的修改是不是有问题呢?

【j5】

使用C++接口

如果按照sample中的示例编写,运行的时候会报一个输入数据的错误,应该是和nv12_separate相关(我的模型输入alignedSize是115200):

因此我做了如下修改: